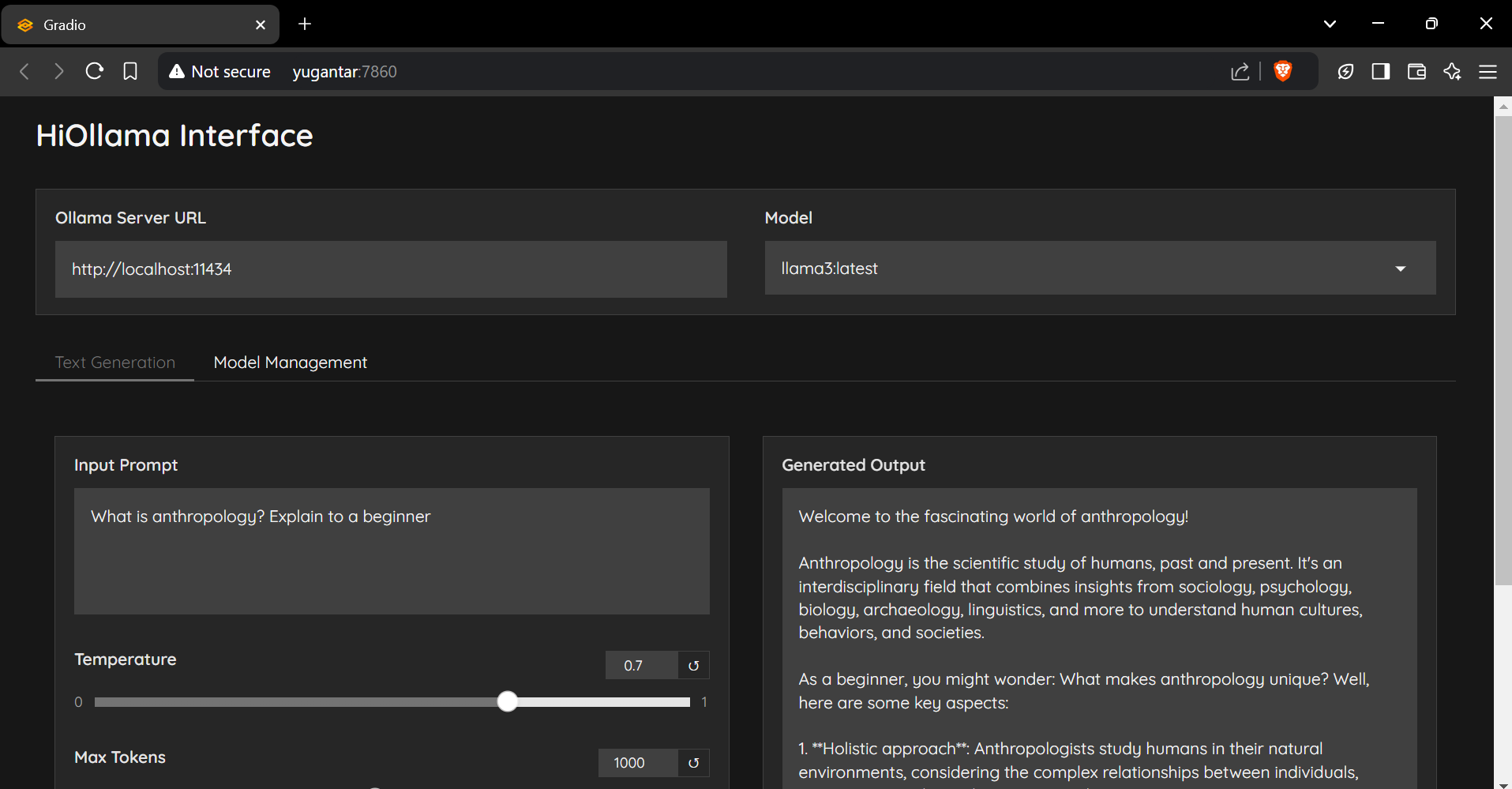

HiOllama

1.0.0

Una interfaz elegante y fácil de usar para interactuar con modelos Ollama, construidos con Python y Gradio.

git clone https://github.com/smaranjitghose/HiOllama.git

cd HiOllama # Windows

python -m venv env

. e nv S cripts a ctivate

# Linux/Mac

python3 -m venv env

source env/bin/activatepip install -r requirements.txt # Linux/Mac

curl -fsSL https://ollama.ai/install.sh | sh

# For Windows, install WSL2 first, then run the above command ollama servepython main.py http://localhost:7860

La configuración predeterminada se puede modificar en main.py :

DEFAULT_OLLAMA_URL = "http://localhost:11434"

DEFAULT_MODEL_NAME = "llama3" Error de conexión

ollama serve )Modelo no encontrado

ollama pull model_nameollama listConflicto portuario

main.py : app . launch ( server_port = 7860 ) # Change to another port ¡Las contribuciones son bienvenidas! No dude en enviar una solicitud de extracción.

git checkout -b feature/AmazingFeature )git commit -m 'Add some AmazingFeature' )git push origin feature/AmazingFeature )Este proyecto tiene licencia bajo la licencia MIT; consulte el archivo de licencia para obtener más detalles.

Hecho con ❤️ por Smaranjit Ghose