HiOllama

1.0.0

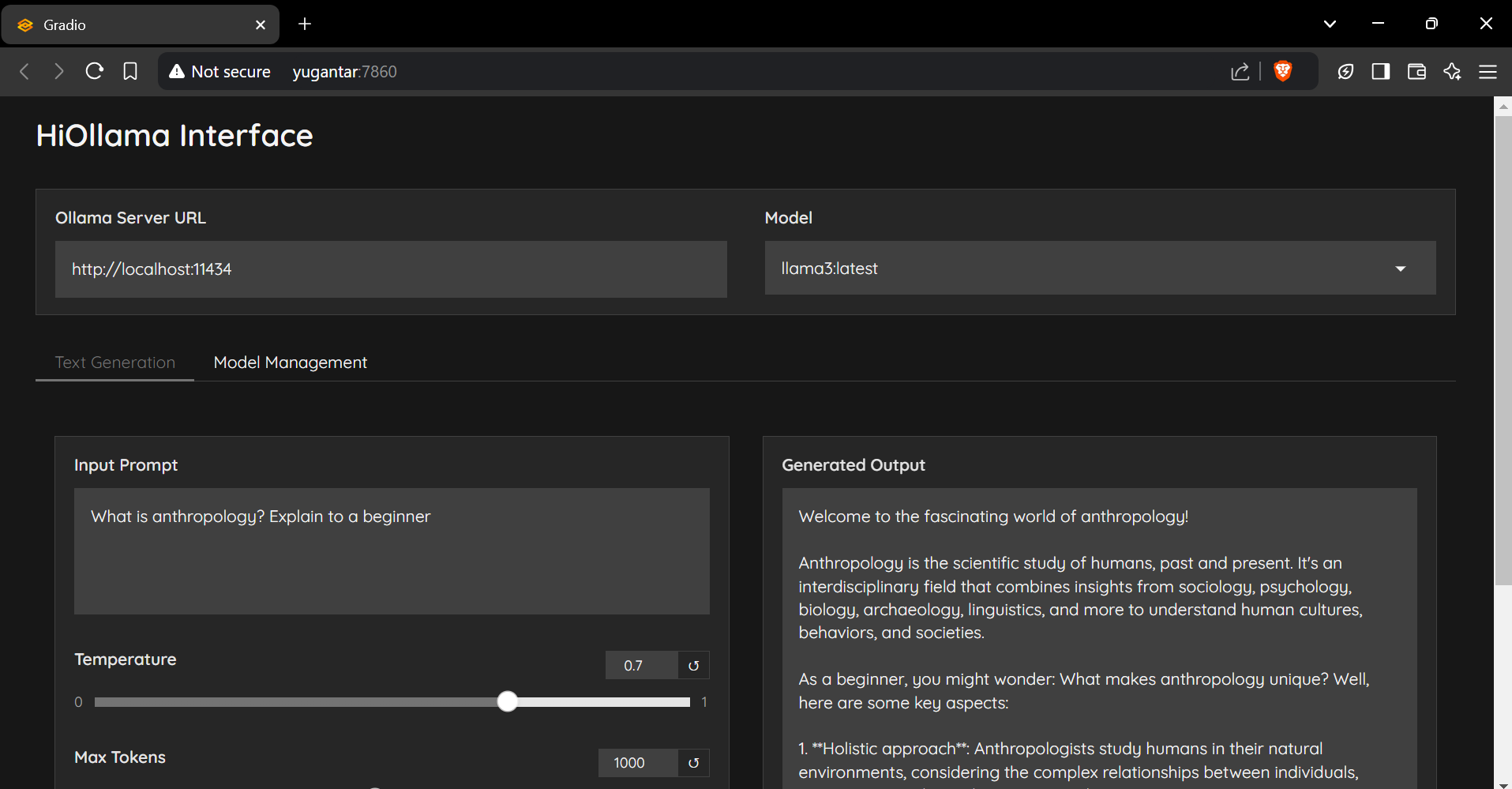

PythonとGradioで構築されたOllamaモデルと対話するための洗練されたユーザーフレンドリーなインターフェイス。

git clone https://github.com/smaranjitghose/HiOllama.git

cd HiOllama # Windows

python -m venv env

. e nv S cripts a ctivate

# Linux/Mac

python3 -m venv env

source env/bin/activatepip install -r requirements.txt # Linux/Mac

curl -fsSL https://ollama.ai/install.sh | sh

# For Windows, install WSL2 first, then run the above command ollama servepython main.py http://localhost:7860

デフォルト設定はmain.pyで変更できます:

DEFAULT_OLLAMA_URL = "http://localhost:11434"

DEFAULT_MODEL_NAME = "llama3" 接続エラー

ollama serve )モデルが見つかりません

ollama pull model_nameollama listポート競合

main.pyのポートを変更: app . launch ( server_port = 7860 ) # Change to another port 貢献は大歓迎です!プルリクエストをお気軽に送信してください。

git checkout -b feature/AmazingFeature )git commit -m 'Add some AmazingFeature' )git push origin feature/AmazingFeature )このプロジェクトは、MITライセンスに基づいてライセンスされています。詳細については、ライセンスファイルを参照してください。

Smaranjit Ghoseによって❤️で作られています