No campo da inteligência artificial, uma tecnologia disruptiva está emergente silenciosamente. Recentemente, a Infception Labs anunciou o lançamento da série Mercury of Diffusion Language Models (DLLMS), uma nova geração de modelos de idiomas projetados para gerar texto de alta qualidade de maneira rápida e eficiente. Comparado com o modelo de grande linguagem autorregressivo tradicional, o Mercúrio aumentou a velocidade de geração em até 10 vezes, permitindo mais de 1.000 marcadores por segundo nas placas gráficas da NVIDIA H100, uma velocidade anteriormente alcançada apenas por chips personalizados.

O Mercury Coder, o primeiro produto da série Mercury, foi revelado em testes públicos. O modelo se concentra na geração de código, demonstra excelente desempenho e supera muitos modelos de otimização de velocidade existentes em vários benchmarks de programação, como o GPT-4O Mini e Claude3.5 Haiku, enquanto também quase 10 vezes mais rápido em velocidade. De acordo com o feedback do desenvolvedor, a conclusão do código da Mercury é mais popular. No teste da C Opilot Arena, o Mercury Coder Mini está entre os melhores do desempenho e é um dos modelos mais rápidos.

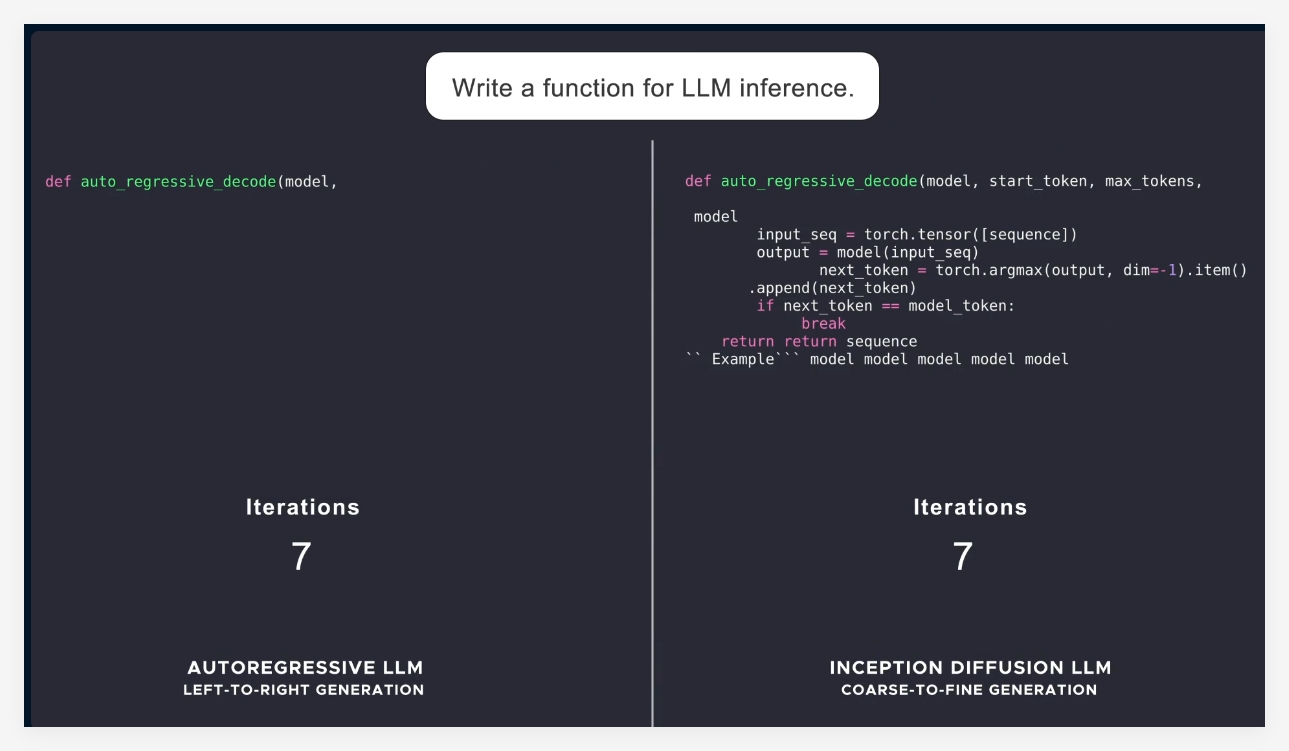

A maioria dos modelos de idiomas atuais adota o AutoRegression, ou seja, gera tags uma a uma da esquerda para a direita, resultando no processo de geração inevitavelmente sendo seqüencial, com altos custos de latência e cálculo. Mercury usa um método de geração "grosso para fina", começando por ruído puro, e gradualmente refina a saída após várias etapas "denoising". Isso permite que os modelos de mercúrio sejam processados em paralelo com várias tags na geração, permitindo uma melhor inferência e capacidade de resposta estruturada.

Com o lançamento da série Mercury, os laboratórios da Infception demonstram o grande potencial de modelos de difusão nos campos da geração de texto e código. Em seguida, a empresa também planeja lançar um modelo de idioma adequado para aplicativos de bate -papo para expandir ainda mais os cenários de aplicativos do modelo de linguagem de difusão. Esses novos modelos terão recursos mais fortes de proxy inteligentes, capazes de planejamento complexo e geração de longo prazo. Ao mesmo tempo, sua eficiência faz com que funcione bem em dispositivos restritos a recursos, como smartphones e laptops.

No geral, o lançamento do Mercúrio marca um avanço importante na tecnologia de inteligência artificial, não apenas melhorando bastante a velocidade e a eficiência, mas também fornecendo soluções de maior qualidade para a indústria.

Introdução oficial: https://www.inceptionlabs.ai/news

Experiência online: https://chat.inceptionlabs.ai/

Pontos -chave:

A série Mercúrio de modelos de grande linguagem (DLLMs) é lançada, com as velocidades de geração aumentadas para 1.000 marcadores por segundo.

O Mercury Coder se concentra na geração de código e supera muitos modelos existentes no benchmarking e tem um bom desempenho.

As formas inovadoras de modelos de difusão tornam a geração de texto mais eficiente e precisa, fornecendo novas possibilidades para aplicativos de proxy inteligentes.