인공 지능 분야에서 파괴적인 기술이 조용히 떠오르고 있습니다. 최근 Inception Labs는 고품질 텍스트를 빠르고 효율적으로 생성하도록 설계된 새로운 세대의 언어 모델 인 Mercury 시리즈의 확산 대형 언어 모델 (DLLM)의 출시를 발표했습니다. 전통적인 자동 회귀 대형 언어 모델과 비교할 때 Mercury는 최대 10 배까지의 생성 속도를 증가시켜 NVIDIA H100 그래픽 카드에서 초당 1,000 개 이상의 마커를 가능하게했습니다.

Mercury 시리즈의 첫 번째 제품인 Mercury Coder는 공개 테스트에서 공개되었습니다. 이 모델은 코드 생성에 중점을두고 탁월한 성능을 보여 주며 GPT-4O MINI 및 Claude3.5haiku와 같은 여러 프로그래밍 벤치 마크에서 기존 속도 최적화 모델을 능가하는 반면, 속도는 거의 10 배 빠릅니다. 개발자 피드백에 따르면 Mercury의 코드 완료가 더 인기가 있습니다. C Opilot Arena의 테스트에서 Mercury Coder Mini는 성능의 최고 중 하나이며 가장 빠른 모델 중 하나입니다.

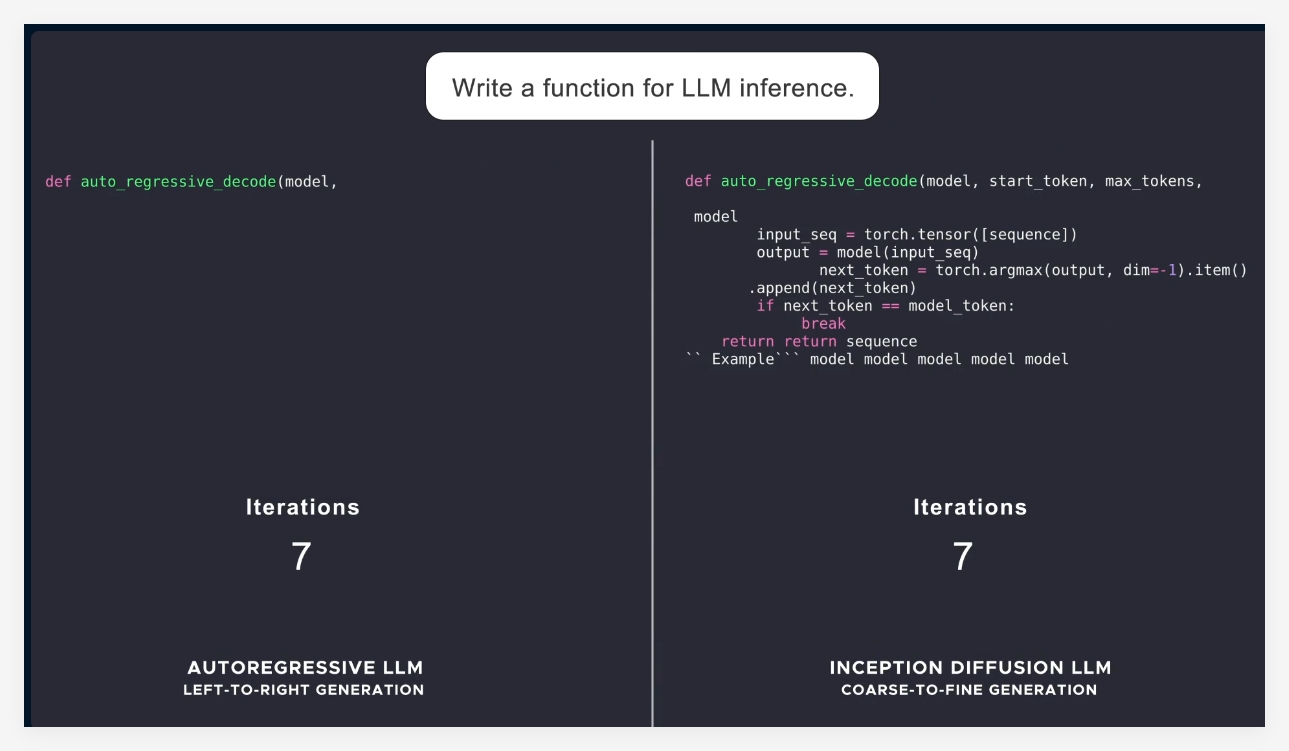

대부분의 현재 언어 모델은 자동 회귀를 채택합니다. 즉, 태그를 왼쪽에서 오른쪽으로 하나씩 생성하여 생성 프로세스가 필연적으로 순차적이며 대기 시간과 계산 비용이 높아집니다. Mercury는 순수한 노이즈부터 시작하여 "거친 내지 미세한"생성 방법을 사용하고 몇 가지 "비난"단계 후에 출력을 점차 개선합니다. 이를 통해 수은 모델은 세대의 여러 태그와 병렬로 처리 될 수 있으므로 더 나은 추론과 구조화 된 응답 성이 가능합니다.

Mercury Series가 출시되면서 Inception Labs는 텍스트 및 코드 생성 분야에서 확산 모델의 큰 잠재력을 보여줍니다. 다음으로, 회사는 채팅 애플리케이션에 적합한 언어 모델을 시작하여 확산 언어 모델의 응용 프로그램 시나리오를 추가로 확장 할 계획입니다. 이 새로운 모델은 더 강력한 지능형 프록시 기능을 갖추고 있으며 복잡한 계획과 장기 생성이 가능합니다. 동시에 효율성은 스마트 폰 및 랩톱과 같은 자원으로 제한된 장치에서 잘 작동합니다.

전반적으로, 수은의 출시는 인공 지능 기술의 중요한 발전으로, 속도와 효율성을 크게 향상시킬뿐만 아니라 업계에 더 높은 품질의 솔루션을 제공합니다.

공식 소개 : https://www.inceptionlabs.ai/news

온라인 경험 : https://chat.inceptionlabs.ai/

핵심 사항 :

Mercury 시리즈의 확산 큰 언어 모델 (DLLM)이 시작되며 초당 1,000 마커로 생성 속도가 증가했습니다.

Mercury Coder는 코드 생성에 중점을두고 벤치마킹에서 기존의 많은 모델을 능가하고 잘 수행합니다.

확산 모델의 혁신적인 방법은 텍스트 생성을보다 효율적이고 정확하게 만들어 스마트 프록시 응용 프로그램에 새로운 가능성을 제공합니다.