2024年7月3日、上海人工知能研究所はSensetimeと手を組み、共同で新世代の大規模な言語モデル-Scholar Puyu 2.5(Internlm2.5)をリリースしました。このリリースは、人工知能の分野における中国の技術革新、特に大規模な言語モデルの研究と応用における重要なステップを告げます。

InternLM2.5-7Bモデルは公式にオープンソースであり、スケールの他のモデルが次々と公開されます。上海の人工知能研究所は、高品質のオープンソースモデルを通じて、無料の商業ライセンスを提供し続け、グローバルコミュニティの革新と開発をサポートし続けることを約束しています。この動きは、人工知能技術のアプリケーションのしきい値を下げるだけでなく、グローバルな開発者にとってより革新的な機会を提供します。

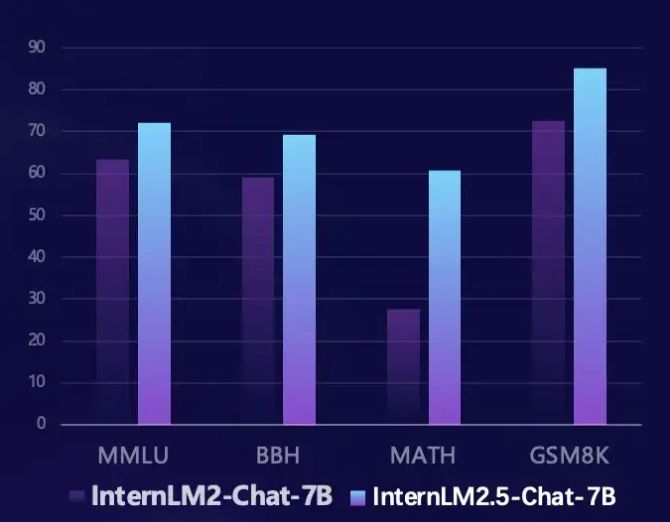

Internlm2.5は、いくつかの重要な分野で大幅な改善を達成しました。第一に、その推論能力が大幅に向上し、いくつかの寸法のパフォーマンスはllama3-70bモデルを上回ります。特に数学的評価セット数学では、Internlm2.5は100%のパフォーマンス改善を達成し、60%の精度を持ち、これはGPT-4 Turbo 1106バージョンに匹敵します。この画期的な進捗状況は、複雑な問題を解決するためのより強力なツールを提供します。

第二に、INTENLM2.5は、最大1Mトークンのコンテキスト処理機能をサポートし、約120万人の漢字の長い記事を処理できます。コンテキストの長さと合成データを増やすことにより、モデルは長いドキュメントの理解とエージェントの相互作用のために最適化されており、複雑なテキストを扱うときにより便利になります。

さらに、Internlm2.5には、独立してツールを計画および呼び出す機能もあります。数百のWebページから情報を検索および統合し、MindSearch Multi-Agentフレームワークを介して人間の思考プロセスをシミュレートして、ネットワーク情報を効果的に統合できます。この関数は、情報の検索と知識統合のための新しいソリューションを提供し、モデルの実用性と知性を大幅に改善します。

開発者は、次のリンクを使用して、Internlm2.5に関する詳細情報とリソースを取得できます。

githubリンク: https://github.com/internlm/internlm

モデルリンク: https://www.modelscope.cn/models/shanghai_ai_laboratory/internlm2_5-7b-chat

Scholar Puyu Homepage: https://internlm.intern-ai.org.cn/