في 3 يوليو ، 2024 ، انضم مختبر شنغهاي للذكاء الاصطناعي مع وقت الحواس ، الذي أصدر جيلًا جديدًا من نموذج اللغة الكبير - الباحث PUYU 2.5 (Internlm2.5). يمثل هذا الإصدار خطوة مهمة في الابتكار التكنولوجي للصين في مجال الذكاء الاصطناعي ، وخاصة في البحث وتطبيق نماذج اللغة الكبيرة.

كان نموذج Internlm2.5-7b مفتوح المصدر رسميًا ، وسيتم فتح نماذج أخرى من الحجم للجمهور تلو الآخر. يعد مختبر شنغهاي بالذكاء الاصطناعي بمواصلة توفير الترخيص التجاري المجاني ودعم ابتكار وتطوير المجتمعات العالمية من خلال نماذج مفتوحة المصادر عالية الجودة. هذه الخطوة لا تخفض فقط عتبة تطبيق تكنولوجيا الذكاء الاصطناعي ، ولكنها توفر أيضًا فرصًا أكثر ابتكارًا للمطورين العالميين.

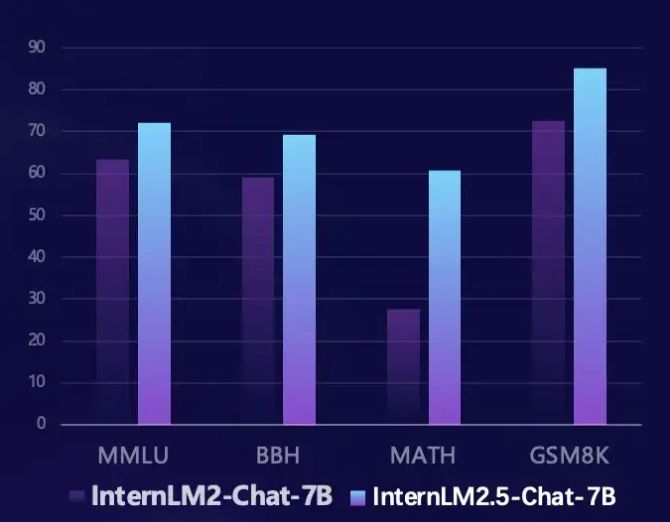

حقق Internlm2.5 تحسينات كبيرة في العديد من المجالات الرئيسية. أولاً ، تم تعزيز قدرتها على الاستنتاج بشكل كبير ، وحتى أداء بعض الأبعاد يتجاوز نموذج LLAMA3-70B. لا سيما في مجموعة التقييم الرياضي ، يحقق Internlm2.5 تحسينًا بنسبة 100 ٪ في الأداء ولديه دقة 60 ٪ ، وهو ما يشبه إصدار GPT-4 Turbo 1106. يوفر هذا التقدم الذي تقدمه أداة أكثر قوة لحل المشكلات المعقدة.

ثانياً ، يدعم Internlm2.5 قدرات معالجة السياق التي تصل إلى 1 مليون رموز ويمكنها معالجة مواد طويلة من حوالي 1.2 مليون حرف صيني. من خلال زيادة طول السياق والبيانات الاصطناعية ، يتم تحسين النموذج لفهم المستندات الطويل وتفاعل الوكيل ، مما يجعله أكثر سهولة عند التعامل مع النص المعقد.

بالإضافة إلى ذلك ، يتمتع Internlm2.5 أيضًا بالقدرة على التخطيط والاتصال بشكل مستقل. يمكنه البحث ودمج المعلومات من مئات صفحات الويب ، ومحاكاة عمليات التفكير البشري من خلال إطار عمل MindSearch متعدد الوكلاء لدمج معلومات الشبكة بفعالية. توفر هذه الوظيفة حلًا جديدًا لاسترجاع المعلومات وتكامل المعرفة ، مما يؤدي إلى تحسين التطبيق العملي وذكاء النموذج بشكل كبير.

يمكن للمطورين الحصول على مزيد من المعلومات والموارد حول internlm2.5 من خلال الروابط التالية:

رابط Github: https://github.com/internlm/internlm

رابط النموذج: https://www.modelscope.cn/models/shanghai_ai_laboratory/internlm2_5-7b-chat

Puyu الصفحة الرئيسية: https://internlm.intern-ai.org.cn/