Calibrated BERT Fine Tuning

1.0.0

このリポジトリには、紙のコードが含まれています。

分散型および分配不足データのための微調整、EMNLP2020。

[紙] [スライド]

Bert Baseでのトレーニング:

CUDA_VISIBLE_DEVICES=0 python bert.py --dataset 20news-15 --seed 0

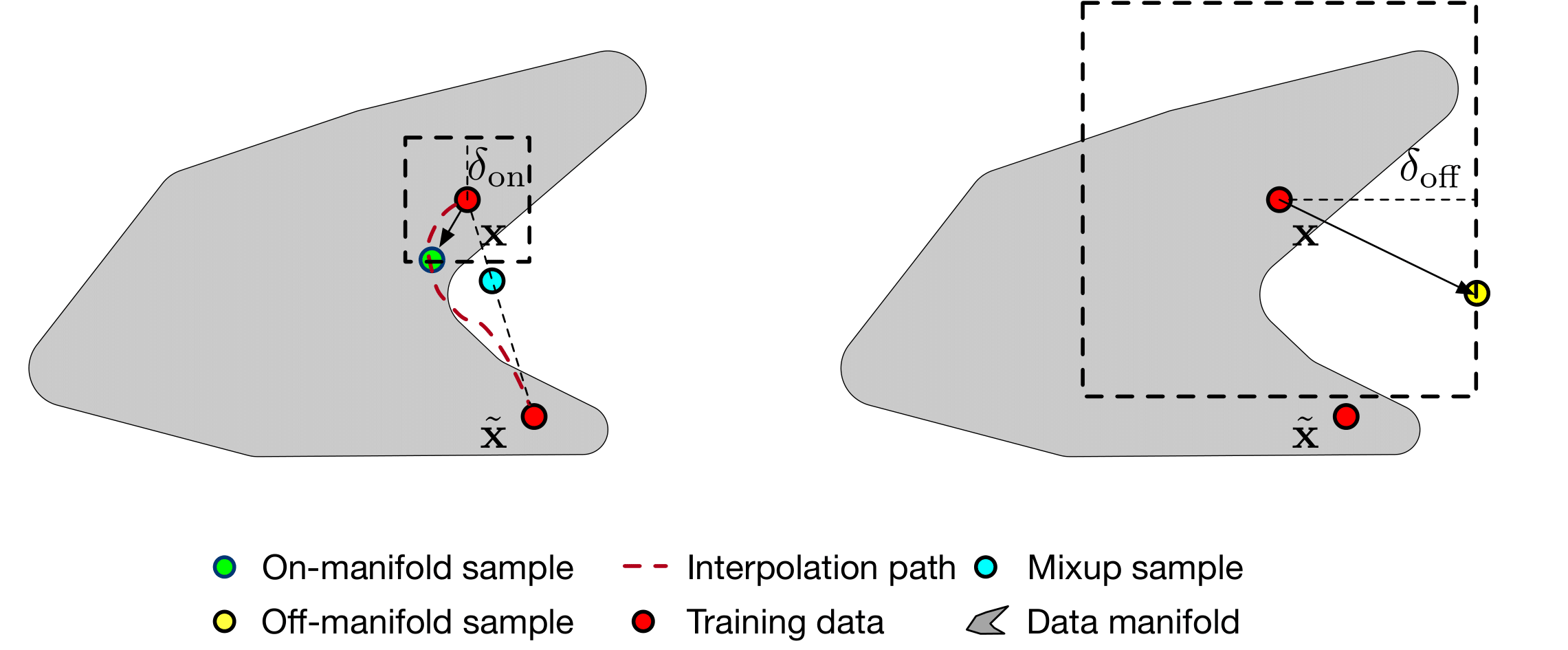

マニホールドスムージングによるトレーニング

CUDA_VISIBLE_DEVICES=0,1 python manifold-smoothing.py --dataset 20news-15 --seed 0 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

Bert Baseでの評価

python test.py --model base --in_dataset 20news-15 --out_dataset 20news-5 --index 0

温度スケーリングによる評価[1](訓練されたバートベースモデルに基づく)

python test.py --model temperature --in_dataset 20news-15 --out_dataset 20news-5 --index 0

MC-Dropout [2]での評価(訓練されたバートベースモデルに基づく)

python test.py --model mc-dropout --in_dataset 20news-15 --out_dataset 20news-5 --eva_iter 10 --index 0

マニホールドスムージングによる評価

python test.py --model manifold-smoothing --in_dataset 20news-15 --out_dataset 20news-5 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

[1] Guo、Chuan、Geoff Pleiss、Yu Sun、およびKilian Q. Weinberger。 「現代のニューラルネットワークのキャリブレーションについて。」機械学習に関する国際会議、pp。1321-1330。 2017年。

[2]ギャル、ヤリン、ゾウビンガラマニ。 「ベイジアン近似としてのドロップアウト:深い学習におけるモデルの不確実性を表す。」機械学習に関する国際会議、pp。1050-1059。 2016年。