Repo ini berisi kode kami untuk kertas:

Fine-tuning model bahasa yang dikalibrasi untuk data in-of-distribusi, EMNLP2020.

[kertas] [slide]

Pelatihan dengan Bert Base:

CUDA_VISIBLE_DEVICES=0 python bert.py --dataset 20news-15 --seed 0

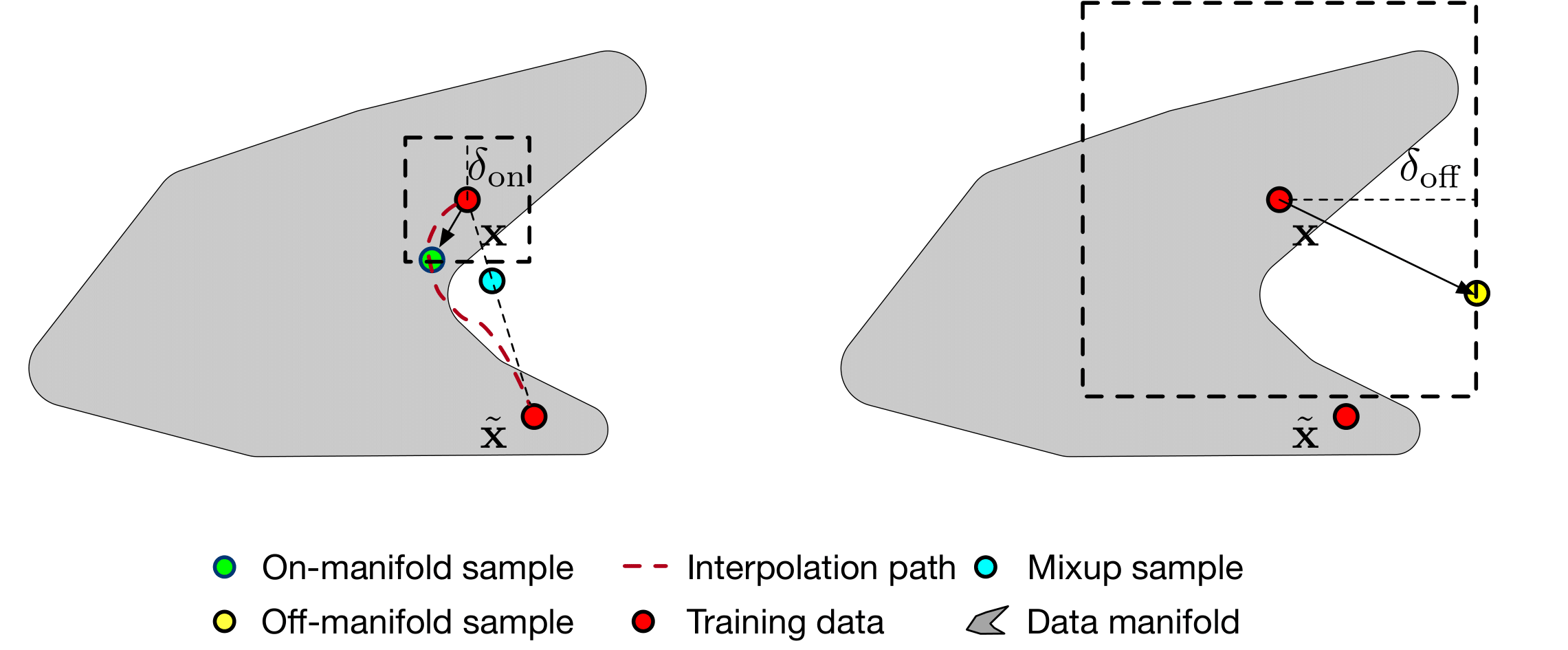

Pelatihan dengan perataan berlipat ganda

CUDA_VISIBLE_DEVICES=0,1 python manifold-smoothing.py --dataset 20news-15 --seed 0 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

Evaluasi dengan Base Bert

python test.py --model base --in_dataset 20news-15 --out_dataset 20news-5 --index 0

Evaluasi dengan penskalaan suhu [1] (berdasarkan model BAS-BASE terlatih)

python test.py --model temperature --in_dataset 20news-15 --out_dataset 20news-5 --index 0

Evaluasi dengan MC-DROPOUT [2] (berdasarkan model BAS-BASE terlatih)

python test.py --model mc-dropout --in_dataset 20news-15 --out_dataset 20news-5 --eva_iter 10 --index 0

Evaluasi dengan bermacam -macam perataan

python test.py --model manifold-smoothing --in_dataset 20news-15 --out_dataset 20news-5 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

[1] Guo, Chuan, Geoff Pleiss, Yu Sun, dan Kilian Q. Weinberger. "Kalibrasi jaringan saraf modern." Dalam Konferensi Internasional tentang Pembelajaran Mesin , hlm. 1321-1330. 2017.

[2] Gal, Yarin, dan Zoubin Ghahramani. "Dropout sebagai perkiraan Bayesian: mewakili model ketidakpastian dalam pembelajaran mendalam." Dalam Konferensi Internasional tentang Pembelajaran Mesin , hlm. 1050-1059. 2016.