Calibrated BERT Fine Tuning

1.0.0

يحتوي هذا الريبو على رمز الورق الخاص بنا:

نموذج اللغة المعايرة لبيانات التوزيع داخل وخارج التوزيع ، EMNLP2020.

[ورقة] [الشرائح]

التدريب مع قاعدة بيرت:

CUDA_VISIBLE_DEVICES=0 python bert.py --dataset 20news-15 --seed 0

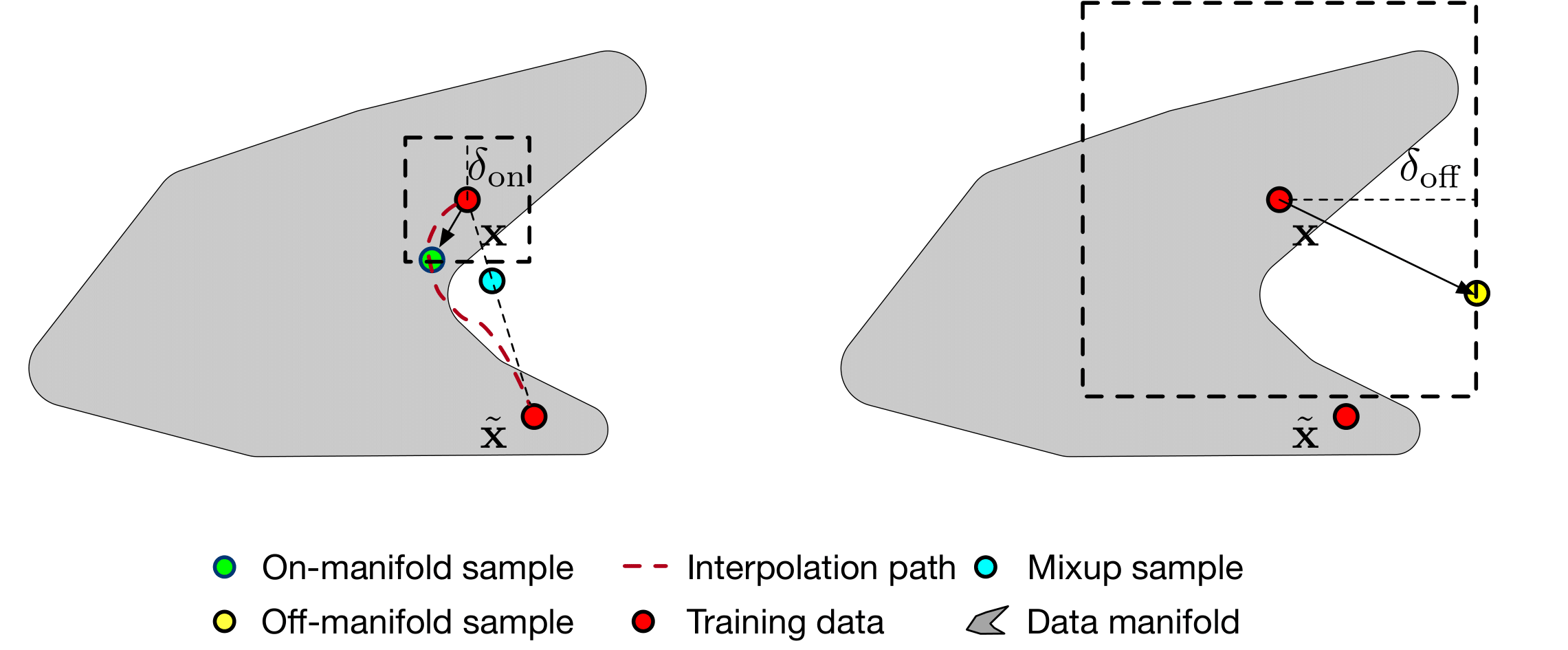

التدريب مع تجانس متعددة

CUDA_VISIBLE_DEVICES=0,1 python manifold-smoothing.py --dataset 20news-15 --seed 0 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

التقييم مع قاعدة بيرت

python test.py --model base --in_dataset 20news-15 --out_dataset 20news-5 --index 0

التقييم مع تحجيم درجة الحرارة [1] (استنادًا إلى نموذج Bert-Base المدرب)

python test.py --model temperature --in_dataset 20news-15 --out_dataset 20news-5 --index 0

التقييم مع MC-Dropout [2] (استنادًا إلى نموذج Bert-Base المدرب)

python test.py --model mc-dropout --in_dataset 20news-15 --out_dataset 20news-5 --eva_iter 10 --index 0

التقييم مع تجانس متعددة

python test.py --model manifold-smoothing --in_dataset 20news-15 --out_dataset 20news-5 --eps_in 0.0001 --eps_out 0.001 --eps_y 0.1

[1] Guo و Chuan و Geoff Pleiss و Yu Sun و Kilian Q. Weinberger. "حول معايرة الشبكات العصبية الحديثة." في المؤتمر الدولي للتعلم الآلي ، الصفحات 1321-1330. 2017.

[2] غال ، يارين ، وزوبين غهراماني. "التسرب كتقريب بايزي: تمثيل عدم اليقين النموذج في التعلم العميق." في المؤتمر الدولي للتعلم الآلي ، الصفحات 1050-1059. 2016.