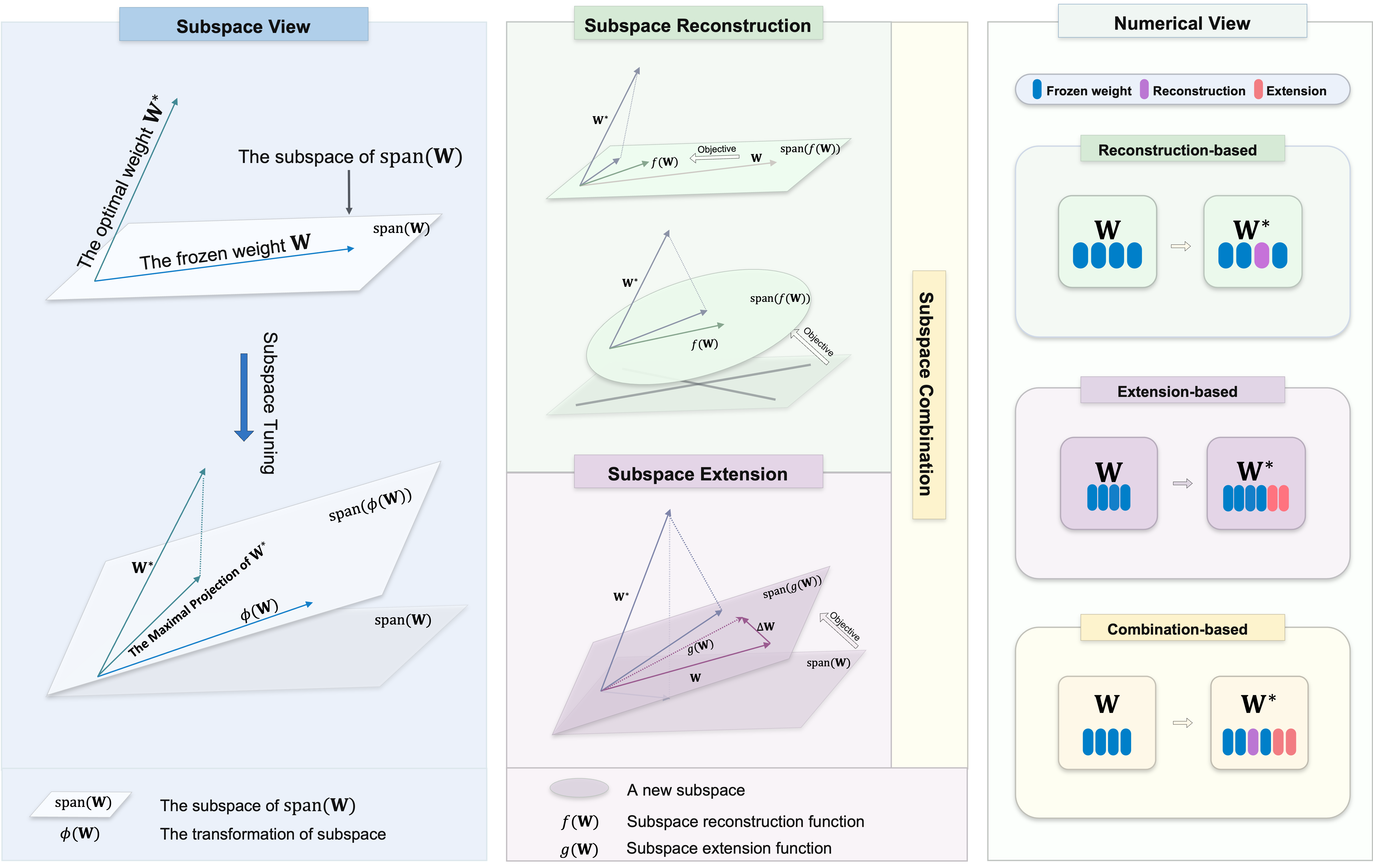

リポジトリへようこそ。これには、パラメーター効率の高い微調整(PEFT)のためのサブスペースチューニング方法の多様なコレクションが含まれています。サブスペースのチューニングは、元のパラメーターに最小限の変更を加えて、大規模な訓練を受けたモデルを特定のタスクに適応させるために不可欠です。最適な重みの最大投影を特定するよう努めています

この分野の研究者と実践者に包括的なリソースを提供し、プロジェクトへの容易な統合を促進することを目指しています。あなたがあなたのプロジェクトのためのリソースを見つけたり、貢献するためにここにいるかどうかにかかわらず、私たちはこのリポジトリがあなたの研究の旅の貴重で刺激的な部分になることを願っています。

このリポジトリには、私たちが取り組んだ他のプロジェクトのいくつかも含まれています。

このリポジトリでアルゴリズムを使用するには、リポジトリをクローンして、必要な依存関係をインストールします。

このリポジトリをクローンします:

git clone https://github.com/Chongjie-Si/Subspace-Tuning.git

cd Subspace-Tuning各フォルダーの指示に従ってください。

以下を含むいくつかのタスクをサポートします

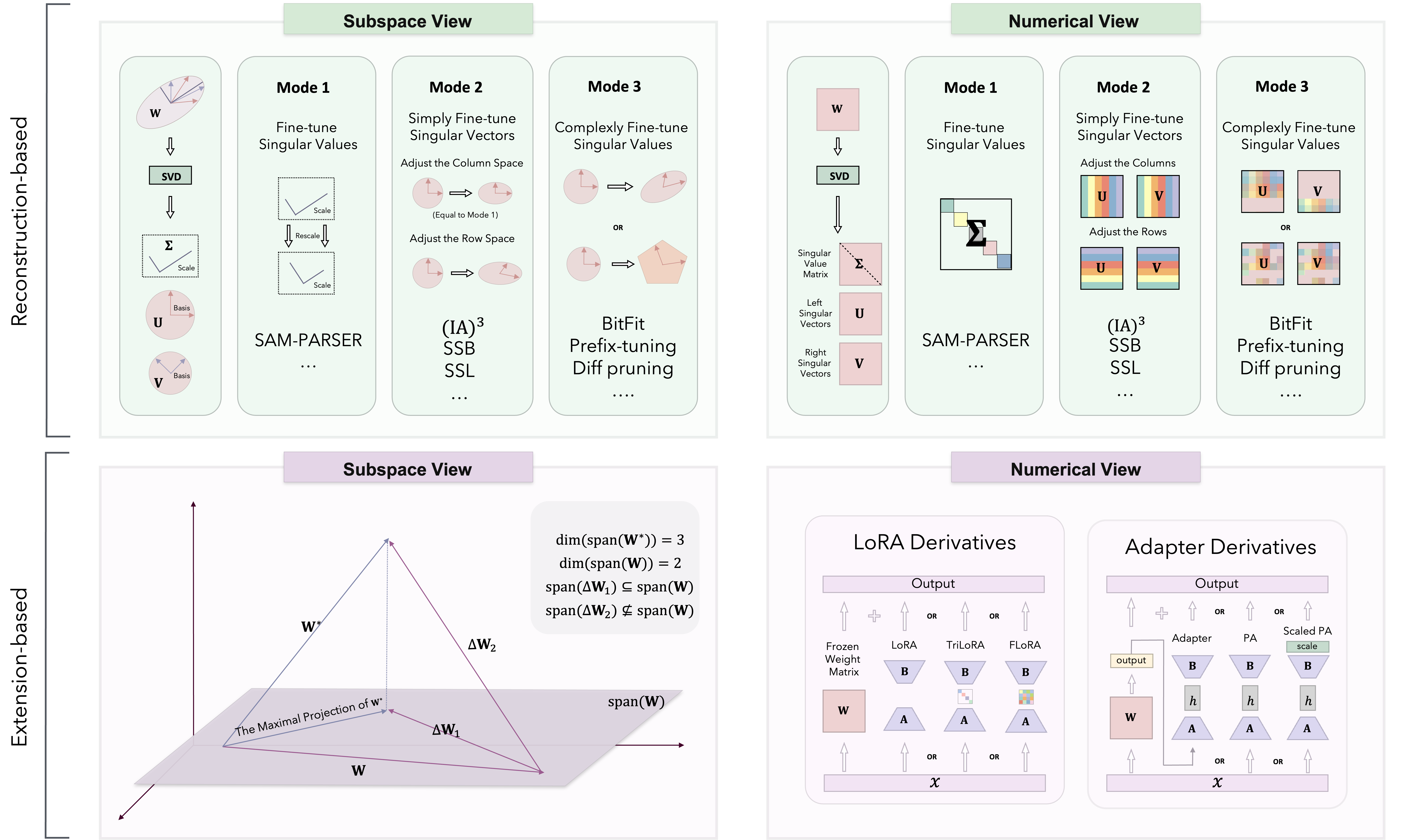

部分空間のチューニング理論に基づいて、PEFTメソッドは、再構築ベース、拡張ベース、および組み合わせベースの3つのカテゴリに分類されます。

主にロラリブ/にさまざまな方法を実装します。

| カテゴリ | アルゴリズム | コード | 紙 |

|---|---|---|---|

| 再建 | サムパーサー | コード | 2024 AAAI |

| IA3 | コード | 2022ニューリップ | |

| SSB | コード | 2024 arxiv | |

| SSL | コード | 2024 arxiv | |

| Bitfit | n/a | 2022 ACL | |

| プレフィックスチューニング | コード | 2021 ACL | |

| プロンプトチューニング | コード | 2021 EMNLP | |

| p調整 | コード | 2022 ACL | |

| ピッサ | コード | 2024 arxiv | |

| ミロラ | コード | 2024 arxiv | |

| 拡大 | ロラ | コード | 2022 ICLR |

| アダロラ | コード | 2023 ICLR | |

| フローラ | コード | 2024 arxiv | |

| モスロラ | コード | 2024 arxiv | |

| トリロラ | コード | 2024 arxiv | |

| アダプター(Houlsby) | n/a | 2019 ICML | |

| アダプター(Pfeiffer) | n/a | 2021 ACL | |

| 平行アダプター | コード | 2022 ICLR | |

| 組み合わせ | ドラ | コード | 2024 ICML |

| svdiff | コード | 2023 ICCV | |

| スペクトルアダプター | コード | 2024 arxiv | |

| ロラ・ダッシュ | コード | 2024 arxiv | |

| より多くのアルゴリズムと更新が継続的に追加されています... | n/a | n/a |

また、NLUおよびCRタスクに関するいくつかのアルゴリズムのパフォーマンスもテストしました。

このリポジトリへの貢献を歓迎します!バグを修正したり、新機能を追加したり、ドキュメントを改善したりするかどうかにかかわらず、ヘルプが高く評価されています。ガイドラインに従って、スムーズな貢献プロセスを確保してください。

PEFTコードリポジトリにご関心をお寄せいただきありがとうございます。私たちは、これをあなたのプロジェクトと研究の努力にとって貴重なリソースにするよう努めています。

私たちの目標は、あなたと私たちの研究者の両方がアイデアを交換し、協力できる共同環境を育てることです。コード関連の問題について議論するだけでなく、PEFTの方法論に関する視点を共有し、遭遇する潜在的な課題に対処することをお勧めします。新しい洞察と革新を引き起こす可能性のある議論を歓迎します。

また、このコードリポジトリは、実験中に使用するタスクとアルゴリズムを含む、より個人的な性質のものです。実装したいアルゴリズムがある場合、またはタスクシナリオを追加したい場合は、電子メールをお気軽に送信してください。詳細については、私の個人的なホームページにアクセスすることもできます。

ご質問、提案、またはフィードバックがある場合は、[email protected]までお気軽にお問い合わせください。

このリポジトリが便利だと思う場合は、スターを与えて、あなたの仕事でそれを引用することを検討してください。

@article { si2024see ,

title = { See Further for Parameter Efficient Fine-tuning by Standing on the Shoulders of Decomposition } ,

author = { Si, Chongjie and Yang, Xiaokang and Shen, Wei } ,

journal = { arXiv preprint arXiv:2407.05417 } ,

year = { 2024 }

}このリポジトリには、他のプロジェクトのコードも含まれています。これらの方法が便利だと思う場合は、星を贈り、あなたの仕事でそれらを引用することを検討してください。

@article { si2024flora ,

title = { FLoRA: Low-Rank Core Space for N-dimension } ,

author = { Si, Chongjie* and Wang, Xuehui* and Yang, Xue and Xu, Zhengqin and Li, Qingyun and Dai, Jifeng and Qiao, Yu and Yang, Xiaokang and Shen, Wei } ,

journal = { arXiv preprint arXiv:2405.14739 } ,

year = { 2024 }

} @article { si2024unleashing ,

title = { Unleashing the Power of Task-Specific Directions in Parameter Efficient Fine-tuning } ,

author = { Si, Chongjie* and Shi, Zhiyi* and Zhang, Shifan and Yang, Xiaokang and Pfister, Hanspeter and Shen, Wei } ,

journal = { arXiv preprint arXiv:2409.01035 } ,

year = { 2024 }

}このリポジトリは、Apache 2.0ライセンスの下でライセンスされています。詳細については、ライセンスファイルを参照してください。