Bienvenue dans notre référentiel, qui contient une collection diversifiée de méthodes de réglage sous-espace pour le réglage fin et économe en paramètres (PEFT). Le réglage du sous-espace est essentiel pour adapter les grands modèles pré-formés à des tâches spécifiques avec un minimum de modifications des paramètres d'origine. Il s'efforce d'identifier la projection maximale du poids optimal

Nous visons à fournir une ressource complète aux chercheurs et aux praticiens dans ce domaine, et à faciliter une intégration facile à vos projets. Que vous soyez ici pour trouver des ressources pour vos projets ou pour contribuer, nous espérons que ce référentiel sera une partie précieuse et inspirante de votre parcours de recherche.

Ce référentiel contient également certains des autres projets sur lesquels nous avons travaillé, ce qui pourrait vous avoir conduit ici.

Pour utiliser les algorithmes dans ce référentiel, clonez le référentiel et installez les dépendances nécessaires.

Cloner ce référentiel:

git clone https://github.com/Chongjie-Si/Subspace-Tuning.git

cd Subspace-TuningSuivez les instructions dans chaque dossier.

Nous soutenons plusieurs tâches, notamment:

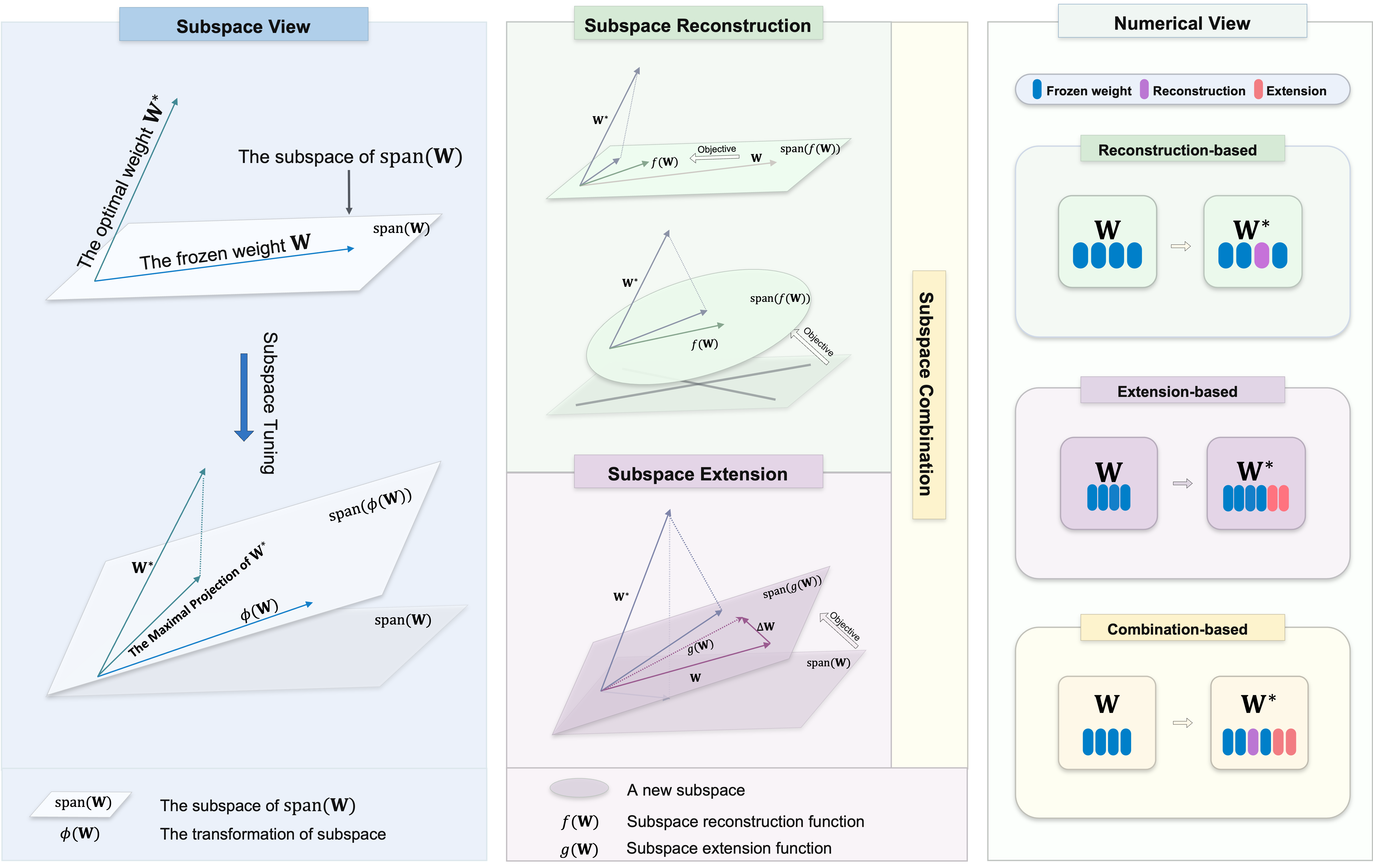

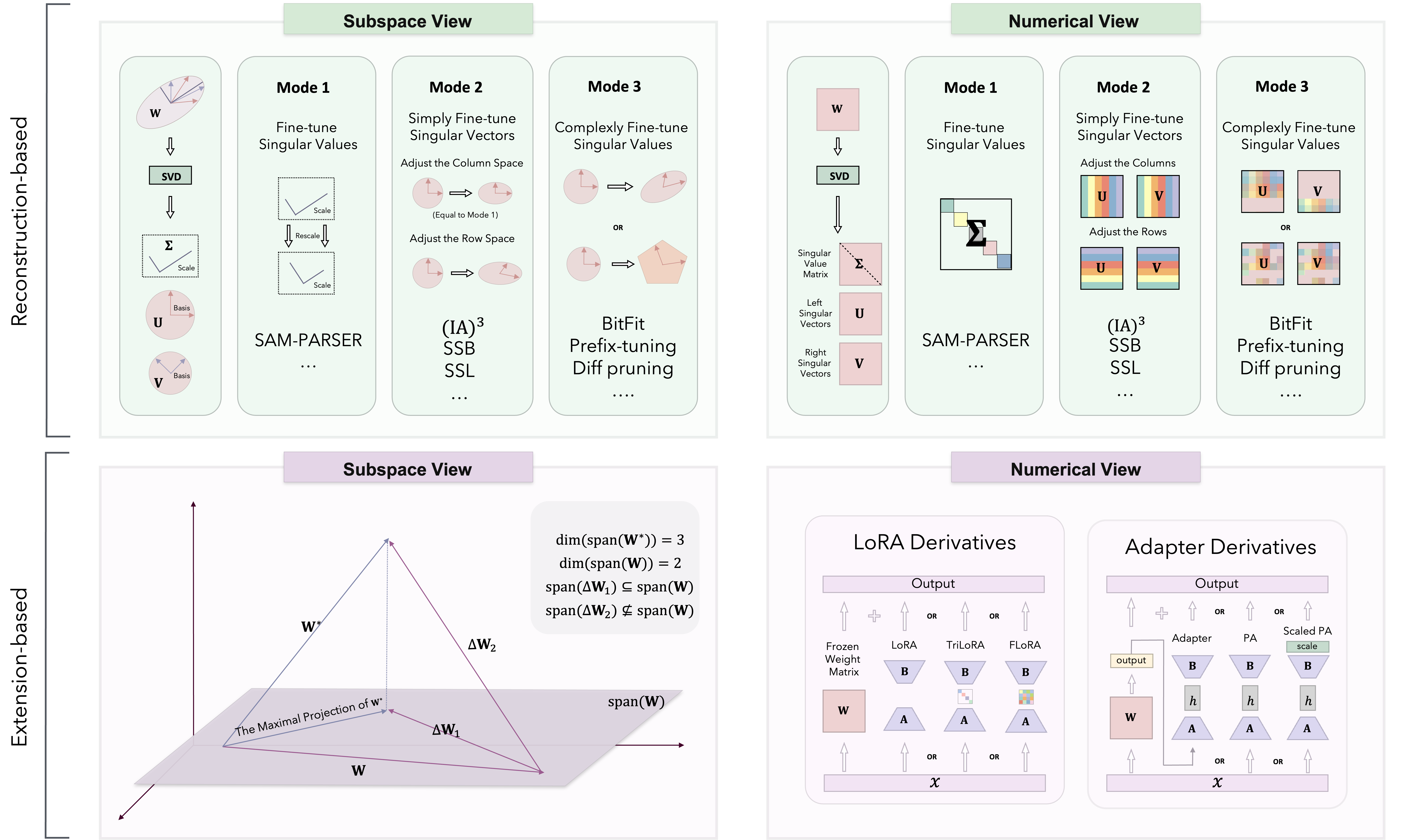

Sur la base de la théorie du réglage du sous-espace, les méthodes PEFT sont classées en trois catégories: basée sur la reconstruction, basée sur une extension et basée sur la combinaison.

Nous mettons en œuvre différentes méthodes principalement dans Loralib /.

| Catégorie | Algorithme | Code | Papier |

|---|---|---|---|

| Reconstruction | Sam-Parser | Code | 2024 AAAI |

| IA3 | Code | 2022 NIRIPS | |

| SSB | Code | 2024 Arxiv | |

| SSL | Code | 2024 Arxiv | |

| Bitfit | N / A | 2022 ACL | |

| Préfixe-réglage | Code | 2021 ACL | |

| Réglage rapide | Code | 2021 EMNLP | |

| Pinage P | Code | 2022 ACL | |

| Pisse | Code | 2024 Arxiv | |

| Milora | Code | 2024 Arxiv | |

| Extension | Lora | Code | 2022 ICLR |

| Adalora | Code | 2023 ICLR | |

| Flore | Code | 2024 Arxiv | |

| Moslora | Code | 2024 Arxiv | |

| Trilora | Code | 2024 Arxiv | |

| Adaptateur (Houlsby) | N / A | ICML 2019 | |

| Adaptateur (pfeiffer) | N / A | 2021 ACL | |

| Adaptateur parallèle | Code | 2022 ICLR | |

| Combinaison | Dora | Code | 2024 ICML |

| Svdiff | Code | 2023 ICCV | |

| Adaptateur spectral | Code | 2024 Arxiv | |

| Lora | Code | 2024 Arxiv | |

| Plus d'algorithmes et de mises à jour sont continuellement ajoutés ... | N / A | N / A |

Nous avons également testé les performances de certains algorithmes sur les tâches NLU et CR.

Nous accueillons des contributions à ce référentiel! Que vous fixiez des bogues, de l'ajout de nouvelles fonctionnalités ou de l'amélioration de la documentation, votre aide est appréciée. Veuillez suivre les directives pour assurer un processus de contribution en douceur.

Merci de votre intérêt pour notre référentiel de code PEFT. Nous nous efforçons d'en faire une ressource précieuse pour vos projets et vos efforts de recherche.

Notre objectif est de favoriser un environnement collaboratif où vous et nos chercheurs pouvez échanger des idées et coopérer. Au-delà de discuter des problèmes liés au code, nous vous encourageons à partager vos perspectives sur toute méthodologie PEFT et à relever les défis potentiels que vous rencontrez. Nous accueillons des discussions qui peuvent déclencher de nouvelles idées et innovations.

En outre, ce référentiel de code est de nature plus privée, contenant des tâches et des algorithmes que j'utilise pendant mes expériences. Si vous avez des algorithmes que vous souhaitez implémenter ou souhaitez ajouter plus de scénarios de tâche, n'hésitez pas à m'envoyer un e-mail. Vous pouvez également visiter ma page d'accueil personnelle pour plus de détails.

Si vous avez des questions, des suggestions ou des commentaires, n'hésitez pas à nous contacter à [email protected].

Si vous trouvez ce référentiel utile, veuillez envisager de lui donner une étoile et de le citant dans votre travail:

@article { si2024see ,

title = { See Further for Parameter Efficient Fine-tuning by Standing on the Shoulders of Decomposition } ,

author = { Si, Chongjie and Yang, Xiaokang and Shen, Wei } ,

journal = { arXiv preprint arXiv:2407.05417 } ,

year = { 2024 }

}Ce référentiel contient également le code de nos autres projets. Si vous trouvez ces méthodes utiles, envisagez de donner une étoile et de les citant dans votre travail.

@article { si2024flora ,

title = { FLoRA: Low-Rank Core Space for N-dimension } ,

author = { Si, Chongjie* and Wang, Xuehui* and Yang, Xue and Xu, Zhengqin and Li, Qingyun and Dai, Jifeng and Qiao, Yu and Yang, Xiaokang and Shen, Wei } ,

journal = { arXiv preprint arXiv:2405.14739 } ,

year = { 2024 }

} @article { si2024unleashing ,

title = { Unleashing the Power of Task-Specific Directions in Parameter Efficient Fine-tuning } ,

author = { Si, Chongjie* and Shi, Zhiyi* and Zhang, Shifan and Yang, Xiaokang and Pfister, Hanspeter and Shen, Wei } ,

journal = { arXiv preprint arXiv:2409.01035 } ,

year = { 2024 }

}Ce référentiel est sous licence sous la licence Apache 2.0. Voir le fichier de licence pour plus de détails.