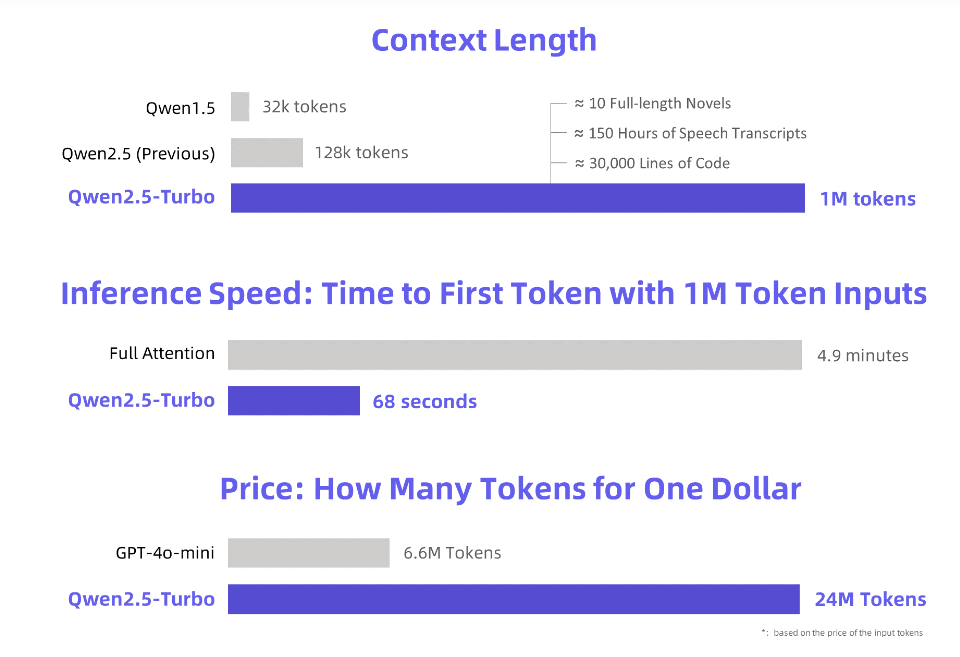

Editor Downcodes mengetahui bahwa Alibaba Cloud telah merilis model bahasa besar Qwen2.5-Turbo yang baru ditingkatkan, dan panjang konteksnya telah mencapai 1 juta Token yang mencengangkan! Apa artinya ini? Artinya, ia dapat memproses sejumlah informasi yang setara dengan 10 novel "Tiga Tubuh", 150 jam suara, atau 30.000 baris kode! Kekuatan pemrosesan yang begitu kuat akan merevolusi cara kita berinteraksi dengan model bahasa besar.

Alibaba Cloud meluncurkan model bahasa besar Qwen2.5-Turbo yang baru ditingkatkan, yang panjang konteksnya melebihi 1 juta Token. Apa yang setara dengan konsep ini? Setara dengan 10 novel "Tiga Tubuh", 150 jam transkripsi suara atau kapasitas 30.000 baris kode! Kali ini, "membaca sepuluh novel dalam satu tarikan napas" bukan lagi mimpi!

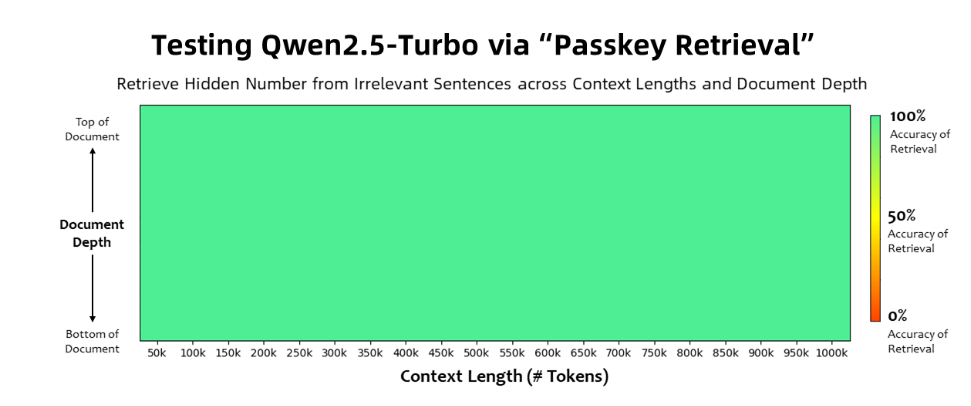

Model Qwen2.5-Turbo mencapai akurasi 100% dalam tugas Pengambilan Kunci Sandi, dan melampaui model serupa seperti GPT-4 dalam hal kemampuan pemahaman teks yang panjang. Model ini memperoleh skor tinggi sebesar 93,1 pada tolok ukur teks panjang RULER, sementara GPT-4 hanya memperoleh skor 91,6 dan GLM4-9B-1M memperoleh skor 89,9.

Selain kemampuan pemrosesan teks ultra panjang, Qwen2.5-Turbo juga memiliki akurasi pemrosesan teks pendek. Dalam pengujian benchmark teks pendek, performanya sebanding dengan GPT-4o-mini dan Qwen2.5-14B-Instruct. model.

Dengan mengadopsi mekanisme perhatian yang jarang, model Qwen2.5-Turbo mempersingkat waktu pemrosesan token pertama 1 juta Token dari 4,9 menit menjadi 68 detik, sehingga mencapai peningkatan kecepatan inferensi sebesar 4,3 kali lipat.

Pada saat yang sama, biaya pemrosesan 1 juta Token hanya 0,3 yuan. Dibandingkan dengan GPT-4o-mini, ia dapat memproses konten 3,6 kali lipat dengan biaya yang sama.

Alibaba Cloud telah menyiapkan serangkaian demonstrasi untuk model Qwen2.5-Turbo, yang menunjukkan penerapannya dalam pemahaman mendalam terhadap novel, bantuan kode, dan membaca berbagai makalah. Misalnya, setelah pengguna mengunggah trilogi novel Tiongkok "The Three-Body Problem" yang berisi 690.000 token, model tersebut berhasil merangkum plot setiap novel dalam bahasa Inggris.

Pengguna dapat merasakan fungsi canggih model Qwen2.5-Turbo melalui layanan API Alibaba Cloud Model Studio, HuggingFace Demo, atau ModelScope Demo.

Alibaba Cloud menyatakan bahwa di masa depan, mereka akan terus mengoptimalkan model tersebut untuk meningkatkan penyelarasan preferensi manusia dalam tugas-tugas yang berurutan, lebih mengoptimalkan efisiensi inferensi, mengurangi waktu komputasi, dan mencoba meluncurkan model konteks panjang yang lebih besar dan kuat.

Pengenalan resmi: https://qwenlm.github.io/blog/qwen2.5-turbo/

Demo daring: https://huggingface.co/spaces/Qwen/Qwen2.5-Turbo-1M-Demo

Dokumentasi API: https://help.aliyun.com/zh/model-studio/getting-started/first-api-call-to-qwen

Kemunculan Qwen2.5-Turbo menandai terobosan besar dalam kemampuan pemrosesan teks panjang pada model bahasa besar. Efisiensi tinggi dan biaya rendah akan membawa potensi penerapan yang besar untuk semua lapisan masyarakat. Mari kita tunggu dan lihat bagaimana model hebat ini akan mengubah dunia kita di masa depan!