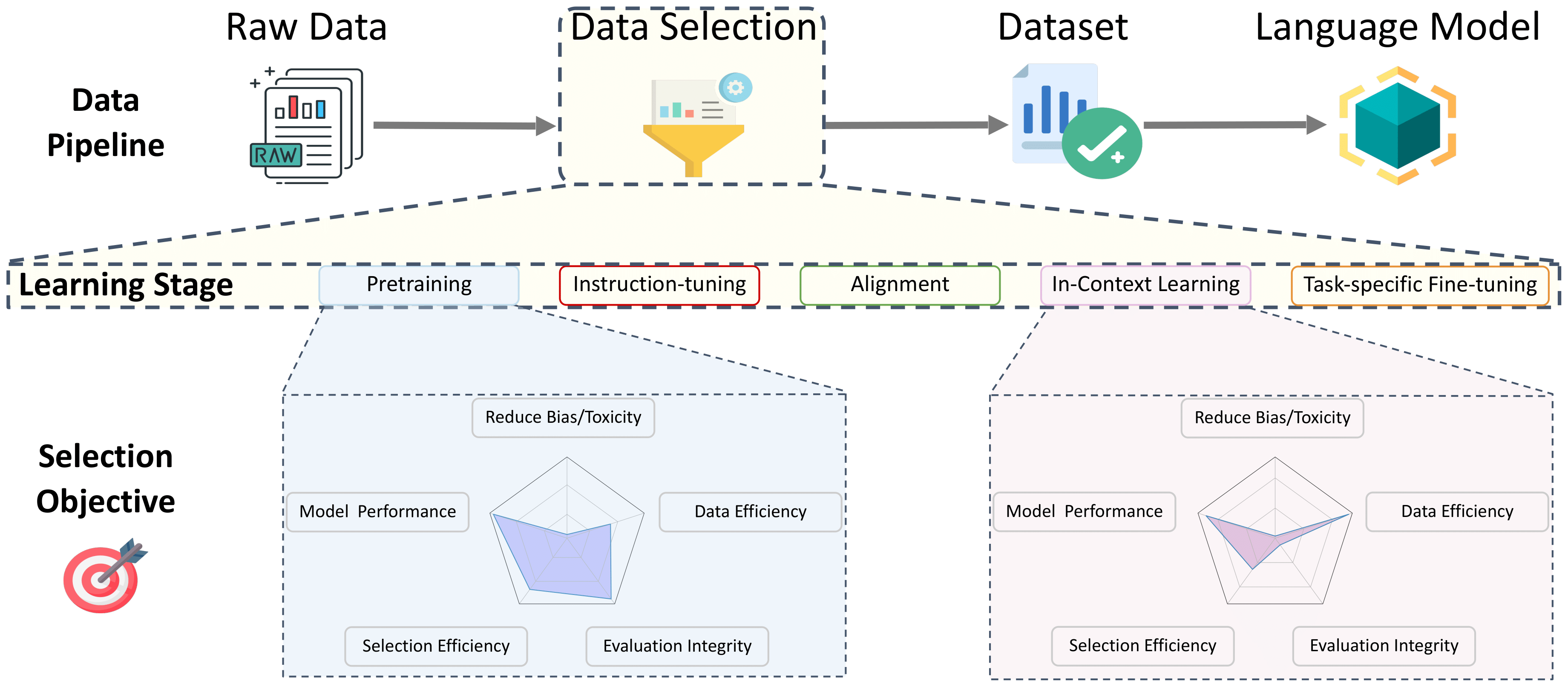

Survei Pilihan Data untuk Model Bahasa

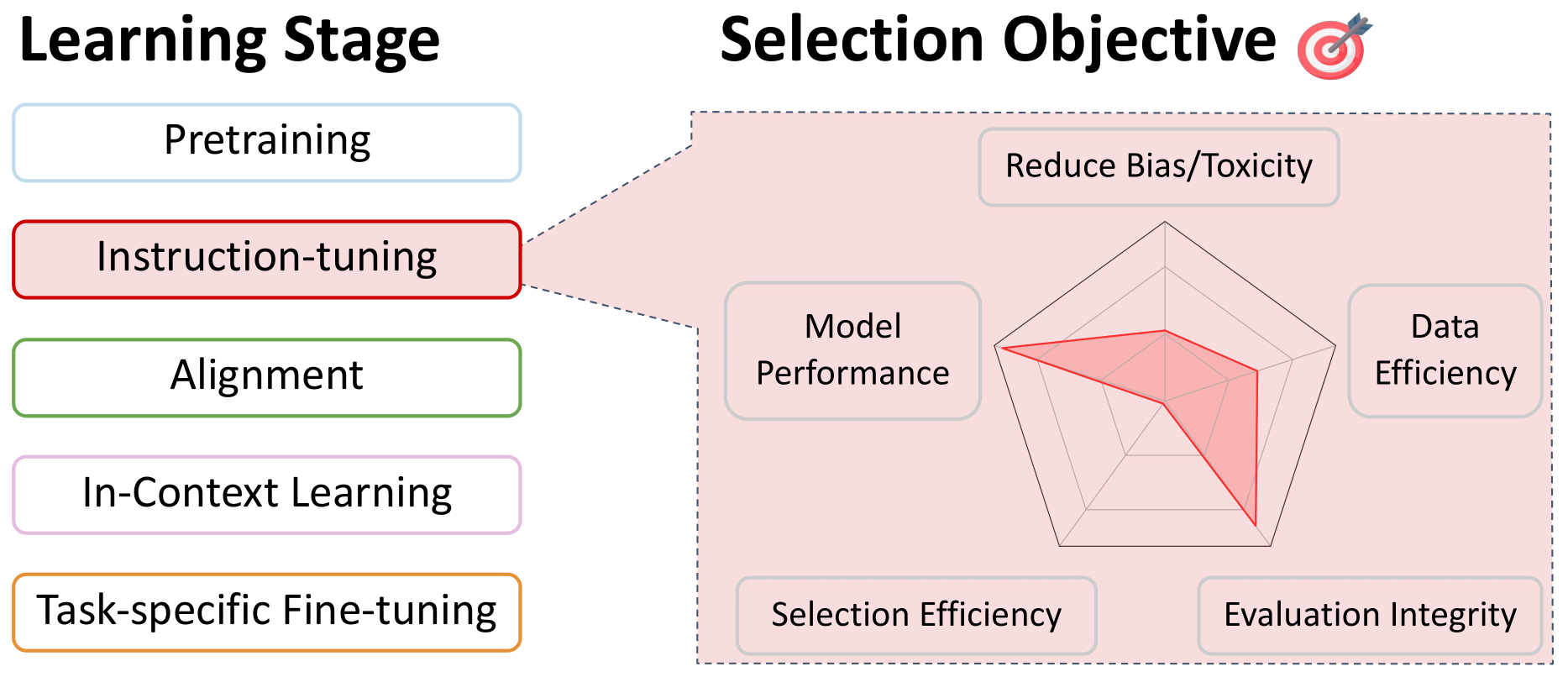

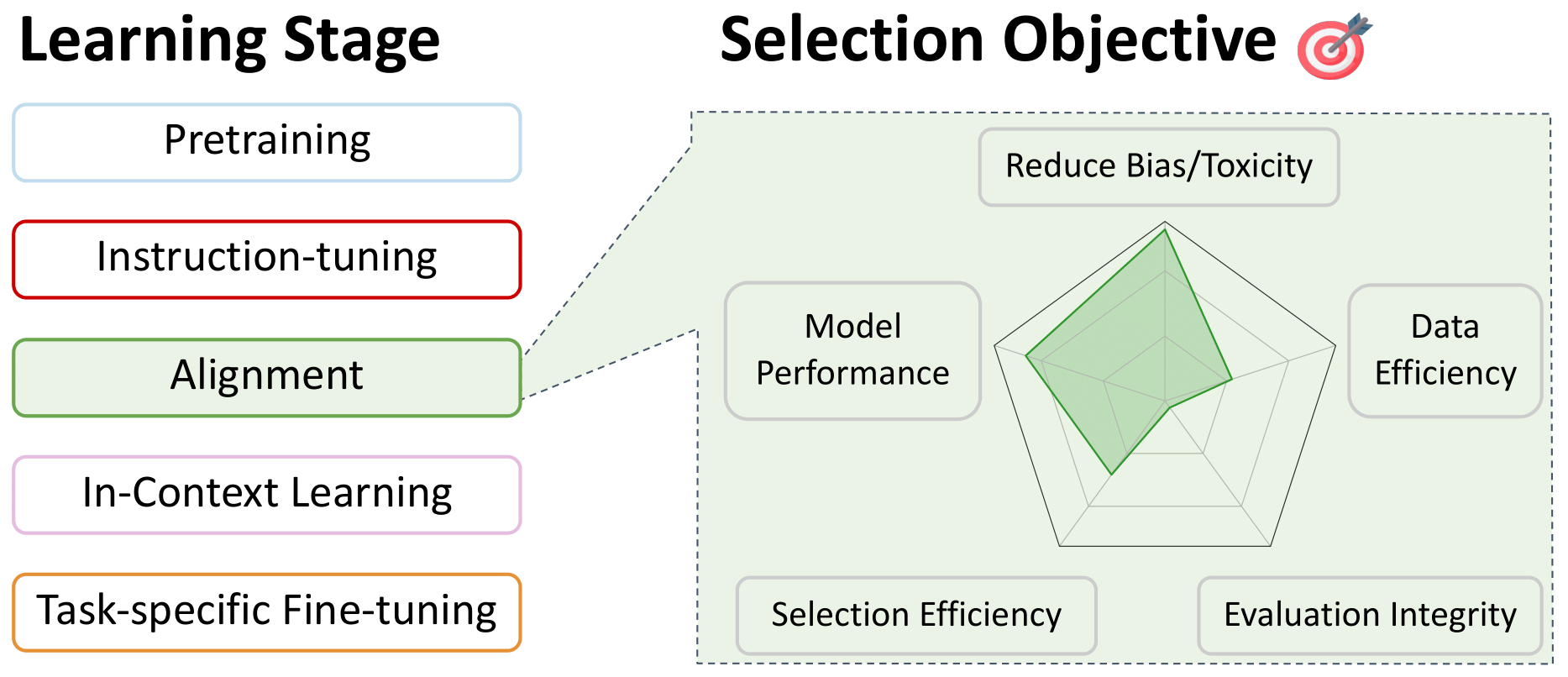

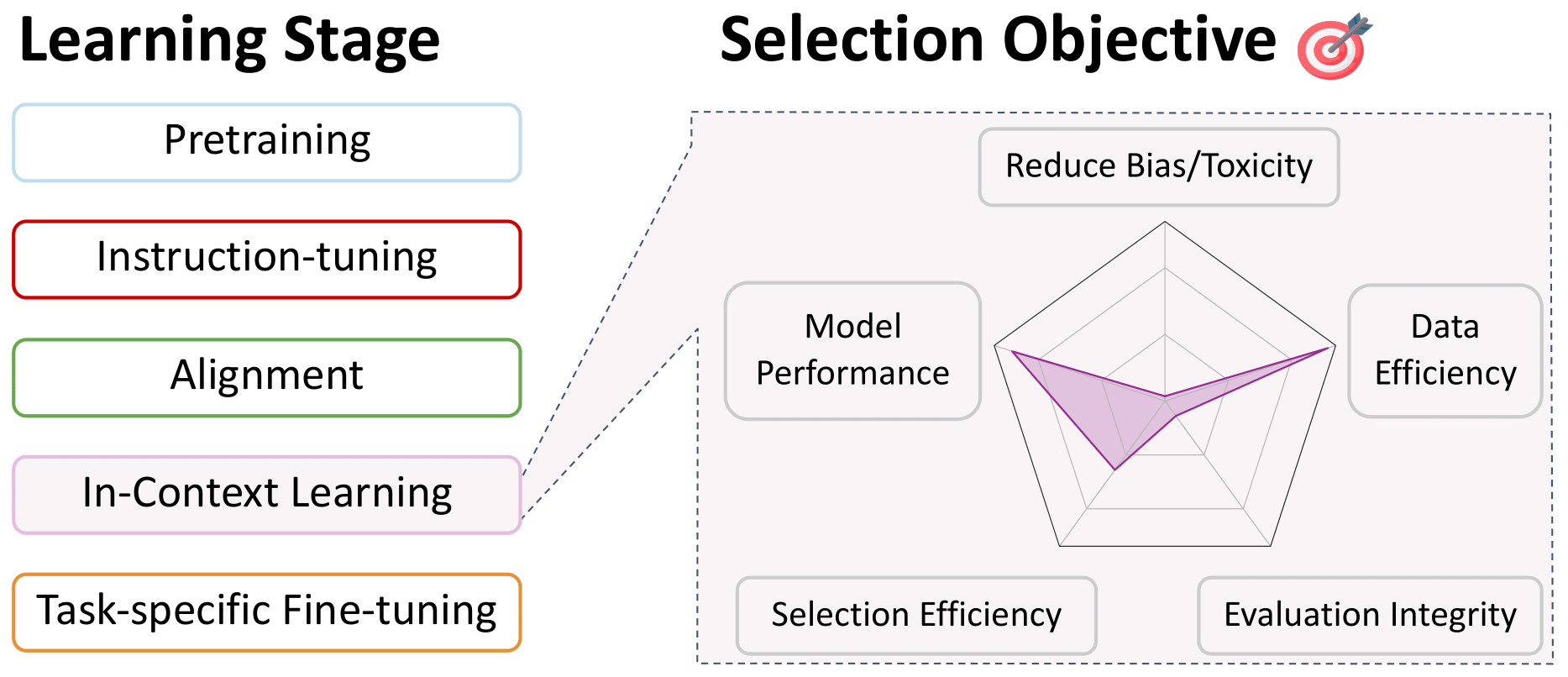

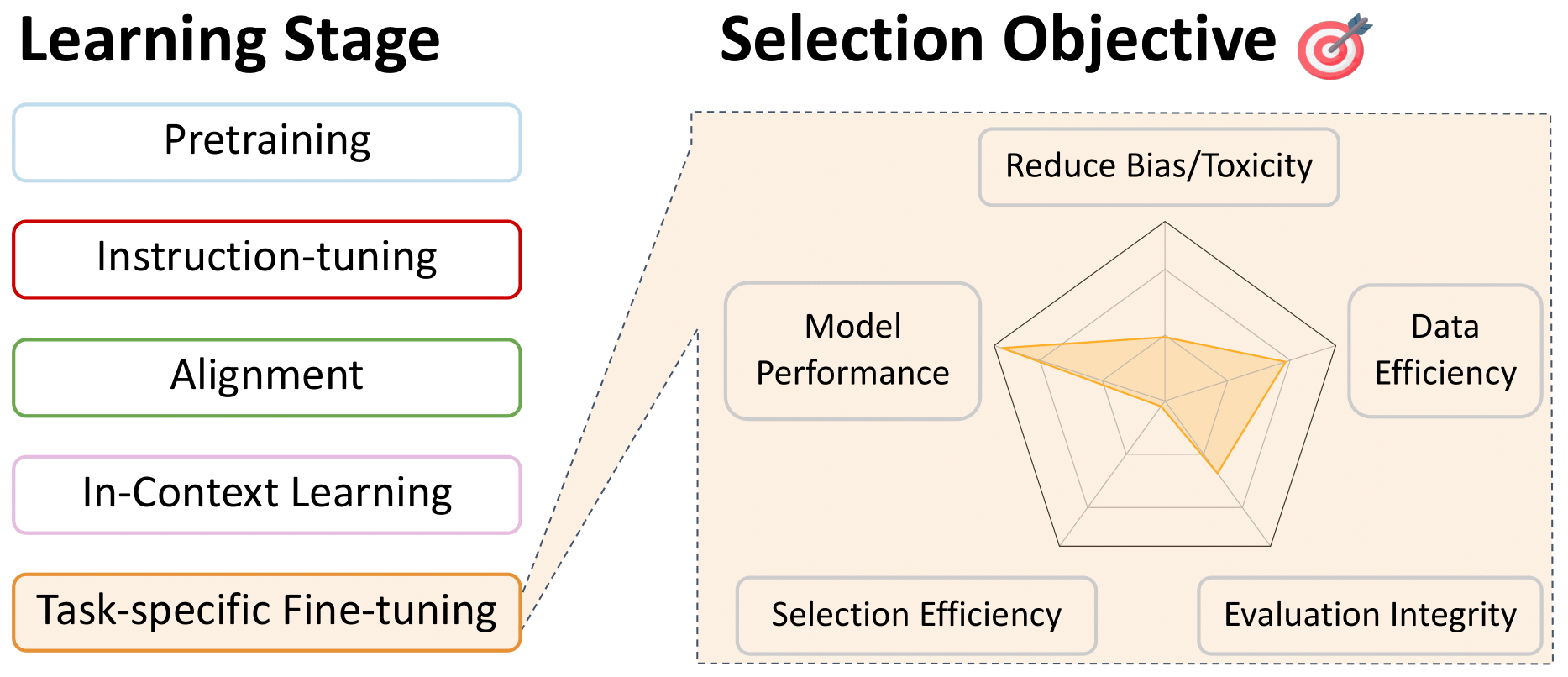

Repo ini adalah daftar makalah yang nyaman yang relevan dengan pemilihan data untuk model bahasa, selama semua tahap pelatihan. Ini dimaksudkan untuk menjadi sumber daya bagi masyarakat, jadi silakan berkontribusi jika Anda melihat sesuatu yang hilang!

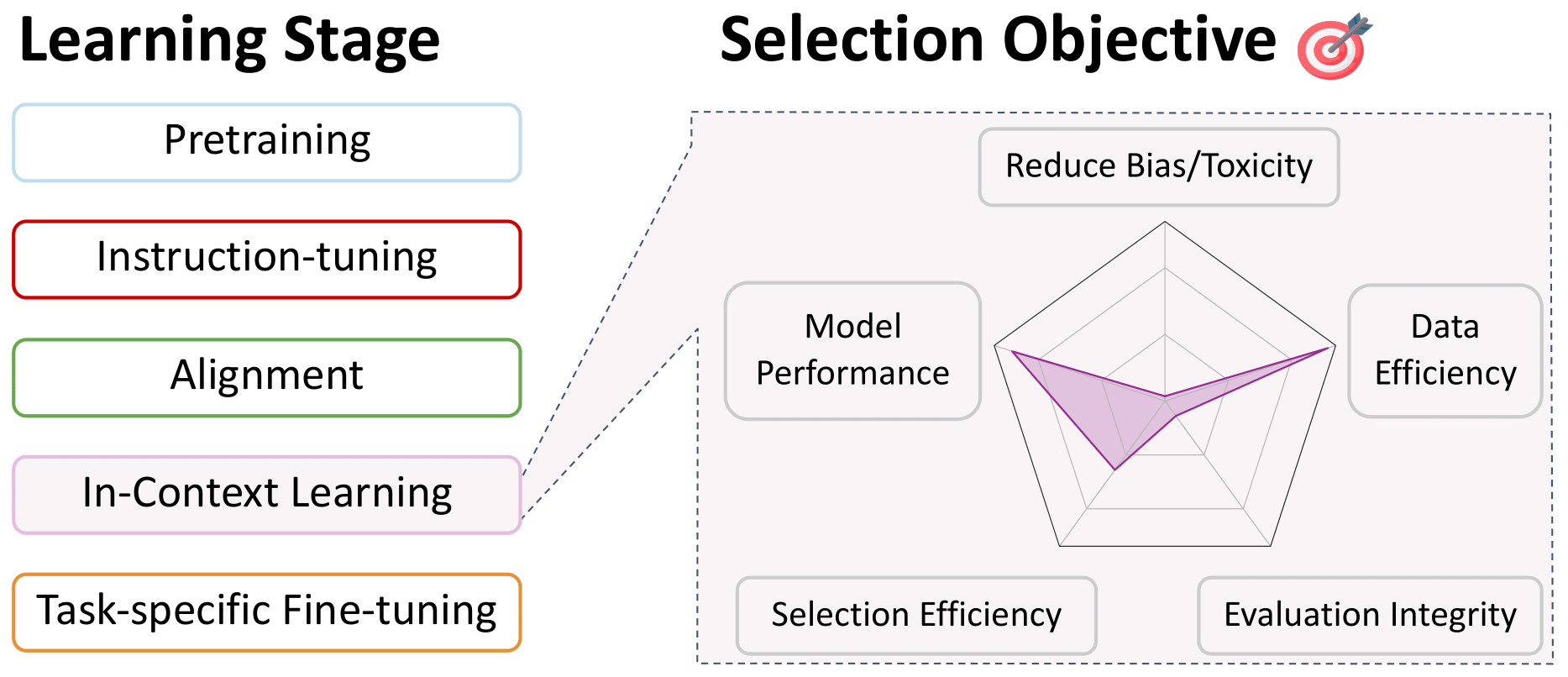

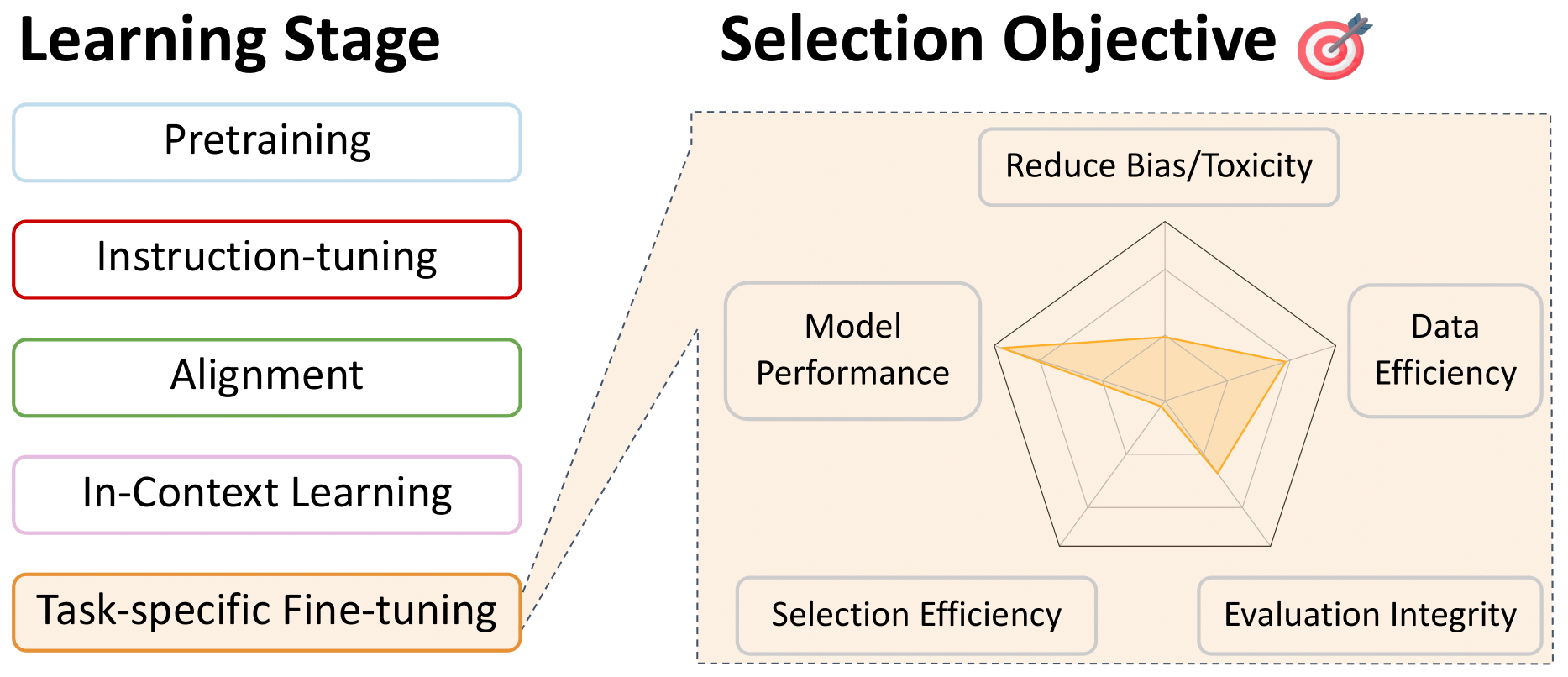

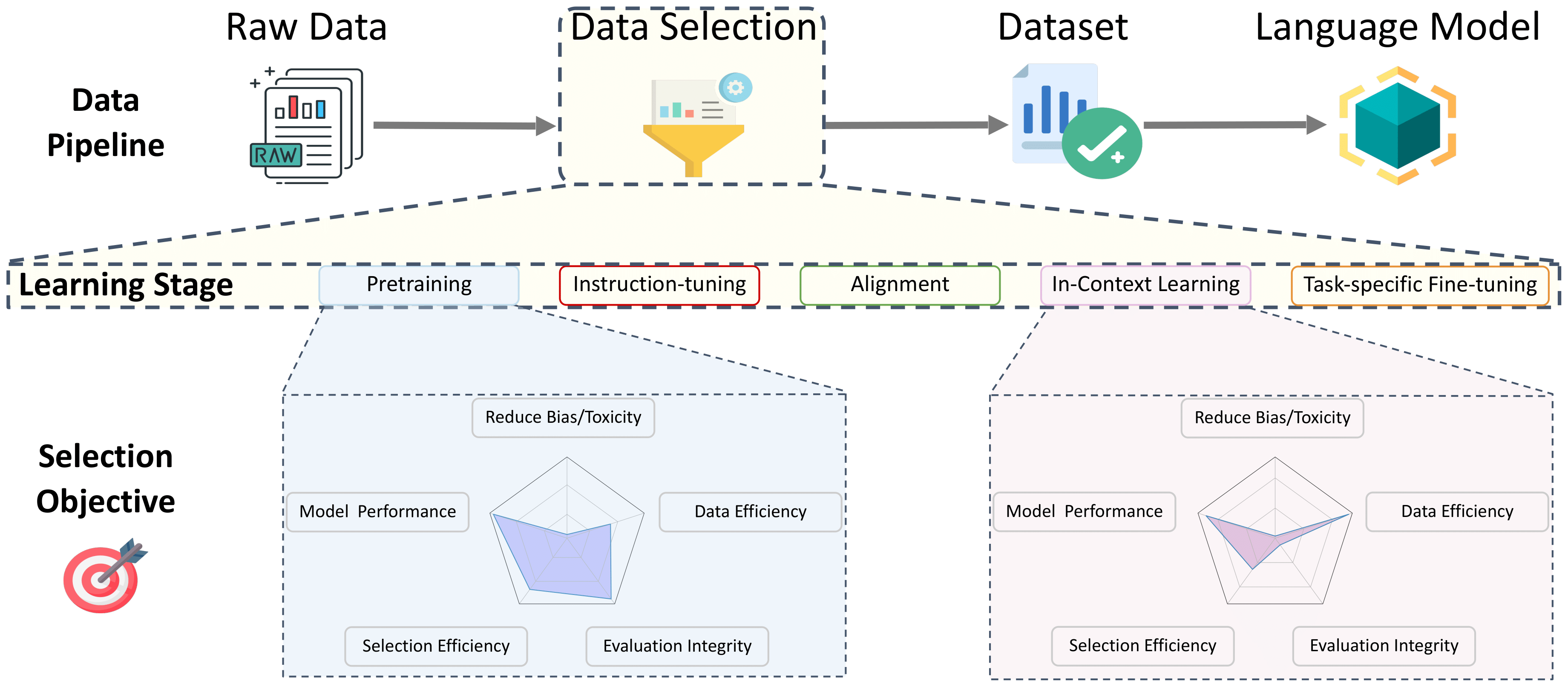

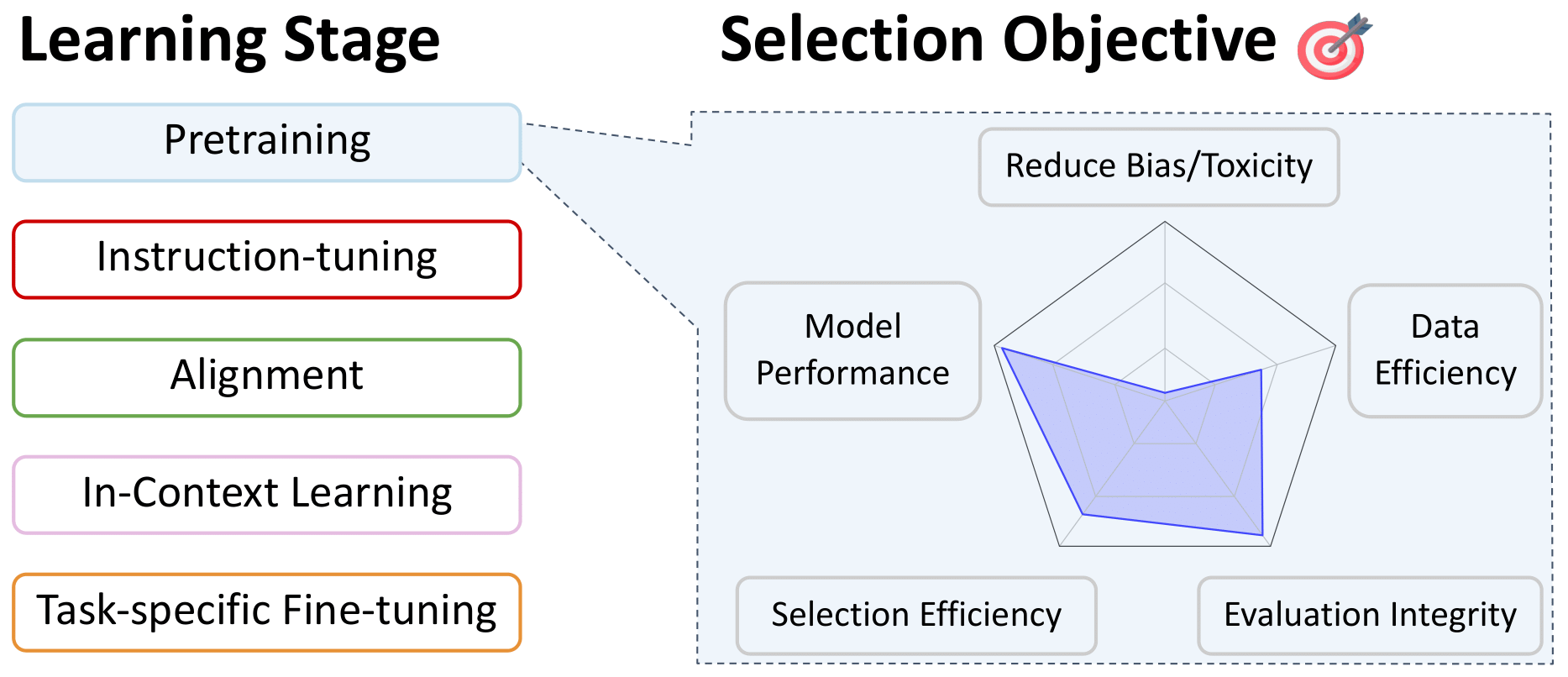

Untuk detail lebih lanjut tentang karya -karya ini, dan banyak lagi, lihat makalah survei kami: survei tentang pemilihan data untuk model bahasa. Oleh tim yang luar biasa ini: Alon Albalak, Yanai Elazar, Sang Michael Xie, Shayne Longpre, Nathan Lambert, Xinyi Wang, Niklas Muennighoff, Bairu Hou, Pan Liangming, Haewon Jeong, Rafel Colin, Shiyu Chang, Tatsunori Hashimoto Hashimot, Colin Yang Wank, Shiyu, Tatsunori Hashimoto Hashimot, Colin Lahan, Shiyu, Tatsunori Hashimoto Hashimot, Colin Lahan, Tatsunu Hashimot, Tatsunu Hashimot, Tatsunu Hashimoto,

Daftar isi

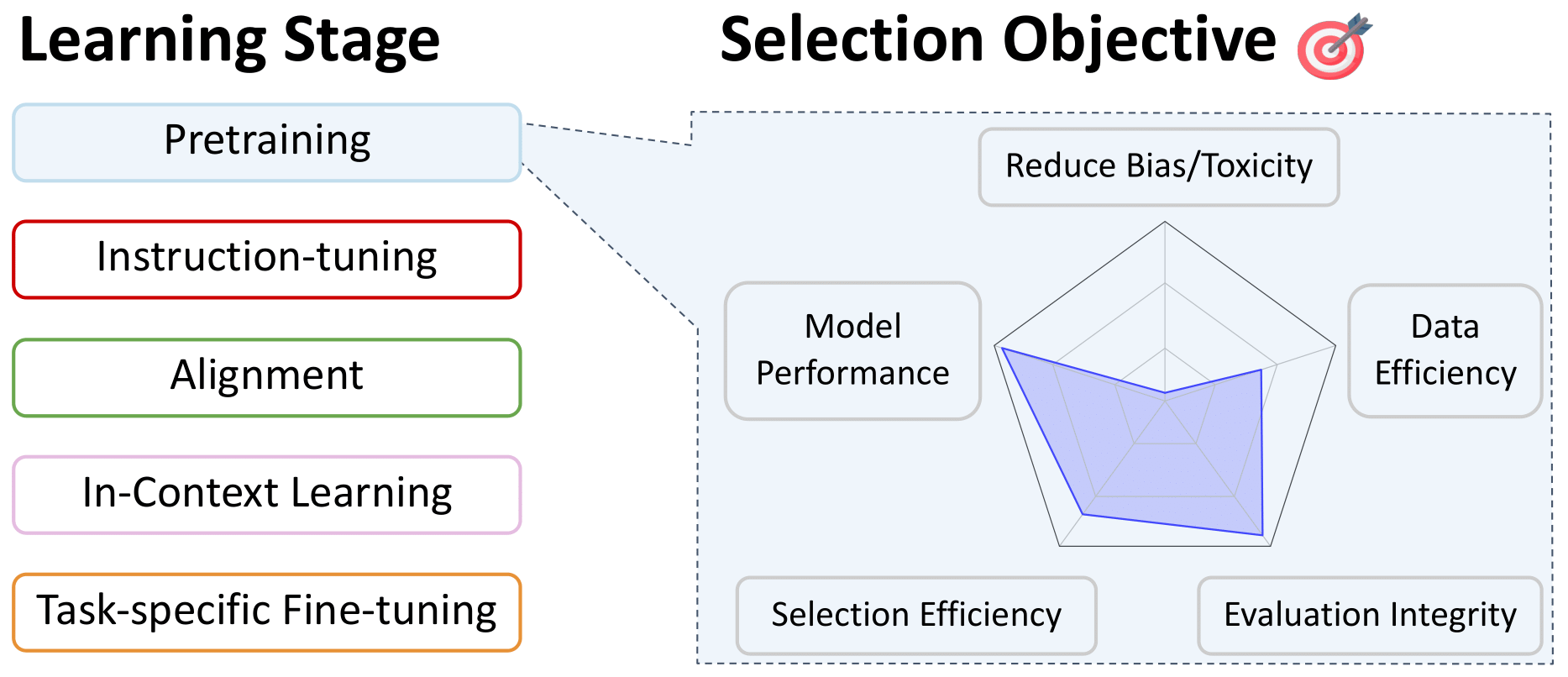

- Pemilihan data untuk pretraining

- Penyaringan bahasa

- Pendekatan heuristik

- Kualitas Data

- Seleksi khusus domain

- Deduplikasi data

- Memfilter konten beracun dan eksplisit

- Seleksi khusus untuk model multibahasa

- Pencampuran data

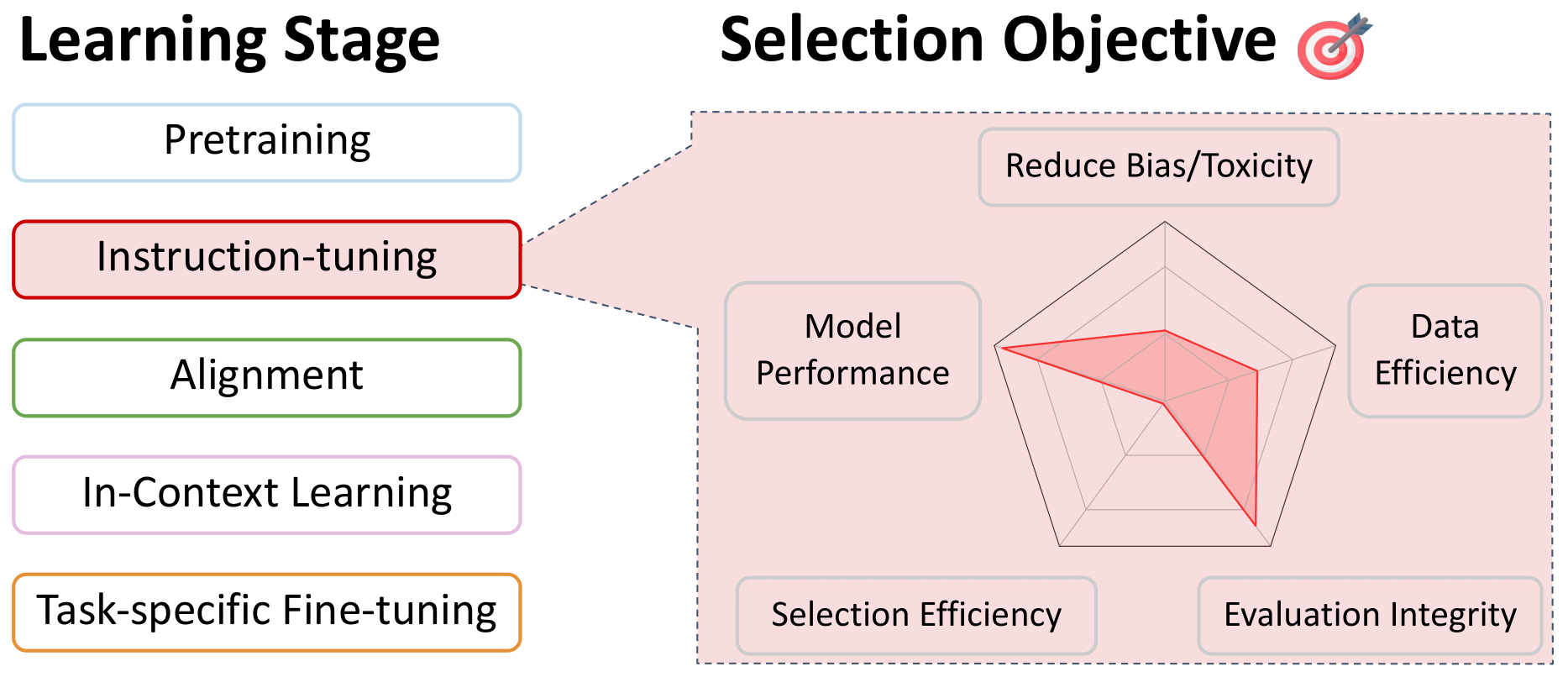

- Pemilihan data untuk pelatihan penyetelan instruksi dan multitask

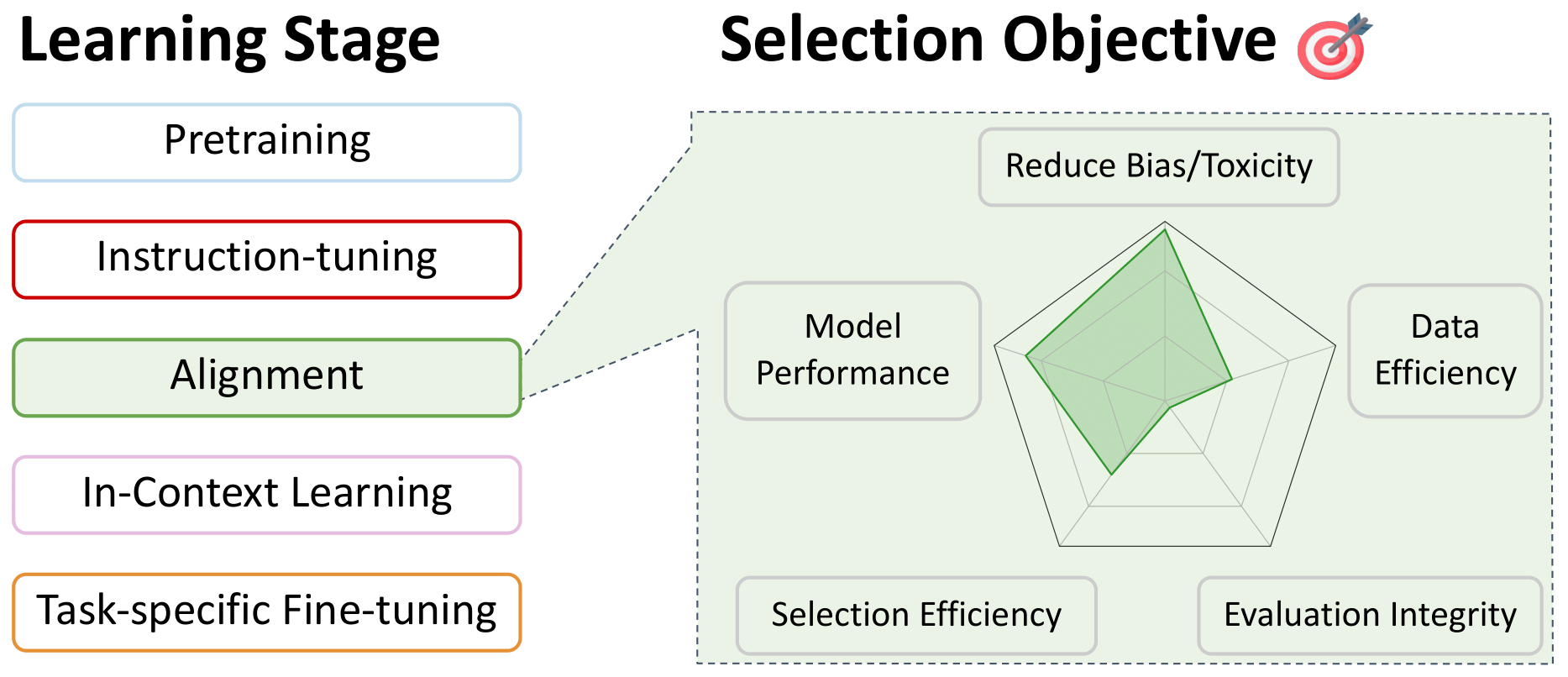

- Pemilihan data untuk penyelarasan penyempurnaan preferensi

- Pemilihan data untuk pembelajaran dalam konteks

- Pemilihan data untuk fine-tuning khusus tugas

Pemilihan data untuk pretraining

Penyaringan bahasa

Kembali ke Daftar Isi

- FastText.zip: Model Klasifikasi Teks Mengompres: 2016

Armand Joulin dan Edouard Grave dan Piotr Bojanowski dan Matthijs Douze dan Hérve Jégou dan Tomas Mikolov

- Belajar kata vektor untuk 157 bahasa: 2018

Grave, Edouard dan Bojanowski, Piotr dan Gupta, Prakhar dan Joulin, Armand dan Mikolov, Tomas

- Model bahasa lintas-bahasa pretraining: 2019

Conneau, Alexis and Lample, Guillaume

- Menjelajahi Batas Pembelajaran Transfer dengan Transformator Teks ke Teks Terpadu: 2020

Raffel, Colin dan Shazeer, Noam dan Roberts, Adam ... 3 Tersembunyi ... Zhou, Yanqi dan Li, Wei dan Liu, Peter J.

- ID Bahasa di alam liar: Tantangan tak terduga di jalan menuju seribu teks web Corpus: 2020

Caswell, Isaac dan Breiner, Theresa dan Van Esch, Daan dan Bapna, Ankur

- Pembelajaran representasi lintas-bahasa tanpa pengawasan pada skala: 2020

Conneau, Alexis dan Khandelwal, Kartikay dan Goyal, Naman ... 4 Tersembunyi ... Ott, Myle dan Zettlemoyer, Luke dan Stoyanov, Veselin

- CCNET: Mengekstraksi Dataset Monolingual Berkualitas Tinggi dari Web Crawl Data: 2020

Wenzek, Guillaume dan Lachaux, Marie-Anne dan Conneau, Alexis ... 1 Tersembunyi ... Guzm'an, Francisco dan Joulin, Armand dan Grave, Edouard

- Reproduksi model LSTM bi-directional Apple untuk identifikasi bahasa dalam string pendek: 2021

Toftrup, Mads dan Asger Sorensen, Soren dan Ciosici, Manuel R. dan Assent, IRA

- Mengevaluasi model bahasa besar yang dilatih pada kode: 2021

Mark Chen dan Jerry Tworek dan Heewoo Jun ... 52 Tersembunyi ... Sam McCandlish dan Ilya Sutskever dan Wojciech Zaremba

- MT5: Transformator Teks-ke-Teks Pra-Latih Multilingual: 2021

Xue, berjarak dan konstan, Nuh dan Roberts, Adam ... 2 Tersembunyi ... Siddhant, Aditya dan Barua, Aditya dan Rafel, Colin

- Pembuatan kode tingkat kompetisi dengan alphacode: 2022

Li, Yujia dan Choi, David dan Chung, Junyoung ... 20 Tersembunyi ... De Freitas, Nando dan Kavukcuoglu, Koray dan Vinyal, Oriol

- Palm: Pemodelan Bahasa Penskalaan dengan Jalur: 2022

Aakanksha Chowdhery dan Sharan Narang dan Jacob Devlin ... 61 Tersembunyi ... Jeff Dean dan Slave Petrov dan Noah Fiedel

- The BigScience Roots Corpus: Dataset Multilingual Komposit 1.6TB: 2022

Laurenccon, Hugo dan Saulnier, Lucile dan Wang, Thomas ... 48 Tersembunyi ... Mitchell, Margaret dan Luccioni, Sasha Alexandra dan Jernite, Yacine

- Sistem Penulisan dan Metadata Pembicara untuk 2.800+ Varietas Bahasa: 2022

Van Esch, Daan dan Lucassen, Tamar dan Ruder, Sebastian dan Caswell, Isaac dan Rivera, Clara

- Fingpt: Model generatif besar untuk bahasa kecil: 2023

Luukkonen, Risto dan Komulainen, Ville dan Luoma, Jouni ... 5 Tersembunyi ... Muennighoff, Niklas dan Piktus, Aleksandra dan lainnya

- MC^ 2: Korpus multibahasa bahasa minoritas di Cina: 2023

Zhang, Chen dan Tao, Mingxu dan Huang, Quzhe dan Lin, Jiuheng dan Chen, Zhibin dan Feng, Yansong

- Madlad-400: Dataset Besar Multilingual dan Level Dokumen: 2023

Kudugunta, Sneha dan Caswell, Isaac dan Zhang, Biao ... 5 Tersembunyi ... Stella, Romi dan Bapna, Ankur dan lainnya

- Dataset RefinedWeb untuk Falcon LLM: Mengungguli Korpor Kurator dengan Data Web, dan Data Web saja: 2023

Guilherme Penedo dan Quentin Malartic dan Daniel Hesslow ... 3 Tersembunyi ... Baptiste Pannier dan Ebtesam Almazrouei dan Julien Launay

- Dolma: Sebuah korpus terbuka dengan tiga triliun token untuk Model Bahasa Pretraining Research: 2024

Luca Soldaini dan Rodney Kinney dan Akshita Bhagia ... 30 Tersembunyi ... Dirk Groeneveld dan Jesse Dodge dan Kyle Lo

Pendekatan heuristik

Kembali ke Daftar Isi

- Menjelajahi Batas Pembelajaran Transfer dengan Transformator Teks ke Teks Terpadu: 2020

Raffel, Colin dan Shazeer, Noam dan Roberts, Adam ... 3 Tersembunyi ... Zhou, Yanqi dan Li, Wei dan Liu, Peter J.

- Model bahasa adalah beberapa pelajar: 2020

Brown, Tom dan Mann, Benjamin dan Ryder, Nick ... 25 Tersembunyi ... Radford, Alec dan Sutskever, Ilya dan Amodei, Dario

- Tumpukan: Dataset 800GB dari beragam teks untuk Pemodelan Bahasa: 2020

Leo Gao dan Stella Biderman dan Sid Black ... 6 Tersembunyi ... Noa Nabeshima dan Shawn Presser dan Connor Leahy

- Mengevaluasi model bahasa besar yang dilatih pada kode: 2021

Mark Chen dan Jerry Tworek dan Heewoo Jun ... 52 Tersembunyi ... Sam McCandlish dan Ilya Sutskever dan Wojciech Zaremba

- MT5: Transformator Teks-ke-Teks Pra-Latih Multilingual: 2021

Xue, berjarak dan konstan, Nuh dan Roberts, Adam ... 2 Tersembunyi ... Siddhant, Aditya dan Barua, Aditya dan Rafel, Colin

- Model Bahasa Skala: Metode, Analisis & Wawasan dari Pelatihan Gopher: 2022

Jack W. Rae dan Sebastian Borgeaud dan Trevor Cai ... 74 Tersembunyi ... Demis Hassabis dan Koray Kavukcuoglu dan Geoffrey Irving

- The BigScience Roots Corpus: Dataset Multilingual Komposit 1.6TB: 2022

Laurenccon, Hugo dan Saulnier, Lucile dan Wang, Thomas ... 48 Tersembunyi ... Mitchell, Margaret dan Luccioni, Sasha Alexandra dan Jernite, Yacine

- HTLM: Pra-pelatihan Hyper-Text dan dorongan Model Bahasa: 2022

Armen Aghajanyan dan Dmytro Okhonko dan Mike Lewis ... 1 Tersembunyi ... Hu Xu dan Gargi Ghosh dan Luke Zettlemoyer

- Llama: Model Bahasa Yayasan Terbuka dan Efisien: 2023

Hugo Touvron dan Thibaut Lavril dan Gautier Izacard ... 8 Tersembunyi ... Armand Joulin dan Edouard Grave dan Guillaume Lample

- Dataset RefinedWeb untuk Falcon LLM: Mengungguli Korpor Kurator dengan Data Web, dan Data Web saja: 2023

Guilherme Penedo dan Quentin Malartic dan Daniel Hesslow ... 3 Tersembunyi ... Baptiste Pannier dan Ebtesam Almazrouei dan Julien Launay

- Indeks Transparansi Model Yayasan: 2023

Bommasani, Rishi dan Klyman, Kevin dan Longpre, Shayne ... 2 Tersembunyi ... Xiong, Betty dan Zhang, Daniel dan Liang, Percy

- Dolma: Sebuah korpus terbuka dengan tiga triliun token untuk Model Bahasa Pretraining Research: 2024

Luca Soldaini dan Rodney Kinney dan Akshita Bhagia ... 30 Tersembunyi ... Dirk Groeneveld dan Jesse Dodge dan Kyle Lo

Kualitas Data

Kembali ke Daftar Isi

- Kenlm: Model bahasa yang lebih cepat dan lebih kecil pertanyaan: 2011

HEAFELY, KENNETH

- FastText.zip: Model Klasifikasi Teks Mengompres: 2016

Armand Joulin dan Edouard Grave dan Piotr Bojanowski dan Matthijs Douze dan Hérve Jégou dan Tomas Mikolov

- Belajar kata vektor untuk 157 bahasa: 2018

Grave, Edouard dan Bojanowski, Piotr dan Gupta, Prakhar dan Joulin, Armand dan Mikolov, Tomas

- Model bahasa adalah pelajar multitask tanpa pengawasan: 2019

Alec Radford dan Jeff Wu dan Rewon Child dan David Luan dan Dario Amodei dan Ilya Sutskever

- Model bahasa adalah beberapa pelajar: 2020

Brown, Tom dan Mann, Benjamin dan Ryder, Nick ... 25 Tersembunyi ... Radford, Alec dan Sutskever, Ilya dan Amodei, Dario

- Tumpukan: Dataset 800GB dari beragam teks untuk Pemodelan Bahasa: 2020

Leo Gao dan Stella Biderman dan Sid Black ... 6 Tersembunyi ... Noa Nabeshima dan Shawn Presser dan Connor Leahy

- CCNET: Mengekstraksi Dataset Monolingual Berkualitas Tinggi dari Web Crawl Data: 2020

Wenzek, Guillaume dan Lachaux, Marie-Anne dan Conneau, Alexis ... 1 Tersembunyi ... Guzm'an, Francisco dan Joulin, Armand dan Grave, Edouard

- Detoksifikasi Model Bahasa berisiko meminggirkan suara minoritas: 2021

Xu, Albert dan Pathak, Eshaan dan Wallace, Eric dan Gururangan, Suchin dan Sap, Maarten dan Klein, Dan

- Palm: Pemodelan Bahasa Penskalaan dengan Jalur: 2022

Aakanksha Chowdhery dan Sharan Narang dan Jacob Devlin ... 61 Tersembunyi ... Jeff Dean dan Slave Petrov dan Noah Fiedel

- Model Bahasa Skala: Metode, Analisis & Wawasan dari Pelatihan Gopher: 2022

Jack W. Rae dan Sebastian Borgeaud dan Trevor Cai ... 74 Tersembunyi ... Demis Hassabis dan Koray Kavukcuoglu dan Geoffrey Irving

- Bahasa siapa berkualitas tinggi? Mengukur ideologi bahasa dalam pemilihan data teks: 2022

Gururangan, Suchin and Card, Dallas dan Dreier, Sarah ... 2 Tersembunyi ... Wang, Zeyu dan Zettlemoyer, Luke dan Smith, Noah A.

- Glam: Penskalaan Efisien Model Bahasa dengan Campuran-Eksperti: 2022

Du, Nan dan Huang, Yanping dan Dai, Andrew M ... 21 Tersembunyi ... Wu, Yonghui dan Chen, Zhifeng dan Cui, Claire

- Panduan Pretrainer untuk Data Pelatihan: Mengukur Efek Usia Data, Cakupan Domain, Kualitas, & Toksisitas: 2023

Shayne Longpre dan Gregory Yauney dan Emily Reif ... 5 Tersembunyi ... Kevin Robinson dan David Mimno dan Daphne Ippolito

- Pemilihan Data untuk Model Bahasa melalui Pentingnya Resampling: 2023

Sang Michael Xie dan Shibani Santurkar dan Tengyu Ma dan Percy Liang

- Dataset RefinedWeb untuk Falcon LLM: Mengungguli Korpor Kurator dengan Data Web, dan Data Web saja: 2023

Guilherme Penedo dan Quentin Malartic dan Daniel Hesslow ... 3 Tersembunyi ... Baptiste Pannier dan Ebtesam Almazrouei dan Julien Launay

- Dolma: Sebuah korpus terbuka dengan tiga triliun token untuk Model Bahasa Pretraining Research: 2024

Luca Soldaini dan Rodney Kinney dan Akshita Bhagia ... 30 Tersembunyi ... Dirk Groeneveld dan Jesse Dodge dan Kyle Lo

- Pemrograman Setiap contoh: Mengangkat kualitas data pra-pelatihan seperti para ahli pada skala: 2024

Fan Zhou dan Zengzhi Wang dan Qian Liu dan Junlong Li dan Pengfei Liu

Seleksi khusus domain

Kembali ke Daftar Isi

- Akuisisi Data Teks untuk Model Bahasa Spesifik Domain: 2006

Sethy, Abhinav dan Georgiou, Panayiotis G. dan Narayanan, Shrikanth

- Pilihan Cerdas Data Pelatihan Model Bahasa: 2010

Moore, Robert C. dan Lewis, William

- Pemilihan sinis dari data pelatihan model bahasa: 2017

Amittai Axelrod

- Pemilihan dokumen otomatis untuk pretraining enkoder yang efisien: 2022

Feng, Yukun dan Xia, Patrick dan Van Durme, Benjamin dan Sedoc, Jo ~ AO

- Pemilihan Data untuk Model Bahasa melalui Pentingnya Resampling: 2023

Sang Michael Xie dan Shibani Santurkar dan Tengyu Ma dan Percy Liang

- DSDM: Model-Ware Dataset Seleksi dengan Datamodels: 2024

Logan Engstrom dan Axel Feldmann dan Aleksander Madry

Deduplikasi data

Kembali ke Daftar Isi

- Pertukaran luar angkasa/waktu dalam pengkodean hash dengan kesalahan yang diijinkan: 1970

Bloom, Burton H.

- Array Suffix: Metode baru untuk pencarian string on-line: 1993

Manber, Udi dan Myers, Gene

- Tentang kemiripan dan penahanan dokumen: 1997

Broder, AZ

- Teknik Estimasi Kesamaan dari Algoritma Pembulatan: 2002

Charisikar, Moses S.

- Normalisasi URL untuk de-duplikasi halaman web: 2009

Agarwal, Amit dan Koppula, Hema Swetha dan Leela, Krishna P .... 3 Tersembunyi ... Haty, Chittaranjan dan Roy, Anirban dan Sasturkar, Amit

- Pipa -saluran asinkron untuk memproses korpora besar pada infrastruktur sumber daya menengah ke rendah: 2019

Pedro Javier Ortiz Su'arez dan Beno^It Sagot dan Laurent Romary

- Model bahasa adalah beberapa pelajar: 2020

Brown, Tom dan Mann, Benjamin dan Ryder, Nick ... 25 Tersembunyi ... Radford, Alec dan Sutskever, Ilya dan Amodei, Dario

- Tumpukan: Dataset 800GB dari beragam teks untuk Pemodelan Bahasa: 2020

Leo Gao dan Stella Biderman dan Sid Black ... 6 Tersembunyi ... Noa Nabeshima dan Shawn Presser dan Connor Leahy

- CCNET: Mengekstraksi Dataset Monolingual Berkualitas Tinggi dari Web Crawl Data: 2020

Wenzek, Guillaume dan Lachaux, Marie-Anne dan Conneau, Alexis ... 1 Tersembunyi ... Guzm'an, Francisco dan Joulin, Armand dan Grave, Edouard

- Di luar hukum penskalaan saraf: mengalahkan penskalaan hukum kekuasaan melalui pemangkasan data: 2022

Ben Sorscher dan Robert Geirhos dan Shashank Shekhar dan Surya Ganguli dan Ari S. Morcos

- Deduplicating Training Data Membuat Model Bahasa Lebih Baik: 2022

Lee, Katherine dan Ippolito, Daphne dan Nystrom, Andrew ... 1 Tersembunyi ... Eck, Douglas dan Callison-Burch, Chris dan Carlini, Nicholas

- MTEB: Benchmark Embedding Teks Masif: 2022

Muennighoff, Niklas dan Tazi, Nouamane dan Magne, lo "ic dan reimers, nils

- Palm: Pemodelan Bahasa Penskalaan dengan Jalur: 2022

Aakanksha Chowdhery dan Sharan Narang dan Jacob Devlin ... 61 Tersembunyi ... Jeff Dean dan Slave Petrov dan Noah Fiedel

- Model Bahasa Skala: Metode, Analisis & Wawasan dari Pelatihan Gopher: 2022

Jack W. Rae dan Sebastian Borgeaud dan Trevor Cai ... 74 Tersembunyi ... Demis Hassabis dan Koray Kavukcuoglu dan Geoffrey Irving

- SGPT: GPT Kalimat Embeddings Untuk Pencarian Semantic: 2022

Muennighoff, Niklas

- The BigScience Roots Corpus: Dataset Multilingual Komposit 1.6TB: 2022

Laurenccon, Hugo dan Saulnier, Lucile dan Wang, Thomas ... 48 Tersembunyi ... Mitchell, Margaret dan Luccioni, Sasha Alexandra dan Jernite, Yacine

- C-PACK: Sumber Daya untuk Memajukan Embedding Tiongkok Umum: 2023

Xiao, Shitao dan Liu, Zheng dan Zhang, Peitian dan Muennighoff, Niklas

- D4: Meningkatkan pretraining LLM melalui de-duplikasi dan diversifikasi Dokumen: 2023

Kushal Tirumala dan Daniel Simig dan Armen Aghajanyan dan Ari S. Morcos

- Deduplikasi mendekati skala besar di belakang Bigcode: 2023

Mou, Chenghao

- Paloma: Benchmark untuk Mengevaluasi Model Bahasa Fit: 2023

Ian Magnusson dan Akshita Bhagia dan Valentin Hofmann ... 10 Tersembunyi ... Nuh A. Smith dan Kyle Richardson dan Jesse Dodge

- Mengukur menghafal di seluruh model bahasa saraf: 2023

Nicholas Carlini dan Daphne Ippolito dan Matthew Jagielski dan Katherine Lee dan Florian Tramer dan Chiyuan Zhang

- Semdedup: Pembelajaran Data-Efisien di Web-Scale Melalui Deduplikasi Semantik: 2023

Abbas, Amro dan Tirumala, Kushal dan Simig, D'Aliel dan Ganguli, Surya dan Morcos, Ari S

- Dataset RefinedWeb untuk Falcon LLM: Mengungguli Korpor Kurator dengan Data Web, dan Data Web saja: 2023

Guilherme Penedo dan Quentin Malartic dan Daniel Hesslow ... 3 Tersembunyi ... Baptiste Pannier dan Ebtesam Almazrouei dan Julien Launay

- Apa yang ada di data besar saya?: 2023

Elazar, Yanai dan Bhagia, Akshita dan Magnusson, Ian ... 5 Tersembunyi ... Soldaini, Luca dan Singh, Sameer dan lainnya

- Dolma: Sebuah korpus terbuka dengan tiga triliun token untuk Model Bahasa Pretraining Research: 2024

Luca Soldaini dan Rodney Kinney dan Akshita Bhagia ... 30 Tersembunyi ... Dirk Groeneveld dan Jesse Dodge dan Kyle Lo

- Tuning Instruksi Representasi Generatif: 2024

Muennighoff, Niklas dan Su, Hongjin dan Wang, Liang ... 2 Tersembunyi ... Yu, Tao dan Singh, Amanpreet dan Kiela, Douwe

Memfilter konten beracun dan eksplisit

Kembali ke Daftar Isi

- Menjelajahi Batas Pembelajaran Transfer dengan Transformator Teks ke Teks Terpadu: 2020

Raffel, Colin dan Shazeer, Noam dan Roberts, Adam ... 3 Tersembunyi ... Zhou, Yanqi dan Li, Wei dan Liu, Peter J.

- MT5: Transformator Teks-ke-Teks Pra-Latih Multilingual: 2021

Xue, berjarak dan konstan, Nuh dan Roberts, Adam ... 2 Tersembunyi ... Siddhant, Aditya dan Barua, Aditya dan Rafel, Colin

- Bingung dengan kualitas: metode berbasis kebingungan untuk deteksi konten dewasa dan berbahaya dalam data web heterogen multibahasa: 2022

Tim Jansen dan Yangling Tong dan Victoria Zevallos dan Pedro Ortiz Suarez

- Model Bahasa Skala: Metode, Analisis & Wawasan dari Pelatihan Gopher: 2022

Jack W. Rae dan Sebastian Borgeaud dan Trevor Cai ... 74 Tersembunyi ... Demis Hassabis dan Koray Kavukcuoglu dan Geoffrey Irving

- The BigScience Roots Corpus: Dataset Multilingual Komposit 1.6TB: 2022

Laurenccon, Hugo dan Saulnier, Lucile dan Wang, Thomas ... 48 Tersembunyi ... Mitchell, Margaret dan Luccioni, Sasha Alexandra dan Jernite, Yacine

- Bahasa siapa berkualitas tinggi? Mengukur ideologi bahasa dalam pemilihan data teks: 2022

Gururangan, Suchin and Card, Dallas dan Dreier, Sarah ... 2 Tersembunyi ... Wang, Zeyu dan Zettlemoyer, Luke dan Smith, Noah A.

- Panduan Pretrainer untuk Data Pelatihan: Mengukur Efek Usia Data, Cakupan Domain, Kualitas, & Toksisitas: 2023

Shayne Longpre dan Gregory Yauney dan Emily Reif ... 5 Tersembunyi ... Kevin Robinson dan David Mimno dan Daphne Ippolito

- Dataset pelatihan gambar AI ditemukan termasuk citra pelecehan seksual anak: 2023

David, Emilia

- Mendeteksi Informasi Pribadi dalam Pelatihan Korpora: An Analisis: 2023

Subramani, Nishant dan Luccioni, Sasha dan Dodge, Jesse dan Mitchell, Margaret

- GPT-4 Laporan Teknis: 2023

Openai dan: Dan Josh Achiam ... 276 Tersembunyi ... Juntang Zhuang dan William Zhuk dan Barret Zoph

- Santacoder: Jangan Raih Bintang!: 2023

Allal, Loubna Ben dan Li, Raymond dan Kocetkov, Denis ... 5 Tersembunyi ... Gu, Alex dan Dey, Manan dan Lainnya

- Dataset RefinedWeb untuk Falcon LLM: Mengungguli Korpor Kurator dengan Data Web, dan Data Web saja: 2023

Guilherme Penedo dan Quentin Malartic dan Daniel Hesslow ... 3 Tersembunyi ... Baptiste Pannier dan Ebtesam Almazrouei dan Julien Launay

- Indeks Transparansi Model Yayasan: 2023

Bommasani, Rishi dan Klyman, Kevin dan Longpre, Shayne ... 2 Tersembunyi ... Xiong, Betty dan Zhang, Daniel dan Liang, Percy

- Apa yang ada di data besar saya?: 2023

Elazar, Yanai dan Bhagia, Akshita dan Magnusson, Ian ... 5 Tersembunyi ... Soldaini, Luca dan Singh, Sameer dan lainnya

- Dolma: Sebuah korpus terbuka dengan tiga triliun token untuk Model Bahasa Pretraining Research: 2024

Luca Soldaini dan Rodney Kinney dan Akshita Bhagia ... 30 Tersembunyi ... Dirk Groeneveld dan Jesse Dodge dan Kyle Lo

- Olmo: Mempercepat Sains Model Bahasa: 2024

Groeneveld, Dirk and Beltagy, Iz dan Walsh, Pete ... 5 Tersembunyi ... Magnusson, Ian dan Wang, Yizhong dan Lainnya

Seleksi khusus untuk model multibahasa

Kembali ke Daftar Isi

- BLOOM: Model bahasa multibahasa akses-parameter 176b-parameter: 2022

Workshop, BigScience and Scao, Teven Le and Fan, Angela ... 5 Tersembunyi ... Luccioni, Alexandra Sasha dan Yvon, Franccois dan lainnya

- Kualitas sekilas: Audit dataset multibahasa yang sedang dirangkak web: 2022

Kreutzer, Julia dan Caswell, Isaac dan Wang, Lisa ... 46 Tersembunyi ... Ahia, Oghenefego dan Agrawal, Sweta dan Adeyemi, Mofetoluwa

- The BigScience Roots Corpus: Dataset Multilingual Komposit 1.6TB: 2022

Laurenccon, Hugo dan Saulnier, Lucile dan Wang, Thomas ... 48 Tersembunyi ... Mitchell, Margaret dan Luccioni, Sasha Alexandra dan Jernite, Yacine

- Model bahasa apa yang akan dilatih jika Anda memiliki satu juta jam GPU?: 2022

Scao, Teven Le dan Wang, Thomas dan Hesslow, Daniel ... 5 Tersembunyi ... Muennighoff, Niklas dan Phang, Jason dan lainnya

- Madlad-400: Dataset Besar Multilingual dan Level Dokumen: 2023

Kudugunta, Sneha dan Caswell, Isaac dan Zhang, Biao ... 5 Tersembunyi ... Stella, Romi dan Bapna, Ankur dan lainnya

- SCALING Model Bahasa Multilingual Di Bawah Data Terkendala: 2023

Scao, Teven Le

- Dataset Aya: Koleksi akses terbuka untuk penyetelan instruksi multibahasa: 2024

Shivalika Singh dan Freddie Vargus dan Daniel Dsouza ... 27 Tersembunyi ... Ahmet üstün dan Marzieh Fadaee dan Sara Hooker

Pencampuran data

Kembali ke Daftar Isi

- Masalah Bandit multiarmed nonstokastik: 2002

Auer, Peter dan Cesa-Bianchi, Nicol`o dan Freund, Yoav dan Schapire, Robert E.

- Pemodelan bahasa yang kuat secara distribusi: 2019

Oren, Yonatan dan Sagawa, Shiori dan Hashimoto, Tatsunori B. dan Liang, Percy

- Jaringan saraf yang kuat secara distribusi: 2020

Shiori Sagawa dan Pang Wei Koh dan Tatsunori B. Hashimoto dan Percy Liang

- Menjelajahi Batas Pembelajaran Transfer dengan Transformator Teks ke Teks Terpadu: 2020

Raffel, Colin dan Shazeer, Noam dan Roberts, Adam ... 3 Tersembunyi ... Zhou, Yanqi dan Li, Wei dan Liu, Peter J.

- Tumpukan: Dataset 800GB dari beragam teks untuk Pemodelan Bahasa: 2020

Leo Gao dan Stella Biderman dan Sid Black ... 6 Tersembunyi ... Noa Nabeshima dan Shawn Presser dan Connor Leahy

- Model Bahasa Skala: Metode, Analisis & Wawasan dari Pelatihan Gopher: 2022

Jack W. Rae dan Sebastian Borgeaud dan Trevor Cai ... 74 Tersembunyi ... Demis Hassabis dan Koray Kavukcuoglu dan Geoffrey Irving

- Glam: Penskalaan Efisien Model Bahasa dengan Campuran-Eksperti: 2022

Du, Nan dan Huang, Yanping dan Dai, Andrew M ... 21 Tersembunyi ... Wu, Yonghui dan Chen, Zhifeng dan Cui, Claire

- Pengawasan lintas-bahasa meningkatkan model bahasa besar pra-pelatihan: 2023

Andrea Schioppa dan Xavier Garcia dan Orhan Firat

- [DOGE: Domain Reobegning dengan Estimasi Generalisasi] (https://arxiv.org/abs/arxiv preprint): 2023

Simin Fan dan Matteo Pagliardini dan Martin Jaggi

- Doremi: Mengoptimalkan campuran data mempercepat model bahasa pretraining: 2023

Sang Michael Xie dan Hieu Pham dan Xuanyi Dong ... 4 Tersembunyi ... Quoc v Le dan Tengyu Ma dan Adams Wei Yu

- Pencampuran data online yang efisien untuk model bahasa pra-pelatihan: 2023

Alon Albalak dan Liangming Pan dan Colin Raffel dan William Yang Wang

- Llama: Model Bahasa Yayasan Terbuka dan Efisien: 2023

Hugo Touvron dan Thibaut Lavril dan Gautier Izacard ... 8 Tersembunyi ... Armand Joulin dan Edouard Grave dan Guillaume Lample

- Pythia: Suite untuk menganalisis model bahasa besar di seluruh pelatihan dan penskalaan: 2023

Biderman, Stella dan Schoelkopf, Hailey dan Anthony, Quentin Gregory ... 7 Tersembunyi ... Skowron, Aviya dan Sutawika, Lintang dan Van der Wal, Oskar

- Model Bahasa yang Terkendala Data: 2023

Niklas Muennighoff dan Alexander M Rush dan Boaz Barak ... 3 Tersembunyi ... Sampo Pyysalo dan Thomas Wolf dan Colin Raffel

- Llama Sheared: Model Bahasa yang Mempercepat Pra-Pelatihan Melalui Pemangkasan Struktur: 2023

Mengzhou Xia dan Tianyu Gao dan Zhiyuan Zeng dan Danqi Chen

- Keterampilan-itu! Kerangka Kerja Keterampilan Berbasis Data untuk Model Pemahaman dan Pelatihan Bahasa: 2023

Mayee F. Chen dan Nicholas Roberts dan Kush Bhatia ... 1 Tersembunyi ... Ce Zhang dan Frederic Sala dan Christopher Ré

Pemilihan data untuk pelatihan penyetelan instruksi dan multitask

Kembali ke Daftar Isi

- The Natural Language Decathlon: Multitask Learning sebagai Penjawab pertanyaan: 2018

McCann, Bryan dan Keskar, Nitish Shirish dan Xiong, Caiming and Socher, Richard

- PERTANYAAN PERTANYAAN PERTANYAAN, KLASIFIKASI TEKS, DAN Regresi Melalui Ekstraksi Bentang: 2019

Keskar, Nitish Shirish dan McCann, Bryan dan Xiong, Caiming and Socher, Richard

- Jaringan saraf dalam multi-tugas untuk pemahaman bahasa alami: 2019

Liu, Xiaodong dan dia, Pengcheng dan Chen, Weizhu dan Gao, Jianfeng

- UnifiedQA: Batas format persimpangan dengan sistem QA tunggal: 2020

Khashabi, Daniel dan Min, Sewon dan Khot, Tushar ... 1 Tersembunyi ... Tafjord, Oyvind dan Clark, Peter dan Hajishirzi, Hannaneh

- Menjelajahi Batas Pembelajaran Transfer dengan Transformator Teks ke Teks Terpadu: 2020

Raffel, Colin dan Shazeer, Noam dan Roberts, Adam ... 3 Tersembunyi ... Zhou, Yanqi dan Li, Wei dan Liu, Peter J.

- Muppet: Representasi multi-tugas besar-besaran dengan pra-finetuning: 2021

Aghajanyan, Armen dan Gupta, Anchit dan Shrivastava, Akshat dan Chen, Xilun dan Zettlemoyer, Luke dan Gupta, Sonal

- Model Bahasa Finetuned Adalah Peserta didik Zero-shot: 2021

Wei, Jason dan Bosma, Maarten dan Zhao, Vincent Y .... 3 Tersembunyi ... Du, Nan dan Dai, Andrew M. dan Le, Quoc V.

- Generalisasi silang melalui instruksi crowdsourcing bahasa alami: 2021

Mishra, Swaroop dan Khashabi, Daniel dan Baral, Chitta dan Hajishirzi, Hannaneh

- NL-Augmenter: Kerangka kerja untuk augmentasi bahasa alami yang peka terhadap tugas: 2021

Dhole, Kaustubh D dan Gangal, Varun dan Gehrmann, Sebastian ... 5 Tersembunyi ... Shrivastava, Ashish dan Tan, Samson dan lainnya

- Ext5: Menuju penskalaan multi-tugas yang ekstrem untuk pembelajaran transfer: 2021

Aribandi, Vamsi dan Tay, Yi dan Schuster, Tal ... 5 Tersembunyi ... Bahri, Dara dan Ni, Jianmo dan lainnya

- Super-natural Instruksi: Generalisasi melalui instruksi deklaratif pada 1600+ tugas NLP: 2022

Wang, Yizhong dan Mishra, Swaroop dan Alipoormolabashi, Pegah ... 29 Tersembunyi ... Patro, Sumanta dan Dixit, Tanay dan Shen, Xudong

- Model Bahasa yang Di-Instruksi Penskalaan: 2022

Chung, Hyung Won dan Hou, Le and Longpre, Shayne ... 5 Tersembunyi ... Dehghani, Mostafa dan Brahma, Siddhartha dan lainnya

- Bloom+ 1: Menambahkan dukungan bahasa ke mekar untuk diminta nol-shot: 2022

Yong, Zheng-Xin dan Schoelkopf, Hailey dan Muennighoff, Niklas ... 5 tersembunyi ... Kasai, Jungo dan Baruwa, Ahmed dan lainnya

- OPT-IML: Instruksi Model Bahasa Skala Pembelajaran Meta melalui Lensa Generalisasi: 2022

Srinivasan Iyer dan Xi Victoria Lin dan Ramakanth Pasunuru ... 12 Tersembunyi ... Asli Celikyilmaz dan Luke Zettlemoyer dan Ves Stoyanov

- Metaicl: Belajar Belajar dalam Konteks: 2022

Min, Sewon dan Lewis, Mike dan Zettlemoyer, Luke dan Hajishirzi, Hannaneh

- Instruksi yang tidak wajar: Model bahasa tuning dengan (hampir) tidak ada tenaga manusia: 2022

Honovich, atau dan Scialom, Thomas and Levy, Omer dan Schick, Timo

- Generalisasi crosslingual melalui finetuning multitask: 2022

Muennighoff, Niklas dan Wang, Thomas dan Sutawika, Lintang ... 5 Tersembunyi ... Yong, Zheng-Xin dan Schoelkopf, Hailey dan lainnya

- Pelatihan Multitask yang Diminta Mengaktifkan Generalisasi Tugas Zero-Shot: 2022

Victor Sanh dan Albert Webson dan Colin Raffel ... 34 Tersembunyi ... Leo Gao dan Thomas Wolf dan Alexander M Rush

- Prometheus: menginduksi kemampuan evaluasi berbutir halus dalam model bahasa: 2023

Kim, Seungone dan Shin, Jamin dan Cho, Yejin ... 5 Tersembunyi ... Kim, Sungdong dan Thorne, James dan lainnya

- Slimorca: Dataset Terbuka GPT-4 Augmented Flan Reasoning Traces, dengan Verifikasi: 2023

Wing Lian dan Guan Wang dan Bleys Goodson ... 1 Tersembunyi ... Austin Cook dan Chanvichet Vong dan "Teknium"

- Apakah AI Art mencuri dari seniman?: 2023

Chayka, Kyle

- Paul Tremblay, Mona Awad vs Openai, Inc., dkk.: 2023

Saveri, Joseph R. dan Zirpoli, Cadio dan Young, Christopher KL dan McMahon, Kathleen J.

- Membuat model bahasa besar pencipta data yang lebih baik: 2023

Lee, Dong-ho dan Pujara, Jay dan Sewak, Mohit dan White, Ryen dan Jauhar, Sujay

- Koleksi Flan: Merancang Data dan Metode untuk Penyetelan Instruksi yang Efektif: 2023

Shayne Longpre dan Le Hou dan Tu Vu ... 5 Tersembunyi ... Barret Zoph dan Jason Wei dan Adam Roberts

- Wizardlm: Memberdayakan Model Bahasa Besar Untuk Mengikuti Instruksi Kompleks: 2023

Xu, Can and Sun, Qingfeng dan Zheng, Kai ... 2 Tersembunyi ... Feng, Jiazhan dan Tao, Chongyang dan Jiang, Daxin

- Lima: Less lebih banyak untuk penyelarasan: 2023

Chunting Zhou dan Pengfei Liu dan Puxin Xu ... 9 Tersembunyi ... Mike Lewis dan Luke Zettlemoyer dan Omer Levy

- Unta dalam iklim yang berubah: Meningkatkan adaptasi LM dengan Tulu 2: 2023

Hamish Ivison dan Yizhong Wang dan Valentina Pyatkin ... 5 Tersembunyi ... Nuh A. Smith dan Iz Beltagy dan Hananeh Hajishirzi

- Mandiri Self-Instruksi: Menyelaraskan Model Bahasa dengan Instruksi yang Dihasilkan Diri: 2023

Wang, Yizhong dan Kordi, Yeganeh dan Mishra, Swaroop ... 1 Tersembunyi ... Smith, Nuh A. dan Khashabi, Daniel dan Hajishirzi, Hannaneh

- Apa yang membuat data yang baik untuk penyelarasan? Studi komprehensif pemilihan data otomatis dalam penyetelan instruksi: 2023

Liu, Wei dan Zeng, Weihao dan dia, Keqing dan Jiang, Yong dan dia, Junxian

- Tuning Instruksi untuk Model Bahasa Besar: Survei: 2023

Shengyu Zhang dan Linfeng Dong dan Xiaooya Li ... 5 Tersembunyi ... Tianwei Zhang dan Fei Wu dan Guoyin Wang

- Stanford Alpaca: Model Llama yang mengikuti instruksi: 2023

Rohan Taori dan Ishaan Gulrajani dan Tianyi Zhang ... 2 Tersembunyi ... Carlos Guestrin dan Percy Liang dan Tatsunori B. Hashimoto

- Seberapa jauh unta bisa? Menjelajahi keadaan penyetelan instruksi tentang sumber daya terbuka: 2023

Yizhong Wang dan Hamish Ivison dan Pradeep Dasigi ... 5 Tersembunyi ... Nuh A. Smith dan Iz Beltagy dan Hananeh Hajishirzi

- Percakapan OpenAssistant-Demokratisasi Penyelarasan Model Bahasa Besar: 2023

K "OPF, Andreas dan Kilcher, Yannic dan Von R" Utte, Dimitri ... 5 Tersembunyi ... Stanley, Oliver dan Nagyfi, Rich'ard dan lainnya

- Octopack: Kode Tuning Instruksi Model Bahasa Besar: 2023

Niklas Muennighoff dan Qian Liu dan Armel Zebaze ... 4 Tersembunyi ... Xiangru Tang dan Leandro von Werra dan Shayne Longpre

- Self: Evolusi diri yang didorong oleh bahasa untuk Model Bahasa Besar: 2023

Lu, Jianqiao dan Zhong, Wanjun dan Huang, Wenyong ... 3 Tersembunyi ... Wang, Weichao dan Shang, Lifeng dan Liu, Qun

- Koleksi Flan: Merancang Data dan Metode untuk Penyetelan Instruksi yang Efektif: 2023

Longpre, Shayne dan Hou, Le and Vu, Tu ... 5 Tersembunyi ... Zoph, Barret dan Wei, Jason dan Roberts, Adam

- #Instag: Tags instruksi untuk menganalisis fine-tuning yang diawasi dari model bahasa besar: 2023

Keming Lu dan Hongyi Yuan dan Zheng Yuan ... 2 Tersembunyi ... Chuanqi Tan dan Chang Zhou dan Jingren Zhou

- Penambangan Instruksi: Ketika Data Mining Bertemu Model Bahasa Besar Finetuning: 2023

Yihan Cao dan Yanbin Kang dan Chi Wang dan Lichao Sun

- Tuning Instruksi Aktif: Meningkatkan Generalisasi Cross-Task dengan Pelatihan tentang Tugas Sensitif yang Segera: 2023

Po-Nien Kung dan Fan Yin dan Di Wu dan Kai-Wei Chang dan Nanyun Peng

- Inisiatif Provenance Data: Audit skala besar dari lisensi & atribusi dataset di AI: 2023

Longpre, Shayne dan Mahari, Robert dan Chen, Anthony ... 5 Tersembunyi ... Kabbara, Jad dan Perisetla, Kartik dan Lainnya

- Dataset Aya: Koleksi akses terbuka untuk penyetelan instruksi multibahasa: 2024

Shivalika Singh dan Freddie Vargus dan Daniel Dsouza ... 27 Tersembunyi ... Ahmet üstün dan Marzieh Fadaee dan Sara Hooker

- Astraios: Parameter-Efisien Kode Tuning Model Bahasa Besar: 2024

Zhuo, Terry Yue dan Zebaze, Armel dan Sepattarachai, Nitchakarn ... 1 Tersembunyi ... De Vries, Harm and Liu, Qian dan Muennighoff, Niklas

- Model Aya: Instruksi Finetuned Open-Access Multilingual Bahasa Model: 2024

"UST" UN, Ahmet dan Aryabumi, Viraat dan Yong, Zheng-Xin ... 5 Tersembunyi ... Ooi, Hui-Lee dan Kayid, AMR dan Lainnya

- Model bahasa yang lebih kecil mampu memilih data pelatihan penyetelan instruksi untuk model bahasa yang lebih besar: 2024

Dheeraj Mekala dan Alex Nguyen dan Jingbo Shang

- Kurasi Data Otomatis untuk Fine Tuning Model Bahasa yang Kuat: 2024

Jihai Chen dan Jonas Mueller

Pemilihan data untuk penyempurnaan preferensi: Alignment

Kembali ke Daftar Isi

- WebGPT: Permintaan yang dibantu oleh browser dengan umpan balik manusia: 2021

Nakano, Reiichiro dan Hilton, Jacob dan Balaji, Suchir ... 5 Tersembunyi ... Kosaraju, Vineet dan Saunders, William dan Lainnya

- Melatih asisten yang membantu dan tidak berbahaya dengan pembelajaran penguatan dari umpan balik manusia: 2022

Bai, Yuntao dan Jones, Andy dan Ndousse, Kamal ... 5 Tersembunyi ... Ganguli, Deep dan Henighan, Tom dan Lainnya

- Memahami Kesulitan Dataset Dengan $ MathCalv $ -Seable Information: 2022

Ethayarajh, Kawin dan Choi, Yejin dan Swayamdipta, Swabha

- AI Konstitusi: tidak berbahaya dari umpan balik AI: 2022

Bai, Yuntao dan Kadavath, Saurav dan Kundu, Sandipan ... 5 Tersembunyi ... Mirhoseini, Azalia dan McKinnon, Cameron dan lainnya

- Prometheus: menginduksi kemampuan evaluasi berbutir halus dalam model bahasa: 2023

Kim, Seungone dan Shin, Jamin dan Cho, Yejin ... 5 Tersembunyi ... Kim, Sungdong dan Thorne, James dan lainnya

- Notus: 2023

Alvaro Bartolome dan Gabriel Martin dan Daniel Vila

- Ultrafeedback: Meningkatkan model bahasa dengan umpan balik berkualitas tinggi: 2023

Ganqu Cui and Lifan Yuan and Ning Ding... 3 hidden ... Guotong Xie and Zhiyuan Liu and Maosong Sun

- Exploration with Principles for Diverse AI Supervision: 2023

Liu, Hao and Zaharia, Matei and Abbeel, Pieter

- Wizardlm: Empowering large language models to follow complex instructions: 2023

Xu, Can and Sun, Qingfeng and Zheng, Kai... 2 hidden ... Feng, Jiazhan and Tao, Chongyang and Jiang, Daxin

- LIMA: Less Is More for Alignment: 2023

Chunting Zhou and Pengfei Liu and Puxin Xu... 9 hidden ... Mike Lewis and Luke Zettlemoyer and Omer Levy

- Shepherd: A Critic for Language Model Generation: 2023

Tianlu Wang and Ping Yu and Xiaoqing Ellen Tan... 4 hidden ... Luke Zettlemoyer and Maryam Fazel-Zarandi and Asli Celikyilmaz

- No Robots: 2023

Nazneen Rajani and Lewis Tunstall and Edward Beeching and Nathan Lambert and Alexander M. Rush and Thomas Wolf

- Starling-7B: Improving LLM Helpfulness & Harmlessness with RLAIF: 2023

Zhu, Banghua and Frick, Evan and Wu, Tianhao and Zhu, Hanlin and Jiao, Jiantao

- Scaling laws for reward model overoptimization: 2023

Gao, Leo and Schulman, John and Hilton, Jacob

- SALMON: Self-Alignment with Principle-Following Reward Models: 2023

Zhiqing Sun and Yikang Shen and Hongxin Zhang... 2 hidden ... David Cox and Yiming Yang and Chuang Gan

- Open Problems and Fundamental Limitations of Reinforcement Learning from Human Feedback: 2023

Stephen Casper and Xander Davies and Claudia Shi... 26 hidden ... David Krueger and Dorsa Sadigh and Dylan Hadfield-Menell

- Camels in a Changing Climate: Enhancing LM Adaptation with Tulu 2: 2023

Hamish Ivison and Yizhong Wang and Valentina Pyatkin... 5 hidden ... Noah A. Smith and Iz Beltagy and Hannaneh Hajishirzi

- Llama 2: Open Foundation and Fine-Tuned Chat Models: 2023

Hugo Touvron and Louis Martin and Kevin Stone... 62 hidden ... Robert Stojnic and Sergey Edunov and Thomas Scialom

- What Makes Good Data for Alignment? A Comprehensive Study of Automatic Data Selection in Instruction Tuning: 2023

Liu, Wei and Zeng, Weihao and He, Keqing and Jiang, Yong and He, Junxian

- HuggingFace H4 Stack Exchange Preference Dataset: 2023

Lambert, Nathan and Tunstall, Lewis and Rajani, Nazneen and Thrush, Tristan

- Textbooks Are All You Need: 2023

Gunasekar, Suriya and Zhang, Yi and Aneja, Jyoti... 5 hidden ... de Rosa, Gustavo and Saarikivi, Olli and others

- Quality-Diversity through AI Feedback: 2023

Herbie Bradley and Andrew Dai and Hannah Teufel... 4 hidden ... Kenneth Stanley and Grégory Schott and Joel Lehman

- Direct preference optimization: Your language model is secretly a reward model: 2023

Rafailov, Rafael and Sharma, Archit and Mitchell, Eric and Ermon, Stefano and Manning, Christopher D and Finn, Chelsea

- Scaling relationship on learning mathematical reasoning with large language models: 2023

Yuan, Zheng and Yuan, Hongyi and Li, Chengpeng and Dong, Guanting and Tan, Chuanqi and Zhou, Chang

- The History and Risks of Reinforcement Learning and Human Feedback: 2023

Lambert, Nathan and Gilbert, Thomas Krendl and Zick, Tom

- Zephyr: Direct distillation of lm alignment: 2023

Tunstall, Lewis and Beeching, Edward and Lambert, Nathan... 5 hidden ... Fourrier, Cl'ementine and Habib, Nathan and others

- Perils of Self-Feedback: Self-Bias Amplifies in Large Language Models: 2024

Wenda Xu and Guanglei Zhu and Xuandong Zhao and Liangming Pan and Lei Li and William Yang Wang

- Suppressing Pink Elephants with Direct Principle Feedback: 2024

Louis Castricato and Nathan Lile and Suraj Anand and Hailey Schoelkopf and Siddharth Verma and Stella Biderman

- West-of-N: Synthetic Preference Generation for Improved Reward Modeling: 2024

Alizée Pace and Jonathan Mallinson and Eric Malmi and Sebastian Krause and Aliaksei Severyn

- Statistical Rejection Sampling Improves Preference Optimization: 2024

Liu, Tianqi and Zhao, Yao and Joshi, Rishabh... 1 hidden ... Saleh, Mohammad and Liu, Peter J and Liu, Jialu

- Self-play fine-tuning converts weak language models to strong language models: 2024

Chen, Zixiang and Deng, Yihe and Yuan, Huizhuo and Ji, Kaixuan and Gu, Quanquan

- Self-Rewarding Language Models: 2024

Weizhe Yuan and Richard Yuanzhe Pang and Kyunghyun Cho and Sainbayar Sukhbaatar and Jing Xu and Jason Weston

- Theoretical guarantees on the best-of-n alignment policy: 2024

Beirami, Ahmad and Agarwal, Alekh and Berant, Jonathan... 1 hidden ... Eisenstein, Jacob and Nagpal, Chirag and Suresh, Ananda Theertha

- KTO: Model Alignment as Prospect Theoretic Optimization: 2024

Ethayarajh, Kawin and Xu, Winnie and Muennighoff, Niklas and Jurafsky, Dan and Kiela, Douwe

Data Selection for In-Context Learning

Back to Table of Contents

- Sentence-BERT: Sentence Embeddings using Siamese BERT-Networks: 2019

Reimers, Nils and Gurevych, Iryna

- Language Models are Few-Shot Learners: 2020

Brown, Tom and Mann, Benjamin and Ryder, Nick... 25 hidden ... Radford, Alec and Sutskever, Ilya and Amodei, Dario

- True Few-Shot Learning with Language Models: 2021

Ethan Perez and Douwe Kiela and Kyunghyun Cho

- Active Example Selection for In-Context Learning: 2022

Zhang, Yiming and Feng, Shi and Tan, Chenhao

- Careful Data Curation Stabilizes In-context Learning: 2022

Chang, Ting-Yun and Jia, Robin

- Learning To Retrieve Prompts for In-Context Learning: 2022

Rubin, Ohad and Herzig, Jonathan and Berant, Jonathan

- Fantastically Ordered Prompts and Where to Find Them: Overcoming Few-Shot Prompt Order Sensitivity: 2022

Lu, Yao and Bartolo, Max and Moore, Alastair and Riedel, Sebastian and Stenetorp, Pontus

- What Makes Good In-Context Examples for GPT-3?: 2022

Liu, Jiachang and Shen, Dinghan and Zhang, Yizhe and Dolan, Bill and Carin, Lawrence and Chen, Weizhu

- MetaICL: Learning to Learn In Context: 2022

Min, Sewon and Lewis, Mike and Zettlemoyer, Luke and Hajishirzi, Hannaneh

- Unified Demonstration Retriever for In-Context Learning: 2023

Li, Xiaonan and Lv, Kai and Yan, Hang... 3 hidden ... Xie, Guotong and Wang, Xiaoling and Qiu, Xipeng

- Which Examples to Annotate for In-Context Learning? Towards Effective and Efficient Selection: 2023

Mavromatis, Costas and Srinivasan, Balasubramaniam and Shen, Zhengyuan... 1 hidden ... Rangwala, Huzefa and Faloutsos, Christos and Karypis, George

- Large Language Models Are Latent Variable Models: Explaining and Finding Good Demonstrations for In-Context Learning: 2023

Xinyi Wang and Wanrong Zhu and Michael Saxon and Mark Steyvers and William Yang Wang

- Selective Annotation Makes Language Models Better Few-Shot Learners: 2023

Hongjin SU and Jungo Kasai and Chen Henry Wu... 5 hidden ... Luke Zettlemoyer and Noah A. Smith and Tao Yu

- In-context Example Selection with Influences: 2023

Nguyen, Tai and Wong, Eric

- Coverage-based Example Selection for In-Context Learning: 2023

Gupta, Shivanshu and Singh, Sameer and Gardner, Matt

- Compositional exemplars for in-context learning: 2023

Ye, Jiacheng and Wu, Zhiyong and Feng, Jiangtao and Yu, Tao and Kong, Lingpeng

- Take one step at a time to know incremental utility of demonstration: An analysis on reranking for few-shot in-context learning: 2023

Hashimoto, Kazuma and Raman, Karthik and Bendersky, Michael

- Ambiguity-aware in-context learning with large language models: 2023

Gao, Lingyu and Chaudhary, Aditi and Srinivasan, Krishna and Hashimoto, Kazuma and Raman, Karthik and Bendersky, Michael

- IDEAL: Influence-Driven Selective Annotations Empower In-Context Learners in Large Language Models: 2023

Zhang, Shaokun and Xia, Xiaobo and Wang, Zhaoqing... 1 hidden ... Liu, Jiale and Wu, Qingyun and Liu, Tongliang

- ScatterShot: Interactive In-context Example Curation for Text Transformation: 2023

Wu, Sherry and Shen, Hua and Weld, Daniel S and Heer, Jeffrey and Ribeiro, Marco Tulio

- Diverse Demonstrations Improve In-context Compositional Generalization: 2023

Levy, Itay and Bogin, Ben and Berant, Jonathan

- Finding supporting examples for in-context learning: 2023

Li, Xiaonan and Qiu, Xipeng

- Misconfidence-based Demonstration Selection for LLM In-Context Learning: 2024

Xu, Shangqing and Zhang, Chao

- In-context Learning with Retrieved Demonstrations for Language Models: A Survey: 2024

Xu, Xin and Liu, Yue and Pasupat, Panupong and Kazemi, Mehran and others

Data Selection for Task-specific Fine-tuning

Back to Table of Contents

- A large annotated corpus for learning natural language inference: 2015

Bowman, Samuel R. and Angeli, Gabor and Potts, Christopher and Manning, Christopher D.

- GLUE: A Multi-Task Benchmark and Analysis Platform for Natural Language Understanding: 2018

Wang, Alex and Singh, Amanpreet and Michael, Julian and Hill, Felix and Levy, Omer and Bowman, Samuel

- A Broad-Coverage Challenge Corpus for Sentence Understanding through Inference: 2018

Williams, Adina and Nangia, Nikita and Bowman, Samuel

- Sentence Encoders on STILTs: Supplementary Training on Intermediate Labeled-data Tasks: 2019

Jason Phang and Thibault Févry and Samuel R. Bowman

- Distributionally Robust Neural Networks: 2020

Shiori Sagawa and Pang Wei Koh and Tatsunori B. Hashimoto and Percy Liang

- Dataset Cartography: Mapping and Diagnosing Datasets with Training Dynamics: 2020

Swayamdipta, Swabha and Schwartz, Roy and Lourie, Nicholas... 1 hidden ... Hajishirzi, Hannaneh and Smith, Noah A. and Choi, Yejin

- Intermediate-Task Transfer Learning with Pretrained Language Models: When and Why Does It Work?: 2020

Pruksachatkun, Yada and Phang, Jason and Liu, Haokun... 3 hidden ... Vania, Clara and Kann, Katharina and Bowman, Samuel R.

- On the Complementarity of Data Selection and Fine Tuning for Domain Adaptation: 2021

Dan Iter and David Grangier

- FETA: A Benchmark for Few-Sample Task Transfer in Open-Domain Dialogue: 2022

Albalak, Alon and Tuan, Yi-Lin and Jandaghi, Pegah... 3 hidden ... Getoor, Lise and Pujara, Jay and Wang, William Yang

- LoRA: Low-Rank Adaptation of Large Language Models: 2022

Edward J Hu and yelong shen and Phillip Wallis... 2 hidden ... Shean Wang and Lu Wang and Weizhu Chen

- Training Subset Selection for Weak Supervision: 2022

Lang, Hunter and Vijayaraghavan, Aravindan and Sontag, David

- On-Demand Sampling: Learning Optimally from Multiple Distributions: 2022

Haghtalab, Nika and Jordan, Michael and Zhao, Eric

- The Trade-offs of Domain Adaptation for Neural Language Models: 2022

Grangier, David and Iter, Dan

- Data Pruning for Efficient Model Pruning in Neural Machine Translation: 2023

Azeemi, Abdul and Qazi, Ihsan and Raza, Agha

- Skill-it! A Data-Driven Skills Framework for Understanding and Training Language Models: 2023

Mayee F. Chen and Nicholas Roberts and Kush Bhatia... 1 hidden ... Ce Zhang and Frederic Sala and Christopher Ré

- D2 Pruning: Message Passing for Balancing Diversity and Difficulty in Data Pruning: 2023

Adyasha Maharana and Prateek Yadav and Mohit Bansal

- Improving Few-Shot Generalization by Exploring and Exploiting Auxiliary Data: 2023

Alon Albalak and Colin Raffel and William Yang Wang

- Efficient Online Data Mixing For Language Model Pre-Training: 2023

Alon Albalak and Liangming Pan and Colin Raffel and William Yang Wang

- Data-Efficient Finetuning Using Cross-Task Nearest Neighbors: 2023

Ivison, Hamish and Smith, Noah A. and Hajishirzi, Hannaneh and Dasigi, Pradeep

- Make Every Example Count: On the Stability and Utility of Self-Influence for Learning from Noisy NLP Datasets: 2023

Bejan, Irina and Sokolov, Artem and Filippova, Katja

- LESS: Selecting Influential Data for Targeted Instruction Tuning: 2024

Mengzhou Xia and Sadhika Malladi and Suchin Gururangan and Sanjeev Arora and Danqi Chen

Kontribusi

There are likely some amazing works in the field that we missed, so please contribute to the repo.

Feel free to open a pull request with new papers or create an issue and we can add them for you. Thank you in advance for your efforts!

Kutipan

We hope this work serves as inspiration for many impactful future works. If you found our work useful, please cite this paper as:

@article{albalak2024survey,

title={A Survey on Data Selection for Language Models},

author={Alon Albalak and Yanai Elazar and Sang Michael Xie and Shayne Longpre and Nathan Lambert and Xinyi Wang and Niklas Muennighoff and Bairu Hou and Liangming Pan and Haewon Jeong and Colin Raffel and Shiyu Chang and Tatsunori Hashimoto and William Yang Wang},

year={2024},

journal={arXiv preprint arXiv:2402.16827},

note={url{https://arxiv.org/abs/2402.16827}}

}