Verwenden Sie LVCNET zum Entwerfen des Generators des parallelen Wellengegers und der gleichen Strategie zum Training, die Inferenzgeschwindigkeit des neuen Vokoders ist mehr als 5 -fach schneller als der ursprüngliche Vokoder ohne Abbau der Audioqualität .

Unsere aktuellen Werke [Papier] wurden von ICASP2021 akzeptiert, und unsere früheren Werke wurden in MelGlow beschrieben.

Bereiten Sie die Daten vor, laden Sie LJSpeech Datensatz von https://keithito.com/lj-speech-dataset/ herunter und speichern Sie sie in data/LJSpeech-1.1 . Dann rennen

python - m vocoder . preprocess - - data - dir . / data / LJSpeech - 1.1 - - config configs / lvcgan . v1 . yaml Die mel-sepctrums werden in der temp/ berechnet und gespeichert.

Training LVCNET

python - m vocoder . train - - config configs / lvcgan . v1 . yaml - - exp - dir exps / exp . lvcgan . v1Testen Sie LVCNET

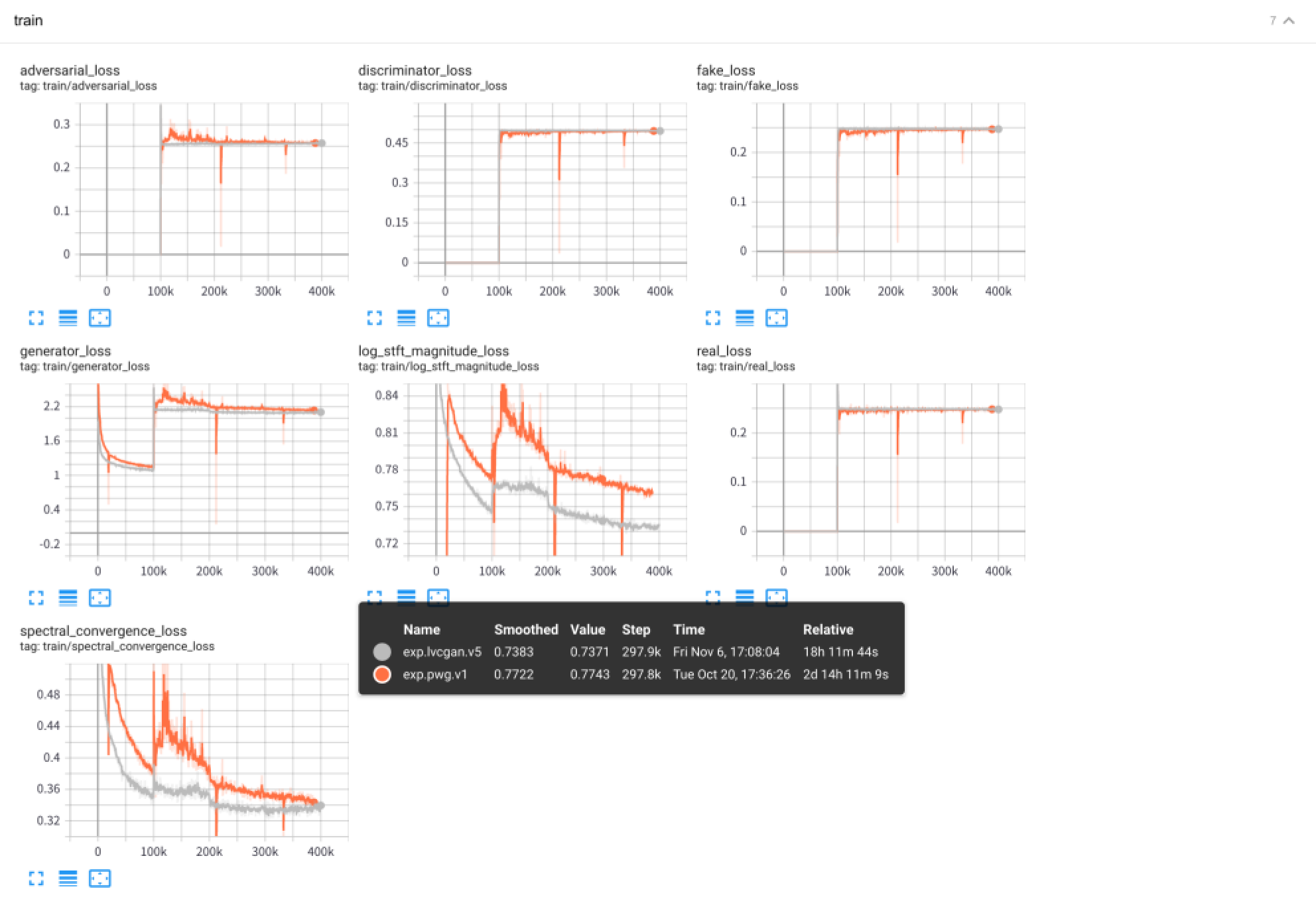

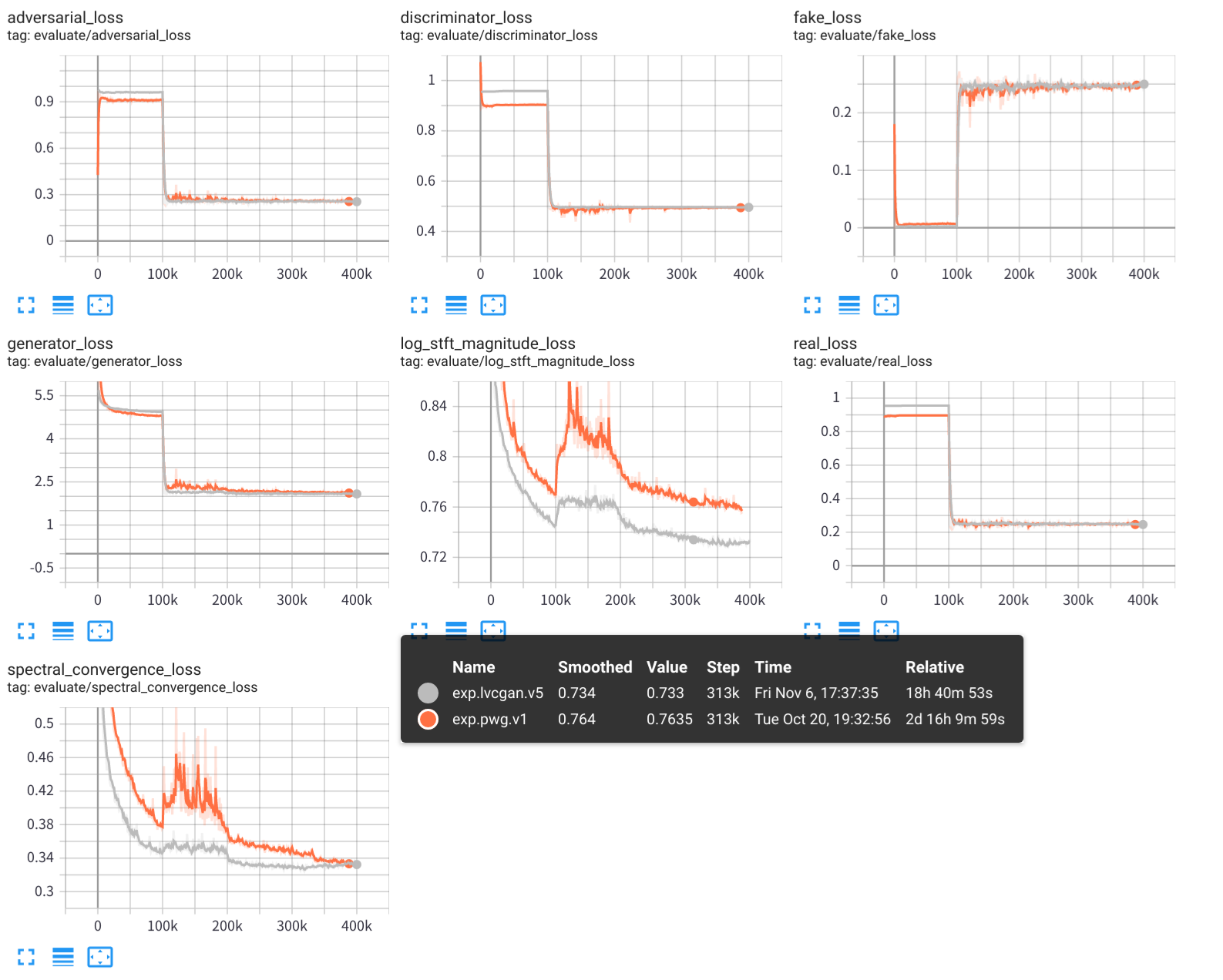

python - m vocoder . test - - config configs / lvcgan . v1 . yaml - - exp - dir exps / exp . lvcgan . v1 Die experimentellen Ergebnisse, einschließlich Trainingsprotokolle, Modell -Checkpoints und synthetisierten Audios, werden in den Ordnern exps/exp.lvcgan.v1/ gespeichert.

Ähnlich können Sie auch die configs/pwg.v1.yaml verwenden, um ein paralleles Wavegegan -Modell zu trainieren.

# training

python - m vocoder . train - - config configs / pwg . v1 . yaml - - exp - dir exps / exp . pwg . v1

# test

python - m vocoder . test - - config configs / pwg . v1 . yaml - - exp - dir exps / exp . pwg . v1 Verwenden Sie das Tensorboard, um den experimentellen Trainingsprozess anzuzeigen:

tensorboard --logdir exps

Audioproben werden in samples/ wo

samples/*_lvc.wav werden von LVCNET generiert,samples/*_pwg.wav werden durch paralleles Wavegan erzeugt,samples/*_real.wav sind das echte Audio. LVCNET: Effizientes konditionsabhängiges Modellierungsnetzwerk für die Wellenformgenerierung, https://arxiv.org/abs/2102.10815

MelGlow: Effizienter Wellenform generatives Netzwerk basierend auf Standort-Variable Faltung, https://arxiv.org/abs/2012.01684

https://github.com/kan-bayashi/parallelwavegan

https://github.com/lmnt-com/diffwave