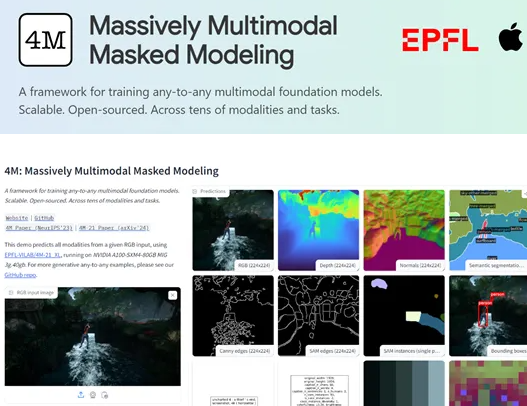

蘋果公司與瑞士洛桑聯邦理工學院(EPFL)攜手推出了一款名為4M-21的開源多模態視覺模型,這一合作標誌著人工智能領域的一次重大突破。 4M-21模型以其卓越的通用性和靈活性,成為多模態學習領域的一顆新星。儘管其參數規模僅為30億,遠小於一些主流的大型模型,但它卻能夠在圖像分類、目標檢測、語義分割、實例分割、深度估計、表面法線估計等數十種任務中展現出卓越的性能。

4M-21模型的核心創新在於其“離散tokens”轉換技術。這一技術能夠將來自不同模態的數據,如圖像、神經網絡特徵圖、向量、結構化數據以及文本等,統一轉換為模型可理解的tokens序列。這種轉換不僅簡化了模型的訓練過程,還為多模態數據的融合與處理提供了堅實的基礎。通過這一技術,4M-21能夠高效地處理多種數據類型,從而在多模態學習中展現出強大的能力。

在訓練過程中,4M-21採用了掩碼建模的方法。這種方法通過隨機遮蓋輸入序列中的部分tokens,並基於剩餘的tokens預測被遮蓋的部分,從而迫使模型學習輸入數據的統計結構和潛在關係。掩碼建模不僅提升了模型的泛化能力,還顯著提高了其在生成任務中的準確性。這種方法的應用,使得4M-21能夠在多模態學習中捕捉到不同模態間的信息共通性和交互性。

研究人員對4M-21進行了廣泛的評測,涵蓋了圖像分類、目標檢測、語義分割、實例分割、深度估計、表面法線估計以及3D人體姿態估計等多個任務。評測結果顯示,4M-21在這些任務中的表現與當前最先進的模型不相上下,甚至在某些任務中超越了現有的技術。這充分證明了4M-21在多模態處理方面的卓越能力。

劃重點:

- 蘋果與瑞士洛桑聯邦理工學院聯合開源了4M-21模型,該模型以其廣泛的通用性和靈活性成為多模態學習領域的重要成果。

- 4M-21能夠在圖像分類、目標檢測、語義分割、實例分割、深度估計、表面法線估計等數十種任務中表現出色。

- 4M-21的核心技術是“離散tokens”轉換,這一技術能夠將多種模態的數據統一轉換為模型可理解的tokens序列。