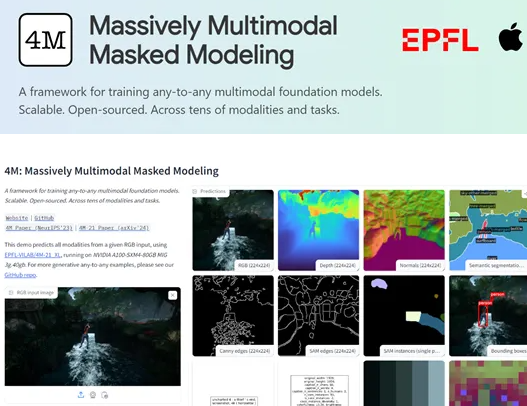

Apple und das Swiss Federal Institute of Technology (EPFL) haben gemeinsam ein multimodales Sehmodell mit dem Namen 4M-21 auf den Markt gebracht. Mit seiner hervorragenden Vielseitigkeit und Flexibilität ist das 4M-21-Modell zu einem neuen Stern im Bereich multimodaler Lernen geworden. Obwohl seine Parameterskala nur 3 Milliarden beträgt, weit kleiner als bei einigen Mainstream -großen Modellen, kann er bei Dutzenden von Aufgaben wie Bildklassifizierung, Objekterkennung, semantischer Segmentierung, Instanzsegmentierung, Tiefenschätzung, Oberflächennormalschätzung usw. hervorragend sein.

Die Kerninnovation des 4M-21-Modells liegt in seiner Conversion-Technologie "Discrete Tokens". Diese Technologie kann Daten aus verschiedenen Modi, wie Bildern, Merkmalen des neuronalen Netzwerks, Vektoren, strukturierten Daten und Text, in Token -Sequenzen, die vom Modell verständlich sind, einheitlich umwandeln. Diese Transformation vereinfacht nicht nur den Trainingsprozess des Modells, sondern bietet auch eine solide Grundlage für die Fusion und Verarbeitung multimodaler Daten. Durch diese Technologie kann der 4M-21 mehrere Datentypen effizient verarbeiten und so leistungsstarke Funktionen beim multimodalen Lernen aufweisen.

Während des Schulungsprozesses übernahm 4M-21 eine Maskenmodellierungsmethode. Diese Methode erzwingt das Modell, um die statistische Struktur und die potenzielle Beziehung der Eingabedaten zu erlernen, indem Teile der Token in der Eingabesequenz zufällig verkleinert und die verdeckten Teile basierend auf den verbleibenden Token vorhergesagt werden. Die Mask -Modellierung verbessert nicht nur die Generalisierungsfähigkeit des Modells, sondern verbessert auch die Genauigkeit in der Erzeugungsaufgabe signifikant. Die Anwendung dieser Methode ermöglicht es 4M-21, die Commonalität und Interaktion der Information zwischen verschiedenen Modi im multimodalen Lernen zu erfassen.

Die Forscher führten umfangreiche Bewertungen von 4M-21 durch und deckten mehrere Aufgaben wie Bildklassifizierung, Objekterkennung, semantische Segmentierung, Instanzsegmentierung, Tiefenschätzung, Oberflächennormalschätzung und 3D-Humanpose-Schätzung ab. Die Bewertungsergebnisse zeigen, dass der 4M-21 in diesen Aufgaben, die mit den aktuellen hochmodernen Modellen vergleichbar sind, durchgeführt werden, und übertrifft sogar vorhandene Technologien in einigen Aufgaben. Dies zeigt vollständig die herausragenden Fähigkeiten von 4M-21 in der multimodalen Verarbeitung.

Schlüsselpunkte:

- Apple und das Federal Institute of Technology in Lausanne, Schweiz, haben gemeinsam das 4M-21-Modell offen, das im Bereich des multimodalen Lernens mit seiner breiten Vielseitigkeit und Flexibilität zu einer wichtigen Errungenschaft geworden ist.

- 4M-21 kann in Dutzenden von Aufgaben wie Bildklassifizierung, Objekterkennung, semantischer Segmentierung, Instanzsegmentierung, Tiefenschätzung, Oberflächennormalschätzung usw. gut abschneiden.

- Die Kerntechnologie von 4M-21 ist die Konvertierung von "Discreten Token", die Daten aus mehreren Modalitäten in eine verständliche Token-Token-Sequenz umwandeln kann.