StyleSpeech

v1.0.2

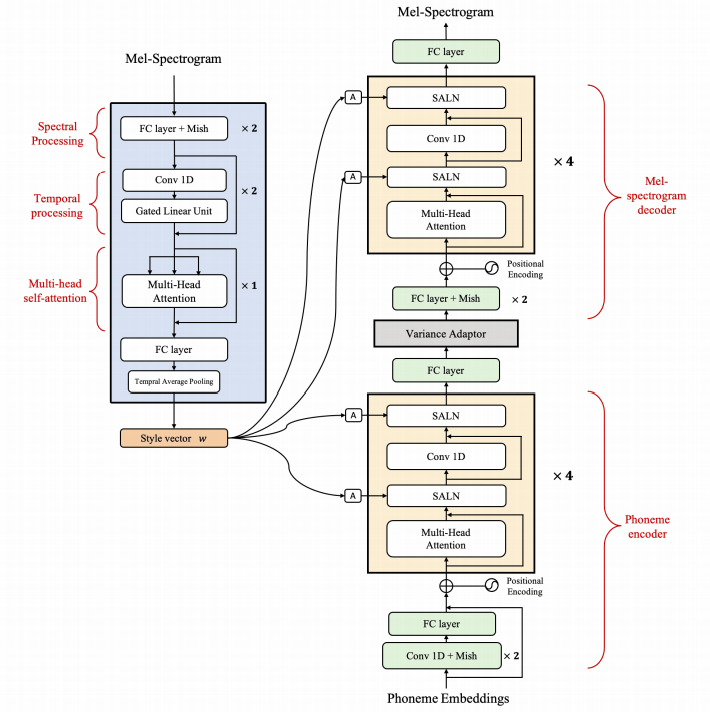

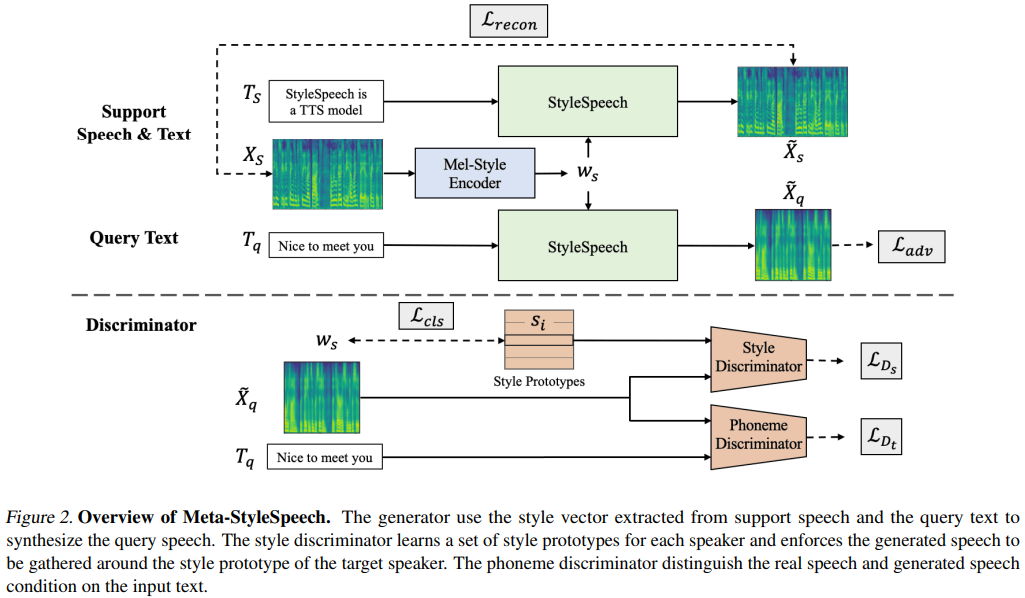

Meta-StylesPeech的Pytorch實現:多演講者自適應文本到語音的生成。

naive分支) main分支)您可以使用

pip3 install -r requirements.txt

您必須下載驗證的型號,並將其放入output/ckpt/LibriTTS_meta_learner/ 。

對於英語多演講者TTS,運行

python3 synthesize.py --text "YOUR_DESIRED_TEXT" --ref_audio path/to/reference_audio.wav --restore_step 200000 --mode single -p config/LibriTTS/preprocess.yaml -m config/LibriTTS/model.yaml -t config/LibriTTS/train.yaml

生成的話語將放入output/result/ 。您的綜合語音將具有ref_audio的風格。

也支持批次推理,嘗試

python3 synthesize.py --source preprocessed_data/LibriTTS/val.txt --restore_step 200000 --mode batch -p config/LibriTTS/preprocess.yaml -m config/LibriTTS/model.yaml -t config/LibriTTS/train.yaml

綜合preprocessed_data/LibriTTS/val.txt中的所有話語。這可以看作是驗證數據集的重建,以引用參考樣式。

可以通過指定所需的音高/能量/持續時間比來控制合成話語的音高/音量/口語速率。例如,一個人可以將語言率提高20%,並將數量減少20%

python3 synthesize.py --text "YOUR_DESIRED_TEXT" --restore_step 200000 --mode single -p config/LibriTTS/preprocess.yaml -m config/LibriTTS/model.yaml -t config/LibriTTS/train.yaml --duration_control 0.8 --energy_control 0.8

請注意,可控性源自FastSpeech2,而不是StylesPeech的重要利益。有關每個樣式因子的可控性,請參閱Styler [演示,代碼]。

支持的數據集是

跑步

python3 prepare_align.py config/LibriTTS/preprocess.yaml

用於一些準備工作。

對於強制對準,蒙特利爾強制對準器(MFA)用於獲得發音和音素序列之間的比對。此處提供了數據集的預提取對齊。您必須在preprocessed_data/LibriTTS/TextGrid/中解壓縮文件。或者,您可以自己運行對準器。

之後,通過

python3 preprocess.py config/LibriTTS/preprocess.yaml

培訓您的模型

python3 train.py -p config/LibriTTS/preprocess.yaml -m config/LibriTTS/model.yaml -t config/LibriTTS/train.yaml

如本文所述,該腳本將從預先培訓幼稚的模型開始,直到meta_learning_warmup步驟,然後通過情節培訓進行元模型以進行其他步驟。

使用

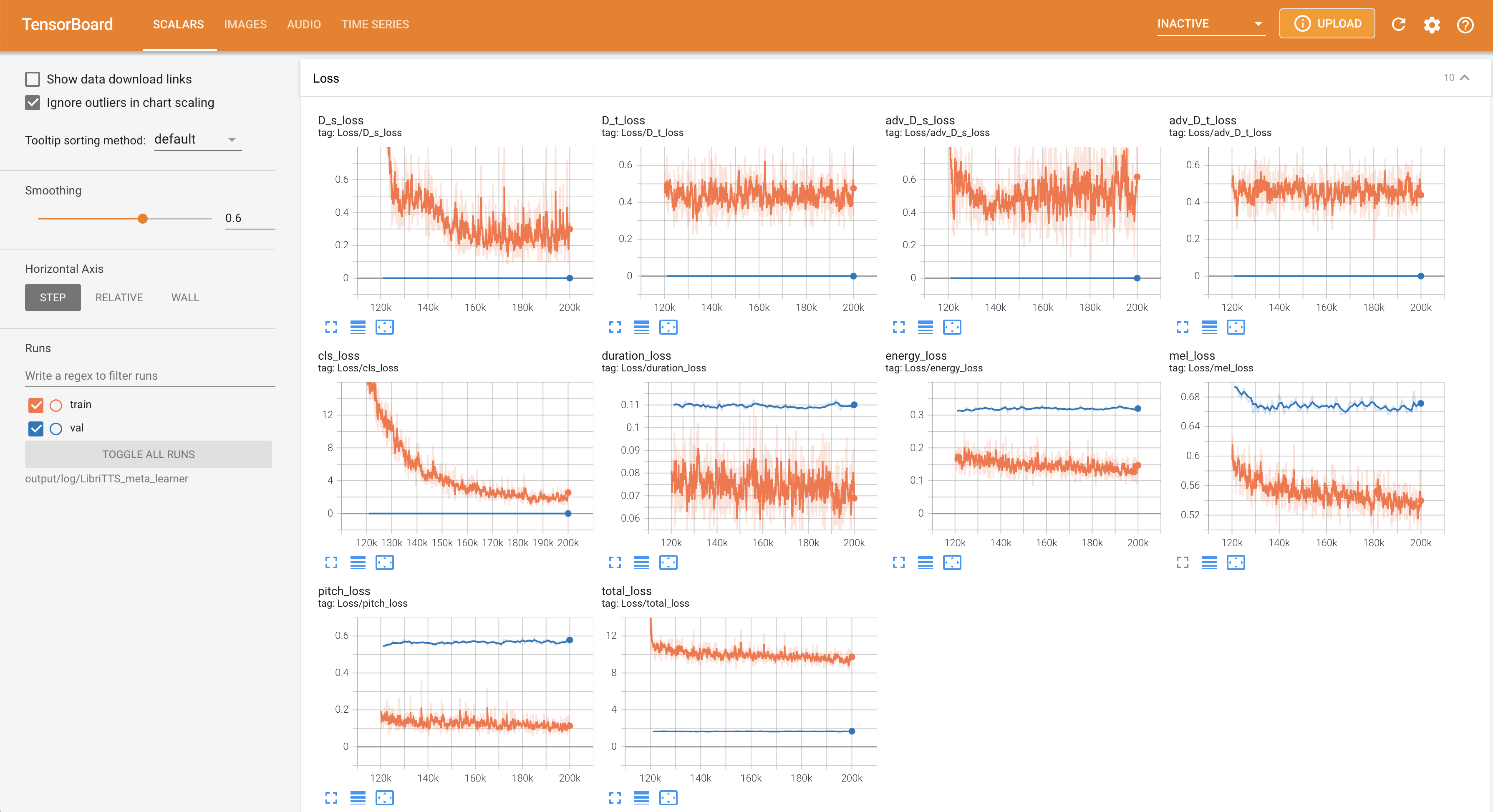

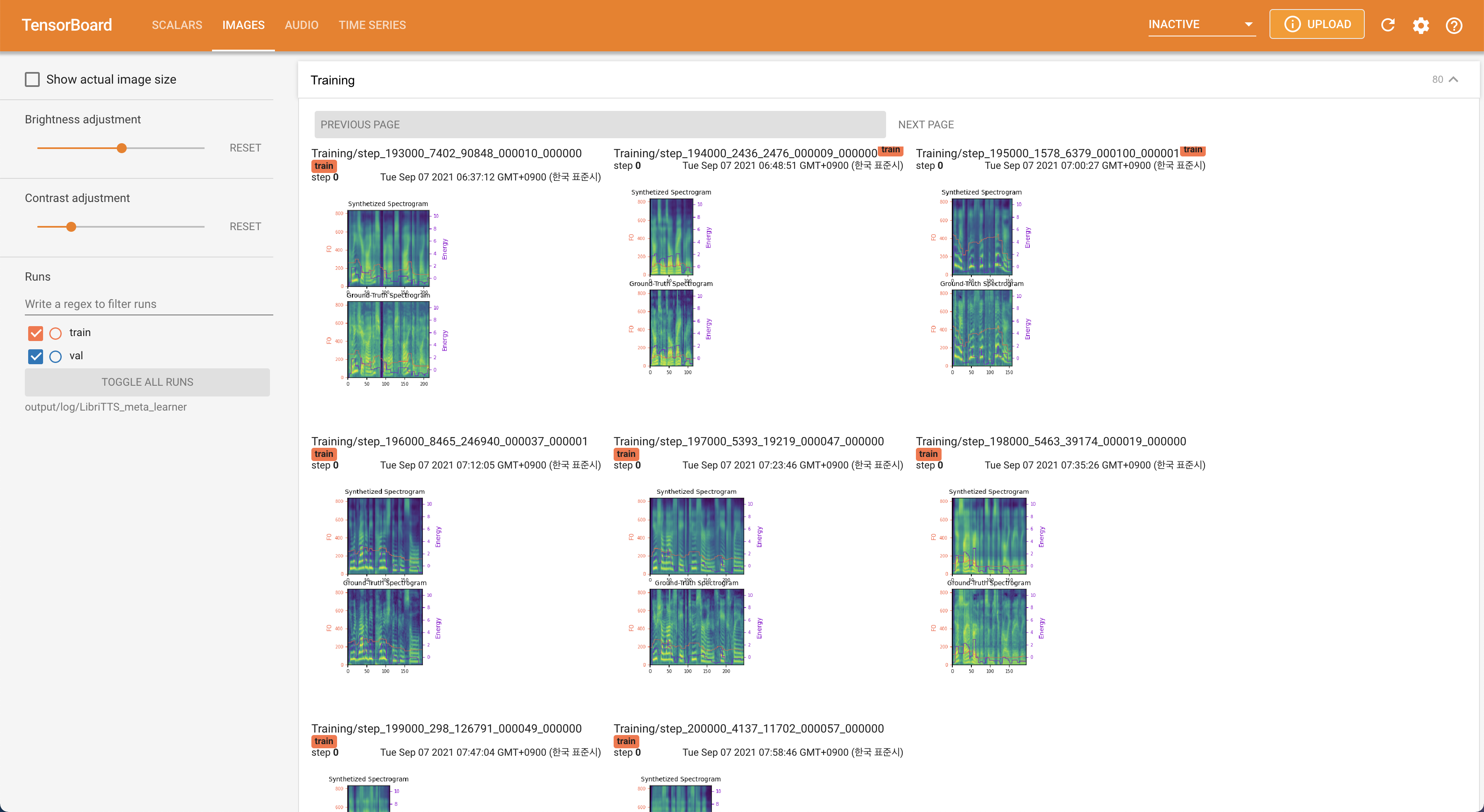

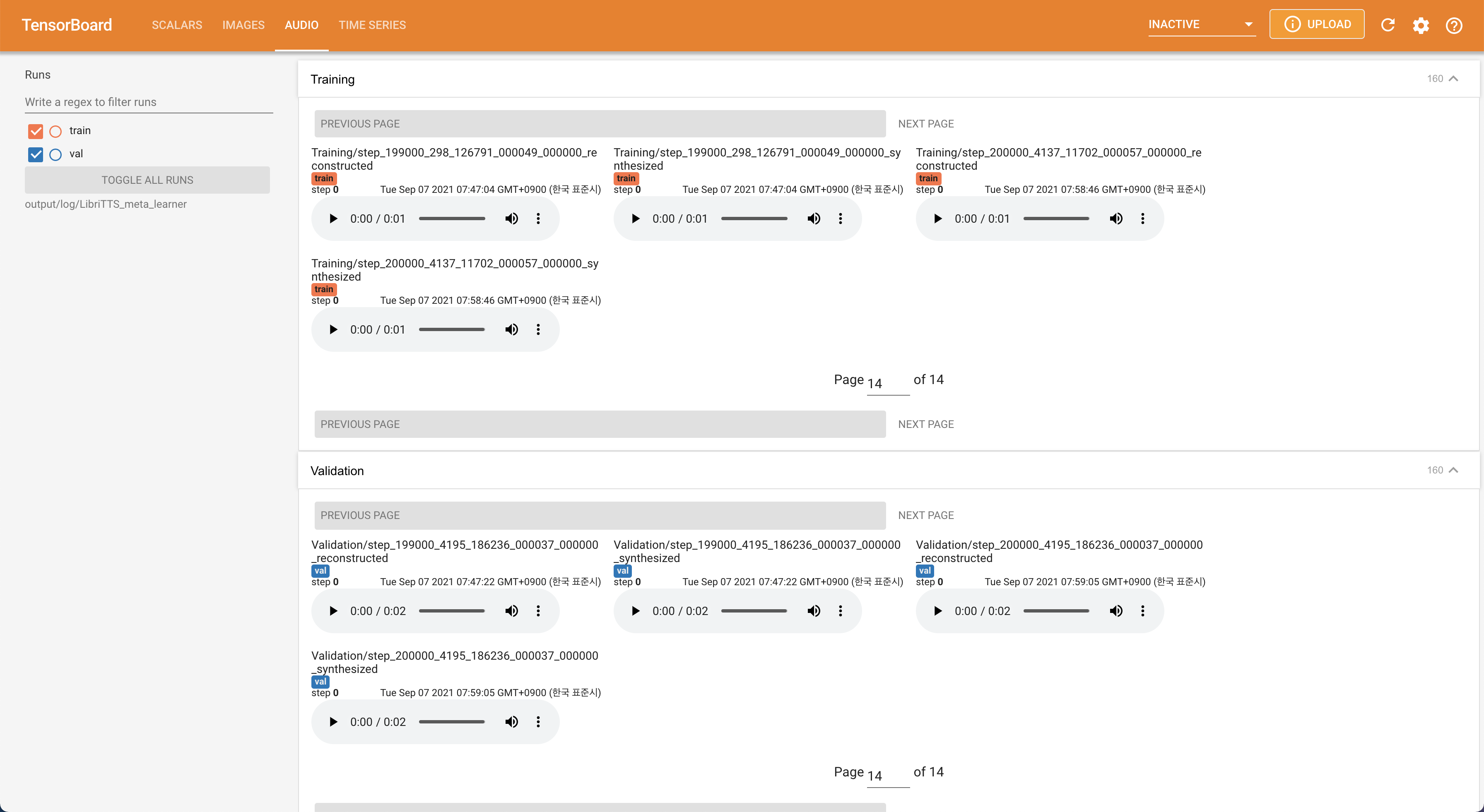

tensorboard --logdir output/log/LibriTTS

在您的本地主機上提供張板。顯示了損耗曲線,合成的MEL光譜圖和音頻。

22050Hz採樣率,而不是16kHz 。80到128 Uplample輸入MEL-SPECTROGRAM。28.197M 。16批量的大小,而不是48或20這主要是由於單個24GIB TITAN-RTX缺乏記憶能力。這可以通過以下腳本來實現,以比max_seq_len過濾更長的數據: python3 filelist_filtering.py -p config/LibriTTS/preprocess.yaml -m config/LibriTTS/model.yaml

train.txt的同一位置生成train_filtered.txt 。 @misc{lee2021stylespeech,

author = {Lee, Keon},

title = {StyleSpeech},

year = {2021},

publisher = {GitHub},

journal = {GitHub repository},

howpublished = {url{https://github.com/keonlee9420/StyleSpeech}}

}