ragapp

v0.1.5

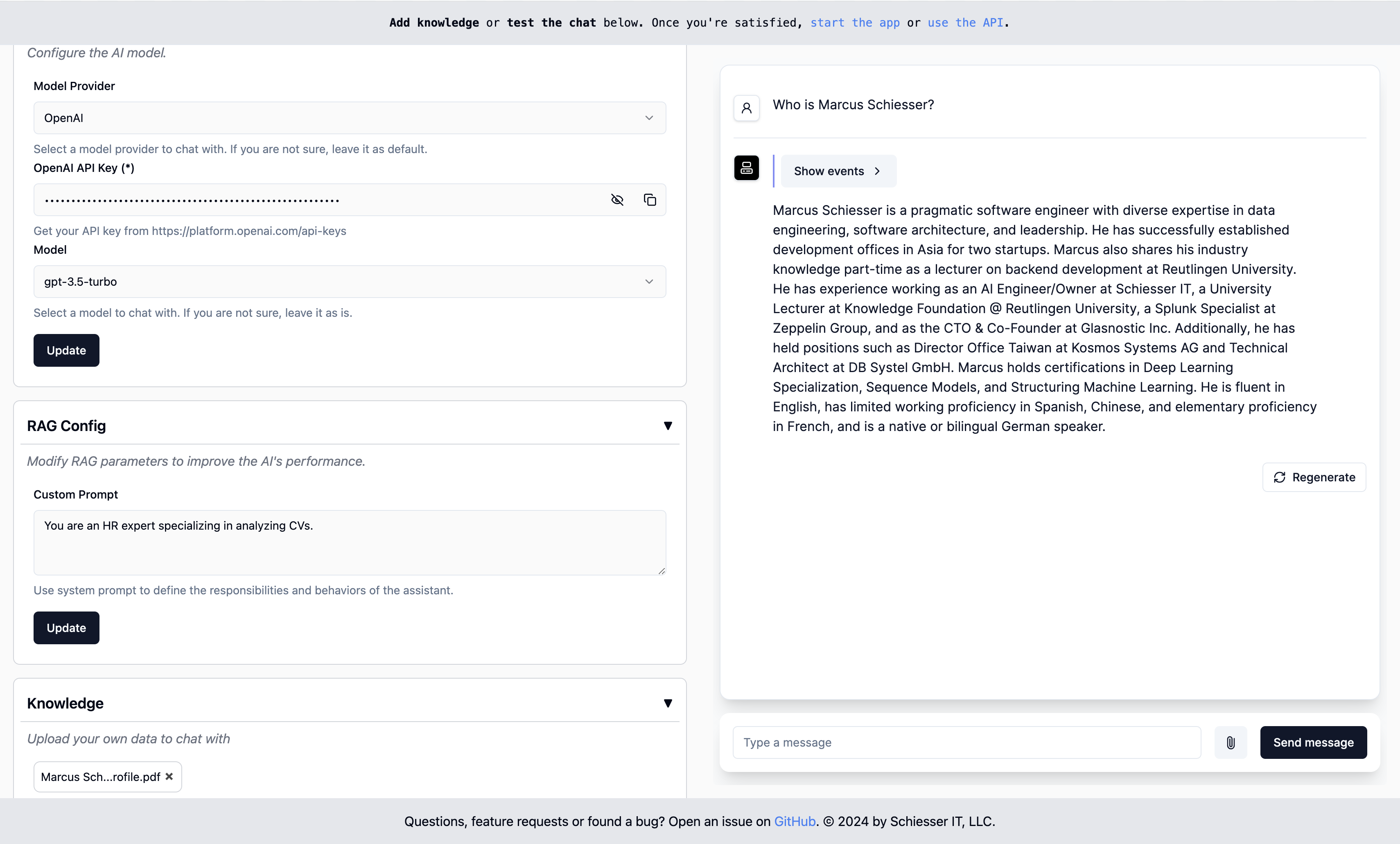

在任何企業中使用代理抹布的最簡單方法。

易於配置為OpenAI的自定義GPT,但可以在您自己的雲基礎架構中使用Docker部署。使用LlamainDex建造。

入門·端點·部署·聯繫人

要運行,請使用我們的圖像啟動Docker容器:

docker run -p 8000:8000 ragapp/ragapp然後,通過http:// localhost訪問管理UI:8000/admin配置您的ragapp。

您可以使用OpenAI或Gemini的託管AI型號以及使用Ollama的本地模型。

注意:要避免遇到任何錯誤,我們建議使用最新版本的Docker和(如果需要)Docker組成。

Docker容器公開以下端點:

注意:僅在配置ragapp時,CHAT UI和API才起作用。

只是ragapp容器不帶設計任何身份驗證層。這是API網關將流量路由到Ragapp的任務。此步驟在很大程度上取決於您的雲提供商和您使用的服務。對於純的Docker組成環境,您可以通過管理UI部署來查看我們的Ragapp。

Ragapp的後期版本將支持基於從API網關轉發或類似的訪問令牌的限制訪問。

您可以通過其中一種docker組成的部署來輕鬆地將ragapp部署到自己的基礎架構上:

在您自己的雲基礎架構中部署Ragapp很容易。定制的K8部署描述符即將推出。

重要的是:該項目源代碼的一部分是從創建式項目中動態檢索的。在進行更改之前,請確保通過調用

make build-frontends來更新源代碼。

移動到SRC/RAGAPP目錄,然後從這些命令開始:

export ENVIRONMENT=dev

poetry install --no-root

make build-frontends

make dev然後,要查看Admin UI,請訪問http:// localhost:3000/admin。

注意:確保安裝了詩歌。

問題,功能請求還是找到錯誤?打開問題或與Marcusschiesser接觸。