此工具使您可以使用一键单击!

16GB RAM。12GB VRAM的GPU。pytorch安装命令:

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu117 CUDA 11.7安装: https://developer.nvidia.com/cuda-11-7-0-download-archive

zlib dll安装: https://docs.nvidia.com/deeplearning/cudnn/install-guide/index.html#install-zlib-windows

手动安装pyopenjtalk: pip install -U pyopenjtalk --no-build-isolation

conda create -n one-click-vits python=3.8conda activate one-click-vitsgit clone https://github.com/ORI-Muchim/One-Click-VITS-Training.git cd One-Click-VITS-Trainingpip install -r requirements.txt将音频文件如下。

.mp3或.wav文件还可以。

One-Click-VITS-Training

├────datasets

│ ├───speaker0

│ │ ├────1.mp3

│ │ └────1.wav

│ └───speaker1

│ │ ├───1.mp3

│ │ └───1.wav

│ ├integral.py

│ └integral_low.py

│

├────vits

├────inference.py

├────main_low.py

├────main_resume.py

├────main.py

├────Readme.md

└────requirements.txt

这只是一个例子,可以添加更多扬声器。

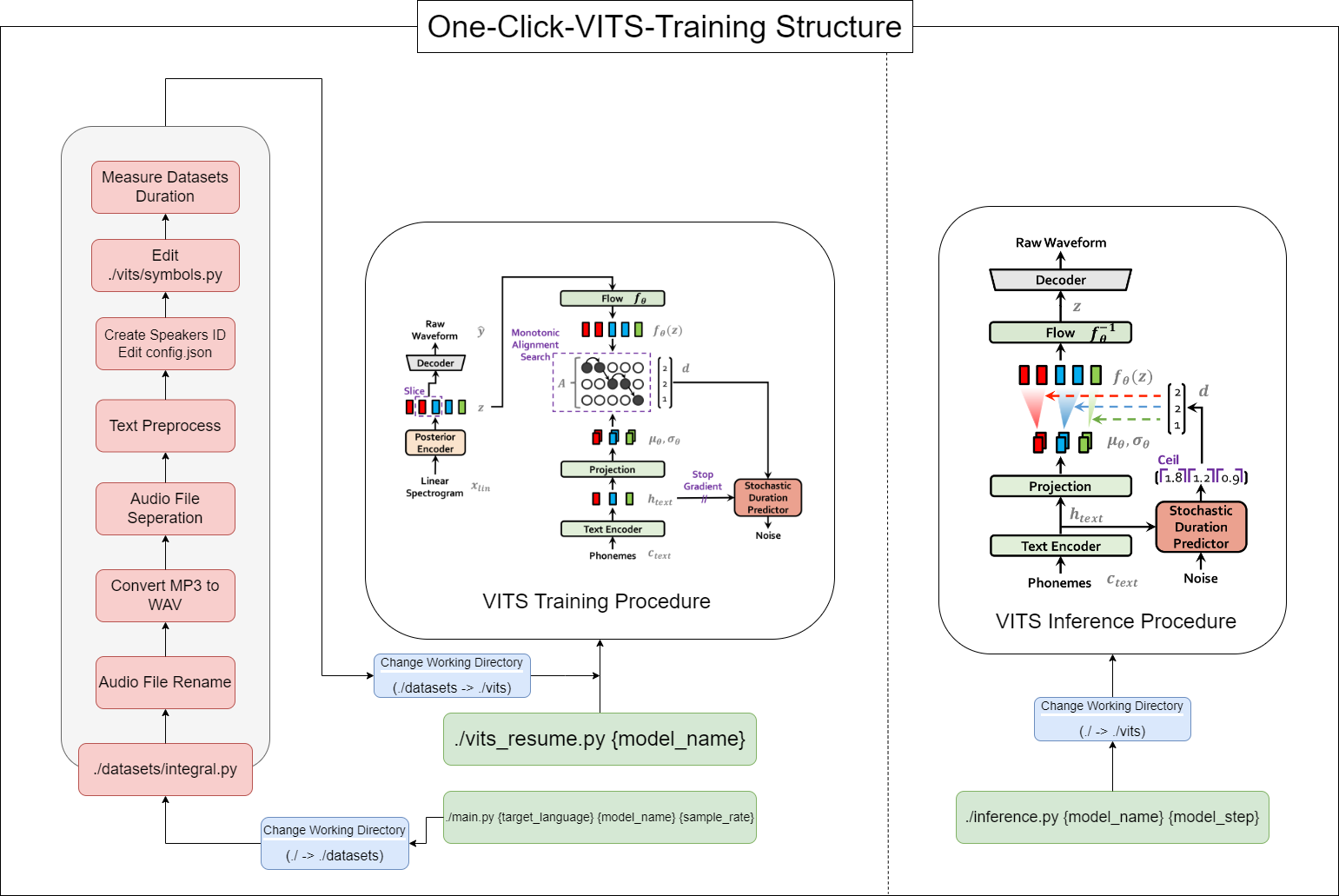

要启动此工具,请使用以下命令,替换{language},{model_name}和{sample_rate}的{sample_rate}使用您的值({language:ko,ja,en,en,zh} / {sample_rate:22050 /44100}):

python main.py {language} {model_name} {sample_rate}对于规格低的人(VRAM <12GB),请使用此代码:

python main_low.py {language} {model_name} {sample_rate}如果数据配置已完成并且要恢复培训,请输入此代码:

python main_resume.py {model_name}训练模型后,您可以使用以下命令来生成预测,以{model_name}和{model_step}的范围用相应的值替换:

python inference.py {model_name} {model_step}或检查./vits/inference.ipynb。

如果要更改参考中使用的示例文本,请修改./vits/inferencems.py text部分。

在cjangcjengh/vits的存储库中,我对韩国文本清洁方法进行了一些修改。通过将其发布到cjangcjengh存储库中,另一个清洁过程是相同的,但是使用Tenebo/g2pk2库修改了清洁剂文件,以韩语发音。

有关更多信息,请参阅以下存储库: