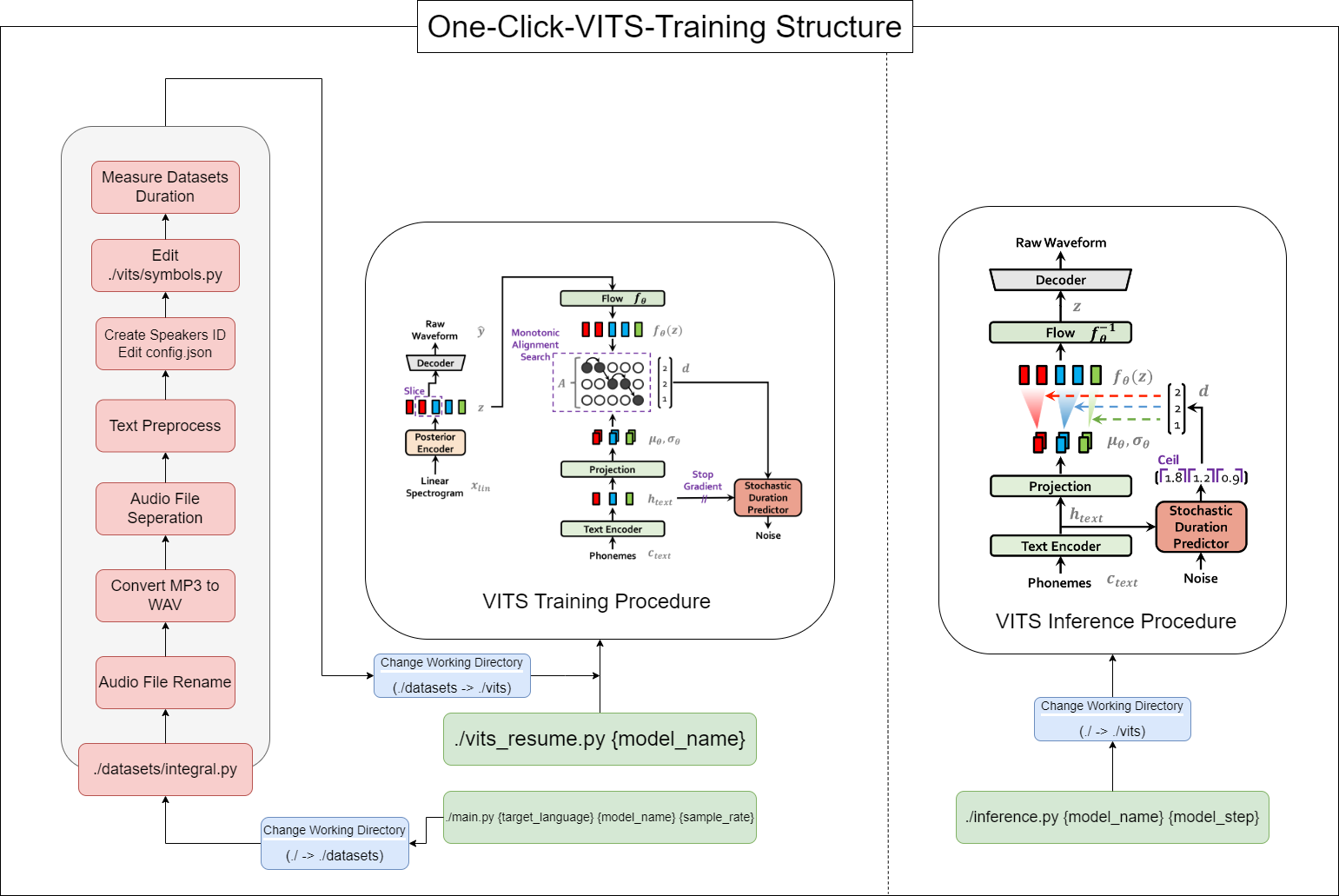

Этот инструмент позволяет вам завершить весь процесс VIT (предварительная обработка данных + Whisper ASR + Текстовая предварительная обработка + модификация config.json + обучение, вывод) с одним щелчком!

16GB оперативной памяти.12GB VRAM.Команда установки Pytorch:

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu117 Cuda 11.7 Установка: https://developer.nvidia.com/cuda-11-7-0-download-archive

Zlib DLL Установка: https://docs.nvidia.com/deeplearning/cudnn/install-guide/index.html#install-zlib-windows

Установите Pyopenjtalk вручную: pip install -U pyopenjtalk --no-build-isolation

conda create -n one-click-vits python=3.8conda activate one-click-vitsgit clone https://github.com/ORI-Muchim/One-Click-VITS-Training.git cd One-Click-VITS-Trainingpip install -r requirements.txtПоместите аудиофайлы следующим образом.

.mp3 или .wav файлы в порядке.

One-Click-VITS-Training

├────datasets

│ ├───speaker0

│ │ ├────1.mp3

│ │ └────1.wav

│ └───speaker1

│ │ ├───1.mp3

│ │ └───1.wav

│ ├integral.py

│ └integral_low.py

│

├────vits

├────inference.py

├────main_low.py

├────main_resume.py

├────main.py

├────Readme.md

└────requirements.txt

Это всего лишь пример, и можно добавить больше динамиков.

Чтобы запустить этот инструмент, используйте следующую команду, заменив {language}, {model_name} и {sample_rate} на ваши соответствующие значения ({язык: ko, ja, en, zh} / {sample_rate: 22050 /44100}):

python main.py {language} {model_name} {sample_rate}Для тех, у кого низкие спецификации (VRAM <12GB), используйте этот код:

python main_low.py {language} {model_name} {sample_rate}Если конфигурация данных завершена, и вы хотите возобновить обучение, введите этот код:

python main_resume.py {model_name}После обучения модели вы можете генерировать прогнозы, используя следующую команду, заменив {model_name} и {model_step} с вашими соответствующими значениями:

python inference.py {model_name} {model_step}Или проверить ./vits/infere.ipynb.

Если вы хотите изменить пример текста, используемый в ссылке, измените text часть ./vits/inferencems.py .

В репозитории Cjangcjengh/Vits я внес некоторые изменения в корейский метод очистки текста. Другой процесс очистки одинаковы, опубликовав его в репозиторий Cjangcjengh, но файл более чистоты был изменен с использованием библиотеки Tenebo/G2PK2 в качестве корейского.

Для получения дополнительной информации, пожалуйста, обратитесь к следующим репозиториям: