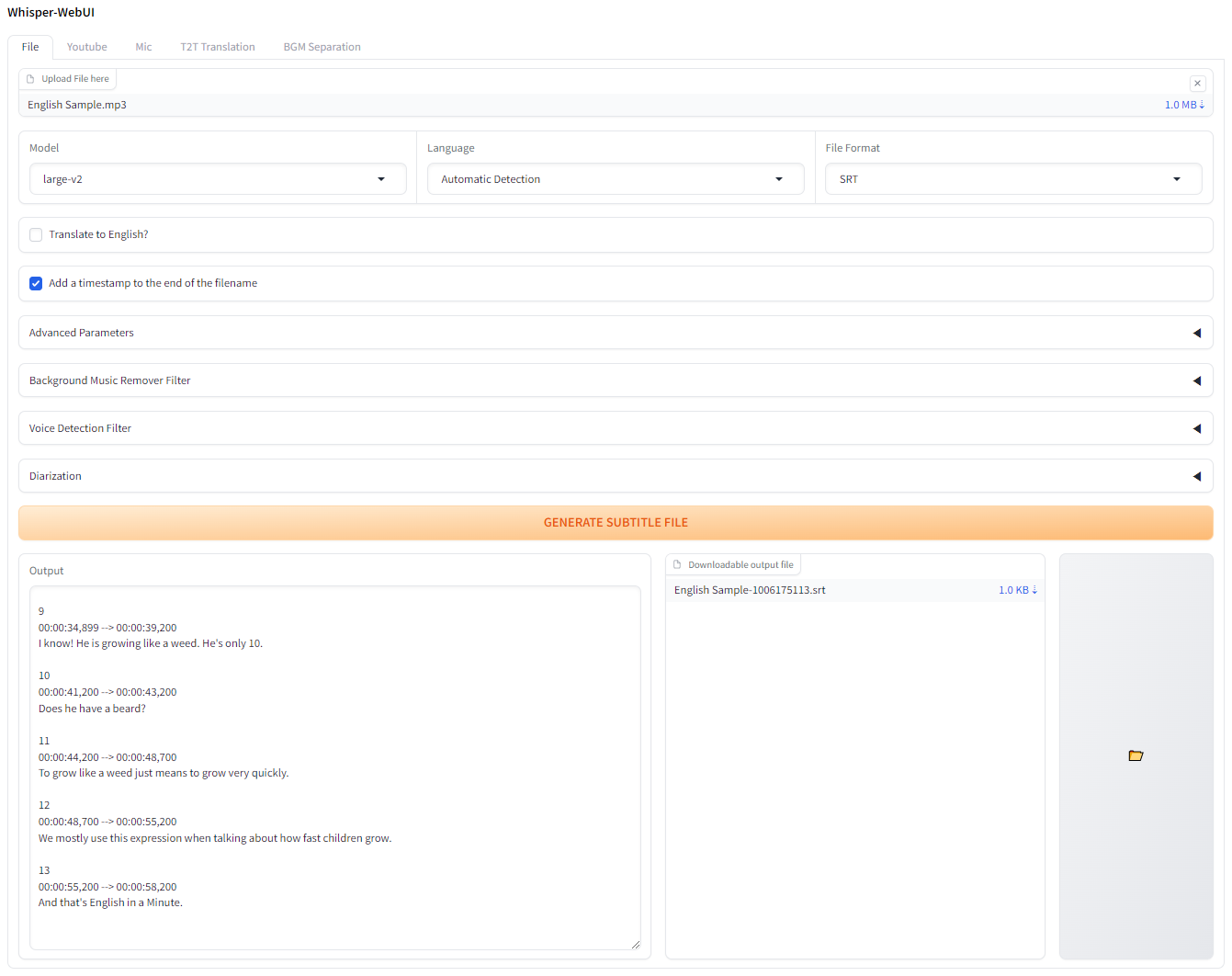

Whisper WebUI

1.0.0

低语的基于Gradio的浏览器界面。您可以将其用作简单的字幕生成器!

如果您想在Colab上尝试此操作,可以在这里进行!

该应用程序可以使用Pinokio运行。

http://localhost:7860 。 安装和启动Docker-Desktop。

git克隆存储库

git clone https://github.com/jhj0517/Whisper-WebUI.gitdocker compose build docker compose uphttp://localhost:7860连接到WebUI如果需要,请更新docker-compose.yaml以匹配您的环境。

要运行此WebUI,您需要拥有git , 3.10 <= python <= 3.12 , FFmpeg 。

而且,如果您不使用NVIDA GPU,或者使用与12.4的CUDA版本不同,请编辑requirements.txt以匹配您的环境。

请按照以下链接安装必要的软件:

3.10 ~ 3.12 。安装FFMPEG后,请确保将FFmpeg/bin文件夹添加到您的系统路径!

git clone https://github.com/jhj0517/Whisper-WebUI.gitinstall.bat或install.sh以安装依赖项。 (它将创建一个venv目录并在那里安装依赖项。)start-webui.bat或start-webui.sh启动webui(激活VENV后将运行python app.py )而且,如果您愿意,您还可以使用命令行参数运行该项目,请参阅Wiki以获取参数指南。

默认情况下,该项目与更快的呼声集成在一起,以更好地使用VRAM和转录速度。

根据更快的呼声,优化的耳语模型的效率如下:

| 执行 | 精确 | 梁尺寸 | 时间 | 最大限度。 GPU内存 | 最大限度。 CPU内存 |

|---|---|---|---|---|---|

| Openai/窃窃私语 | FP16 | 5 | 4M30S | 11325MB | 9439MB |

| 更快的呼声 | FP16 | 5 | 54 | 4755MB | 3244MB |

如果要使用更快的旋转速度以外的实现,请使用--whisper_type arg和存储库名称。

阅读Wiki以获取有关CLI ARGS的更多信息。

这是Whisper的原始VRAM使用表用于模型。

| 尺寸 | 参数 | 仅英语模型 | 多语言模型 | 需要VRAM | 相对速度 |

|---|---|---|---|---|---|

| 微小的 | 39 m | tiny.en | tiny | 〜1 GB | 〜32X |

| 根据 | 74 m | base.en | base | 〜1 GB | 〜16x |

| 小的 | 244 m | small.en | small | 〜2 GB | 〜6x |

| 中等的 | 769 m | medium.en | medium | 〜5 GB | 〜2x |

| 大的 | 1550 m | N/A。 | large | 〜10 GB | 1倍 |

.en Translate to English

任何将语言翻译成翻译的PR。YAML将不胜感激!