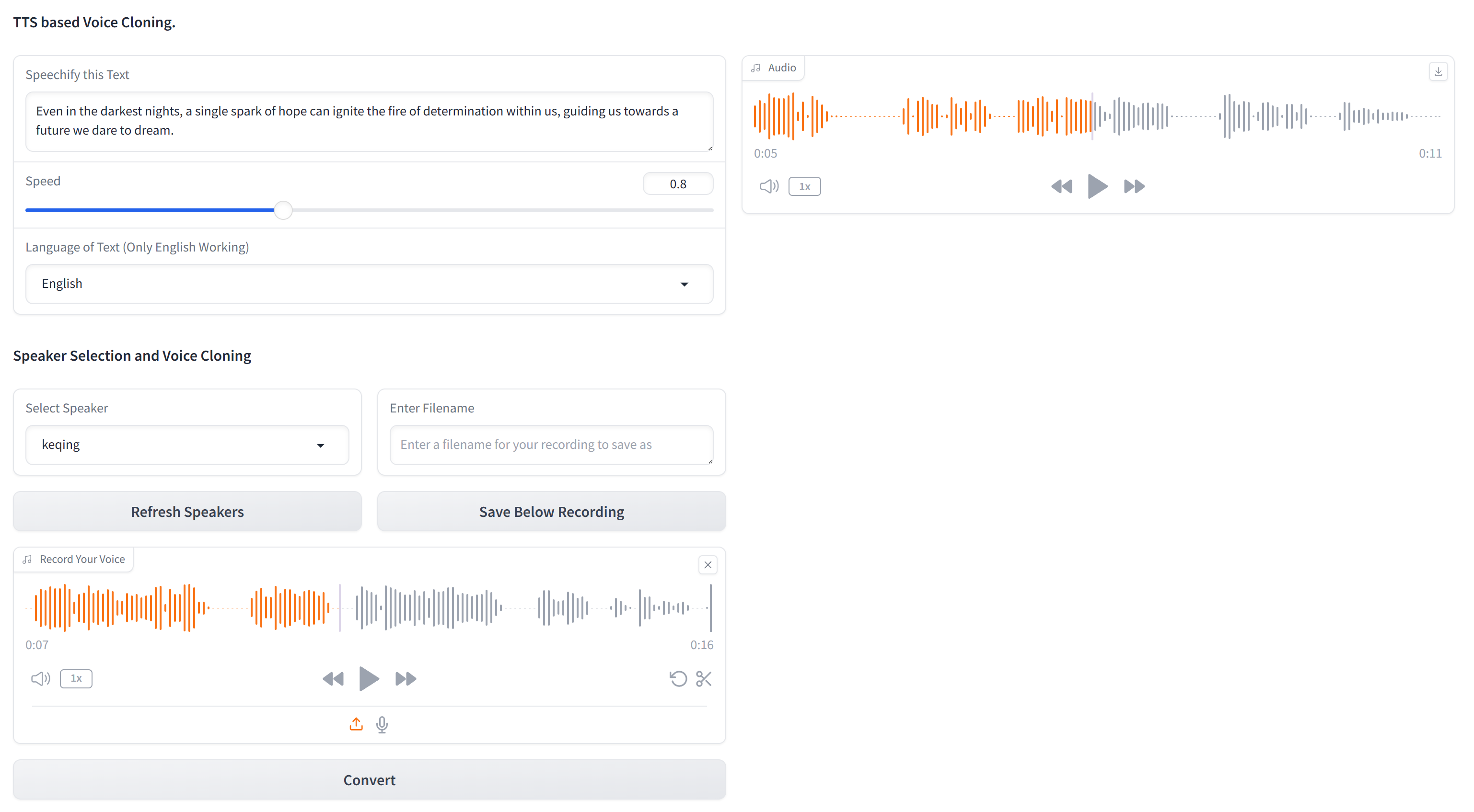

ที่เก็บนี้มีรหัสสำคัญสำหรับการโคลนเสียงใด ๆ โดยใช้ข้อความเพียงแค่ข้อความและตัวอย่างเสียง 10 วินาทีของเสียงเป้าหมาย XTTS-2-UI นั้นง่ายต่อการตั้งค่าและใช้งาน ตัวอย่างผลลัพธ์?

ทำงานใน 16 ภาษาและมีการบันทึกเสียง/อัพโหลดในตัว หมายเหตุ: อย่าคาดหวังคุณภาพระดับเอลมันยังไม่มี

โมเดลที่ใช้คือ tts_models/multilingual/multi-dataset/xtts_v2 สำหรับรายละเอียดเพิ่มเติมโปรดดูที่ Hugging Face-XTTS-V2 และเวอร์ชันเฉพาะ XTTS-V2 เวอร์ชัน 2.0.2

ในการตั้งค่าโครงการนี้ให้ทำตามขั้นตอนเหล่านี้ในเทอร์มินัล:

โคลนที่เก็บ

git clone https://github.com/pbanuru/xtts2-ui.git

cd xtts2-uiสร้างสภาพแวดล้อมเสมือนจริง:

python -m venv venvWindows:

# cmd prompt

venv S cripts a ctivateหรือ

# git bash

source venv/Scripts/activateLinux/Mac:

source venv/bin/activateติดตั้ง pytorch:

nvcc --versionpip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118ติดตั้งแพ็คเกจอื่น ๆ ที่จำเป็น:

pip install -r requirements.txtpip install --upgrade TTSหลังจากทำตามขั้นตอนเหล่านี้เสร็จสิ้นการตั้งค่าของคุณควรจะเสร็จสมบูรณ์และคุณสามารถเริ่มใช้โครงการได้

รุ่นจะถูกดาวน์โหลดโดยอัตโนมัติเมื่อใช้งานครั้งแรก

ดาวน์โหลดเส้นทาง:

/Users/USR/Library/Application Support/tts/tts_models--multilingual--multi-dataset--xtts_v2C:Users YOUR-USER-ACCOUNT AppDataLocalttstts_models--multilingual--multi-dataset--xtts_v2/home/${USER}/.local/share/tts/tts_models--multilingual--multi-dataset--xtts_v2 /share/tts/tts_models-ภาษาหลายภาษา ----multi-dataset-xtts_v2 เพื่อเรียกใช้แอปพลิเคชัน:

python app.py

OR

streamlit run app2.py

หรือคุณสามารถเรียกใช้จากเทอร์มินัลเองโดยการจัดทำข้อความอินพุตตัวอย่างบนข้อความ json และสร้างเสียงหลายตัวด้วยลำโพงหลายตัว (คุณอาจต้องปรับ appterminal.py)

python appTerminal.py

ในการใช้งานครั้งแรกคุณจะต้องยอมรับข้อกำหนด:

[XTTS] Loading XTTS...

> tts_models/multilingual/multi-dataset/xtts_v2 has been updated, clearing model cache...

> You must agree to the terms of service to use this model.

| > Please see the terms of service at https://coqui.ai/cpml.txt

| > "I have read, understood and agreed to the Terms and Conditions." - [y/n]

| | >

หากโมเดลของคุณกำลังโหลดซ้ำการทำงานแต่ละครั้งโปรดปรึกษาปัญหา 4723 บน GitHub

ชุดข้อมูลประกอบด้วยโฟลเดอร์เดียวชื่อ targets ซึ่งเติมเต็มด้วยเสียงหลายเสียงเพื่อการทดสอบ

หากต้องการเพิ่มเสียงเพิ่มเติม (หากคุณไม่ต้องการผ่าน GUI) ให้สร้างไฟล์ WAV 24KHz WAV ประมาณ 10 วินาทีและวางไว้ใต้โฟลเดอร์ targets คุณสามารถใช้ YT-DLP เพื่อดาวน์โหลดเสียงจาก YouTube สำหรับการโคลนนิ่ง:

yt-dlp -x --audio-format wav "https://www.youtube.com/watch?"

| ภาษา | ลิงค์ตัวอย่างเสียง |

|---|---|

| ภาษาอังกฤษ | |

| ชาวรัสเซีย | |

| ภาษาอาหรับ |

ภาษาอาหรับ, จีน, เช็ก, ดัตช์, อังกฤษ, ฝรั่งเศส, เยอรมัน, ฮังการี, อิตาลี, ญี่ปุ่น (ดูการตั้งค่า), เกาหลี, โปแลนด์, โปรตุเกส, รัสเซีย, สเปน, ตุรกี, ตุรกี

หากคุณต้องการเลือก ภาษาญี่ปุ่น เป็นภาษาเป้าหมายคุณต้องติดตั้งพจนานุกรม

# Lite version

pip install fugashi[unidic-lite]หรือสำหรับการประมวลผลที่จริงจังมากขึ้น:

# Full version

pip install fugashi[unidic]

python -m unidic downloadรายละเอียดเพิ่มเติมที่นี่