หม้อแปลงวิสัยทัศน์แบบลำดับชั้นที่ทรงพลังขึ้นอยู่กับความสนใจของหน้าต่างบานเลื่อน

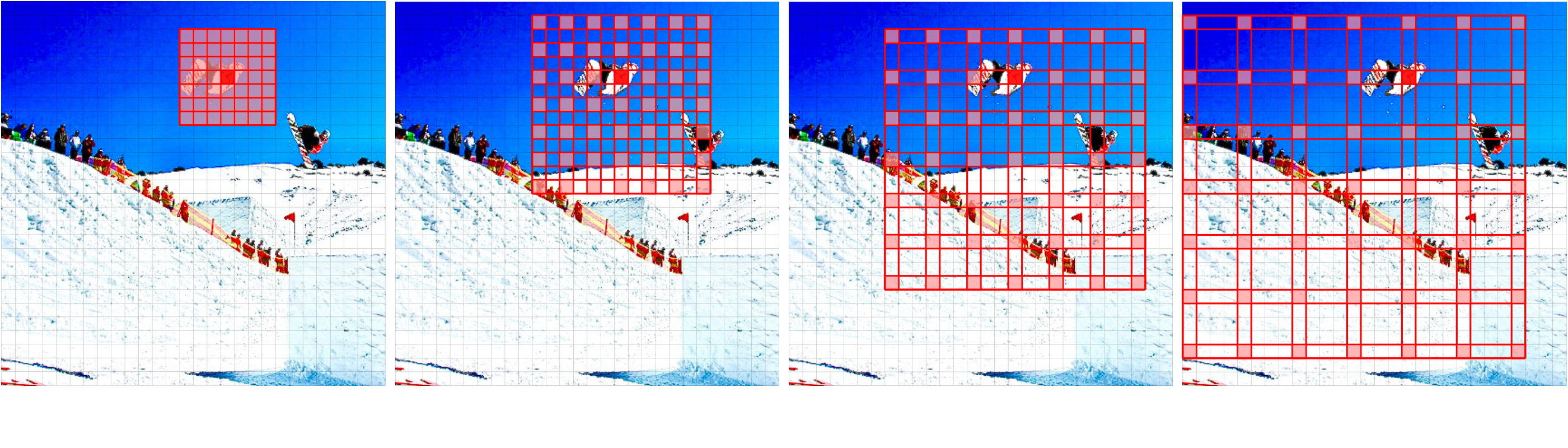

ความสนใจในละแวกใกล้เคียง (NA, ความสนใจในท้องถิ่น) ได้รับการแนะนำในบทความต้นฉบับของเรา NAT และทำงานอย่างมีประสิทธิภาพด้วยการขยายของเราไปยัง Pytorch, Natten

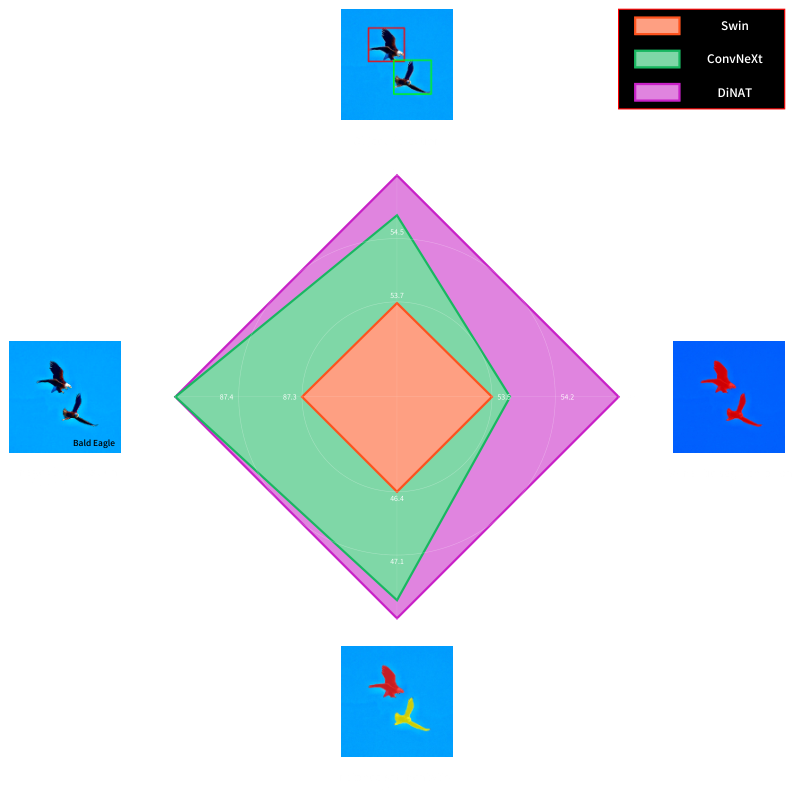

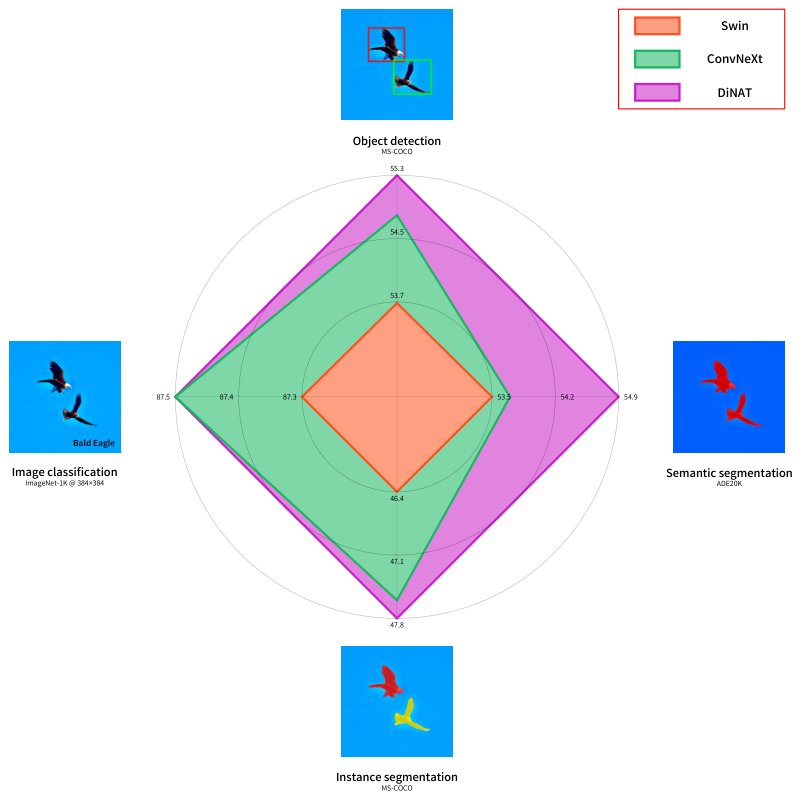

เมื่อเร็ว ๆ นี้เราได้เปิดตัวโมเดลใหม่ Dinat ซึ่งขยาย NA โดยการขยายพื้นที่ใกล้เคียง (Dina, กระจัดกระจายความสนใจระดับโลกหรือที่รู้จักกันในนามความสนใจในท้องถิ่น)

การรวมกันของ Na/Dina มีความสามารถในการรักษาสถานที่รักษาความเท่าเทียมกันในการแปลการขยายสนามที่เปิดกว้างทวีคูณและการจับภาพระหว่างระยะยาวซึ่งนำไปสู่การเพิ่มประสิทธิภาพที่สำคัญในงานวิสัยทัศน์ดาวน์สตรีมเช่น stylenat สำหรับการสร้างภาพ

หม้อแปลงวิสัยทัศน์แบบลำดับชั้นใหม่ขึ้นอยู่กับความสนใจในพื้นที่ใกล้เคียง (ความสนใจในท้องถิ่น) และความสนใจในละแวกใกล้เคียงที่ขยายตัว (ความสนใจทั่วโลกที่กระจัดกระจาย) ซึ่งมีความสุขในการเพิ่มประสิทธิภาพอย่างมากในงานดาวน์สตรีม

ตรวจสอบ Dinat Readme

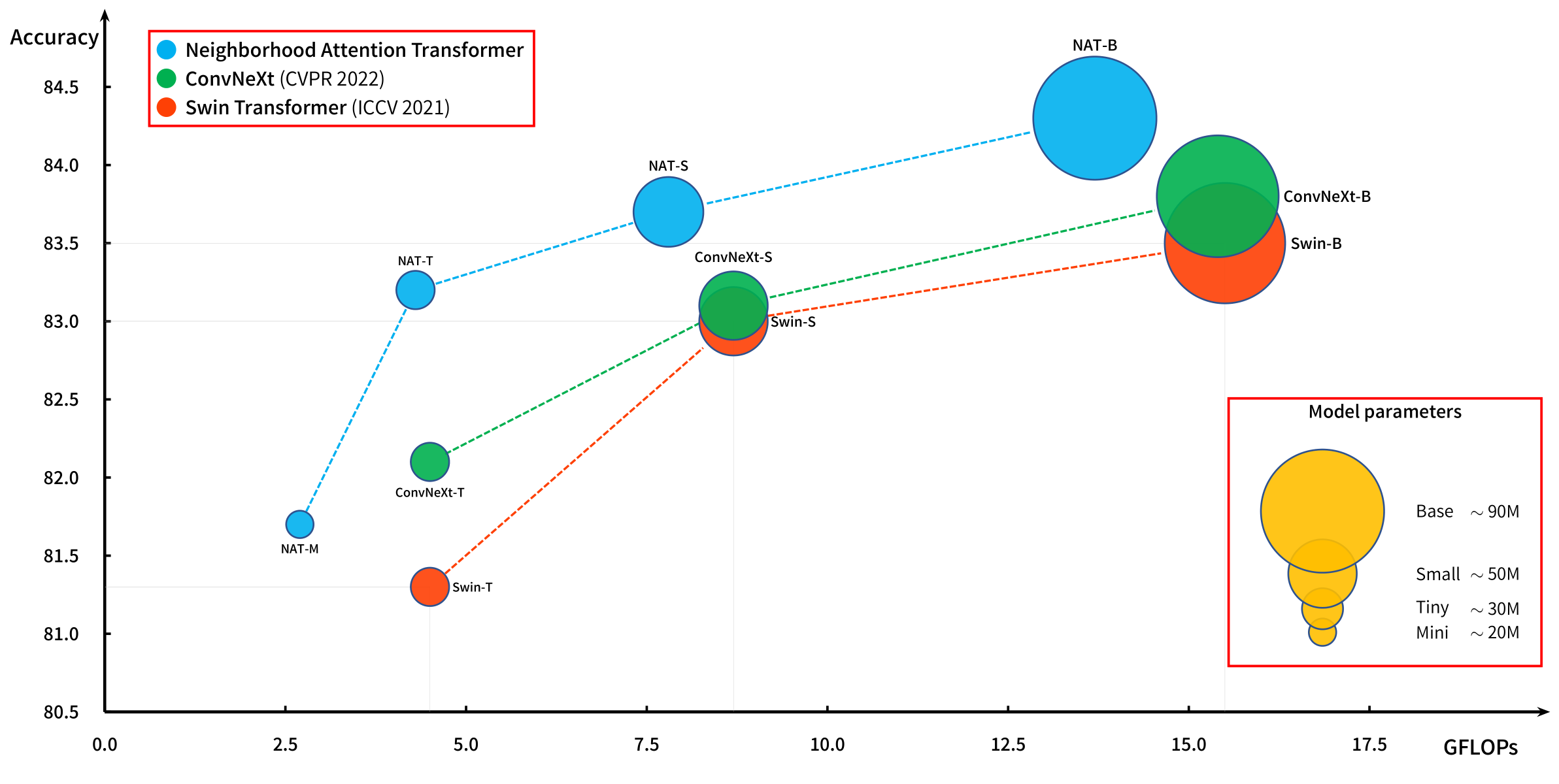

กระดาษต้นฉบับของเราหม้อแปลงความสนใจในละแวกใกล้เคียง (NAT) ซึ่งเป็นความสนใจในท้องถิ่นแบบเลื่อนที่มีประสิทธิภาพครั้งแรก

ความสนใจในละแวกใกล้เคียง จำกัด การค้นหาโทเค็น (สีแดง) ที่เปิดกว้างไปยังโทเค็นใกล้เคียงที่ใกล้ที่สุดในคู่คีย์-ค่า (สีเขียว) สิ่งนี้เทียบเท่ากับความสนใจของตัวเอง Dot-Product เมื่อขนาดใกล้เคียงเหมือนกับขนาดของภาพ โปรดทราบว่าขอบเป็นกรณีพิเศษ (ขอบ)

@inproceedings { hassani2023neighborhood ,

title = { Neighborhood Attention Transformer } ,

author = { Ali Hassani and Steven Walton and Jiachen Li and Shen Li and Humphrey Shi } ,

booktitle = { Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) } ,

month = { June } ,

year = { 2023 } ,

pages = { 6185-6194 }

}

@article { hassani2022dilated ,

title = { Dilated Neighborhood Attention Transformer } ,

author = { Ali Hassani and Humphrey Shi } ,

year = 2022 ,

url = { https://arxiv.org/abs/2209.15001 } ,

eprint = { 2209.15001 } ,

archiveprefix = { arXiv } ,

primaryclass = { cs.CV }

}

@article { walton2022stylenat ,

title = { StyleNAT: Giving Each Head a New Perspective } ,

author = { Steven Walton and Ali Hassani and Xingqian Xu and Zhangyang Wang and Humphrey Shi } ,

year = 2022 ,

url = { https://arxiv.org/abs/2211.05770 } ,

eprint = { 2211.05770 } ,

archiveprefix = { arXiv } ,

primaryclass = { cs.CV }

}