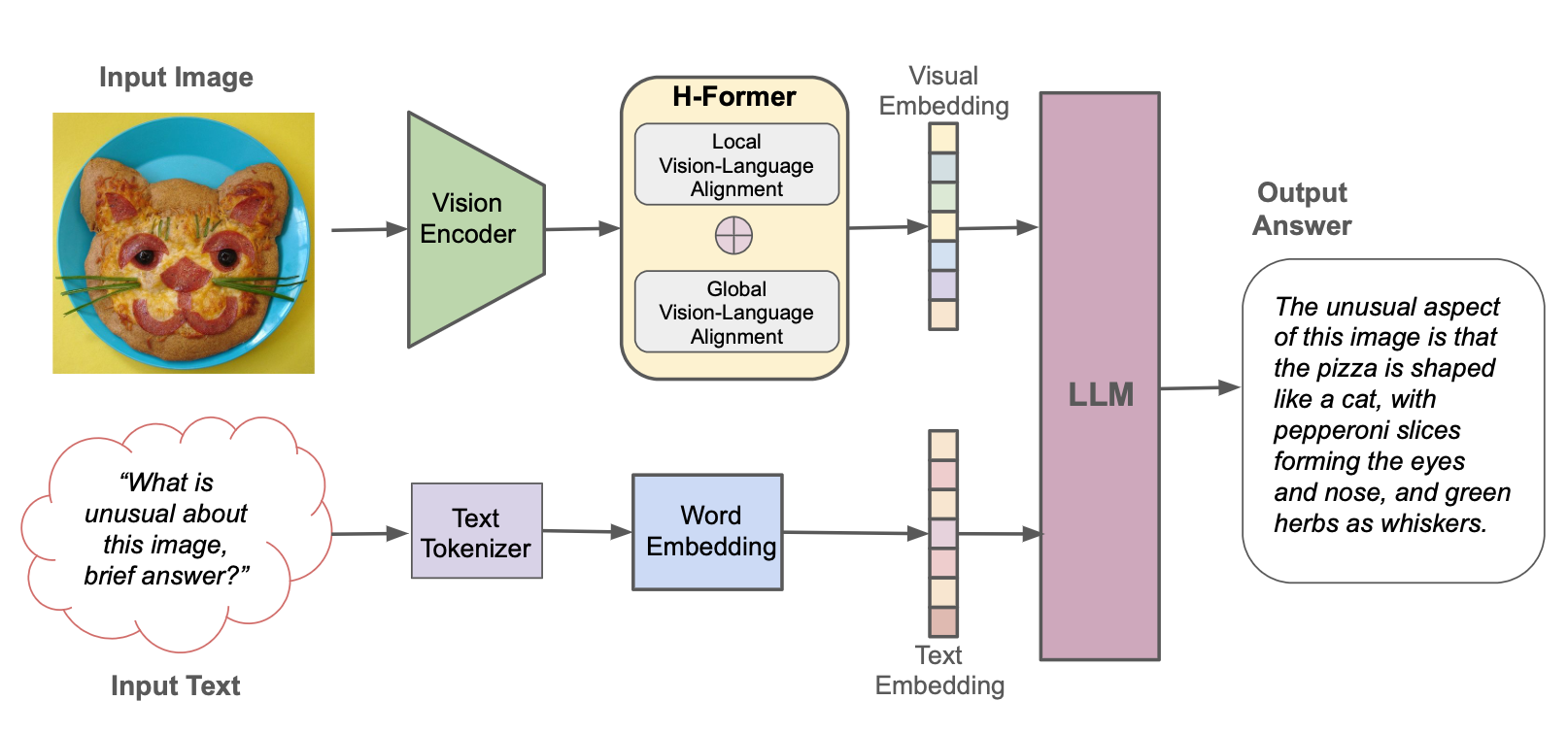

Hyper-Pretrained Transformers (HPT) เป็นกรอบ LLM แบบหลายรูปแบบใหม่จาก Hypergai และได้รับการฝึกฝนสำหรับแบบจำลองภาษาวิสัยทัศน์ที่สามารถเข้าใจทั้งอินพุตที่เป็นข้อความและภาพ HPT ได้รับผลลัพธ์ที่มีการแข่งขันสูงด้วยโมเดลที่ล้ำสมัยบนเกณฑ์มาตรฐาน LLM ที่หลากหลาย พื้นที่เก็บข้อมูลนี้มีการใช้งานรหัสการอนุมานโอเพ่นซอร์สเพื่อทำซ้ำผลการประเมินผลของ HPT บนมาตรฐานที่แตกต่างกัน

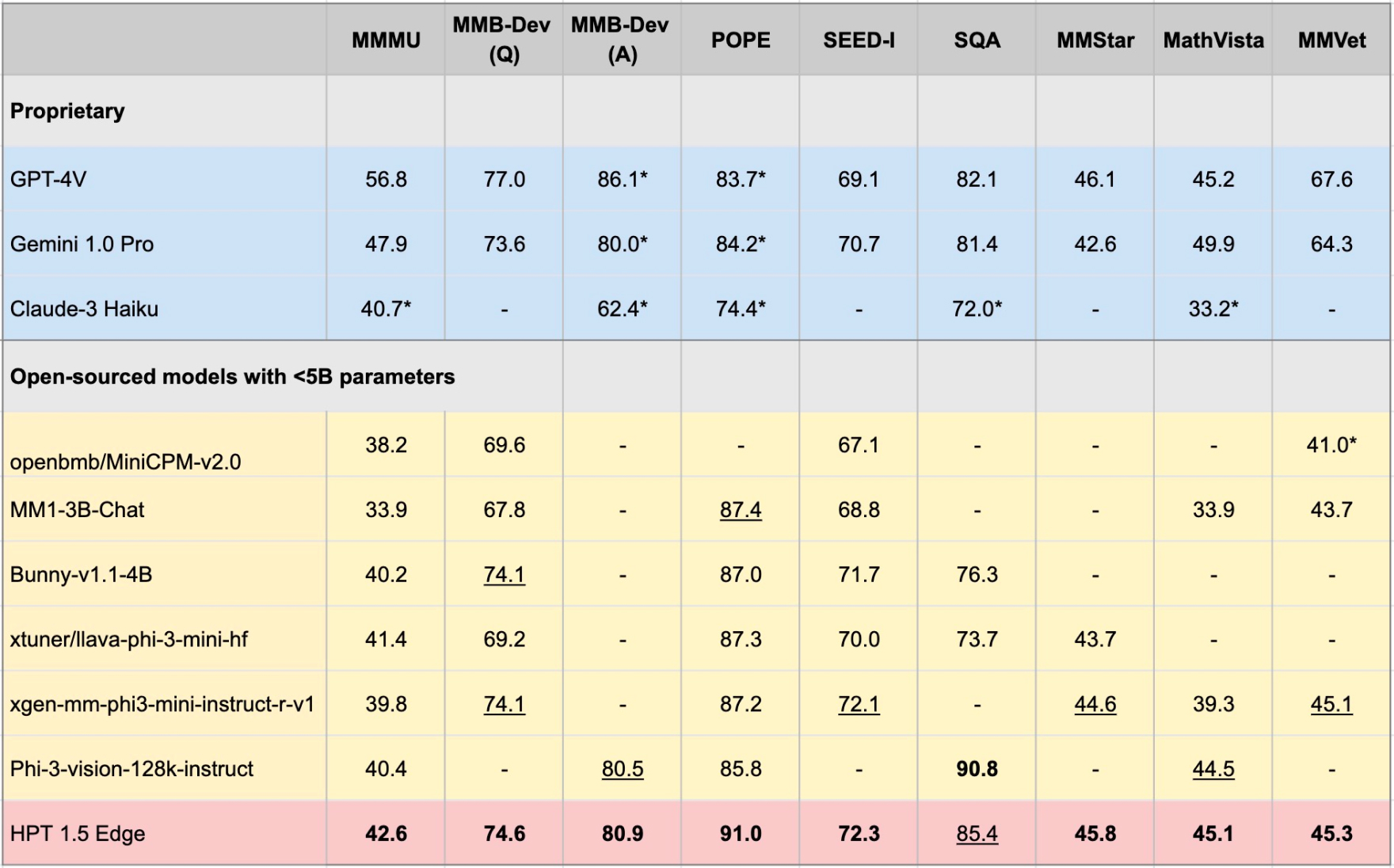

เราเปิดตัว HPT 1.5 Edge เป็นโมเดลโอเพ่นซอร์สล่าสุดของเราที่เหมาะกับอุปกรณ์ขอบ แม้จะมีขนาด (<5b), Edge แสดงให้เห็นถึงความสามารถที่น่าประทับใจในขณะที่มีประสิทธิภาพมาก เราปล่อย HPT 1.5 Edge ต่อสาธารณะที่ HuggingFace และ GitHub ภายใต้ใบอนุญาต Apache 2.0

pip install -r requirements.txt

pip install -e .

คุณสามารถดาวน์โหลดน้ำหนักรุ่นจาก HF ลงใน [เส้นทางท้องถิ่น] ของคุณและตั้งค่า global_model_path เป็น [เส้นทางท้องถิ่น] ของคุณในไฟล์กำหนดค่าโมเดล:

git lfs install

git clone https://huggingface.co/HyperGAI/HPT1_5-Edge [Local Path]

นอกจากนี้คุณยังสามารถตั้งค่ากลยุทธ์อื่น ๆ ในไฟล์กำหนดค่าที่แตกต่างจากการตั้งค่าเริ่มต้นของเรา

หลังจากตั้งค่าไฟล์ config แล้วให้เปิดการสาธิตแบบจำลองเพื่อทดลองใช้อย่างรวดเร็ว:

python demo/demo.py --image_path [Image] --text [Text] --model [Config]

ตัวอย่าง:

python demo/demo.py --image_path demo/einstein.jpg --text 'What is unusual about this image?' --model hpt-edge-1-5

เปิดตัวแบบจำลองสำหรับการประเมินผล:

torchrun --nproc-per-node=8 run.py --data [Dataset] --model [Config]

ตัวอย่างสำหรับ HPT 1.5 Edge:

torchrun --nproc-per-node=8 run.py --data MMMU_DEV_VAL --model hpt-edge-1-5

สำหรับ HPT 1.5 Edge

HPT 1.5 Edge

Pretrained LLM: PHI-3-MINI-4K-Instruct

Pretraned Visual encoder: Siglip-SO400m-Patch14-384

HPT 1.5 Air

Pretrained LLM: LLAMA3-8B-Instruct

Pretraned Visual encoder: Siglip-SO400m-Patch14-384

HPT 1.0 Air

pretrained llm: yi-6b-chat

ตัวเข้ารหัสภาพที่ได้รับการฝึกฝนมาก่อน: คลิป-ขนาดใหญ่-แพทช์ 14-336

โปรดทราบว่า HPT Air เป็นการเปิดตัวแบบเปิดอย่างรวดเร็วของเราเพื่ออำนวยความสะดวกในการวิจัย AI ที่เปิดกว้างและรับผิดชอบการพัฒนาชุมชน มันไม่มีกลไกการกลั่นกรองใด ๆ และไม่รับประกันผลลัพธ์ของพวกเขา เราหวังว่าจะมีส่วนร่วมกับชุมชนในการสร้างแบบจำลองให้ความเคารพอย่างประณีตเพื่ออนุญาตให้มีการรับเลี้ยงบุตรบุญธรรมในการใช้งานจริงในแอปพลิเคชันในโลกแห่งความเป็นจริงที่ต้องใช้ผลลัพธ์ที่ได้รับการดูแล

โครงการนี้เปิดตัวภายใต้ใบอนุญาต Apache 2.0 บางส่วนของโครงการนี้มีรหัสและรูปแบบจากแหล่งอื่น ๆ ซึ่งอยู่ภายใต้ใบอนุญาตของตนและคุณต้องใช้ใบอนุญาตที่เกี่ยวข้องหากคุณต้องการใช้เพื่อวัตถุประสงค์ทางการค้า

รหัสการประเมินผลสำหรับการใช้งานการสาธิตนี้ถูกขยายออกไปตามโครงการ VLMevalkit นอกจากนี้เรายังขอขอบคุณ OpenAI สำหรับการเปิดตัวโมเดล Visual Encoder ของพวกเขา, 01.AI, Meta และ Microsoft สำหรับการเปิดแหล่งภาษาขนาดใหญ่ของพวกเขา