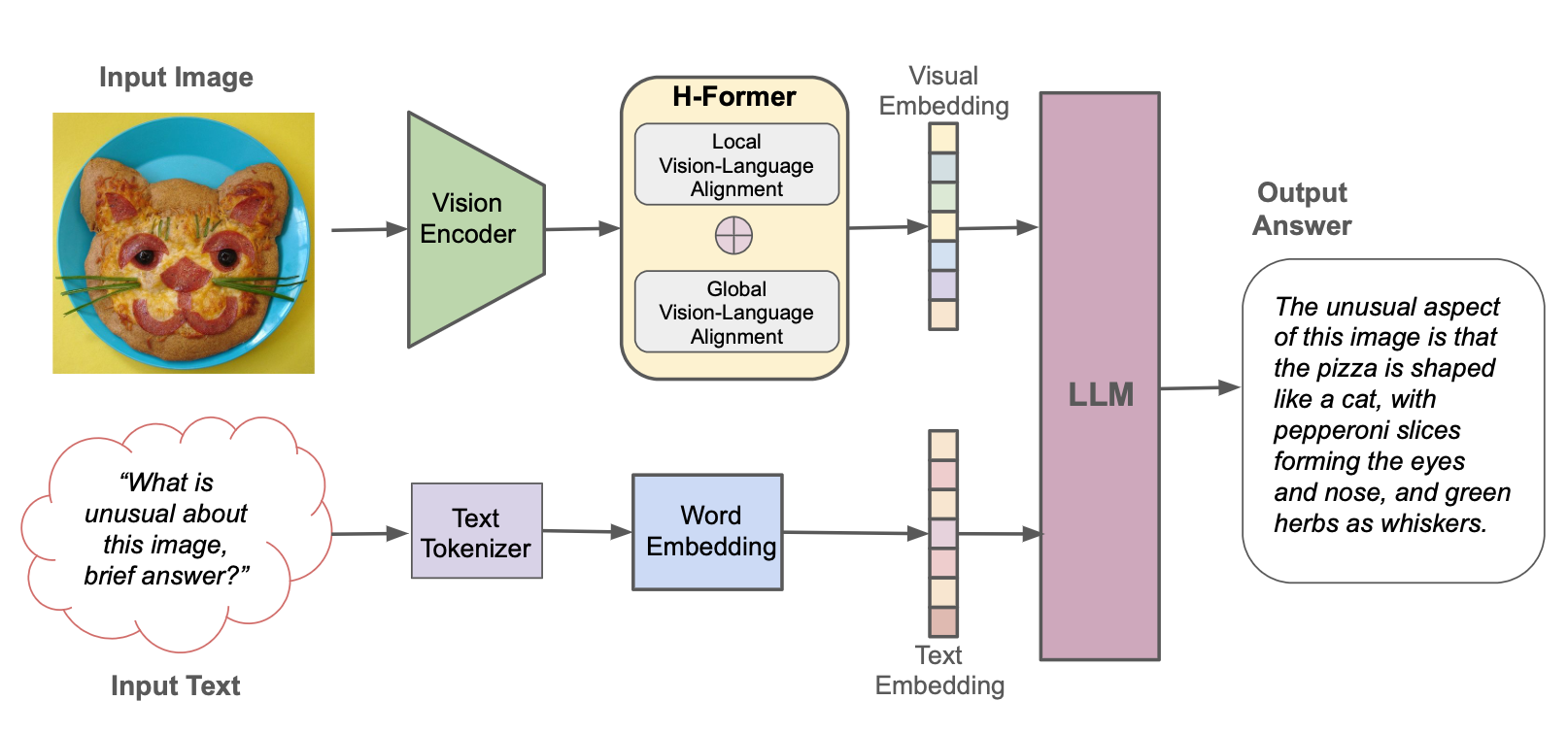

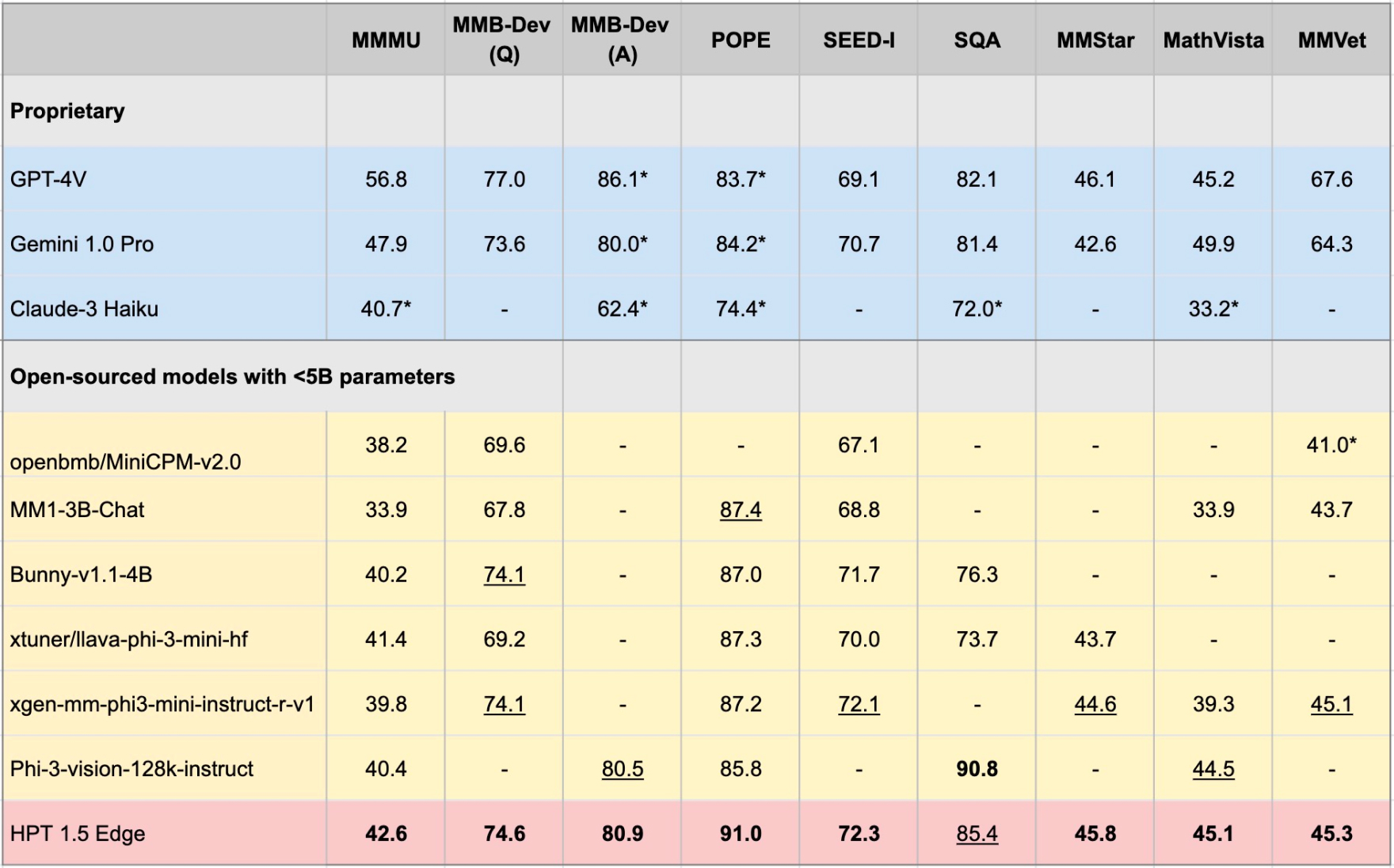

Hyper Pretured Transformers (HPT) es un nuevo marco LLM multimodal de Hypergai, y ha sido entrenado para modelos en idioma de visión que son capaces de comprender las entradas textuales y visuales. HPT ha logrado resultados altamente competitivos con modelos de vanguardia en una variedad de puntos de referencia multimodales LLM. Este repositorio contiene la implementación de código abierto del código de inferencia para reproducir los resultados de evaluación de HPT en diferentes puntos de referencia.

Lanzamos HPT 1.5 Edge como nuestro último modelo de fuente abierta adaptada a dispositivos de borde. A pesar de su tamaño (<5b), Edge demuestra capacidades impresionantes mientras es extremadamente eficiente. Lanzamos HPT 1.5 Edge públicamente en Huggingface y Github bajo la licencia Apache 2.0.

pip install -r requirements.txt

pip install -e .

Puede descargar los pesos del modelo de HF en su [ruta local] y establecer el global_model_path como su [ruta local] en el archivo de configuración del modelo:

git lfs install

git clone https://huggingface.co/HyperGAI/HPT1_5-Edge [Local Path]

También puede establecer otras estrategias en el archivo de configuración que son diferentes de nuestra configuración predeterminada.

Después de configurar el archivo de configuración, inicie la demostración del modelo para una prueba rápida:

python demo/demo.py --image_path [Image] --text [Text] --model [Config]

Ejemplo:

python demo/demo.py --image_path demo/einstein.jpg --text 'What is unusual about this image?' --model hpt-edge-1-5

Inicie el modelo para la evaluación:

torchrun --nproc-per-node=8 run.py --data [Dataset] --model [Config]

Ejemplo para HPT 1.5 Edge:

torchrun --nproc-per-node=8 run.py --data MMMU_DEV_VAL --model hpt-edge-1-5

Para HPT 1.5 Edge

HPT 1.5 Edge

PROTRADO LLM: PHI-3-MINI-4K-INSTRUST

Encoder visual previo a la aparición: Siglip-So400m-Patch14-384

HPT 1.5 AIR

Pretrenado LLM: Llama3-8b-Instructo

Encoder visual previo a la aparición: Siglip-So400m-Patch14-384

HPT 1.0 AIR

Prained LLM: Yi-6b-chat

Encoder visual previo a la aparición: Clip-Vit-Large-Patch14-336

Tenga en cuenta que el HPT AIR es un lanzamiento rápido de nuestros modelos para facilitar la investigación de IA abierta y responsable y el desarrollo comunitario. No tiene ningún mecanismo de moderación y no proporciona garantías sobre sus resultados. Esperamos comprometernos con la comunidad para que el modelo respete finamente las barandillas para permitir adopciones prácticas en aplicaciones del mundo real que requieren resultados moderados.

Este proyecto se publica bajo la licencia Apache 2.0. Partes de este proyecto contienen código y modelos de otras fuentes, que están sujetas a sus respectivas licencias y debe aplicar su licencia respectiva si desea usar con fines comerciales.

El código de evaluación para ejecutar esta demostración se extendió en función del proyecto VLMEVALKIT. También agradecemos a OpenAI por la obtención abierta de sus modelos de codificadores visuales, 01.AI, Meta y Microsoft por la obtención de sus grandes modelos de idiomas.