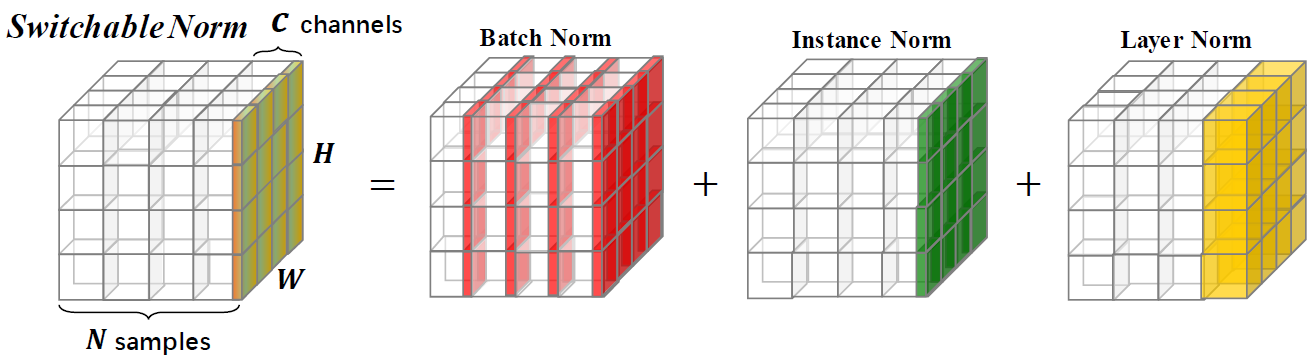

Переключаемая нормализация-это метод нормализации, которая способна изучать различные операции нормализации для различных слоев нормализации в глубокой нейронной сети в сквозной манере.

Этот репозиторий обеспечивает результаты классификации ImageNet и модели, обученные сменной нормализации. Вам рекомендуется цитировать следующую статью, если вы используете SN в исследованиях.

@article{SwitchableNorm,

title={Differentiable Learning-to-Normalize via Switchable Normalization},

author={Ping Luo and Jiamin Ren and Zhanglin Peng and Ruimao Zhang and Jingyu Li},

journal={International Conference on Learning Representation (ICLR)},

year={2019}

}

Сравнение точков TOP-1 в наборе проверки ImageNet, используя RESNET50, обученный SN, BN и GN в разных настройках размера партии. Кроншень (·, ·) обозначает (#графические процессоры,#образцы на графический процессор). В нижней части «GN-BN» указывает разницу между точностью GN и BN. «-» в (8, 1) BN указывает, что он не сходится.

| (8,32) | (8,16) | (8,8) | (8,4) | (8,2) | (1,16) | (132) | (8,1) | (1,8) | |

| Мгновенный | 76.4 | 76.3 | 75,2 | 72,7 | 65,3 | 76.2 | 76.5 | - | 75,4 |

| Гно | 75,9 | 75,8 | 76.0 | 75,8 | 75,9 | 75,9 | 75,8 | 75,5 | 75,5 |

| С | 76.9 | 76.7 | 76.7 | 75,9 | 75,6 | 76.3 | 76.6 | 75,0 * | 75,9 |

| GN - Bn | -0.5 | -0.5 | 0,8 | 3.1 | 10.6 | -0.3 | -0.7 | - | 0,1 |

| Sn - bn | 0,5 | 0,4 | 1.5 | 3.2 | 10.3 | 0,1 | 0,1 | - | 0,5 |

| Sn - Gn | 1.0 | 0,9 | 0,7 | 0,1 | -0.3 | 0,4 | 0,8 | -0.5 | 0,4 |

Мы предоставляем модели, предоставленные SN на ImageNet, и сравниваем с теми, которые предварительно проведены с BN в качестве ссылки. Если вы используете эти модели в исследованиях, пожалуйста, укажите SN Paper. Конфигурация SN обозначена как (#GPUS, #Images на GPU).

| Модель | Топ-1 * | Топ-5 * | Эпохи | LR планировщик | Распад веса | Скачать |

|---|---|---|---|---|---|---|

| Resnet101v2+sn (8,32) | 78,81% | 94,16% | 120 | разминка + косинус LR | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet101v1+sn (8,32) | 78,54% | 94,10% | 120 | разминка + косинус LR | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet50v2+sn (8,32) | 77,57% | 93,65% | 120 | разминка + косинус LR | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet50v1+sn (8,32) | 77,49% | 93,32% | 120 | разминка + косинус LR | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet50v1+sn (8,32) | 76,92% | 93,26% | 100 | Начальный LR = 0,1 распада = 0,1 шага [30,60,90,10] | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet50v1+sn (8,4) | 75,85% | 92,7% | 100 | Начальный LR = 0,0125 Размещение = 0,1 шага [30,60,90,10] | 1E-4 | [Google Drive] [Baidu Pan] |

| Resnet50v1+sn (8,1) † | 75,94% | 92,7% | 100 | Начальный LR = 0,003125 Размещение = 0,1 шага [30,60,90,10] | 1E-4 | [Google Drive] [Baidu Pan] |

| RESNET50V1+BN | 75,20% | 92,20% | - | поэтапное распад | - | [TensorFlow Models] |

| RESNET50V1+BN | 76,00% | 92,98% | - | поэтапное распад | - | [Pytorch Vision] |

| RESNET50V1+BN | 75,30% | 92,20% | - | поэтапное распад | - | [MSRA] |

| RESNET50V1+BN | 75,99% | 92,98% | - | поэтапное распад | - | [FB Torch] |

*Точность валидации с одной культурой на ImageNet (центральная культура 224x224 от измененного изображения с более короткой стороной = 256)

† Для (8,1) SN содержит в и LN без BN, как BN такой же, как и в тренировках. При использовании этой модели вы должны добавить using_bn : False в файле YAML.

Все материалы в этом хранилище выпускаются по лицензии CC-By-NC 4.0.