Este repositório contém a implementação do ICLR2024 Paper LLCP: Aprendendo processos causais latentes para a pergunta em vídeo baseada em raciocínio Resposta PDF

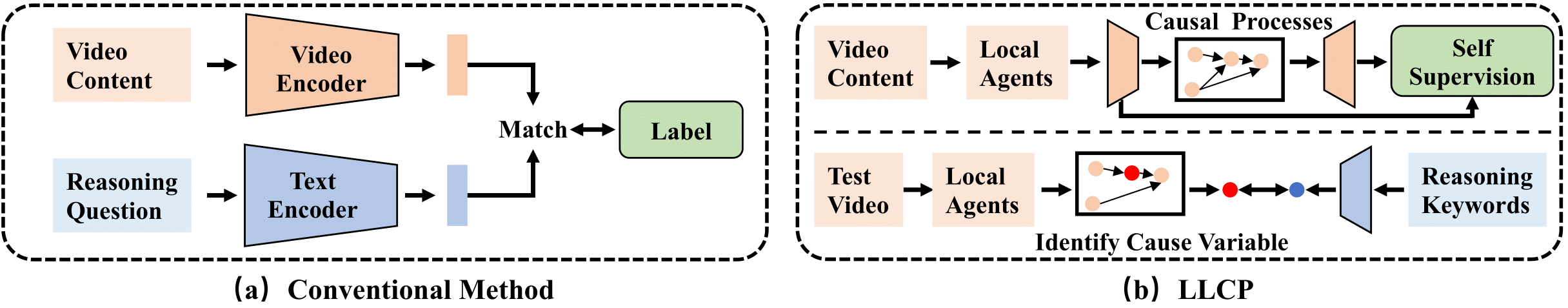

O LLCP é uma estrutura causal projetada para aprimorar o raciocínio em vídeo, concentrando-se na dinâmica espacial-temporal dos objetos nos eventos, sem a necessidade de extensas anotações de dados. Ao empregar aprendizado auto-supervisionado e alavancar a modularidade dos mecanismos causais, a LLCP aprende um modelo generativo multivariado para a dinâmica espacial-temporais e, portanto, permite a atribuição eficaz de acidentes e a previsão contrafactual de videoQA baseado em raciocínio.

Primeiro, instale a versão recente de Pytorch e Torchvision como pip install torch torchvision . Em seguida, você pode instalar outro pacote executando pip install -r requirements.txt

Fornecemos os recursos processados usados em nossos experimentos. Faça o download dos dados e modelo neste link1 e este link2. Em seguida, descompacte os floders como ./data/ e ./results/ e substitua os floders originais como os baixados.

A estrutura do diretório deve parecer

LLCP_VQA/

|–– config.py

|–– configs/

|–– data/

| |–– object_test_feat/

| |–– object_train_feat/

| |–– appearance_feat_rn50.h5

| |–– test_questions.pt

| |–– train_questions.pt

| |–– video_noaccident_train.txt

|–– DataLoader.py

|–– models_cvae.py

|–– requirements.txt

|–– results/

| |–– .../model_cvae49.pt

|–– README.md

|–– train.py

|–– validate.py

Para treinar o modelo CVAE, você pode executar este comando:

python train.py --cfg configs/sutd-traffic_transition.yml

Para avaliar o modelo treinado, consulte:

python validate.py --cfg configs/sutd-traffic_transition.yml

Veja simulação de LLCP.

Se você achar nosso trabalho útil em sua pesquisa, considere citar:

@inproceedings{chen2024llcp,

title={LLCP: Learning Latent Causal Processes for Reasoning-based Video Question Answer},

author={Chen, Guangyi and Li, Yuke and Liu, Xiao and Li, Zijian and Al Surad, Eman and Wei, Donglai and Zhang, Kun}

booktitle={ICLR},

year={2024}

}

Nossa implementação é baseada principalmente no SUTD-TRAFFICQA e TEM-ADAPTER, agradecemos aos autores a lançar seus códigos.