llama index RAG

1.0.0

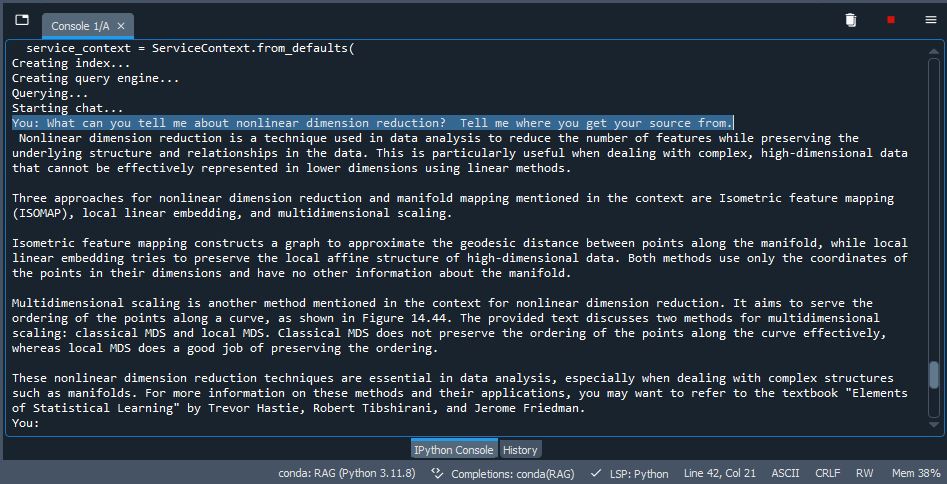

Implementasi RAG pada Indeks LLAMA menggunakan Qdrant sebagai penyimpanan. Ambil beberapa PDF (Anda dapat menggunakan PDF uji termasuk dalam /data atau hapus dan gunakan dokumen Anda sendiri), indeks /embed mereka dalam VDB, gunakan LLM untuk inferensi dan menghasilkan output. Cukup bagus.

pip install -r /path/to/requirements.txt di cmd promptollama run mistral atau model apa pun yang Anda pilih. Jika Anda menggunakan Ollama baru untuk Windows maka tidak perlu karena berjalan di latar belakang (pastikan aktif).