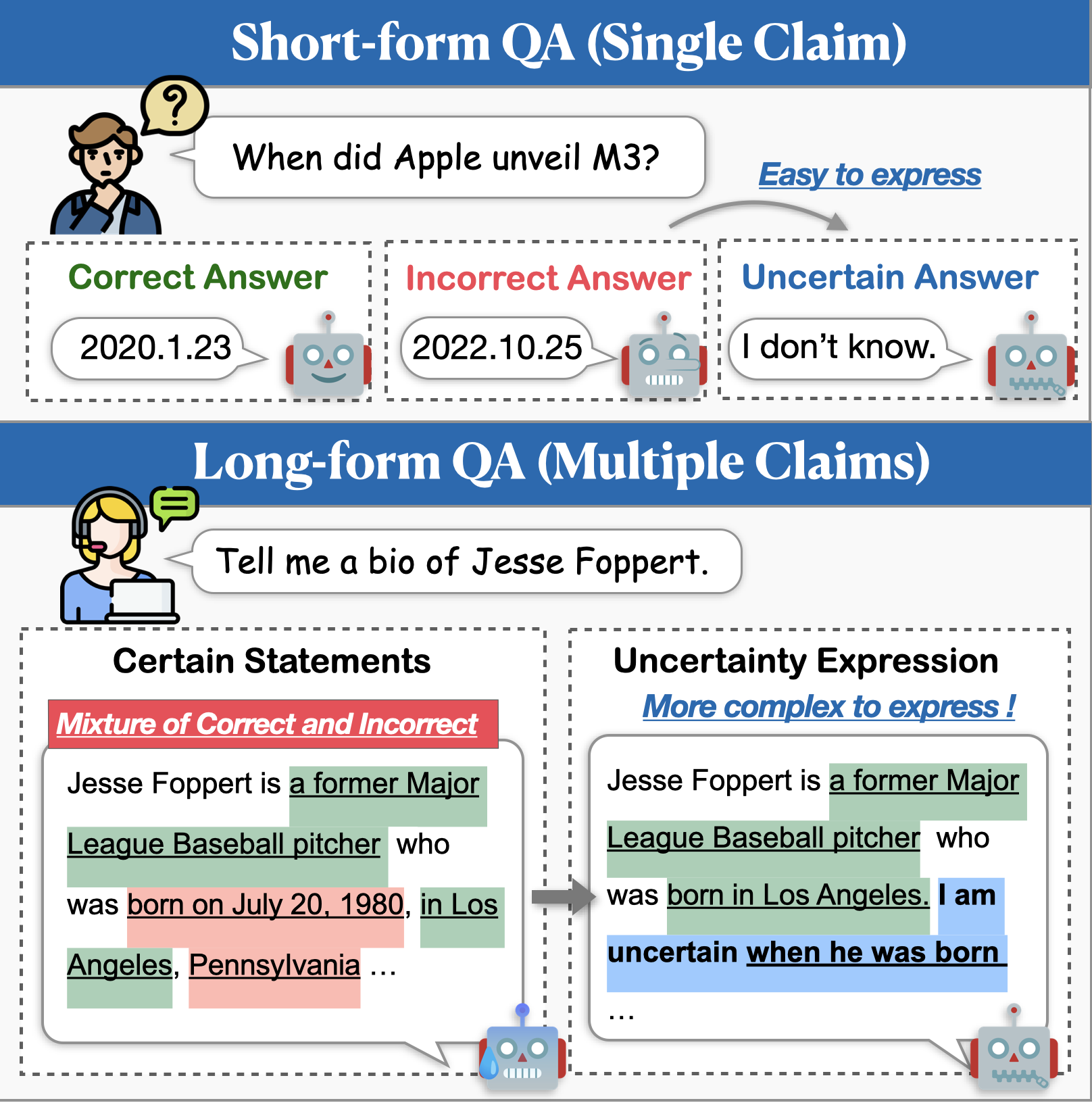

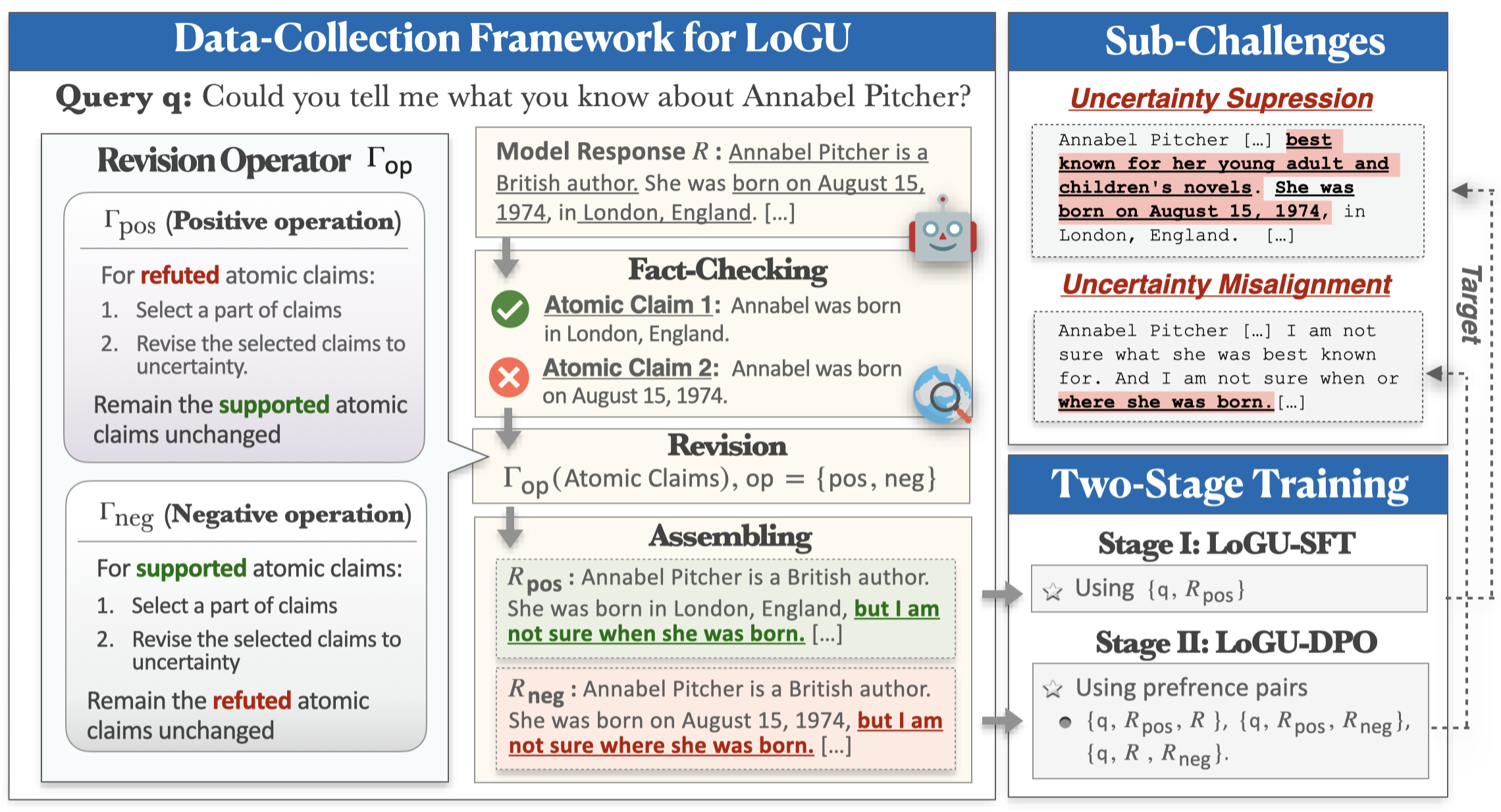

Alors que les modèles de grands langues (LLM) montrent des capacités impressionnantes, elles ont toujours du mal à générer un contenu factuellement incorrect (c'est-à-dire des hallucinations). Une approche prometteuse pour atténuer ce problème permet aux modèles d'exprimer l'incertitude lorsqu'ils ne sont pas sûrs. Des recherches antérieures sur la modélisation de l'incertitude se sont principalement concentrées sur la QA de formes courtes, mais les applications du monde réel nécessitent souvent des réponses beaucoup plus longues. Dans ce travail, nous introduisons la tâche de la génération longue avec incertitude (LOGU). Nous identifions deux défis clés: la suppression de l'incertitude , où les modèles hésitent à exprimer l'incertitude et le désalignement de l'incertitude , où les modèles transmettent de manière incertaine.

Pour relever ces défis, nous proposons un cadre de collecte de données basé sur le raffinement et un pipeline de formation en deux étapes. Notre cadre adopte une stratégie de division et de conquête, affiner l'incertitude basée sur les revendications atomiques. Les données collectées sont ensuite utilisées dans la formation par un réglage fin supervisé (SFT) et l'optimisation des préférences directes (DPO) pour améliorer l'expression de l'incertitude. Des expériences approfondies sur trois instructions longues suivant les ensembles de données montrent que notre méthode améliore considérablement la précision, réduit les hallucinations et maintient l'exhaustivité des réponses.

Vous pouvez utiliser les commandes suivantes pour installer l'environnement pour logu:

conda create -n LoGU python==3.8

conda activate LoGU

pip install -r lf_requirements.txt

pip install -r vllm_requirements.txtEssayez la commande suivante pour tester notre méthode sur le BIOS, Longfact, Wildhallu:

cd ./scripts

bash generate_vllm_responses.shbash eval_pipeline.shbash generate_unc_answers.sh

bash factcheck_unc_answers.shÀ venir!

Nous fournissons également des modèles d'expression d'incertitude sur le hub HuggingFace pour Fast Trail:

| Modèle | Lien |

|---|---|

| rhyang2021 / incertain_llama3_8b | Étreinte |

| rhyang2021 / incertain_mistral_7b | Étreinte |

Si vous avez des questions, n'hésitez pas à m'envoyer un e-mail ou à m'envoyer un problème.