Le projet a désormais une version portable, vous n'avez donc pas à vous procéder à l'installation de toutes les dépendances.

Cliquez ici pour télécharger

Vous n'avez besoin que de Windows et d'une carte graphique NVIDIA avec 6 Go de mémoire vidéo pour l'exécuter.

Anglais

russe

Portuguêts

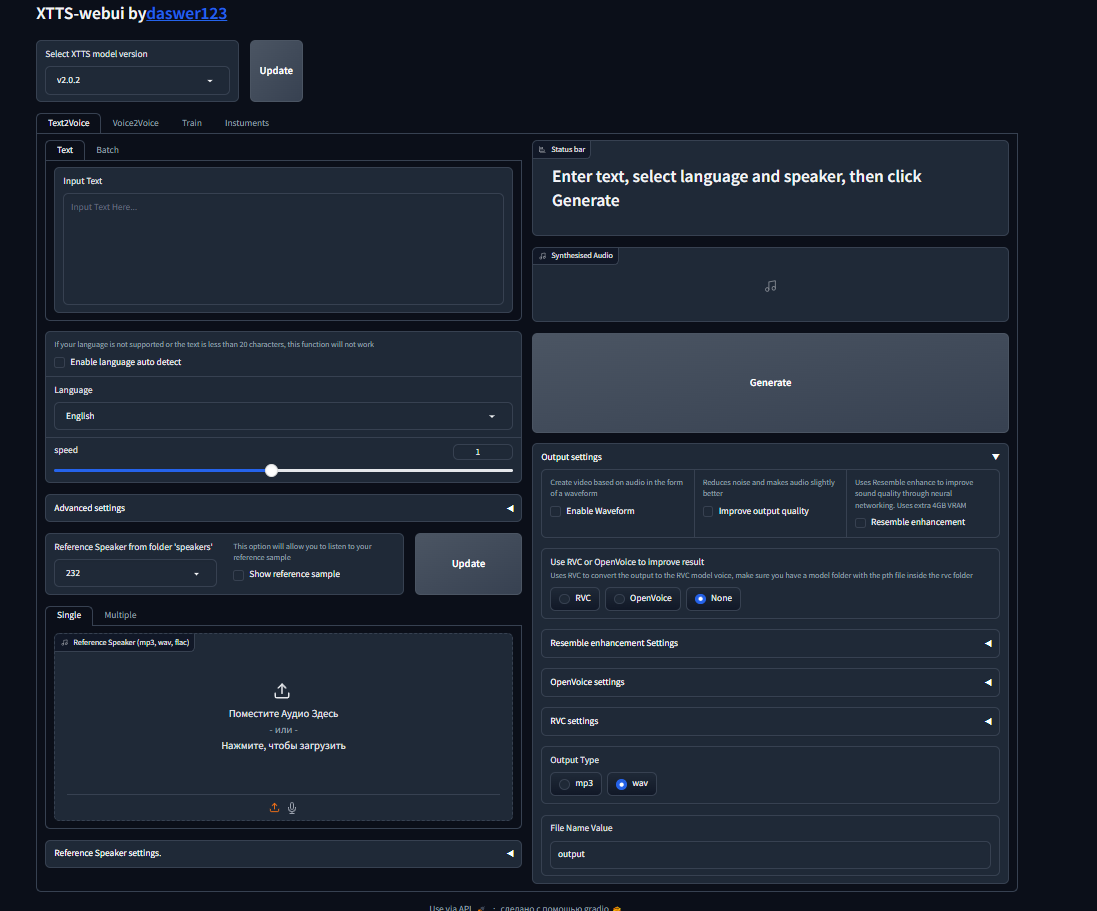

XTTS-WEBUI est une interface Web qui vous permet de tirer le meilleur parti de XTTS. Il existe d'autres réseaux de neurones autour de cette interface qui amélioreront vos résultats. Vous pouvez également affiner le modèle et obtenir un modèle vocal de haute qualité.

Utilisez cette interface utilisateur Web via Google Colab

Veuillez vous assurer d'avoir Python 3.10.x ou Python 3.11, CUDA 11.8 ou CUDA 12.1, Microsoft Builder Tools 2019 avec package C ++ et FFMPEG installé

Pour commencer:

Pour commencer:

Suivez ces étapes pour l'installation:

Assurez-vous que CUDA est installé

Clone The Repository: git clone https://github.com/daswer123/xtts-webui

Naviguez dans le répertoire: cd xtts-webui

Créer un environnement virtuel: python -m venv venv

Activez l'environnement virtuel:

venvscriptsactivatesource venvbinactivateInstallez Pytorch et Torchaudio avec la commande PIP:

pip install torch==2.1.1+cu118 torchaudio==2.1.1+cu118 --index-url https://download.pytorch.org/whl/cu118

Installez toutes les dépendances à partir des exigences.txt:

pip install -r requirements.txt

Pour lancer l'interface, veuillez suivre ces étapes:

Activez votre environnement virtuel:

venv/scripts/activateou si vous êtes sur Linux,

source venv/bin/activateDémarrez ensuite le WebUI pour XTTS en exécutant cette commande:

python app.pyVoici quelques arguments d'exécution qui peuvent être utilisés lors du démarrage de l'application:

| Argument | Valeur par défaut | Description |

|---|---|---|

| -Hs, - host | 127.0.0.1 | L'hôte à lier |

| -p, --port | 8010 | Le numéro de port à écouter |

| -D, --Device | cuda | Quel appareil utiliser (CPU ou CUDA) |

| -sf, - Speaker_folder | haut-parleurs / | Répertoire contenant des échantillons TTS |

| -o, - sortie | "sortir/" | Répertoire de sortie |

| -l, - langue | "auto" | Langue Webui, vous pouvez voir les traductions disponibles dans le dossier i18n / local. |

| -ms, - modèle de modèle | "locale" | Définissez la source du modèle: «API» pour la dernière version du référentiel, l'inférence API ou «local» pour l'utilisation de l'inférence locale et le modèle v2.0.2 |

| -v, -version | "v2.0.2" | Vous pouvez spécifier la version de XTTS à utiliser. Vous pouvez spécifier le nom du modèle personnalisé à cet effet, mettez le dossier dans les modèles et spécifiez le nom du dossier de ce drapeau |

| - Lowvram | Activer le mode VRAM faible qui fait passer le modèle à RAM lors du traitement activement | |

| - profondément | Activer l'accélération profonde. Fonctionne sur Windows sur Python 3.10 et 3.11 | |

| --partager | Permet le partage de l'interface en dehors de l'ordinateur local | |

| - RVC | Activer le post-traitement RVC, tous les modèles doivent se trouver dans le dossier RVC |

Module pour RVC, vous pouvez permettre au module RVC de reproduire l'audio reçu pour cela, vous devez ajouter l'indicateur - RVC si vous exécutez dans la console ou l'écrivez dans le fichier de démarrage

Pour que le modèle fonctionne dans les paramètres RVC, vous devez sélectionner un modèle que vous devez d'abord télécharger dans le dossier Voice2Voice / RVC, le modèle et le fichier d'index doivent être ensemble, le fichier d'index est facultatif, chaque modèle doit être dans un dossier séparé.