XTS-Webui

Tragbare Version

Das Projekt verfügt jetzt über eine tragbare Version, sodass Sie sich nicht die Mühe machen müssen, alle Abhängigkeiten zu installieren.

Klicken Sie hier, um herunterzuladen

Sie brauchen nichts anderes als Windows und eine NVIDIA -Grafikkarte mit 6 GB Videospeicher, um sie auszuführen.

Der Zug der Zug ist kaputt. Wenn Sie ein Modell trainieren möchten, verwenden Sie ein separates Webui

XTS-Finetune-Webui

Readme ist in den folgenden Sprachen verfügbar

Englisch

Russisch

Português

Über das Projekt

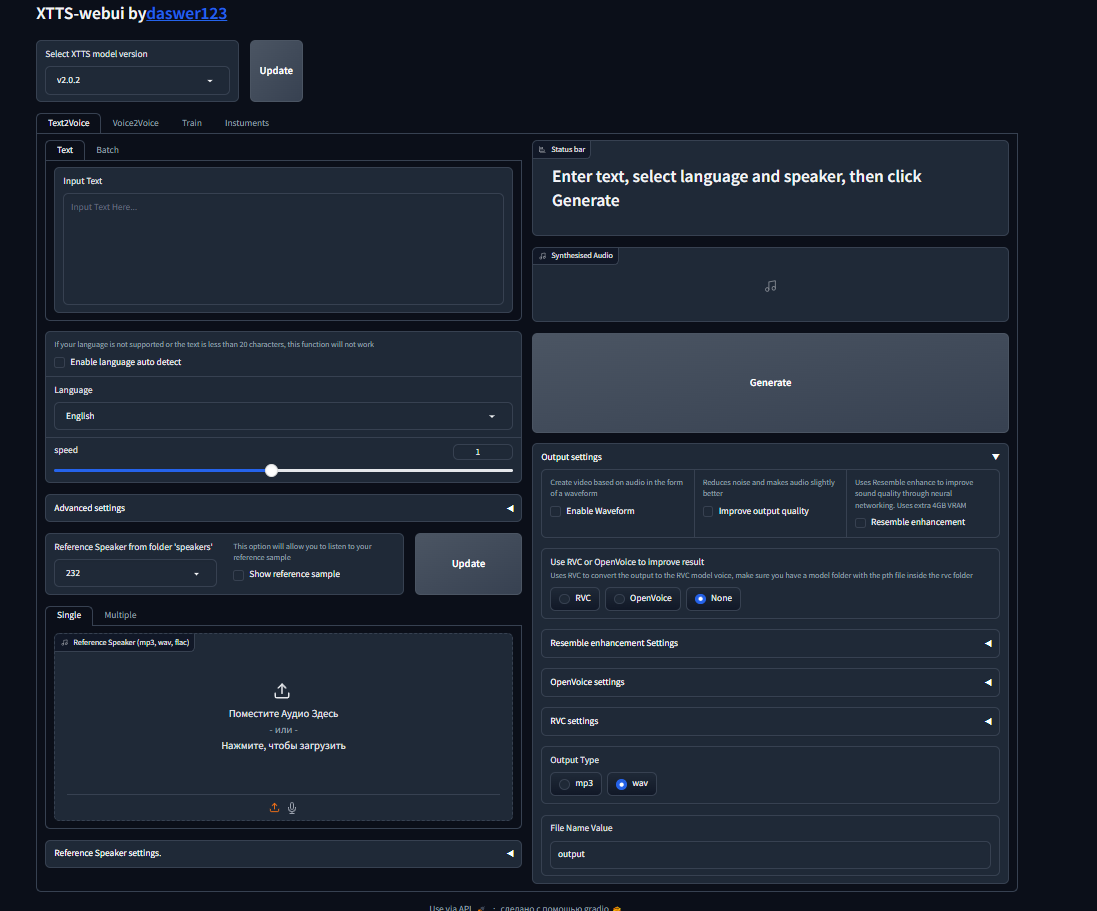

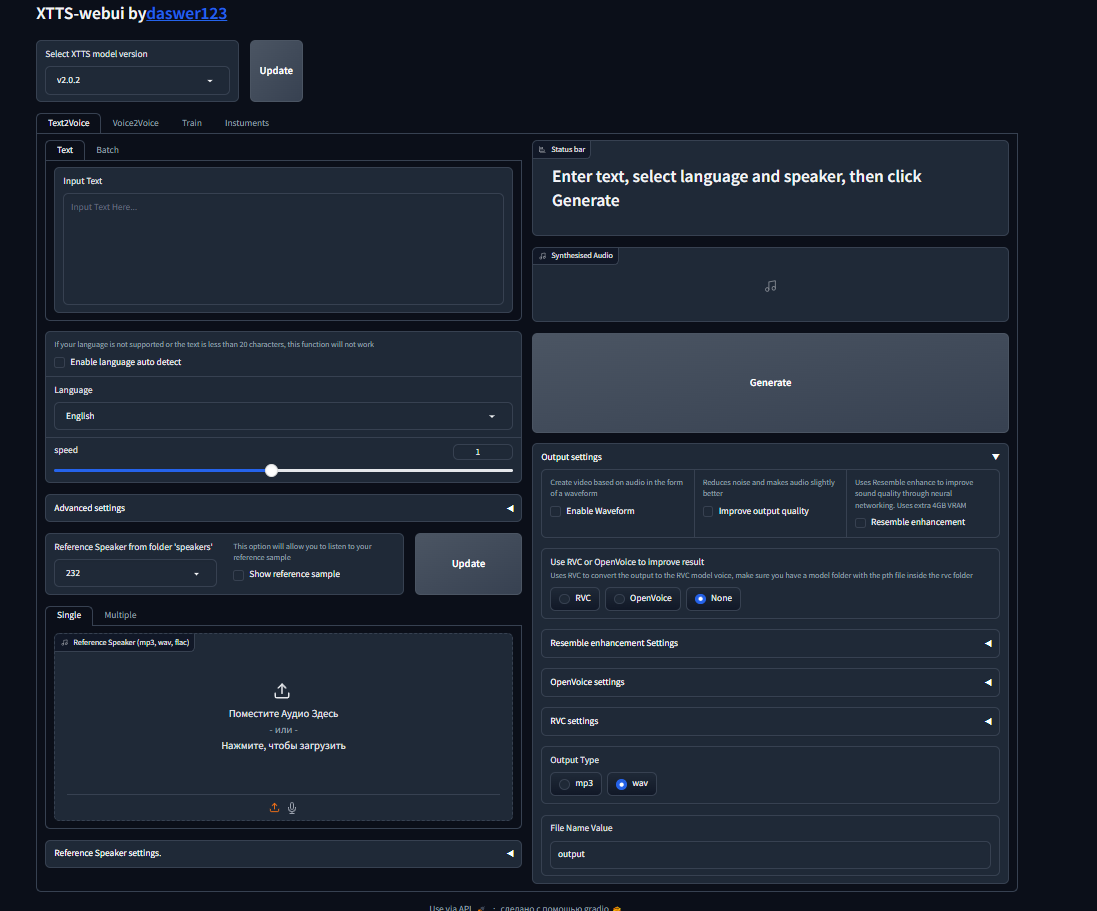

XTTS-Webui ist eine Weboberfläche, mit der Sie das Beste aus XTTs nutzen können. Es gibt andere neuronale Netzwerke in dieser Oberfläche, die Ihre Ergebnisse verbessern. Sie können das Modell auch einstellen und ein hochwertiges Sprachmodell erhalten.

Schlüsselmerkmale

- Einfache Arbeit mit XTTSV2

- Stapelverarbeitung zum Synchronisieren einer großen Anzahl von Dateien

- Fähigkeit, Audio mit Sprachsparen zu übersetzen

- Fähigkeit, die Ergebnisse mithilfe neuronaler Netzwerke und Audio -Tools automatisch zu verbessern

- Fähigkeit, das Modell zu optimieren und es sofort zu verwenden

- Fähigkeit, Tools wie: RVC , OpenVoice , ähneln zu verbessern, sowohl zusammen als auch separat verstärken

- Fähigkeit, die Erzeugung von XTTs, alle Parameter, mehrere sprechende Stichproben anzupassen

Todo

Installation

Verwenden Sie diese Web -Benutzeroberfläche über Google Colab

Bitte stellen Sie sicher

1 Methode durch Skripte

Fenster

Um loszulegen:

- Führen Sie die Datei 'install.bat' aus

- Um die Web -Benutzeroberfläche zu starten, führen Sie 'start_xtts_webui.bat' aus 'aus.

- Öffnen Sie Ihren bevorzugten Browser und gehen Sie zu der in der Konsole angezeigten lokalen Adresse.

Linux

Um loszulegen:

- Führen Sie die Datei 'install.sh' aus

- Um die Web -Benutzeroberfläche zu starten, führen Sie 'start_xtts_webui.sh' aus 'aus.

- Öffnen Sie Ihren bevorzugten Browser und gehen Sie zu der in der Konsole angezeigten lokalen Adresse.

2 Methode, Handbuch

Befolgen Sie diese Schritte zur Installation:

Stellen Sie sicher, dass CUDA installiert ist

Klon das Repository: git clone https://github.com/daswer123/xtts-webui

Navigieren Sie in das Verzeichnis: cd xtts-webui

Erstellen Sie eine virtuelle Umgebung: python -m venv venv

Aktivieren Sie die virtuelle Umgebung:

- Unter Windows verwenden:

venvscriptsactivate - Unter Linux -Verwendung:

source venvbinactivate

Installieren Sie Pytorch und Torchaudio mit PIP -Befehl:

pip install torch==2.1.1+cu118 torchaudio==2.1.1+cu118 --index-url https://download.pytorch.org/whl/cu118

Installieren Sie alle Abhängigkeiten von Anforderungen.txt:

pip install -r requirements.txt

Ausführen der Anwendung

Um die Schnittstelle zu starten, befolgen Sie bitte die folgenden Schritte:

XTTS Webui starten:

Aktivieren Sie Ihre virtuelle Umgebung:

oder wenn Sie unter Linux sind,

Starten Sie dann das Webui für XTTs, indem Sie diesen Befehl ausführen:

Hier sind einige Laufzeitargumente, die beim Starten der Anwendung verwendet werden können:

| Argument | Standardwert | Beschreibung |

|---|

| -hs, -Host | 127.0.0.1 | Der Wirt zu binden an zu binden |

| -p, --port | 8010 | Die Portnummer zum Anhören |

| -d, -Gerät | CUDA | Welches Gerät zu verwenden (CPU oder CUDA) |

| -sf,-LEACHER_FOLDER | Sprecher/ | Verzeichnis mit TTS -Proben |

| -O,-Ausgabe | "Ausgabe/" | Ausgabeverzeichnis |

| -l,-Sprache | "Auto" | In Webui -Sprache können Sie die verfügbaren Übersetzungen im Ordner i18n/Gebietsschema sehen. |

| -Ms,-Modell-Source | "Lokal" | Definieren Sie die Modellquelle: 'API' für die neueste Version aus Repository, API -Inferenz oder „Lokal“ zur Verwendung lokaler Inferenz und Modell v2.0.2 |

| -v, -version | "v2.0.2" | Sie können angeben, welche Version von XTTs verwendet werden soll. Sie können den Namen des benutzerdefinierten Modells für diesen Zweck angeben. Stellen Sie den Ordner in Modelle ein und geben Sie den Namen des Ordners in diesem Flag an |

| -Lowvram | | Aktivieren Sie den niedrigen VRAM -Modus, der das Modell auf RAM umschaltet, wenn sie nicht aktiv verarbeitet |

| -Deepspeed | | Aktivieren Sie die Beschleunigung der Deepspeed. Funktioniert unter Windows unter Python 3.10 und 3.11 |

| --Aktie | | Ermöglicht die gemeinsame Nutzung der Schnittstelle außerhalb des lokalen Computers |

| -RVC | | Aktivieren Sie die RVC-Nachbearbeitung. Alle Modelle sollten im RVC-Ordner lokalisieren |

TTS -> RVC

Modul für RVC können Sie das RVC -Modul ermöglichen, das empfangene Audio dafür nachzuprobieren

Damit das Modell in RVC -Einstellungen funktioniert, müssen Sie ein Modell auswählen, das Sie zuerst in den Ordner Voice2Voice/RVC hochladen müssen. Das Modell und die Indexdatei müssen zusammen sein. Die Indexdatei ist optional. Jedes Modell muss sich in einem separaten Ordner befinden.

Unterschiede zwischen XTTS-Webui und dem offiziellen Webui

Datenverarbeitung

- Schneller auf 0,10.0 aktualisiert, um ein größeres V3-Modell auszuwählen.

- Ausgangsordner in den Ausgangsordner im Hauptordner geändert.

- Wenn im Ausgabeordner bereits ein Datensatz vorhanden ist und Sie neue Daten hinzufügen möchten, können Sie dies tun, indem Sie einfach neues Audio hinzufügen. Was wurde nicht erneut verarbeitet und die neuen Daten werden automatisch hinzugefügt

- VAD -Filter einschalten

- Nachdem der Datensatz erstellt wurde, wird eine Datei erstellt, die die Sprache des Datensatzes angibt. Diese Datei wird vor dem Training gelesen, damit die Sprache immer übereinstimmt. Es ist bequem, wenn Sie die Schnittstelle neu starten

Feinabstimmung XTTS-Encoder

- Die Möglichkeit hinzugefügt, das Basismodell für XTTs auszuwählen, und wenn Sie erneut ausführen, muss das Modell nicht erneut heruntergeladen werden.

- Die Möglichkeit, das benutzerdefinierte Modell als Basismodell während des Trainings auszuwählen, wodurch ein Finetune -Modell bereits ein Finetune -Modell ermöglicht wird.

- Es wurde die Möglichkeit hinzugefügt, um eine optimierte Version des Modells für 1 Klick zu erhalten (Schritt 2.5, optimierte Version in den Ausgangsordner).

- Sie können auswählen, ob Sie Trainingsordner löschen möchten, nachdem Sie das Modell optimiert haben

- Wenn Sie das Modell optimieren, wird das Beispielreferenz -Audio in den Ausgangsordner verschoben

- Überprüfung auf Korrektheit der angegebenen Sprache und Datensatzsprache

Schlussfolgerung

- Es wurde die Möglichkeit hinzugefügt, die InD -Einstellungen während der Modellprüfung anzupassen.

Andere

- Wenn Sie die Schnittstelle in einem der Schritte versehentlich neu starten, können Sie Daten auf zusätzliche Schaltflächen laden

- Entfernte die Anzeige von Protokollen, da sie beim Neustart Probleme verursachten

- Das fertige Ergebnis wird in den Ready -Ordner kopiert. Dies sind vollständig fertige Dateien. Sie können sie überall verschieben und als Standardmodell verwenden

- Unterstützung für Japanisch hier hinzugefügt