Este artículo presenta la serie ShareGPT4Video, un proyecto destinado a mejorar las capacidades de comprensión de video de los modelos de lenguaje de video a gran escala (LVLM) y las capacidades de generación de video de los modelos de texto a video (T2VM). La serie consta de tres partes principales: ShareGPT4Video, un denso conjunto de datos de subtítulos de 40.000 vídeos anotados por GPT4V, un modelo eficiente de generación de subtítulos de vídeo, que se ha utilizado para anotar 4.800.000 vídeos y uno de tres puntos de referencia de vídeo ShareGPT4Video-8B; , un modelo LVLM que logra rendimiento SOTA. El equipo de investigación superó los problemas de falta de detalles y confusión de tiempo en la generación de subtítulos de video con los métodos existentes, y logró una generación de subtítulos de video escalable y de alta calidad a través de una estrategia diferencial de subtítulos de video cuidadosamente diseñada.

1) ShareGPT4Video, una densa colección de subtítulos de 40.000 videos de diferentes duraciones y fuentes anotados por GPT4V, desarrollado a través de estrategias de anotación y filtrado de datos cuidadosamente diseñadas.

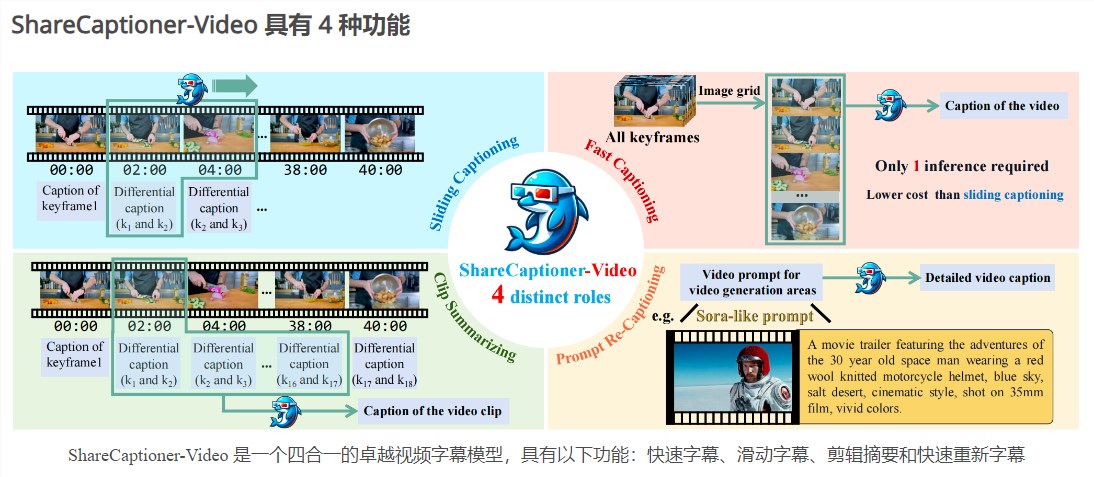

2) ShareCaptioner-Video, un modelo de generación de subtítulos de vídeo eficiente y potente adecuado para vídeos arbitrarios, que anota 4.800.000 vídeos estéticos de alta calidad.

3) ShareGPT4Video-8B, un LVLM simple pero superior, logra rendimiento SOTA en tres pruebas comparativas de video avanzadas.

Además de los anotadores humanos costosos y no escalables, el estudio encontró que el uso de GPT4V para generar subtítulos para videos con una simple estrategia de entrada de múltiples cuadros o concatenación de cuadros dio como resultado resultados que carecían de detalles y, a veces, estaban temporalmente confusos. El equipo de investigación cree que el desafío de diseñar estrategias de subtítulos de vídeo de alta calidad reside en tres aspectos:

1) Comprender los cambios temporales precisos entre fotogramas.

2) Describe el contenido detallado dentro del marco.

3) Escalabilidad al número de fotogramas para vídeos de duración arbitraria.

Con este fin, los investigadores diseñaron cuidadosamente una estrategia diferencial de subtítulos de vídeo que sea estable, escalable y eficiente para generar subtítulos de vídeo de resoluciones, relaciones de aspecto y longitudes arbitrarias. ShareGPT4Video se basó en esto y contiene 40.000 videos de alta calidad que cubren una amplia gama de categorías. Los subtítulos generados contienen un rico conocimiento del mundo, propiedades de los objetos, movimientos de la cámara y descripciones temporales detalladas y precisas de eventos clave.

Basado en ShareGPT4Video, se ha desarrollado aún más ShareCaptioner-Video, un excelente modelo de generación de subtítulos que puede generar de manera eficiente subtítulos de alta calidad para cualquier video. Lo utilizamos para anotar 4.800.000 vídeos estéticamente atractivos y verificar su eficacia en una tarea de generación de texto a vídeo de 10 segundos. ShareCaptioner-Video es un modelo de subtítulos de video superior cuatro en uno con las siguientes características: subtítulo rápido, subtítulo deslizante, resumen de clip y resubtítulo rápido.

En términos de comprensión de video, el equipo de investigación también verificó la efectividad de ShareGPT4Video en varias arquitecturas LVLM actuales y presentó el nuevo y destacado LVLM ShareGPT4Video-8B.

Entrada del producto: https://top.aibase.com/tool/sharegpt4video

La serie ShareGPT4Video ha aportado avances significativos al campo de la comprensión y generación de videos, y se espera que sus conjuntos de datos y modelos de alta calidad promuevan un mayor desarrollo de tecnologías relacionadas. Visita el enlace para más detalles.