MultiSpeech

1.0.0

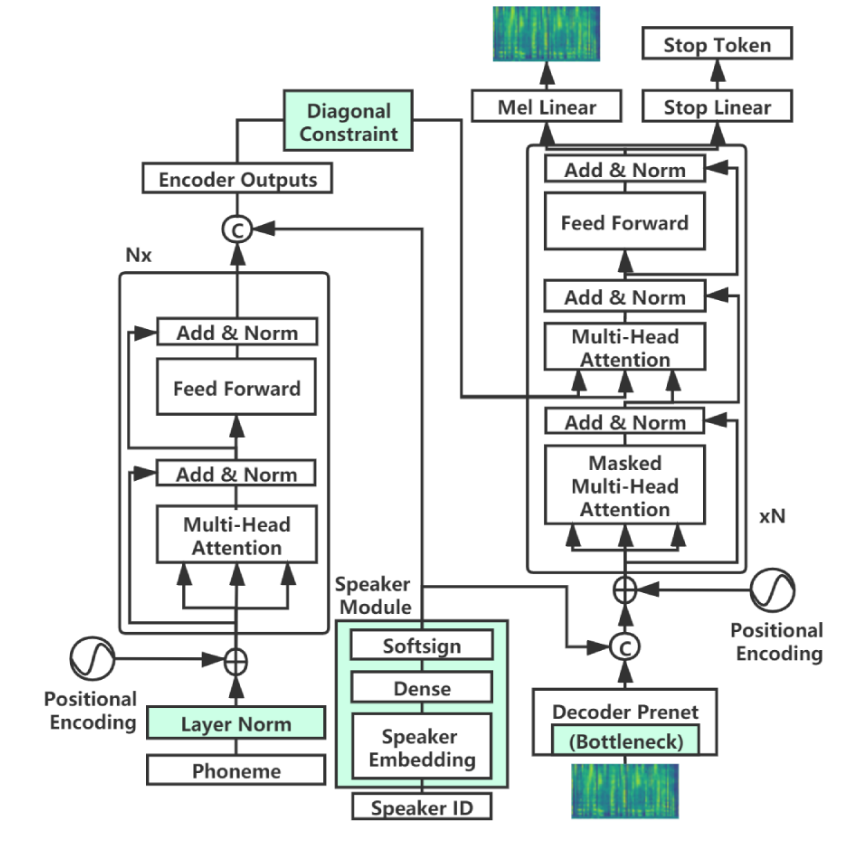

Esta es una implementación de Pytorch de MultiSeCech: texto de múltiples altavoces a discurso con Transformer

Para capacitar al modelo en sus datos, siga los pasos a continuación

speaker_id,audio_path,text,duration

0|file/to/file.wav|the text in that file|3.2

La identificación del altavoz debe ser entera y comienza desde 0

python -m venv env source env/bin/activatepip install -r requirements.txtpython train.py --train_path train_data.txt --test_path test_data.txt --checkpoint_dir outdir --epoch 100 --batch_size 64