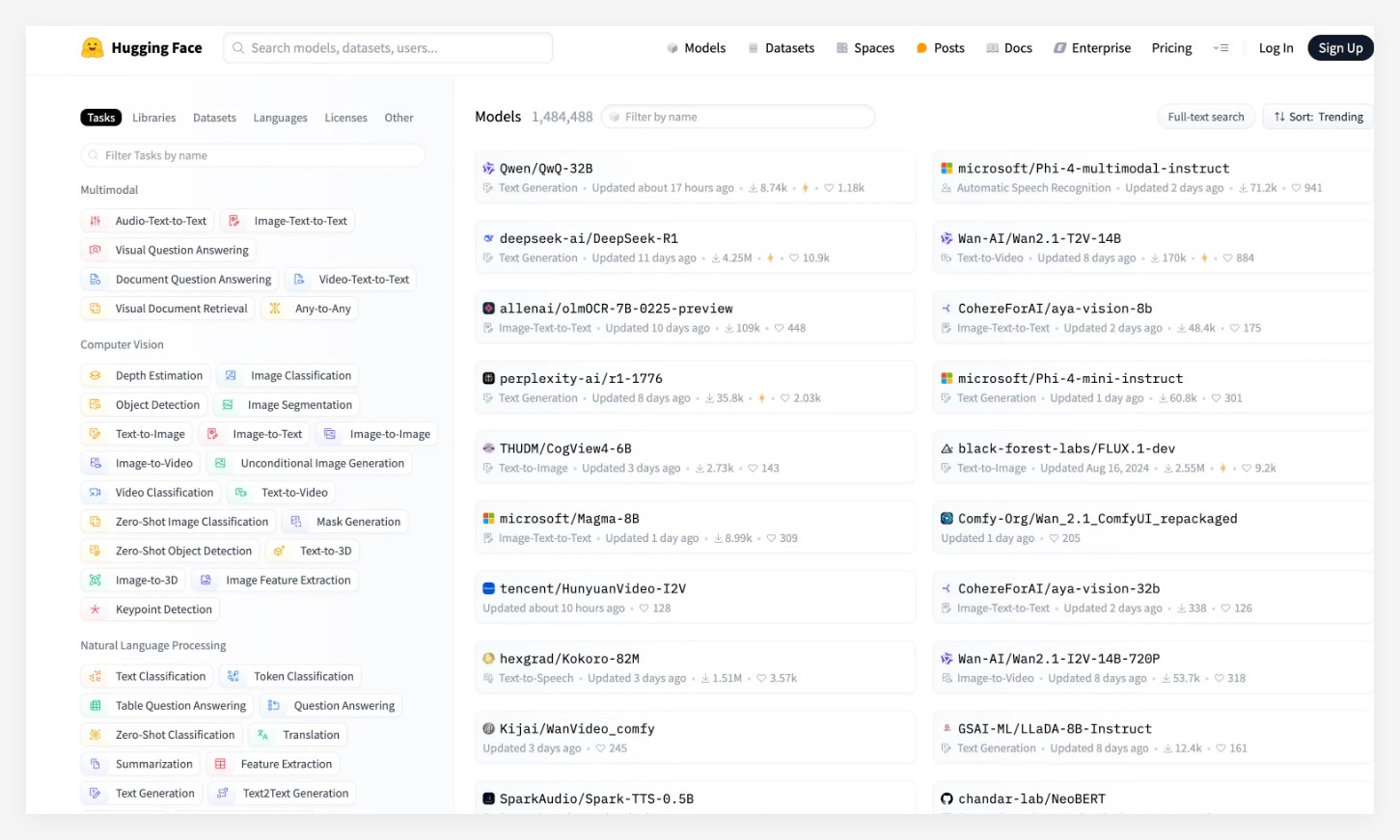

In der neuesten Aktualisierung von Huggingface, der weltweit größten AI-Open-Source-Community, hat Alibaba kürzlich das Tongyi Qianwen Inferenzmodell QWQ-32B erfolgreich den ersten Platz in der großen Modellliste gewonnen. Dieses Modell hat nach seiner Veröffentlichung weit verbreitete Aufmerksamkeit erregt und bekannte Modelle wie Microsofts Phi-4 und Deepseek-R1 übertroffen und eine starke Leistung zeigt.

Das QWQ-32B-Modell hat einen qualitativen Sprung in Mathematik, Codeverarbeitung und allgemeinen Fähigkeiten gemacht, insbesondere in der geringen Anzahl von Parametern, was seine Gesamtleistung mit der von Deepseek-R1 vergleichbar macht. Darüber hinaus ermöglicht das Design dieses Modells Benutzer, lokale Bereitstellungen für Verbrauchergrafikkarten zu implementieren und die Kosten für die Modellanwendung erheblich zu senken. Dieser Durchbruch bietet mehr Benutzern eine bequemere und wirtschaftlichere Auswahl an AI -Anwendungen.

Unter mehreren autoritativen Benchmarks hat das QWQ-32B-Modell sehr gut abschnitten. Dies übertraf fast vollständig die O1-Mini von OpenAI und vergleichbar mit der Leistung von Deepseek-R1. Insbesondere in der AIME24-Bewertung, die für mathematische Fähigkeiten und LivecodeBench-Set eingestellt ist, sind die QWQ-32B-Scores mit Deepseek-R1 vergleichbar, weit vor dem O1-Mini und seinem R1-Destillationsmodell derselben Größe.

Gegenwärtig wurde das QWQ-32B-Modell auf Plattformen wie Modai Community, Huggingface und GitHub basierend auf dem losen Apache2.0-Protokoll offen bezogen. Jeder kann es kostenlos herunterladen und bereitstellen. Gleichzeitig können Benutzer den Modell -API -Service auch direkt über die Bailian -Plattform Alibaba Cloud aufrufen.

Schlüsselpunkte: Das QWQ-32B-Modell steht zuerst auf der HarmgingFace-Liste und übertrifft mehrere bekannte Modelle. Dieses Modell erzielt Durchbrüche in Bezug auf Leistungs- und Anwendungskosten und unterstützt die lokale Bereitstellung von Grafikkarten für Verbraucherqualität. Hervorragende Leistung in mehreren Benchmarks, vergleichbar mit dem stärksten Modell Deepseek-R1.