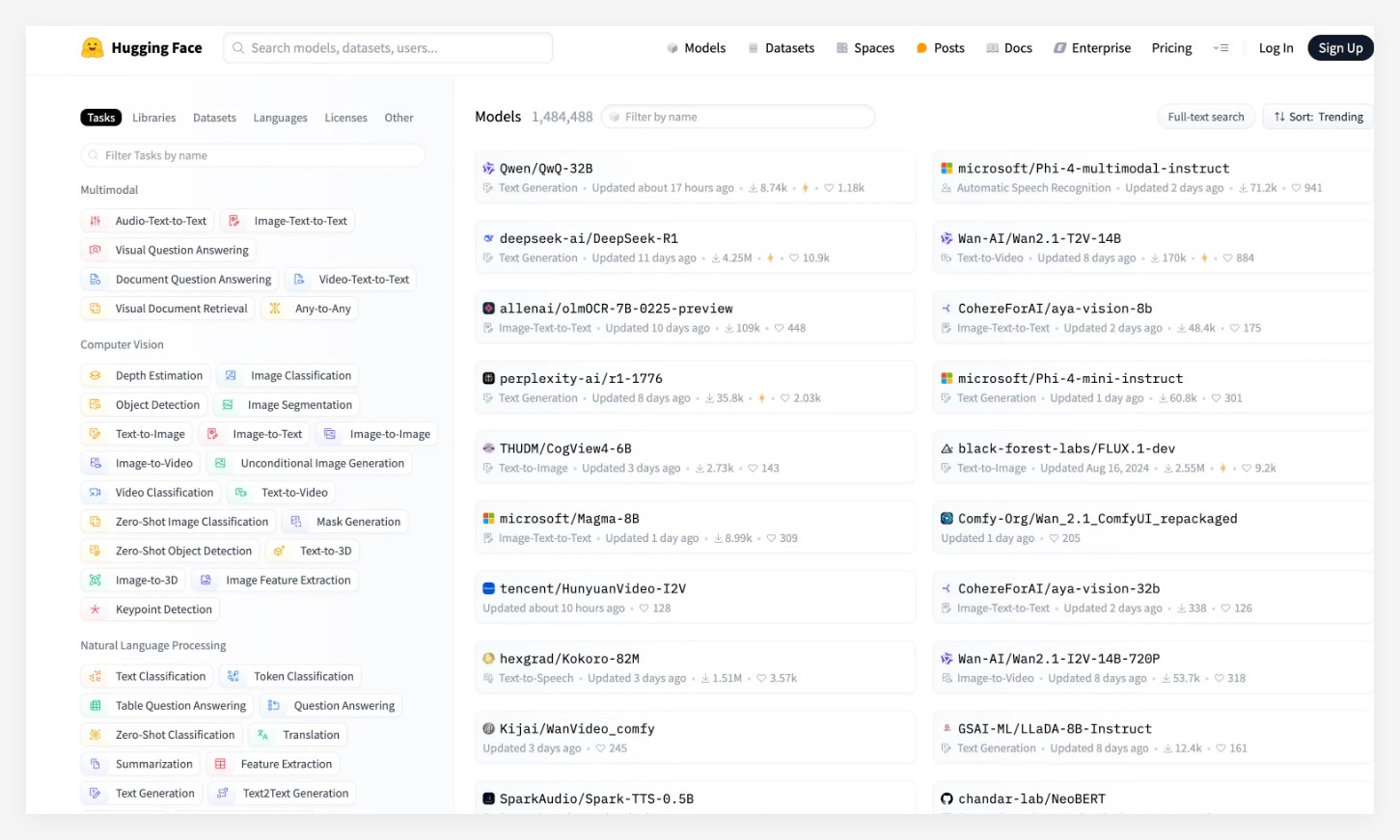

في آخر تحديث لـ Huggingface ، أكبر مجتمع المصدر في العالم ، أطلقت Alibaba مؤخرًا طراز Tongyi Qianwen inference QWQ-32B بنجاح في المركز الأول في قائمة النماذج الكبيرة. اجتذب هذا النموذج اهتمامًا واسع النطاق بعد إصداره ، متجاوزًا النماذج المعروفة مثل Microsoft PHI-4 و Deepseek-R1 ، وإظهار أداء قوي.

حقق نموذج QWQ-32B قفزة نوعية في الرياضيات ومعالجة الكود والقدرات العامة ، وخاصة عدد المعلمات الصغيرة ، مما يجعل أدائها العام مماثلًا لأداء Deepseek-R1. بالإضافة إلى ذلك ، يتيح تصميم هذا النموذج للمستخدمين تنفيذ النشر المحلي على بطاقات رسومات المستهلك ، مما يقلل بشكل كبير من تكلفة تطبيق النموذج. يوفر هذا الاختراق المزيد من المستخدمين مع اختيار تطبيق الذكاء الاصطناعي أكثر ملاءمة واقتصادي.

من بين المعايير الموثوقة المتعددة ، كان أداء طراز QWQ-32B جيدًا للغاية ، حيث تجاوز تقريبًا O1-Mini من Openai وقابل للمقارنة مع أداء Deepseek-R1. لا سيما في تقييم AIME24 المحدد للقدرات الرياضية و LiveCodeBench ، فإن درجات QWQ-32B قابلة للمقارنة مع Deepseek-R1 ، قبل O1-Mini ونموذج التقطير R1 من نفس الحجم.

في الوقت الحاضر ، تم فتح نموذج QWQ-32B على منصات مثل Modai Community و Huggingface و Github استنادًا إلى بروتوكول APACH2.0 فضفاض. يمكن لأي شخص تنزيله ونشره محليًا مجانًا. في الوقت نفسه ، يمكن للمستخدمين أيضًا استدعاء خدمة API Model مباشرة من خلال منصة Alibaba Cloud Pailian.

النقاط الرئيسية: يحتل طراز QWQ-32B المرتبة الأولى في قائمة Huggingface ، متجاوزًا العديد من النماذج المعروفة. يحقق هذا النموذج اختراقات في تكاليف الأداء والتطبيق ، ويدعم النشر المحلي لبطاقات الرسومات على مستوى المستهلك. أداء ممتاز في معايير متعددة ، مماثلة لأقوى نموذج Deepseek-R1.