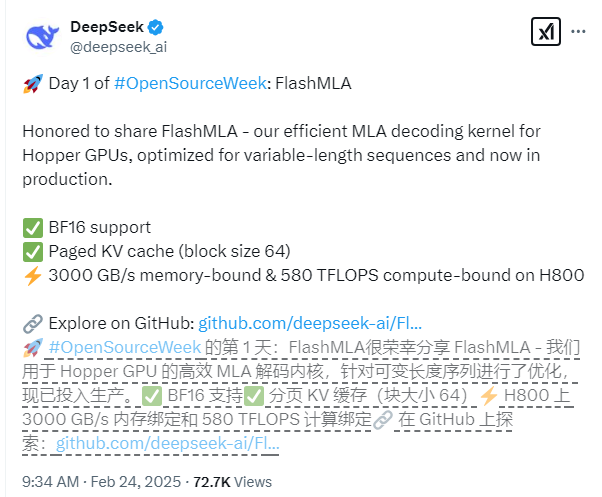

أصدرت Deepseek رسميًا أحدث إنجازات تقنية في اليوم الأول من أسبوع Open Source Week - Flashmla ، وهي عبارة عن نواة لفك تشفير الاهتمام متعدد الطبقات مصممة خصيصًا لعملية معالجة الرسومات المعمارية Nvidia Hopper. تم تحسين هذه التكنولوجيا بشكل خاص لسيناريوهات التسلسل المتغير ، والتي يمكن أن تحسن بشكل كبير من أداء الاستدلال للنماذج الكبيرة ويحقق اختراقات جديدة إلى مجال التعلم العميق.

تتضمن الميزات التقنية الأساسية لـ Flashmla دعمًا شاملاً لدقة BF16 واستخدام نظام ذاكرة التخزين المؤقت KV المليئة بحجم 64 لتحقيق إدارة ذاكرة أكثر دقة. من حيث الأداء ، استنادًا إلى منصة CUDA12.6 ، حققت Flashmla نتائج ملحوظة على H800SXM5GPU: في سيناريوهات المعالجة المقيدة بالذاكرة ، تصل سرعة المعالجة إلى 3000 جيجابايت/ثانية ، وفي السيناريوهات المقيدة بالحوسبة ، يكون مستوى قوة الحوسبة مرتفعًا مثل 580TFLOPs.

اجتاز المشروع التحقق من بيئة الإنتاج ويوضح الاستقرار الممتاز. قال فريق التطوير إن تصميم Flashmla استعار التجربة الممتازة للمشاريع مثل Flashattention2 و 3 و Cutlass ، وعلى هذا الأساس ، حقق اختراقات مبتكرة ، مما أدى إلى تحسين قدراتها على التطبيق في سيناريوهات معقدة.

يمكن للمطورين نشر Flashmla بسرعة مع أوامر تثبيت بسيطة. ما عليك سوى تنفيذ "python setup.py install" لإكمال التثبيت ، وبعد ذلك يمكنك تشغيل البرنامج النصي للاختبار "Python Tests/test_flash_mla.py" لتجربة أدائه الممتاز.

عنوان مفتوح المصدر: https://github.com/deepeek-ai/flashmla