隨著AI生成視訊技術的快速發展,其逼真度已達到難以區分真偽的地步。為應對這項挑戰,哥倫比亞大學的研究人員開發了一種名為DIVID的新工具,用於檢測AI生成的影片。 DIVID是先前用於檢測AI生成文字的Raidar工具的延伸,它透過分析視頻本身的特徵,而非依賴AI模型的內部工作機制,從而有效識別由擴散模型生成的視頻,例如OpenAI的Sora、Runway Gen-2和Pika等。這項研究成果對於打擊深度偽造視頻,維護網路資訊安全具有重要意義。

AI生成的視覺越來越逼真,讓人類(以及現有的偵測系統)難以區分真實影片和假影片。為解決這一問題,哥倫比亞大學工程學院的研究人員,由計算機科學教授楊Junfeng Yang領導,開發了一種名為DIVID新工具,用於檢測AI 生成視頻,全稱為DIffusion-generated VIdeo Detector。 DIVID 是該團隊今年早些時候發布的Raidar 的延伸,Raidar 透過分析文本本身而無需訪問大型語言模型的內部工作原理來檢測AI 生成文本。

DIVID 改進了早期用於檢測生成視訊的方法,有效地識別了由舊的AI 模型(如生成對抗網路GAN)生成的視訊。 GAN 是一種具有兩個神經網路的AI 系統:一個用於創建虛假數據,另一個用於評估以區分真假。透過持續的回饋,兩個網路不斷改進,從而產生非常逼真的合成影片。目前的AI 檢測工具尋找的是一些顯著跡象,例如異常的像素排列、不自然的動作或幀之間的不一致,這在真實影片中通常不會出現。

新一代生成AI 視訊工具,如OpenAI 的Sora、Runway Gen-2和Pika,使用擴散模型創建視訊。擴散模型是一種AI 技術,透過逐漸將隨機雜訊轉換為清晰、逼真的圖片來創建圖像和影片。對於影片來說,它會分別優化每一幀,同時確保平滑過渡,從而產生高品質、逼真的結果。這種日益複雜的AI 生成影片的發展對其真實性的檢測構成了重大挑戰。

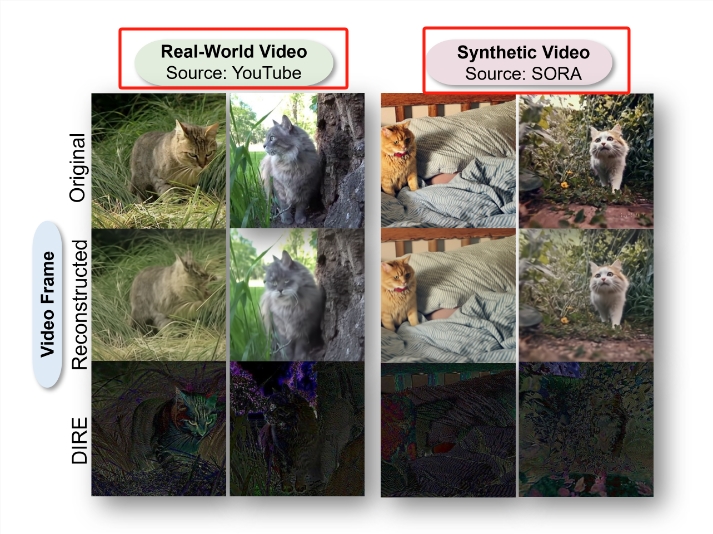

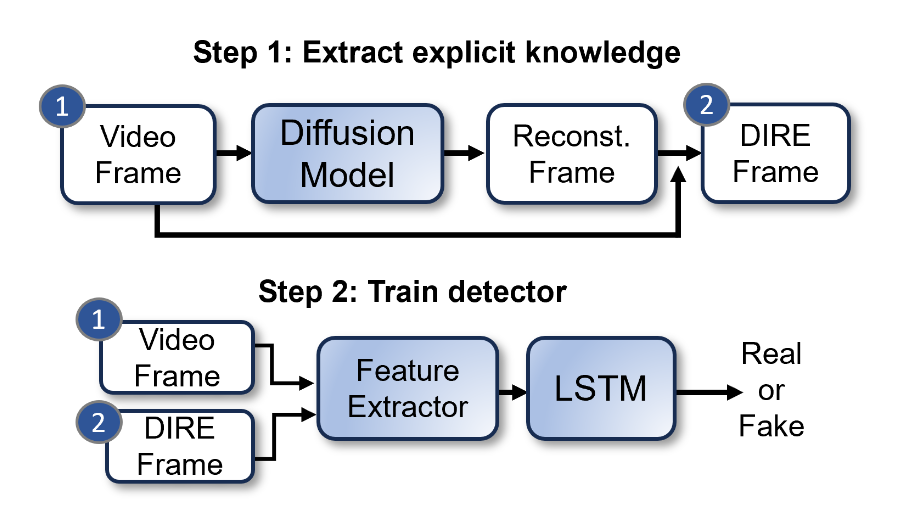

Bernadette Young的團隊使用了一種稱為DIRE(DIffusion Reconstruction Error)的技術來偵測擴散生成的影像。 DIRE 是一種衡量輸入影像與預訓練擴散模型重建的對應輸出影像之間差異的方法。

Junfeng Yang是軟體系統實驗室的共同主任,一直在探索如何檢測AI 生成文字和影片。今年早些時候,隨著Raidar 的發布,Junfeng Yang和合作者透過分析文本本身,無需訪問諸如chatGPT-4、Gemini 或Llama 等大型語言模型的內部工作原理,實現了檢測AI 生成文本的方法。 Raidar 使用語言模型重新表達或修改給定的文本,然後測量系統對給定文本所做的編輯次數。編輯次數多意味著文字可能由人類撰寫,而編輯次數少意味著文字可能是機器生成的。

Junfeng Yang表示:「Raidar 的啟發—— 即另一個AI 通常認為另一個AI 的輸出質量很高,因此它會進行較少的編輯—— 這一洞察力非常強大,不僅限於文本。」他說: “鑑於AI 生成的視頻變得越來越逼真,我們希望藉助Raidar 的洞察力,創建一個可以準確檢測AI 生成視頻的工具。”

研究人員利用相同的概念開發了DIVID。這種新的生成視訊偵測方法可以識別由擴散模型產生的影片。該研究論文於2024年6月18日在西雅圖舉行的電腦視覺與模式識別會議(CVPR)上發表,同時發布了開源程式碼和資料集。

論文網址:https://arxiv.org/abs/2406.09601

劃重點:

- 針對越來越逼真的AI 生成視頻,哥倫比亞大學工程學院的研究人員開發了一種新工具DIVID,可以以93.7% 的準確率檢測AI 生成的視頻。

- DIVID 是對先前的方法的改進,用於檢測新一代生成AI 視頻,它可以識別由擴散模型生成的視頻,這種模型可以逐漸將隨機噪聲轉化為高質量、逼真的視頻圖像。

- 研究人員將從Raidar 的AI 生成文本的洞察力擴展到視頻,利用語言模型對文本或視頻進行重新表述或修改,然後測量系統對文本或視頻所做的編輯次數,從而判斷其真實性。

總之,DIVID 的出現為對抗AI 生成影片的虛假資訊提供了新的武器,其開源程式碼和資料集的發布也將促進該領域未來的研究發展,為建立更安全可靠的網路環境貢獻力量。