Avec le développement rapide de la technologie vidéo générée par l’IA, sa fidélité a atteint un point où il est difficile de distinguer l’authenticité du faux. Pour relever ce défi, des chercheurs de l'Université de Columbia ont développé un nouvel outil appelé DIVID pour détecter les vidéos générées par l'IA. DIVID est une extension de l'outil Raidar qui était auparavant utilisé pour détecter le texte généré par l'IA. Il identifie efficacement les vidéos générées par des modèles de diffusion, tels que Sora et Runway d'OpenAI, en analysant les caractéristiques de la vidéo elle-même plutôt que de s'appuyer sur le fonctionnement interne. mécanisme du modèle AI Gen-2 et Pika et al. Ce résultat de recherche est d’une grande importance pour lutter contre les fausses vidéos et maintenir la sécurité des informations sur les réseaux.

Les vidéos générées par l’IA deviennent de plus en plus réalistes, ce qui rend difficile pour les humains (et les systèmes de détection existants) de distinguer les vraies vidéos des fausses. Pour résoudre ce problème, des chercheurs de la Columbia University School of Engineering, dirigés par le professeur d'informatique Junfeng Yang, ont développé un nouvel outil appelé DIVID pour détecter les vidéos générées par l'IA, qui signifie DIffusion-generated VIdeo Detector. DIVID est une extension de Raidar, que l'équipe a publiée plus tôt cette année, qui détecte le texte généré par l'IA en analysant le texte lui-même sans accéder au fonctionnement interne d'un grand modèle de langage.

DIVID améliore les méthodes antérieures de détection des vidéos générées, en identifiant efficacement les vidéos générées par d'anciens modèles d'IA tels que les réseaux contradictoires génératifs (GAN). Un GAN est un système d'IA avec deux réseaux de neurones : l'un utilisé pour créer de fausses données et un autre utilisé pour évaluer et distinguer les données réelles des fausses données. Grâce à un feedback continu, les deux réseaux s'améliorent continuellement, ce qui donne lieu à des vidéos synthétiques très réalistes. Les outils de détection d’IA actuels recherchent des signes révélateurs tels que des dispositions inhabituelles de pixels, des mouvements non naturels ou des incohérences entre les images, qui n’apparaissent généralement pas dans une vidéo réelle.

Une nouvelle génération d'outils vidéo d'IA générative, tels que Sora, Runway Gen-2 et Pika d'OpenAI, utilisent des modèles de diffusion pour créer des vidéos. La modélisation de diffusion est une technologie d'IA qui crée des images et des vidéos en convertissant progressivement le bruit aléatoire en images claires et réalistes. Pour les vidéos, il optimise chaque image individuellement tout en garantissant des transitions fluides, ce qui donne des résultats réalistes de haute qualité. Le développement de cette vidéo générée par l’IA de plus en plus complexe pose un défi important pour la détection de son authenticité.

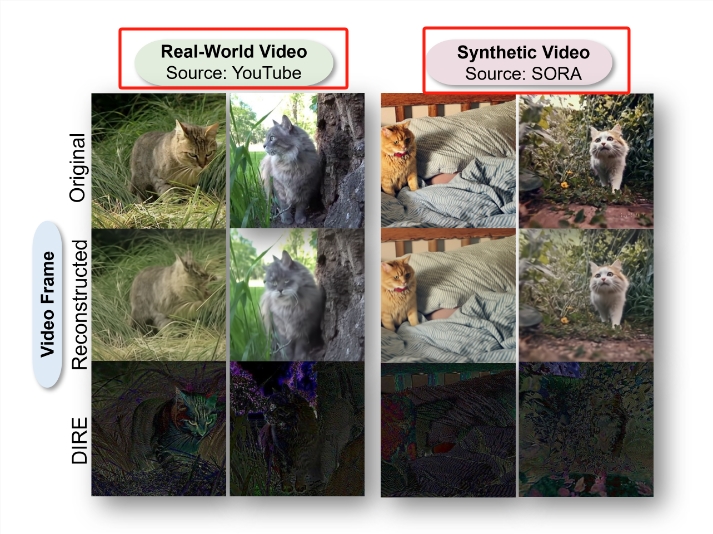

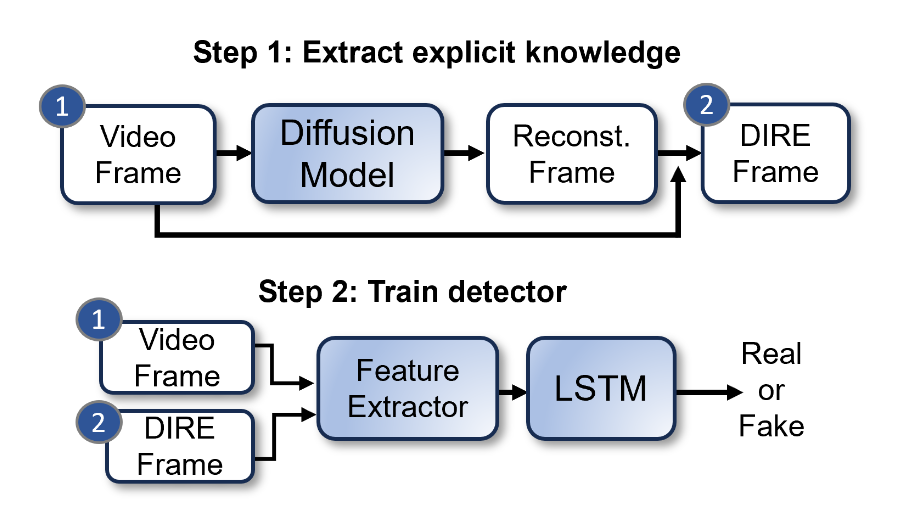

L'équipe de Bernadette Young a utilisé une technique appelée DIRE (DIffusion Reconstruction Error) pour détecter les images générées par diffusion. DIRE est une méthode qui mesure la différence entre une image d'entrée et l'image de sortie correspondante reconstruite par un modèle de diffusion pré-entraîné.

Junfeng Yang, codirecteur du Software Systems Lab, a étudié comment détecter le texte et la vidéo générés par l'IA. Avec la sortie de Raidar plus tôt cette année, Junfeng Yang et ses collaborateurs ont mis en œuvre une méthode permettant de détecter le texte généré par l'IA en analysant le texte lui-même, sans accéder au fonctionnement interne de grands modèles de langage tels que chatGPT-4, Gemini ou Llama. Raidar utilise un modèle de langage pour reformuler ou modifier un texte donné, puis mesure le nombre de modifications apportées par le système au texte donné. Un nombre élevé de modifications signifie que le texte a probablement été écrit par un humain, tandis qu'un faible nombre de modifications signifie que le texte a probablement été généré par une machine.

"L'heuristique de Raidar - selon laquelle une autre IA perçoit généralement la sortie d'une autre IA comme étant de haute qualité, donc elle effectue moins de modifications - est une idée très puissante, qui ne se limite pas au texte", a déclaré Junfeng Yang. Il a déclaré : "Étant donné que l'IA est générée. les vidéos deviennent de plus en plus réalistes, nous voulions utiliser les connaissances de Raidar pour créer un outil capable de détecter avec précision les vidéos générées par l'IA.

Les chercheurs ont développé DIVID en utilisant le même concept. Cette nouvelle méthode de détection vidéo générative permet d'identifier les vidéos générées par des modèles de diffusion. Le document de recherche a été publié lors de la Computer Vision and Pattern Recognition Conference (CVPR) à Seattle le 18 juin 2024, et le code open source et l'ensemble de données ont été publiés en même temps.

Adresse papier : https://arxiv.org/abs/2406.09601

Souligner:

- En réponse aux vidéos générées par l'IA de plus en plus réalistes, des chercheurs de la Columbia University School of Engineering ont développé un nouvel outil, DIVID, capable de détecter les vidéos générées par l'IA avec une précision de 93,7 %.

- DIVID est une amélioration par rapport aux méthodes précédentes de détection d'une nouvelle génération de vidéos IA générées, qui peuvent identifier les vidéos générées par un modèle de diffusion qui transforme progressivement le bruit aléatoire en images vidéo réalistes de haute qualité.

- Les chercheurs étendent les connaissances du texte généré par l'IA de Raidar à la vidéo, en utilisant des modèles linguistiques pour reformuler ou modifier le texte ou la vidéo, puis mesurer le nombre de modifications apportées par le système au texte ou à la vidéo pour déterminer son authenticité.

En bref, l'émergence de DIVID fournit une nouvelle arme pour lutter contre les fausses informations dans les vidéos générées par l'IA. La publication de son code open source et de ses ensembles de données favorisera également les futures recherches et développements dans ce domaine et contribuera à la construction d'un système plus sûr et plus fiable. environnement réseau.