*****我們團隊的新後續研究可通過https://github.com/rlawjdghek/stableviton *****獲得

Viton-HD:高分辨率虛擬試驗通過未對準歸一化

Seunghwan Choi* 1 ,Sunghyun Park* 1 ,Minsoo Lee* 1 ,Jaegul Choo 1

1 kaist

在CVPR 2021中。 (*表示同等的貢獻)

論文:https://arxiv.org/abs/2103.16874

項目頁面:https://psh01087.github.io/viton-hd

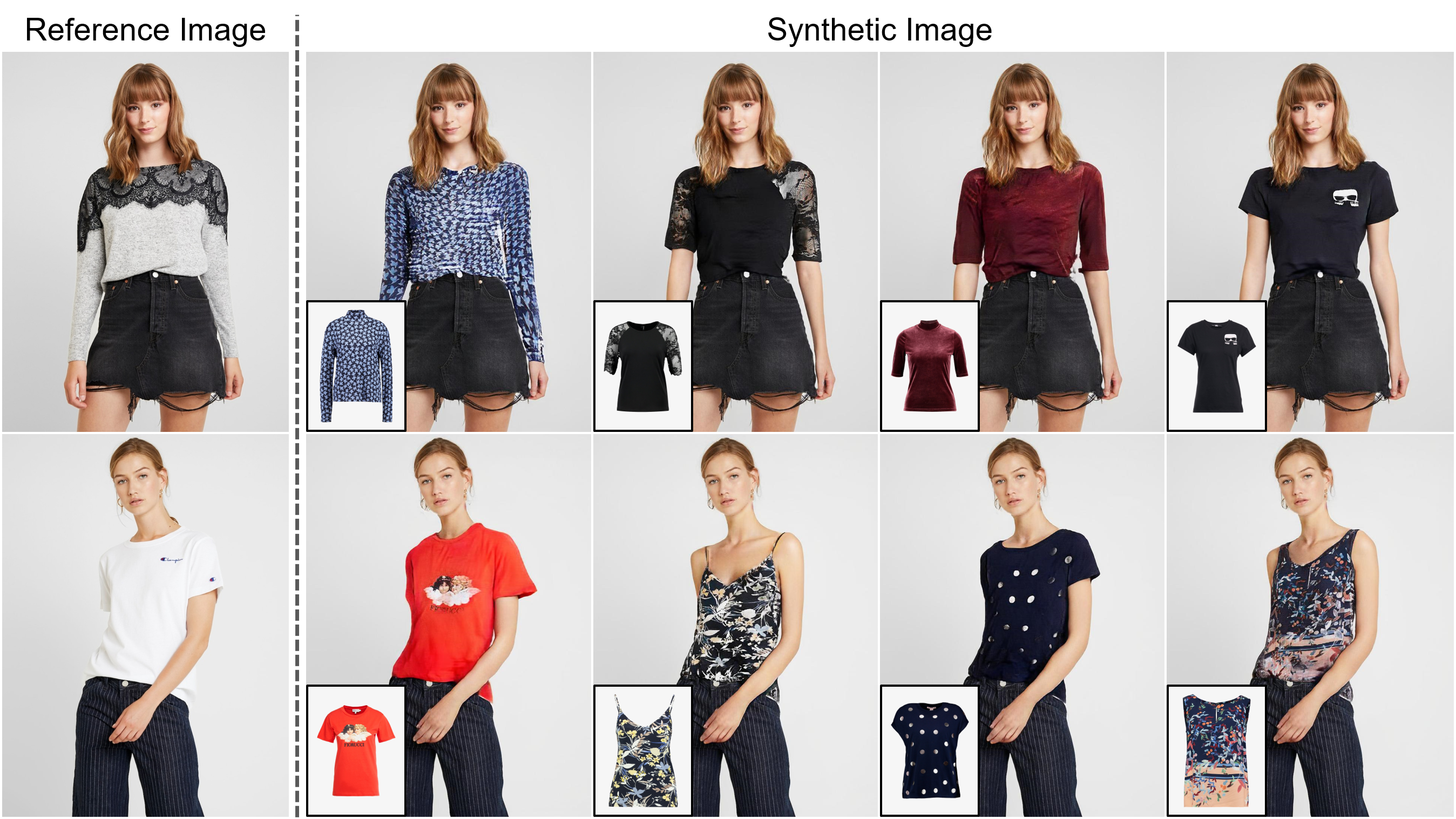

摘要:基於圖像的虛擬試驗的任務旨在將目標服裝項目轉移到一個人的相應區域,通常通過將項目安裝到所需的身體部位並將扭曲的物品與人融合來解決。儘管已經進行了越來越多的研究,但合成圖像的分辨率仍然僅限於低(例如,256x192),這是對滿足在線消費者的關鍵限制。我們認為,限制源於幾個挑戰:隨著決議的增加,扭曲的衣服和所需服裝區域之間未對準的區域中的偽影在最終結果中變得顯著;現有方法中使用的體系結構在產生高質量的身體部位並保持衣服的質地清晰度方面具有較低的性能。為了應對挑戰,我們提出了一種稱為Viton-HD的新型虛擬試驗方法,該方法成功合成了1024x768虛擬試驗圖像。具體來說,我們首先準備分割圖以指導我們的虛擬試驗合成,然後將目標服裝項目大致適合給定人的身體。接下來,我們提出對齊感知細分市場(別名)標準化和別名發生器,以處理未對準的區域並保留1024x768輸入的細節。通過與現有方法進行嚴格的比較,我們證明Viton-HD在定性和定量上都在合成的圖像質量方面高度超過基準。

我們的團隊的ECCV 2022論文(後續研究):https://github.com/sangyun884/hr-viton預處理代碼https://github.com/sangyun884848484/hr-viton。

克隆這個存儲庫:

git clone https://github.com/shadow2496/VITON-HD.git

cd ./VITON-HD/

安裝Pytorch和其他依賴關係:

conda create -y -n [ENV] python=3.8

conda activate [ENV]

conda install -y pytorch=[>=1.6.0] torchvision cudatoolkit=[>=9.2] -c pytorch

pip install opencv-python torchgeometry

我們僅出於我們的研究目的收集了1024 x 768虛擬試驗數據集。您可以從Viton-HD Dropbox下載預處理數據集。正面的女人和頂部服裝圖像對分別分為訓練和測試套,分別為11,647和2,032對。

我們提供預先訓練的網絡和測試數據集的示例圖像。請下載*.pkl並從Viton-HD Google Drive文件夾和UNZIP *.zip文件中測試圖像。 test.py假設下載的文件放在./checkpoints/和./datasets/目錄中。

要生成虛擬的嘗試圖像,請運行:

CUDA_VISIBLE_DEVICES=[GPU_ID] python test.py --name [NAME]

結果保存在./results/ Results/目錄中。您可以通過指定--save_dir參數來更改位置。要使用不同對的人和服裝項目綜合虛擬的嘗試圖像,請編輯./datasets/test_pairs.txt並運行同一命令。

所有材料均在NC 4.0的Creative Commons下提供。只要您引用我們的論文並指出您所做的任何更改,您就可以將材料用於非商業目的的材料來使用,重新分配和調整材料。

如果您發現這項工作對您的研究有用,請引用我們的論文:

@inproceedings{choi2021viton,

title={VITON-HD: High-Resolution Virtual Try-On via Misalignment-Aware Normalization},

author={Choi, Seunghwan and Park, Sunghyun and Lee, Minsoo and Choo, Jaegul},

booktitle={Proc. of the IEEE conference on computer vision and pattern recognition (CVPR)},

year={2021}

}