podfai

该应用程序允许用户根据提供的文件以播客的方式创建内容。一些示例将提供论文,演讲,项目描述,个人简历或其他许多例子。

我还写了一篇博客文章来讨论这个项目,请确保检查“如何使用生成AI来创建任何输入中的播客风格的内容”。

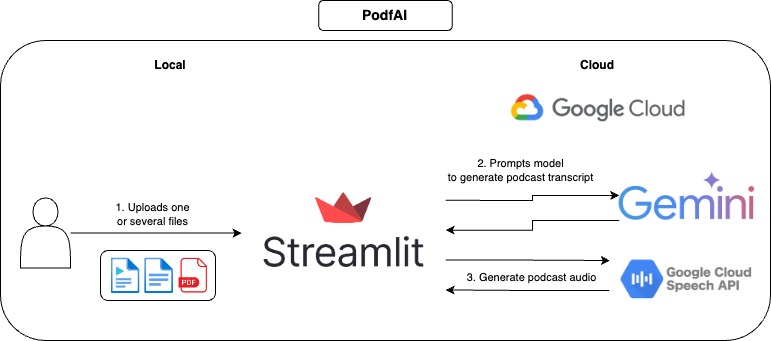

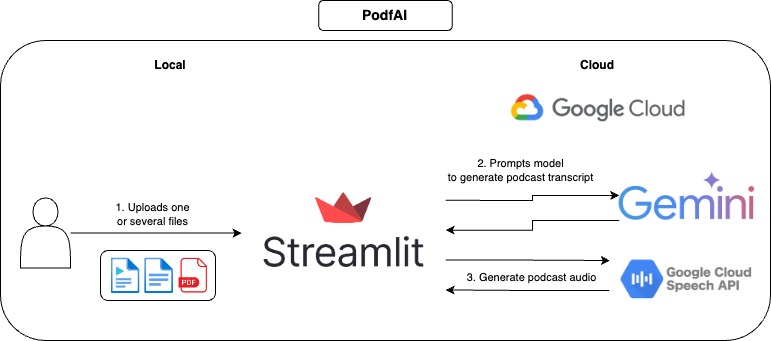

它如何工作

如何使用

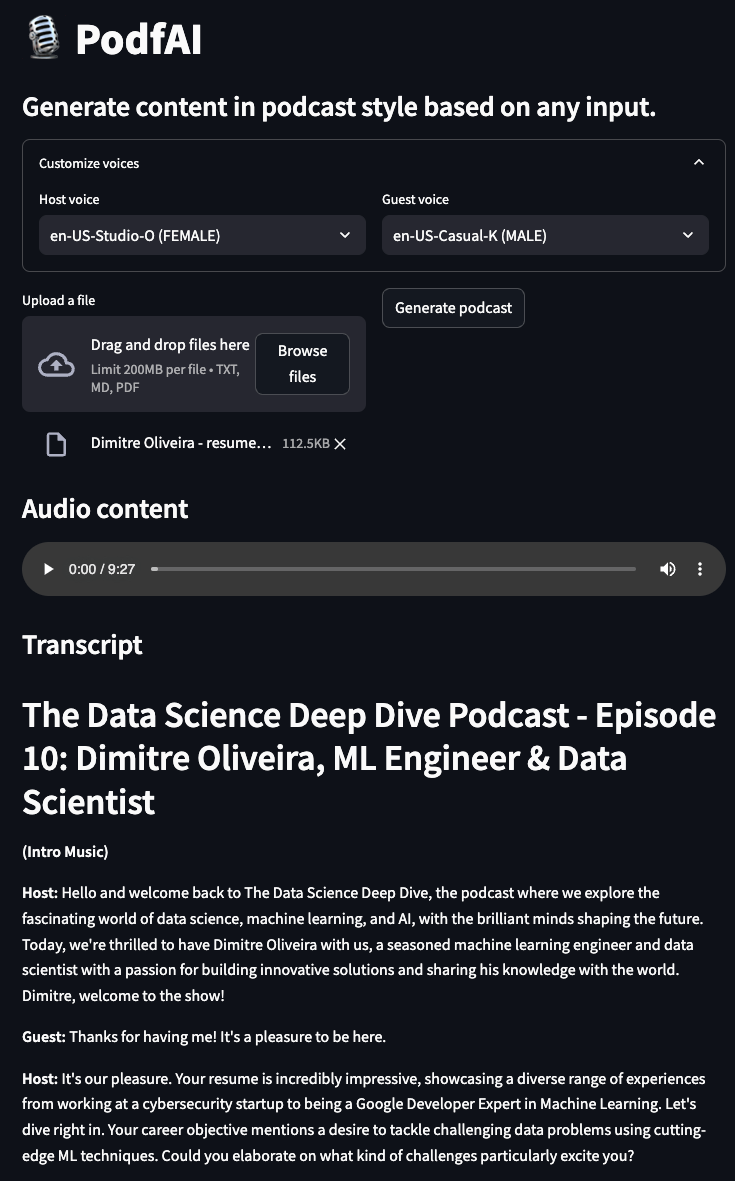

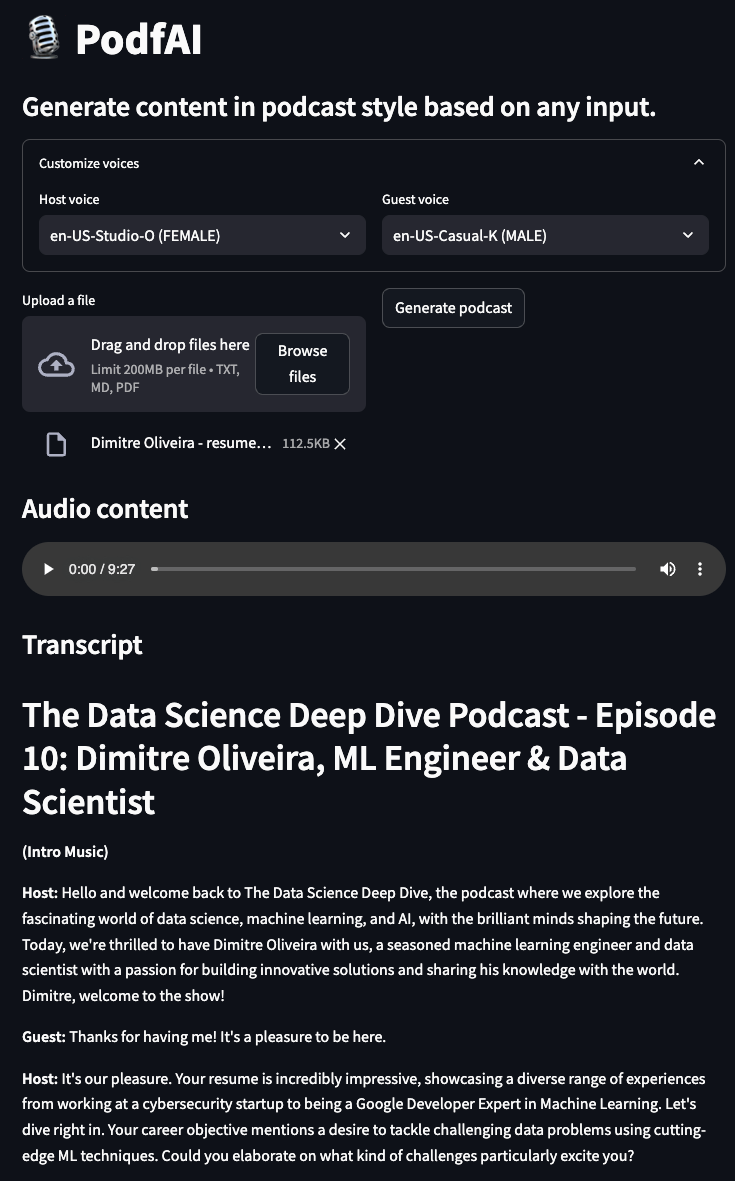

- 提供一个或多个文件。

- 可选地,自定义来宾和主机的声音,您可以在此处查看语音样本。

- 单击“生成播客”,然后等待片刻。

- 播放音频,并随意遵循文字成绩单。

例子

播客从我的另一个项目“ AI Beats”中产生

PODCAST-AI_BEAST.MP4

播客从我的另一个项目“ AI预告片”中产生

PODCAST-AI_TRAILER.MP4

播客从安德鲁·休伯曼(Andrew Huberman)的“最佳凌晨”描述中产生

播客Andrew_hubermans.mp4

播客通过个人简历生成

播客-Cresume.mp4

本地用法

设置

- 克隆GitHub存储库

https://github.com/dimitreOliveira/PodfAI.git

cd PodfAI

- 创建一个新的VENV

python -m venv .venvs/podfai

- 激活VENV

source .venvs/podfai/bin/activate

- 安装要求

另外,您也可以使用pip运行

pip install -r requirements

- 设置Google API依赖关系

运行该应用程序

要启动应用程序,请在下面运行make命令

另外,您也可以使用普通Python运行

streamlit run src / app . py

配置

随意更改默认配置以更改应用程序行为或适应您的需求。

vertex:

project: {VERTEX_AI_PROJECT}

location: {VERTEX_AI_LOCATION}

transcript:

model_id: gemini-1.5-pro-002

transcript_len: 5000

max_output_tokens: 8192

temperature: 1

top_p: 0.95

top_k: 32

- 顶点

- 项目: Vertex AI使用的项目名称。

- 位置: Vertex AI使用的项目位置。

- 成绩单

- Model_ID:用于创建播客成绩单的模型。

- Transcript_len:建议的转录本长度。

- MAX_OUTPUT_TOKENS:模型生成的最大令牌数量。

- 温度:温度控制令牌选择中的随机程度。较低的温度适合期望真正或正确反应的提示,而较高的温度会导致更多样化或意外的结果。温度为0,总是选择最高的概率令牌

- TOP_P: TOP-P会更改模型为输出选择令牌的方式。从最可能到最低的可能性,直到其概率之和等于顶级P值之前,代币是最少的。例如,如果令牌A,B和C的概率为.3,.2和.1,并且TOP-P值为0.5,则模型将选择A或B作为下一个令牌(使用温度)

- TOP_K: TOP-K会更改模型选择令牌以进行输出。 1的顶部为1表示选定的令牌是模型词汇中所有令牌中最可能的令牌(也称为贪婪解码),而3个top-k表示下一代币是从3个最可能的令牌中选择的下一个标记(使用温度)。

托多

- 支持语音克隆

- 支持其他语言

- 支持其他输入类型(图像,视频,YouTube URL)

- 添加示例笔记本以在Colab中运行

- 使用开源型号复制工作流程

- 实验代理工作流程以改进播客笔录

参考

- Google Cloud-文本到语音客户库库

- 在本地设置Google Cloud TTS

- Google Cloud TTS语音列表

贡献

如果您有兴趣为该项目做出贡献,请非常感谢!在创建PR之前,请确保提交代码,以下运行以下命令:

致谢

- 为此项目提供了Google云积分。由于Google的ML开发人员计划团队的支持,这项项目可以实现。

- 该项目基于Google的NotebookLM,除了播客风格的内容外,它具有许多其他功能,请确保检查一下。