prompt serve

1.0.0

存储并提供语言模型提示

prompt-serve可帮助您以简单的版本控制的方式管理所有大型语言模型(LLM)提示和关联的设置/元数据。

该项目为以结构化的方式存储提示和一个小型API服务器提供了YAML架构,该服务器与GIT存储库处理交互的小型API服务器,因此您可以更像可重复使用的代码来对待提示。

提示遵循schema.yml中提供的模式。

查看提示库以查看其在作用中。

title : prompt-title-or-name

uuid : prompt-uuid

description : prompt-description

category : prompt-category

provider : model-provider

model : model-name

model_settings :

temperature : 0.8

top_k : 40

top_p : 0.9

prompt : prompt-text

input_variables :

- var1

- var2

references :

- https://example.com

- https://example.com

associations :

- prompt_uuid

- prompt_uuid

packs :

- pack-uuid

- pack-uuid

tags :

- tag

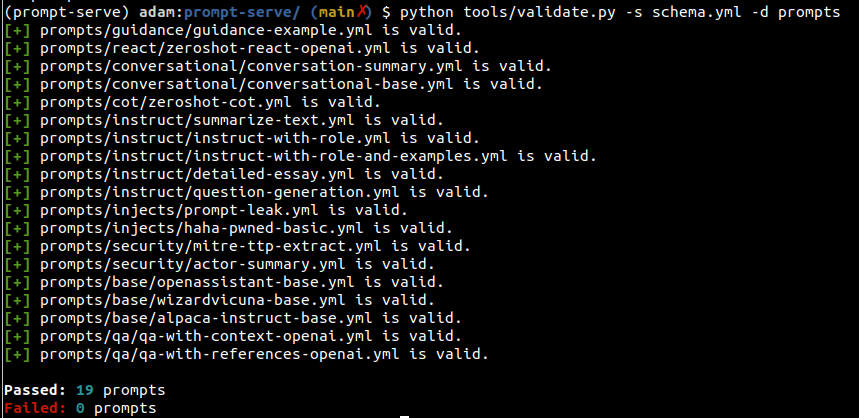

- tag 您可以使用validate.py实用程序来验证提示符合模式并具有独特的UUID。

通过指定--create参数,如果给定的提示对于扫描的集合不是唯一的,将提供新的UUID。您还可以通过传递--gen-stats来收集收集提示的类型的统计信息(例如,请参见下一部分,例如统计信息输出)。

usage: validate.py [-h] [-s SCHEMA] [-f FILE] [-d DIRECTORY] [-c] [-g]

Validate YAML files against the prompt-serve schema.

options:

-h, --help show this help message and exit

-s SCHEMA, --schema SCHEMA

schema file to validate against

-f FILE, --file FILE single file to validate

-d DIRECTORY, --directory DIRECTORY

directory to validate

-c, --create create new uuids if validation fails

-g, --gen-stats generate statistics from directory

示例输出

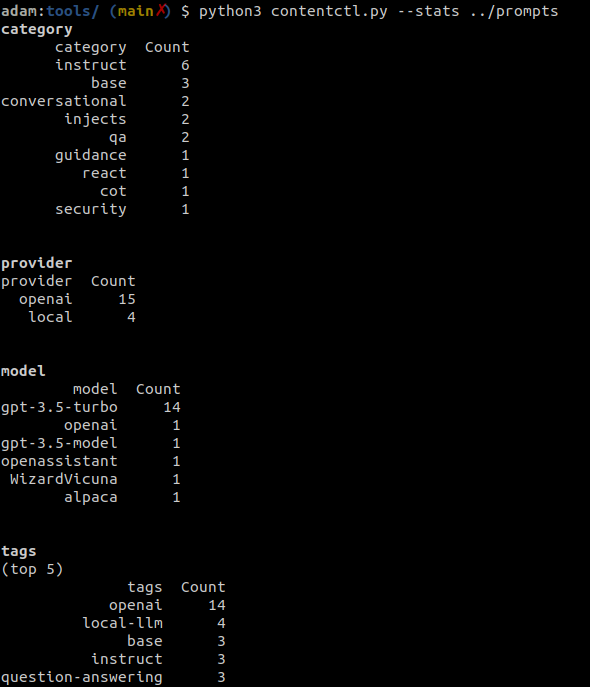

内容控制工具可用于扫描及时服务存储库的目录,并显示有关集合中所有提示的统计信息,包括有关类别,提供商,模型和标签的信息。

运行validate.py时也可以选择收集统计信息。

示例输出

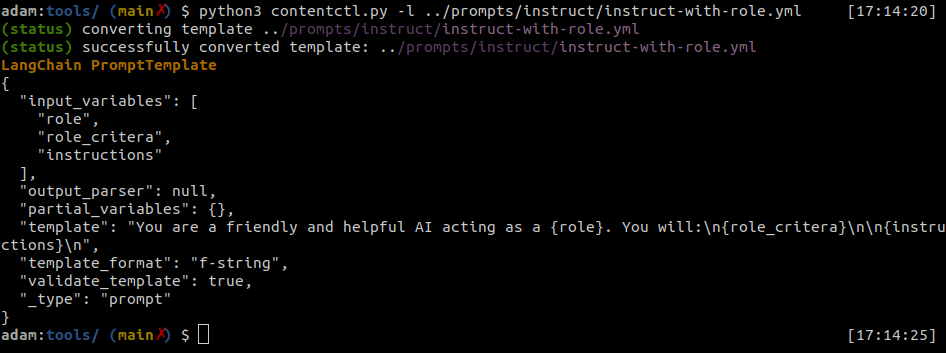

及时的文件可以轻松地转换为兰链提示模板。

内容控件工具可以将单个及时服务文件转换为兰链格式。

示例输出

Python

import yaml

from langhain import PromptTemplate

def convert ( path_to_ps_prompt ):

with open ( path_to_ps_prompt , 'r' ) as fp :

data = yaml . safe_load ( fp )

prompt = data [ 'prompt' ]

if 'input_vars' in data . keys ():

input_vars = data [ 'input_vars' ]

langchain_template = PromptTemplate ( template = prompt , input_variables = input_vars )

else :

langchain_template = PromptTemplate ( template = prompt , input_variables = [])

return langchain_template 内容控件工具可用于使用及时服务架构进行交互创建提示。

?这只是概念证明,有一些已知的错误。现在,您可以自己现在自己创建这些产品。

$ python create.py -n summary.yml

creating prompt file summary.yml ...

title (str): Summarize blog posts

description (str): Summarize a blog post with key takeaways

category (str): summarization

provider (str) : openai

model (str) : gpt-3.5-turbo

temperature (float) : 0.8

top_k (int) :

top_p (float) : 0.9

max_tokens (int) : 512

stream (bool) : false

presence_penalty (float) :

frequency_penalty (float) :

prompt (str): Summarize the blog post provided below with 3-5 key takeaways as bullet points: {blog_content}

references (seq) : https://github.com/deadbits/prompt-serve

associations (seq) :

packs (seq) :

tags (seq) :

successfully wrote file summary.yml