言語モデルのプロンプトを保存して提供します

prompt-serveすべての大規模な言語モデル(LLM)プロンプトと関連する設定/メタデータを簡単にバージョン制御する方法で管理するのに役立ちます。

このプロジェクトは、構造化された方法でプロンプトを保存するためのYAMLスキーマと、GITリポジトリとの相互作用を処理する小さなAPIサーバーを提供するため、再利用可能なコードのようにプロンプトをより扱うことができます。

プロンプトは、schema.ymlで提供されるスキーマに従います。

プロンプトリポジトリをチェックして、動作中のリポジトリを確認してください。

title : prompt-title-or-name

uuid : prompt-uuid

description : prompt-description

category : prompt-category

provider : model-provider

model : model-name

model_settings :

temperature : 0.8

top_k : 40

top_p : 0.9

prompt : prompt-text

input_variables :

- var1

- var2

references :

- https://example.com

- https://example.com

associations :

- prompt_uuid

- prompt_uuid

packs :

- pack-uuid

- pack-uuid

tags :

- tag

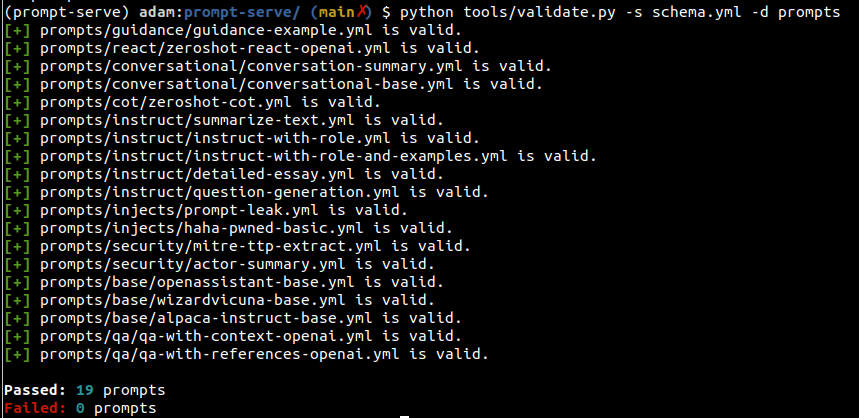

- tag Validate.pyユーティリティを使用して、スキーマを満たし、一意のUUIDを使用するプロンプトを確認できます。

--create引数を指定することにより、特定のプロンプトがスキャンセットに一意でない場合、新しいUUIDが提供されます。また、コレクションの--gen-statsの種類に関する統計を収集することもできます。

usage: validate.py [-h] [-s SCHEMA] [-f FILE] [-d DIRECTORY] [-c] [-g]

Validate YAML files against the prompt-serve schema.

options:

-h, --help show this help message and exit

-s SCHEMA, --schema SCHEMA

schema file to validate against

-f FILE, --file FILE single file to validate

-d DIRECTORY, --directory DIRECTORY

directory to validate

-c, --create create new uuids if validation fails

-g, --gen-stats generate statistics from directory

出力の例

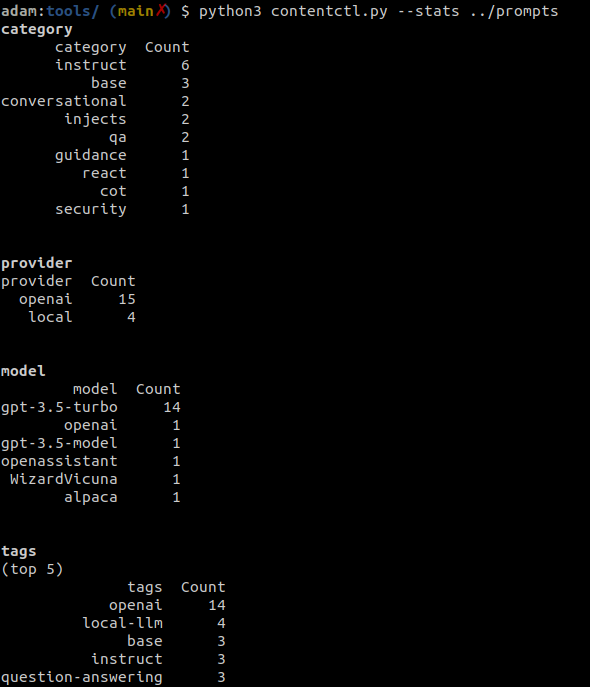

コンテンツ制御ツールを使用して、プロンプトサービスリポジトリのディレクトリをスキャンし、カテゴリ、プロバイダー、モデル、タグに関する情報など、コレクション内のすべてのプロンプトに関する統計を表示できます。

statは、validate.pyを実行するときにオプションで収集することもできます。

出力の例

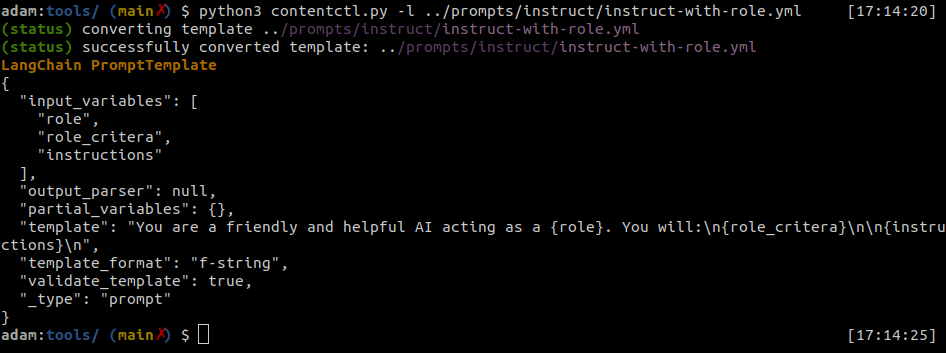

プロンプトサービスファイルは、Langchainプロンプトテンプレートに簡単に変換できます。

コンテンツ制御ツールは、個々のプロンプトサービスファイルをLangchain形式に変換できます。

出力の例

Python

import yaml

from langhain import PromptTemplate

def convert ( path_to_ps_prompt ):

with open ( path_to_ps_prompt , 'r' ) as fp :

data = yaml . safe_load ( fp )

prompt = data [ 'prompt' ]

if 'input_vars' in data . keys ():

input_vars = data [ 'input_vars' ]

langchain_template = PromptTemplate ( template = prompt , input_variables = input_vars )

else :

langchain_template = PromptTemplate ( template = prompt , input_variables = [])

return langchain_template コンテンツ制御ツールを使用して、プロンプトサービススキーマを使用してインタラクティブなプロンプトを作成できます。

?これは単なる概念の証明であり、いくつかの既知のバグがあります。今のところ、これらを独自に作成する方が良いでしょう。

$ python create.py -n summary.yml

creating prompt file summary.yml ...

title (str): Summarize blog posts

description (str): Summarize a blog post with key takeaways

category (str): summarization

provider (str) : openai

model (str) : gpt-3.5-turbo

temperature (float) : 0.8

top_k (int) :

top_p (float) : 0.9

max_tokens (int) : 512

stream (bool) : false

presence_penalty (float) :

frequency_penalty (float) :

prompt (str): Summarize the blog post provided below with 3-5 key takeaways as bullet points: {blog_content}

references (seq) : https://github.com/deadbits/prompt-serve

associations (seq) :

packs (seq) :

tags (seq) :

successfully wrote file summary.yml