armazenar e servir os avisos do modelo de idioma

prompt-serve ajuda a gerenciar todos os seus avisos de Modelo de Linguagem Grande (LLM) e configurações/metadados associados de maneira direta e controlada por versão.

Este projeto fornece um esquema YAML para armazenar prompts de maneira estruturada e um pequeno servidor de API que lida com interações com um repositório Git, para que você possa tratar os avisos mais como o código reutilizável.

Os avisos seguem o esquema fornecido em schema.yml.

Confira o repositório de prompts para vê -lo em ação.

title : prompt-title-or-name

uuid : prompt-uuid

description : prompt-description

category : prompt-category

provider : model-provider

model : model-name

model_settings :

temperature : 0.8

top_k : 40

top_p : 0.9

prompt : prompt-text

input_variables :

- var1

- var2

references :

- https://example.com

- https://example.com

associations :

- prompt_uuid

- prompt_uuid

packs :

- pack-uuid

- pack-uuid

tags :

- tag

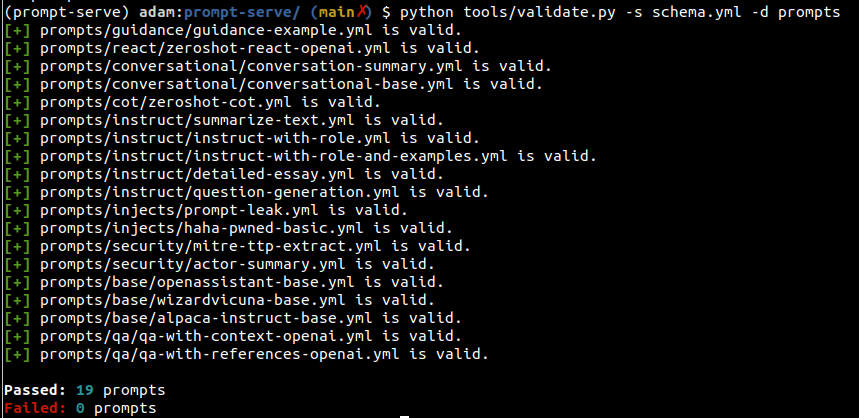

- tag Você pode usar o utilitário validate.py para verificar os avisos do esquema e ter UUIDs exclusivos.

Ao especificar o argumento --create , um novo UUID será fornecido se um determinado prompt não for exclusivo para o seu conjunto digitalizado. Você também pode reunir estatísticas sobre os tipos de instruções em sua coleção passando --gen-stats (consulte a próxima seção, por exemplo, saída de estatísticas).

usage: validate.py [-h] [-s SCHEMA] [-f FILE] [-d DIRECTORY] [-c] [-g]

Validate YAML files against the prompt-serve schema.

options:

-h, --help show this help message and exit

-s SCHEMA, --schema SCHEMA

schema file to validate against

-f FILE, --file FILE single file to validate

-d DIRECTORY, --directory DIRECTORY

directory to validate

-c, --create create new uuids if validation fails

-g, --gen-stats generate statistics from directory

Exemplo de saída

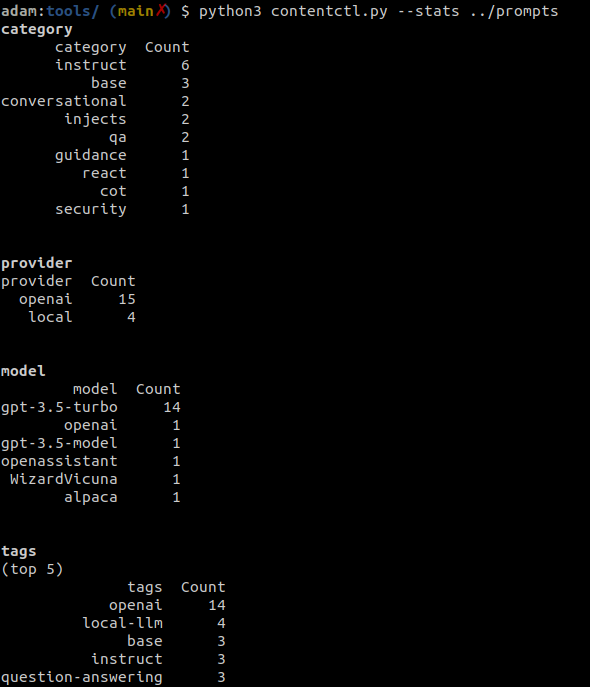

A ferramenta de controle de conteúdo pode ser usada para digitalizar um diretório de repositório de pront-serve e exibir estatísticas sobre todos os avisos da coleção, incluindo informações sobre a categoria, provedor, modelo e tags.

As estatísticas também podem ser opcionalmente coletadas ao executar o validate.py.

Exemplo de saída

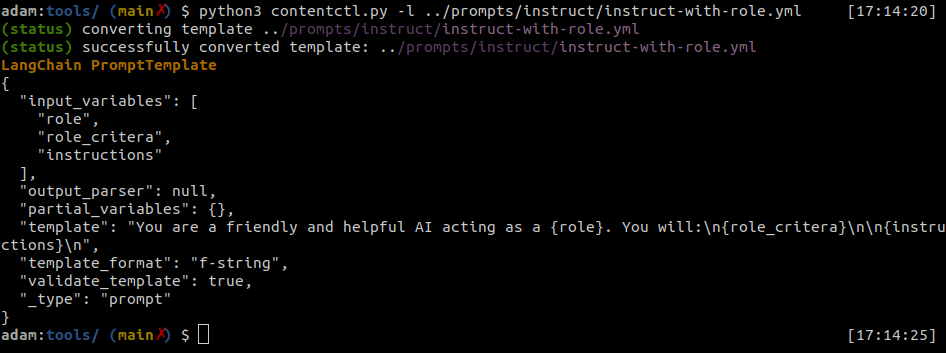

Os arquivos de serviço de prompt podem ser facilmente convertidos em modelos de prompt de Langchain.

A ferramenta de controle de conteúdo pode converter arquivos de serviço prompt individual em formato Langchain.

Exemplo de saída

Python

import yaml

from langhain import PromptTemplate

def convert ( path_to_ps_prompt ):

with open ( path_to_ps_prompt , 'r' ) as fp :

data = yaml . safe_load ( fp )

prompt = data [ 'prompt' ]

if 'input_vars' in data . keys ():

input_vars = data [ 'input_vars' ]

langchain_template = PromptTemplate ( template = prompt , input_variables = input_vars )

else :

langchain_template = PromptTemplate ( template = prompt , input_variables = [])

return langchain_template A ferramenta de controle de conteúdo pode ser usada para criar interativamente um prompt com o esquema de serviço rápido.

? Isso é apenas uma prova de conceito e tem alguns bugs conhecidos. Você seria melhor servido criando isso por conta própria por enquanto.

$ python create.py -n summary.yml

creating prompt file summary.yml ...

title (str): Summarize blog posts

description (str): Summarize a blog post with key takeaways

category (str): summarization

provider (str) : openai

model (str) : gpt-3.5-turbo

temperature (float) : 0.8

top_k (int) :

top_p (float) : 0.9

max_tokens (int) : 512

stream (bool) : false

presence_penalty (float) :

frequency_penalty (float) :

prompt (str): Summarize the blog post provided below with 3-5 key takeaways as bullet points: {blog_content}

references (seq) : https://github.com/deadbits/prompt-serve

associations (seq) :

packs (seq) :

tags (seq) :

successfully wrote file summary.yml