Хранить и обслуживать языковые подсказки

prompt-serve помогает вам управлять всеми вашими подсказотелями для модели большой языка (LLM) и связанными с ними настроек/метаданными, простым, контролируемым версией.

Этот проект предоставляет схему YAML для хранения подсказок структурированным образом и небольшого сервера API, который обрабатывает взаимодействие с репозиторием GIT, поэтому вы можете рассматривать подсказки, которые больше похожи на код повторного использования.

Подсказки следуют схеме, предоставленной в Schema.yml.

Проверьте репозиторий подсказок, чтобы увидеть его в действии.

title : prompt-title-or-name

uuid : prompt-uuid

description : prompt-description

category : prompt-category

provider : model-provider

model : model-name

model_settings :

temperature : 0.8

top_k : 40

top_p : 0.9

prompt : prompt-text

input_variables :

- var1

- var2

references :

- https://example.com

- https://example.com

associations :

- prompt_uuid

- prompt_uuid

packs :

- pack-uuid

- pack-uuid

tags :

- tag

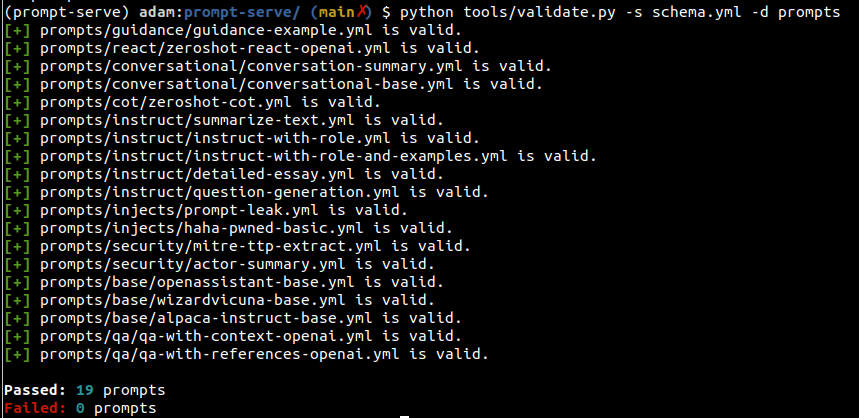

- tag Вы можете использовать утилиту validate.py для проверки подсказок, соответствующих схеме и иметь уникальные UUID.

Указав аргумент --create , будет предоставлен новый UUID, если данная подсказка не является уникальной для вашего отсканированного набора. Вы также можете собрать статистику о типах подсказок в вашей коллекции, передавая --gen-stats (см. Следующий раздел, например, вывод статистики).

usage: validate.py [-h] [-s SCHEMA] [-f FILE] [-d DIRECTORY] [-c] [-g]

Validate YAML files against the prompt-serve schema.

options:

-h, --help show this help message and exit

-s SCHEMA, --schema SCHEMA

schema file to validate against

-f FILE, --file FILE single file to validate

-d DIRECTORY, --directory DIRECTORY

directory to validate

-c, --create create new uuids if validation fails

-g, --gen-stats generate statistics from directory

Пример вывода

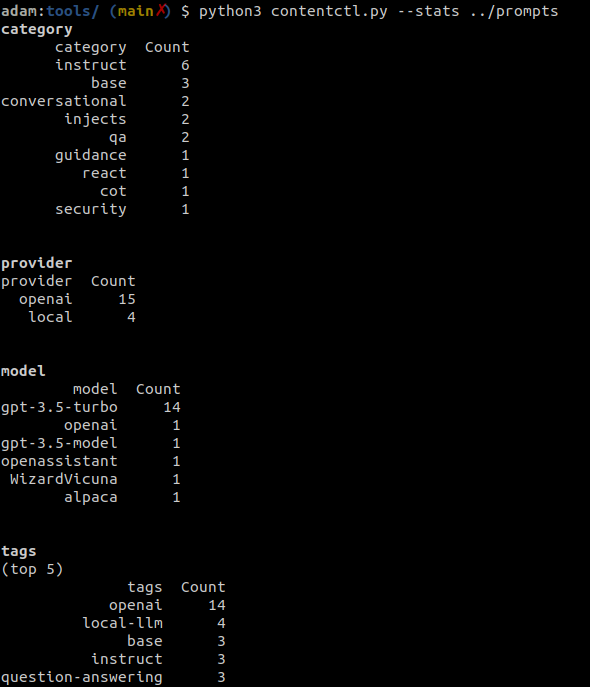

Инструмент управления контентом может использоваться для сканирования каталога хранилища в сборе быстрого обеспечения и отображения статистики обо всех подсказках в сборе, включая информацию о категории, поставщике, модели и тегах.

Статистика также может быть получена при желании при запуске validate.py.

Пример вывода

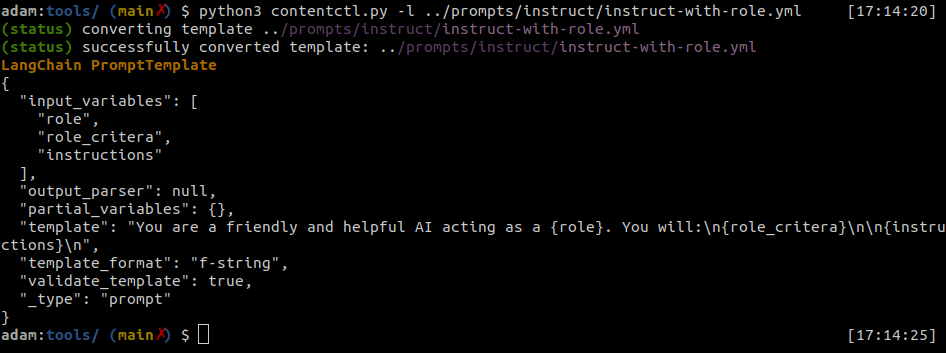

Файлы подсказки могут быть легко преобразованы в шаблоны приглашения Langchain.

Инструмент управления контентом может преобразовать отдельные файлы подсказок в формат Langchain.

Пример вывода

Питон

import yaml

from langhain import PromptTemplate

def convert ( path_to_ps_prompt ):

with open ( path_to_ps_prompt , 'r' ) as fp :

data = yaml . safe_load ( fp )

prompt = data [ 'prompt' ]

if 'input_vars' in data . keys ():

input_vars = data [ 'input_vars' ]

langchain_template = PromptTemplate ( template = prompt , input_variables = input_vars )

else :

langchain_template = PromptTemplate ( template = prompt , input_variables = [])

return langchain_template Инструмент управления контентом может использоваться для интерактивного создания подсказки со схемой сбора приглашения.

? Это всего лишь доказательство концепции и имеет несколько известных ошибок. Вам сейчас лучше будет создавать их самостоятельно.

$ python create.py -n summary.yml

creating prompt file summary.yml ...

title (str): Summarize blog posts

description (str): Summarize a blog post with key takeaways

category (str): summarization

provider (str) : openai

model (str) : gpt-3.5-turbo

temperature (float) : 0.8

top_k (int) :

top_p (float) : 0.9

max_tokens (int) : 512

stream (bool) : false

presence_penalty (float) :

frequency_penalty (float) :

prompt (str): Summarize the blog post provided below with 3-5 key takeaways as bullet points: {blog_content}

references (seq) : https://github.com/deadbits/prompt-serve

associations (seq) :

packs (seq) :

tags (seq) :

successfully wrote file summary.yml