อ่านเอกสารการเปรียบเทียบ DETREX | หน้าโครงการ | ? ️Cite Detrex | ? deepdataspace

เอกสาร การติดตั้ง ? Model Zoo | DETR ที่ยอดเยี่ยม | ข่าวสาร | ปัญหาการรายงาน

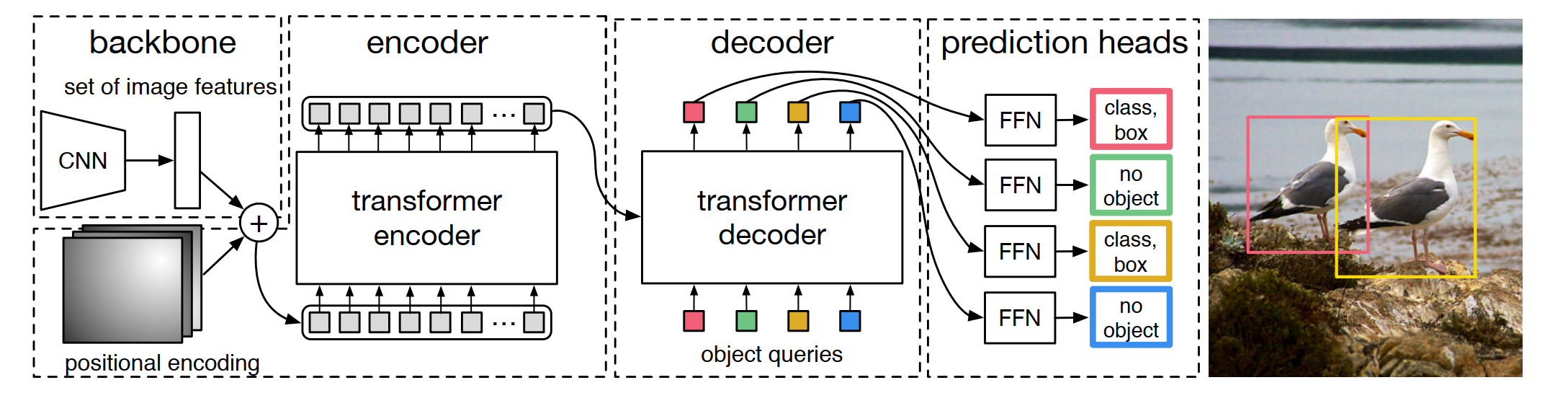

DETREX เป็นกล่องเครื่องมือโอเพนซอร์ซที่ให้บริการอัลกอริทึมการตรวจจับที่ใช้หม้อแปลงที่ทันสมัย มันถูกสร้างขึ้นที่ด้านบนของ Detectron2 และการออกแบบโมดูลของมันถูกยืมบางส่วนจาก MMDetection และ DETR ขอบคุณมากสำหรับรหัสที่จัดระเบียบอย่างดี สาขาหลักทำงานร่วมกับ Pytorch 1.10+ หรือสูงกว่า (เราขอแนะนำ Pytorch 1.12 )

การออกแบบแบบแยกส่วน DETREX สลายตัวกรอบการตรวจจับที่ใช้หม้อแปลงเป็นส่วนประกอบต่าง ๆ ซึ่งช่วยให้ผู้ใช้สร้างโมเดลที่ปรับแต่งเองได้อย่างง่ายดาย

เส้นเขตแดนที่แข็งแกร่ง DETREX จัดเตรียมชุดของเส้นเขตแดนที่แข็งแกร่งสำหรับแบบจำลองการตรวจจับที่ใช้หม้อแปลง เราได้เพิ่มประสิทธิภาพของโมเดลจาก 0.2 AP เป็น 1.1 AP ผ่านการปรับพารามิเตอร์ไฮเปอร์ให้เหมาะสมในอัลกอริทึมที่รองรับส่วนใหญ่

ใช้งานง่าย Detrex ได้รับการออกแบบให้มี น้ำหนักเบา และง่ายสำหรับผู้ใช้ที่จะใช้:

นอกเหนือจาก Detrex แล้วเรายังได้เปิดตัวหม้อแปลงตรวจจับการตรวจจับที่ยอดเยี่ยมเพื่อนำเสนอเอกสารเกี่ยวกับหม้อแปลงสำหรับการตรวจจับและการแบ่งส่วน

ชื่อ repo detrex มีการตีความหลายอย่าง:

DETR-EX : เราถอดหมวกของเราออกไปที่ DETR และพิจารณาว่า repo นี้เป็นส่วนขยายของอัลกอริทึมการตรวจจับที่ใช้หม้อแปลง

Det-Rex : Rex หมายถึง 'ราชา' อย่างแท้จริงในภาษาละติน เราหวังว่า repo นี้จะช่วยให้ทันสมัยในการตรวจจับวัตถุโดยการจัดหาอัลกอริทึมการตรวจจับที่ใช้หม้อแปลงที่ดีที่สุดจากชุมชนการวิจัย

de-t.rex : เดอหมายถึง 'ในภาษาดัตช์ T.Rex หรือที่เรียกว่า Tyrannosaurus Rex หมายถึง 'ราชาแห่งกิ้งก่าทรราช' และเชื่อมต่อกับงานวิจัยของเรา 'Dino' ซึ่งสั้นสำหรับไดโนเสาร์

V0.5.0 เปิดตัวเมื่อวันที่ 16/07/2023:

โปรดดู Changelog.md สำหรับรายละเอียดและประวัติการวางจำหน่าย

โปรดดูคำแนะนำการติดตั้งสำหรับรายละเอียดการติดตั้ง

โปรดดูการเริ่มต้นใช้งานกับ Detrex สำหรับการใช้งานขั้นพื้นฐานของ Detrex นอกจากนี้เรายังมีบทเรียนอื่น ๆ สำหรับ:

แม้ว่าบางส่วนของบทเรียนจะถูกนำเสนอด้วยเนื้อหาที่ค่อนข้างง่าย แต่เราจะปรับปรุงเอกสารของเราอย่างต่อเนื่องเพื่อช่วยให้ผู้ใช้บรรลุประสบการณ์ผู้ใช้ที่ดีขึ้น

โปรดดูเอกสารประกอบสำหรับเอกสารและบทเรียนเต็ม API

ผลลัพธ์และรุ่นมีอยู่ในสวนสัตว์รุ่น

โปรดดูโครงการสำหรับรายละเอียดเกี่ยวกับโครงการที่สร้างขึ้นตาม DETREX

โครงการนี้เปิดตัวภายใต้ใบอนุญาต Apache 2.0

หากคุณใช้กล่องเครื่องมือนี้ในการวิจัยของคุณหรือต้องการอ้างถึงผลลัพธ์พื้นฐานที่เผยแพร่ที่นี่โปรดใช้รายการ BIBTEX ต่อไปนี้:

@misc { ren2023detrex ,

title = { detrex: Benchmarking Detection Transformers } ,

author = { Tianhe Ren and Shilong Liu and Feng Li and Hao Zhang and Ailing Zeng and Jie Yang and Xingyu Liao and Ding Jia and Hongyang Li and He Cao and Jianan Wang and Zhaoyang Zeng and Xianbiao Qi and Yuhui Yuan and Jianwei Yang and Lei Zhang } ,

year = { 2023 } ,

eprint = { 2306.07265 } ,

archivePrefix = { arXiv } ,

primaryClass = { cs.CV }

} @inproceedings { carion2020end ,

title = { End-to-end object detection with transformers } ,

author = { Carion, Nicolas and Massa, Francisco and Synnaeve, Gabriel and Usunier, Nicolas and Kirillov, Alexander and Zagoruyko, Sergey } ,

booktitle = { European conference on computer vision } ,

pages = { 213--229 } ,

year = { 2020 } ,

organization = { Springer }

}

@inproceedings {

zhu2021deformable,

title = { Deformable {{}DETR{}}: Deformable Transformers for End-to-End Object Detection } ,

author = { Xizhou Zhu and Weijie Su and Lewei Lu and Bin Li and Xiaogang Wang and Jifeng Dai } ,

booktitle = { International Conference on Learning Representations } ,

year = { 2021 } ,

url = { https://openreview.net/forum?id=gZ9hCDWe6ke }

}

@inproceedings { meng2021-CondDETR ,

title = { Conditional DETR for Fast Training Convergence } ,

author = { Meng, Depu and Chen, Xiaokang and Fan, Zejia and Zeng, Gang and Li, Houqiang and Yuan, Yuhui and Sun, Lei and Wang, Jingdong } ,

booktitle = { Proceedings of the IEEE International Conference on Computer Vision (ICCV) } ,

year = { 2021 }

}

@inproceedings {

liu2022dabdetr,

title = { {DAB}-{DETR}: Dynamic Anchor Boxes are Better Queries for {DETR} } ,

author = { Shilong Liu and Feng Li and Hao Zhang and Xiao Yang and Xianbiao Qi and Hang Su and Jun Zhu and Lei Zhang } ,

booktitle = { International Conference on Learning Representations } ,

year = { 2022 } ,

url = { https://openreview.net/forum?id=oMI9PjOb9Jl }

}

@inproceedings { li2022dn ,

title = { Dn-detr: Accelerate detr training by introducing query denoising } ,

author = { Li, Feng and Zhang, Hao and Liu, Shilong and Guo, Jian and Ni, Lionel M and Zhang, Lei } ,

booktitle = { Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition } ,

pages = { 13619--13627 } ,

year = { 2022 }

}

@inproceedings {

zhang2023dino,

title = { {DINO}: {DETR} with Improved DeNoising Anchor Boxes for End-to-End Object Detection } ,

author = { Hao Zhang and Feng Li and Shilong Liu and Lei Zhang and Hang Su and Jun Zhu and Lionel Ni and Heung-Yeung Shum } ,

booktitle = { The Eleventh International Conference on Learning Representations } ,

year = { 2023 } ,

url = { https://openreview.net/forum?id=3mRwyG5one }

}

@InProceedings { Chen_2023_ICCV ,

author = { Chen, Qiang and Chen, Xiaokang and Wang, Jian and Zhang, Shan and Yao, Kun and Feng, Haocheng and Han, Junyu and Ding, Errui and Zeng, Gang and Wang, Jingdong } ,

title = { Group DETR: Fast DETR Training with Group-Wise One-to-Many Assignment } ,

booktitle = { Proceedings of the IEEE/CVF International Conference on Computer Vision (ICCV) } ,

month = { October } ,

year = { 2023 } ,

pages = { 6633-6642 }

}

@InProceedings { Jia_2023_CVPR ,

author = { Jia, Ding and Yuan, Yuhui and He, Haodi and Wu, Xiaopei and Yu, Haojun and Lin, Weihong and Sun, Lei and Zhang, Chao and Hu, Han } ,

title = { DETRs With Hybrid Matching } ,

booktitle = { Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) } ,

month = { June } ,

year = { 2023 } ,

pages = { 19702-19712 }

}

@InProceedings { Li_2023_CVPR ,

author = { Li, Feng and Zhang, Hao and Xu, Huaizhe and Liu, Shilong and Zhang, Lei and Ni, Lionel M. and Shum, Heung-Yeung } ,

title = { Mask DINO: Towards a Unified Transformer-Based Framework for Object Detection and Segmentation } ,

booktitle = { Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) } ,

month = { June } ,

year = { 2023 } ,

pages = { 3041-3050 }

}

@article { yan2023bridging ,

title = { Bridging the Gap Between End-to-end and Non-End-to-end Multi-Object Tracking } ,

author = { Yan, Feng and Luo, Weixin and Zhong, Yujie and Gan, Yiyang and Ma, Lin } ,

journal = { arXiv preprint arXiv:2305.12724 } ,

year = { 2023 }

}

@InProceedings { Chen_2023_CVPR ,

author = { Chen, Fangyi and Zhang, Han and Hu, Kai and Huang, Yu-Kai and Zhu, Chenchen and Savvides, Marios } ,

title = { Enhanced Training of Query-Based Object Detection via Selective Query Recollection } ,

booktitle = { Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) } ,

month = { June } ,

year = { 2023 } ,

pages = { 23756-23765 }

}