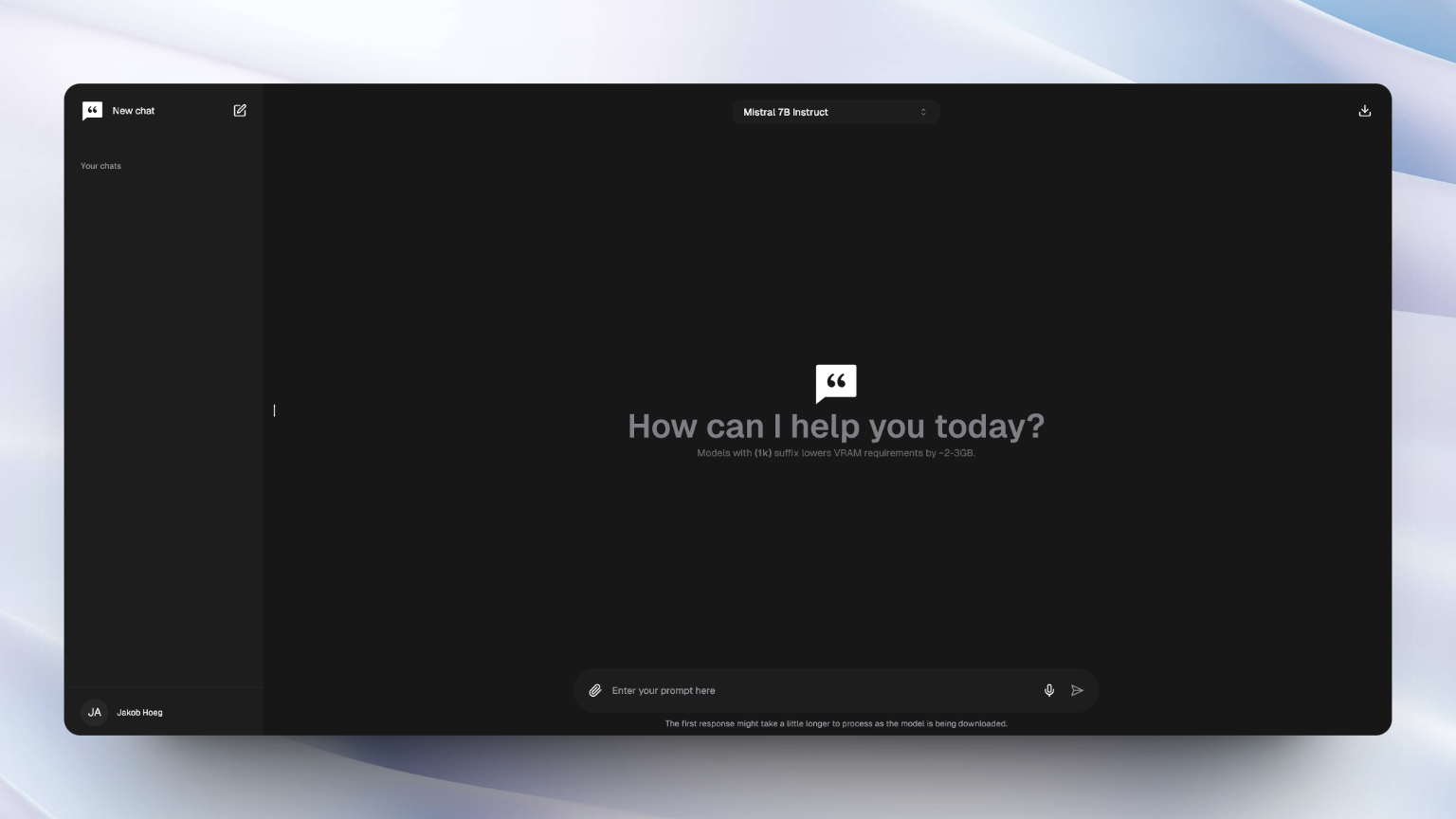

Chatty เป็น AI ส่วนตัวของคุณที่ใช้ประโยชน์จาก WebGPU ในการเรียกใช้รูปแบบภาษาขนาดใหญ่ (LLMS) โดยธรรมชาติและเป็นส่วนตัวในเบราว์เซอร์ของคุณนำคุณลักษณะที่หลากหลายที่สุดในเบราว์เซอร์ AI

โครงการนี้หมายถึงความพยายามที่ใกล้เคียงที่สุดในการนำความเป็นอยู่ที่ความเป็นอยู่และการใช้งานจากอินเทอร์เฟซ AI ยอดนิยมเช่น CHATGPT และ Gemini มาสู่ประสบการณ์ในเบราว์เซอร์

โดยค่าเริ่มต้น WebGPU จะเปิดใช้งานและรองรับทั้งใน Chrome และ Edge อย่างไรก็ตามมันเป็นไปได้ที่จะเปิดใช้งานใน Firefox และ Firefox ทุกคืน ตรวจสอบความเข้ากันได้ของเบราว์เซอร์สำหรับข้อมูลเพิ่มเติม

หากคุณเพียงแค่ต้องการลองใช้แอพมันมีชีวิตอยู่ในเว็บไซต์นี้

นี่คือแอปพลิเคชันถัดไป JS และต้องการ Node.js (18+) และ NPM ที่ติดตั้งเพื่อเรียกใช้โครงการในเครื่อง

หากคุณต้องการตั้งค่าและเรียกใช้โครงการในเครื่องให้ทำตามขั้นตอนด้านล่าง:

1. โคลนที่เก็บไปยังไดเรกทอรีบนพีซีของคุณผ่านพรอมต์คำสั่ง:

git clone https://github.com/addyosmani/chatty

2. เปิดโฟลเดอร์:

cd chatty

3. ติดตั้งการพึ่งพา:

npm install

4. เริ่มเซิร์ฟเวอร์การพัฒนา:

npm run dev

5. ไปที่ LocalHost: 3000 และเริ่มแชท!

บันทึก

DockerFile ยังไม่ได้รับการปรับให้เหมาะสมสำหรับสภาพแวดล้อมการผลิต หากคุณต้องการทำด้วยตัวเองให้ชำระเงินตัวอย่าง nextjs

docker build -t chattyui .

docker run -d -p 3000:3000 chattyui

หรือใช้ docker-compose :

docker compose up

หากคุณมีการเปลี่ยนแปลงและต้องการสร้างใหม่คุณสามารถเรียกใช้

docker-compose up --build

การมีส่วนร่วมเป็นมากกว่าการต้อนรับ! อย่างไรก็ตามโปรดตรวจสอบให้แน่ใจว่าได้อ่านแนวทางการสนับสนุนก่อน :)

บันทึก

ในการเรียกใช้โมเดลอย่างมีประสิทธิภาพคุณจะต้องมี GPU ที่มีหน่วยความจำเพียงพอ รุ่น 7B ต้องการ GPU ที่มีหน่วยความจำประมาณ 6GB ในขณะที่รุ่น 3B ต้องการประมาณ 3GB

รุ่นที่เล็กกว่าอาจไม่สามารถประมวลผลไฟล์ฝังได้อย่างมีประสิทธิภาพเท่ากับรุ่นที่ใหญ่กว่า

Chatty ถูกสร้างขึ้นโดยใช้โครงการ WebLLM โดยใช้ HuggingFace, Open Source LLMS และ Langchain เราต้องการรับทราบผลงานที่ยอดเยี่ยมของพวกเขาและขอบคุณชุมชนโอเพ่นซอร์ส

Chatty ถูกสร้างและดูแลโดย Addy Osmani & Jakob Hoeg Mørk