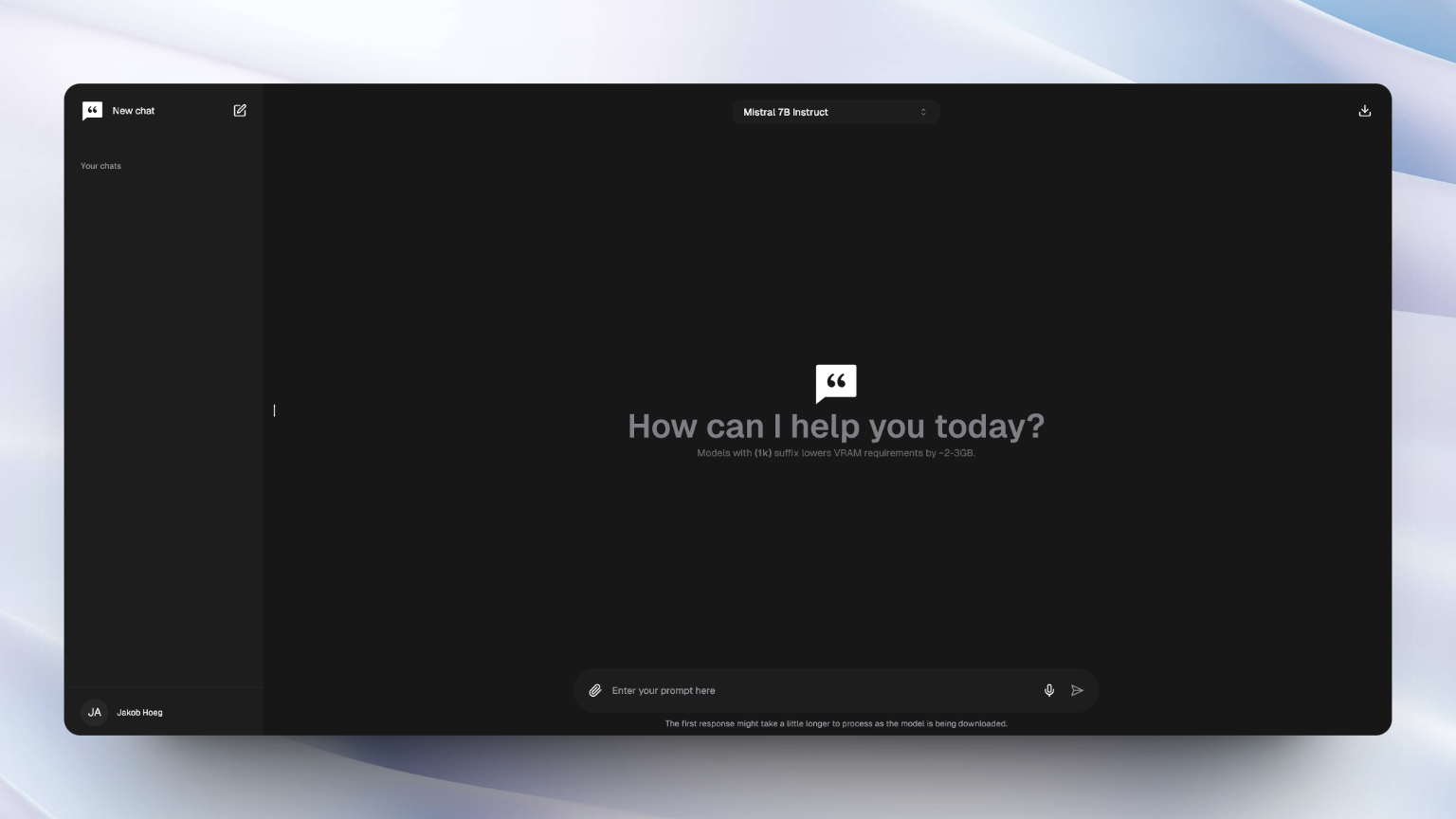

Chaty ist Ihre private KI, die WebGPU nutzt, um große Sprachmodelle (LLMs) nativ und privat in Ihrem Browser auszuführen und Ihnen die meiste Feature Rich In-Browser-KI-Erfahrung zu bieten.

Dieses Projekt soll der engste Versuch sein, die Freiheit und Funktionalität von populären KI-Schnittstellen wie Chatgpt und Gemini in ein In-Browser-Erlebnis zu bringen.

Standardmäßig ist WebGPU sowohl in Chrome als auch in Edge aktiviert und unterstützt. Es ist jedoch möglich, es Nacht in Firefox und Firefox zu aktivieren. Weitere Informationen finden Sie in der Browserkompatibilität.

Wenn Sie nur die App ausprobieren möchten, ist sie auf dieser Website live.

Dies ist eine Next.js -Anwendung und erfordert Node.js (18+) und NPM, um das Projekt lokal auszuführen.

Wenn Sie das Projekt lokal einrichten und ausführen möchten, befolgen Sie die folgenden Schritte:

1. Klonen Sie das Repository über die Eingabeaufforderung in ein Verzeichnis auf Ihrem PC:

git clone https://github.com/addyosmani/chatty

2. Öffnen Sie den Ordner:

cd chatty

3. Installieren Sie Abhängigkeiten:

npm install

4. Starten Sie den Entwicklungsserver:

npm run dev

5. Gehen Sie zu Localhost: 3000 und beginnen Sie mit dem Chatten!

Notiz

Die Dockerfile wurde noch nicht für eine Produktionsumgebung optimiert. Wenn Sie dies selbst tun möchten, sehen Sie sich das nächste Js -Beispiel an

docker build -t chattyui .

docker run -d -p 3000:3000 chattyui

Oder verwenden Sie docker-compose :

docker compose up

Wenn Sie Änderungen vorgenommen haben und wieder aufbauen möchten, können Sie einfach

docker-compose up --buildausführen

Beiträge sind mehr als willkommen! Bitte lesen Sie jedoch zuerst die beitragenden Richtlinien :)

Notiz

Um die Modelle effizient auszuführen, benötigen Sie eine GPU mit genügend Speicher. 7B -Modelle erfordern eine GPU mit etwa 6 GB Speicher, während 3B -Modelle etwa 3 GB benötigen.

Kleinere Modelle sind möglicherweise nicht in der Lage, Dateieinbettungen so effizient zu verarbeiten wie größere.

Chatty wird mit dem Webllm -Projekt erstellt, wobei Huggingface, Open Source LLMS und Langchain verwendet werden. Wir möchten ihre großartige Arbeit anerkennen und der Open -Source -Community danken.

Chatty wird von Addy Osmani & Jakob Hoeg Mørk erstellt und gepflegt.