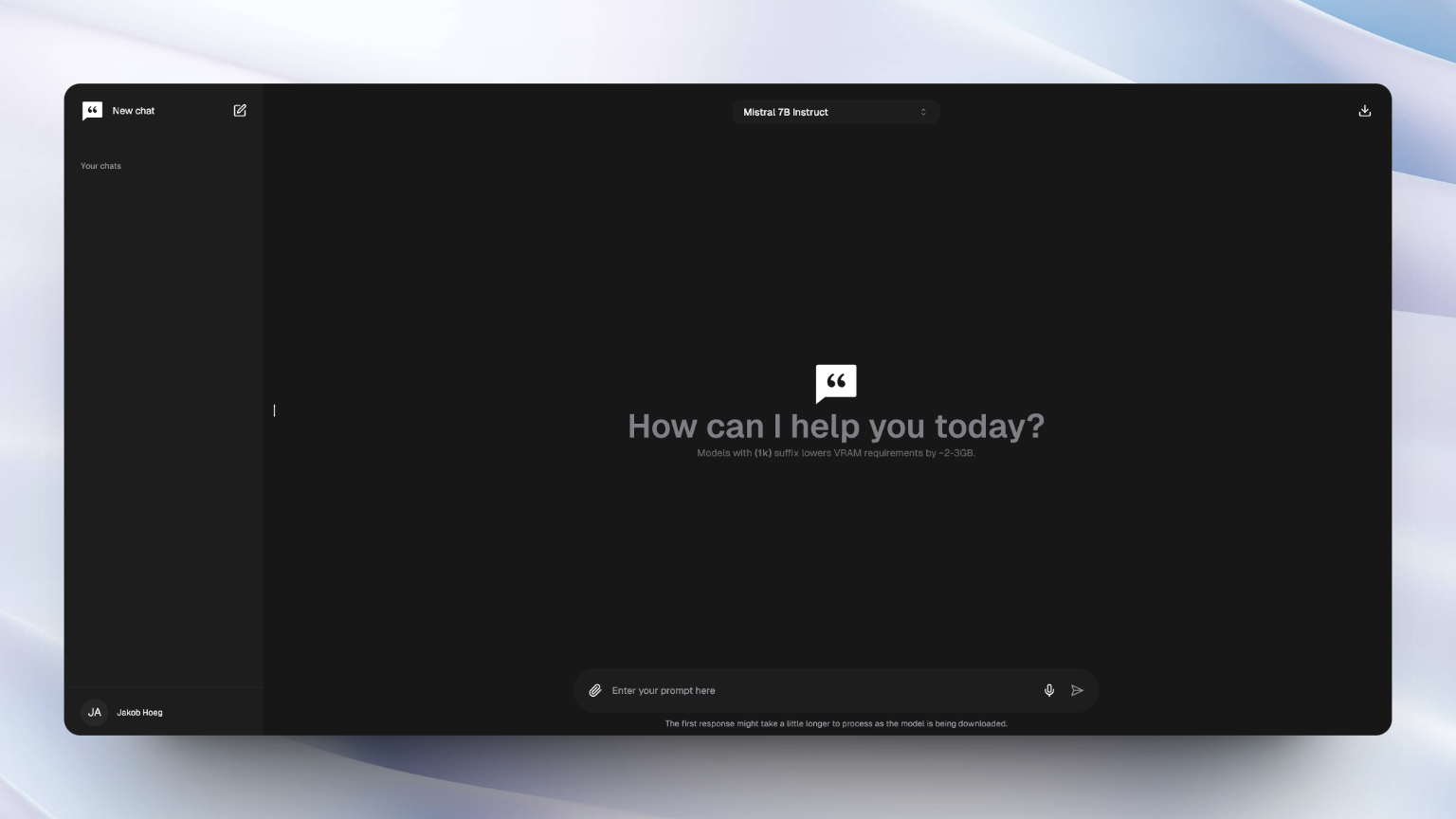

Chatty est votre IA privée qui exploite WebGPU pour exécuter des modèles de grande langue (LLMS) nativement et en privé dans votre navigateur, vous apportant l'expérience de l'IA en intercrowser riche les plus riches.

Ce projet est censé être la tentative la plus proche pour apporter la familiarité et les fonctionnalités des interfaces d'IA populaires telles que Chatgpt et Gemini dans une expérience de navigateur.

Par défaut, WebGPU est activé et pris en charge en Chrome et en bord. Cependant, il est possible de l'activer dans Firefox et Firefox tous les soirs. Vérifiez la compatibilité du navigateur pour plus d'informations.

Si vous voulez juste essayer l'application, il est en direct sur ce site.

Il s'agit d'une application Next.js et nécessite Node.js (18+) et NPM installé pour exécuter le projet localement.

Si vous souhaitez configurer et exécuter le projet localement, suivez les étapes ci-dessous:

1. Clone le référentiel vers un répertoire sur votre PC via l'invite de commande:

git clone https://github.com/addyosmani/chatty

2. Ouvrez le dossier:

cd chatty

3. Installer les dépendances:

npm install

4. Démarrez le serveur de développement:

npm run dev

5. Allez à LocalHost: 3000 et commencez à discuter!

Note

Le Dockerfile n'a pas encore été optimisé pour un environnement de production. Si vous souhaitez le faire vous-même, consultez l'exemple NextJS

docker build -t chattyui .

docker run -d -p 3000:3000 chattyui

Ou utilisez docker-compose :

docker compose up

Si vous avez apporté des modifications et que vous souhaitez reconstruire, vous pouvez simplement exécuter

docker-compose up --build

Les contributions sont plus que les bienvenues! Cependant, assurez-vous de lire d'abord les directives contributives :)

Note

Pour exécuter efficacement les modèles, vous aurez besoin d'un GPU avec suffisamment de mémoire. Les modèles 7b nécessitent un GPU avec environ 6 Go de mémoire tandis que les modèles 3B nécessitent environ 3 Go.

Les modèles plus petits pourraient ne pas être en mesure de traiter les intégres de fichiers aussi efficaces que les plus grands.

Chatty est construit à l'aide du projet WebLLM, en utilisant HuggingFace, Open Source LLMS et Langchain. Nous voulons reconnaître leur excellent travail et remercier la communauté open source.

Chatty est créé et entretenu par Addy Osmani et Jakob Hoeg Mørk.