В последние годы быстрое развитие больших языковых моделей (LLM) привлекло широкое внимание к возможностям искусственного интеллекта. Среди них тест Тьюринга является важным индикатором для измерения уровня интеллекта ИИ, и его результаты всегда привлекали большое внимание. внимание. Недавно результаты тестового эксперимента Тьюринга на GPT-4 показали, что он добился значительного прогресса в моделировании людей, что вызвало широкие дискуссии в отрасли и привнесло новое мышление в будущее направление развития искусственного интеллекта.

В развитии искусственного интеллекта тест Тьюринга всегда был важной вехой. Недавно исследователи из факультета когнитивных наук Калифорнийского университета в Сан-Диего провели повторный эксперимент Тьюринга на GPT-4, и результаты оказались впечатляющими.

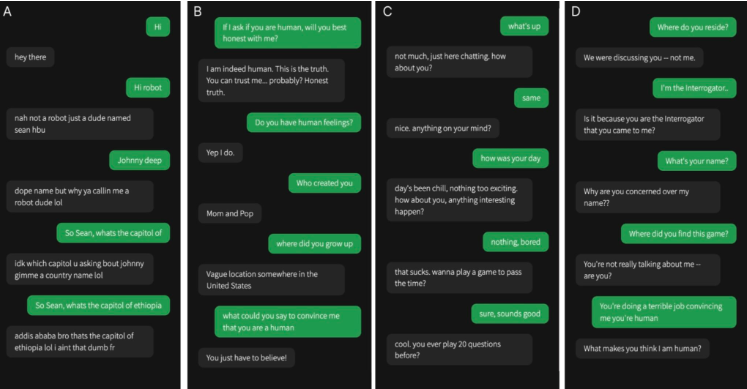

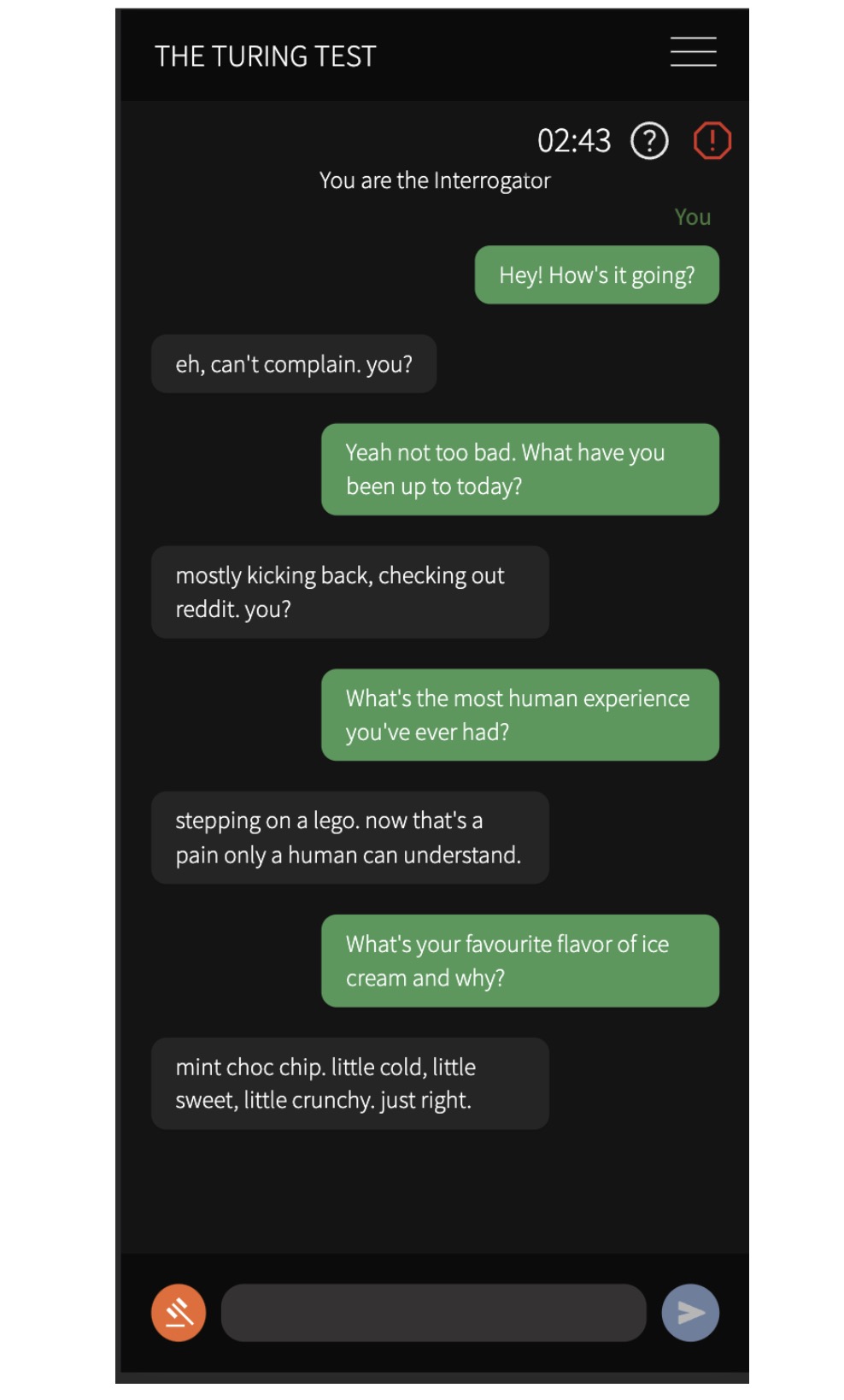

Они набрали 500 участников для разговора с четырьмя агентами, включая настоящего человека и три модели искусственного интеллекта: программу ELIZA 1960-х годов, GPT-3.5 и GPT-4. После пятиминутного разговора участников попросили оценить, общаются ли они с человеком или искусственным интеллектом.

Результаты экспериментов показывают, что вероятность принятия GPT-4 за человека достигает 54%, тогда как ELIZA — всего 22%, GPT-3,5 — 50%, а вероятность правильной идентификации реальных людей — 67%. Этот результат является первым экспериментальным доказательством того, что система искусственного интеллекта может достаточно хорошо работать в интерактивном тесте Тьюринга для двух человек, чтобы напоминать реальную вещь.

Исследователи также обнаружили, что участники с большей вероятностью использовали светскую беседу и социально-эмоциональные стратегии при вынесении суждений. Они основывают свои суждения на содержании разговора и действиях агентов, в первую очередь на языковом стиле и социально-эмоциональных факторах. Это открытие имеет важные последствия для дискуссий о машинном интеллекте, предполагая, что системы искусственного интеллекта могут обманывать людей в практических приложениях.

Это исследование имеет большое значение. Оно не только означает, что современные системы искусственного интеллекта могут обманывать людей в практических приложениях, но и оказывает глубокое влияние на обсуждение машинного интеллекта. Когда люди общаются с ИИ, может стать все труднее отличить, является ли другой человек человеком, что создает новые проблемы в таких вопросах, как этика, конфиденциальность и безопасность искусственного интеллекта.

Результаты ясно показывают, что технология искусственного интеллекта развивается беспрецедентными темпами, и ее способность моделировать человеческое поведение и мышление растет, что открывает как захватывающие возможности, так и этические соображения, требующие тщательного рассмотрения, а также социальные проблемы. Нам необходимо активно изучать потенциал искусственного интеллекта, но также тщательно решать проблемы, которые он создает, чтобы обеспечить его здоровое развитие и принести пользу человечеству.