Помощник с большим моделью

? Введение проекта

Легкий, полноразмерный и проста в средней разработке крупномасштабный проект применения

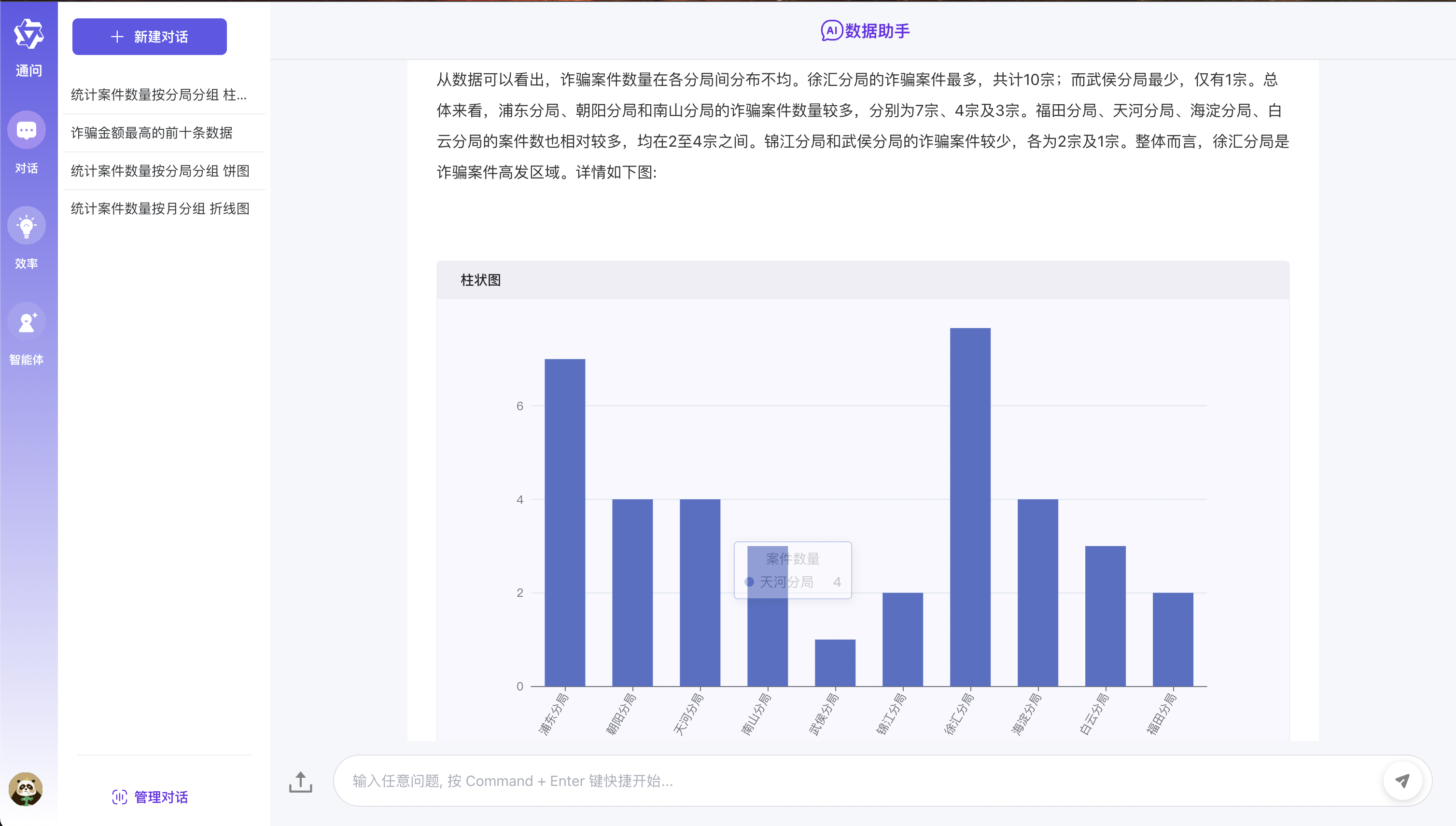

Одноэтажный проект разработки приложений с большим моделем, основанным на таких технологиях, как DIFY, OLLAMA & VLLM, SANIC и TEXT2SQL, с использованием VUE3, TypeScript и VITE 5 для создания современного пользовательского интерфейса. Он поддерживает графические ответы данных на основе больших моделей через Echarts?, И имеет возможность обрабатывать вопросы и ответы на таблицу файлов CSV. В то же время, может быть удобно подключиться к сторонним системам поиска тряпичной системы с открытым исходным кодом и т. Д. Для поддержки широкого спектра вопросов и ответов общего знания.

В качестве легкого проекта по разработке приложений Big Model Sanic-Web поддерживает быстрое итерацию и расширение, помогая крупным модельным проектам для быстрого их реализации.

? Живая демонстрация

Онлайн -опыт будет запущен, так что следите за обновлениями!

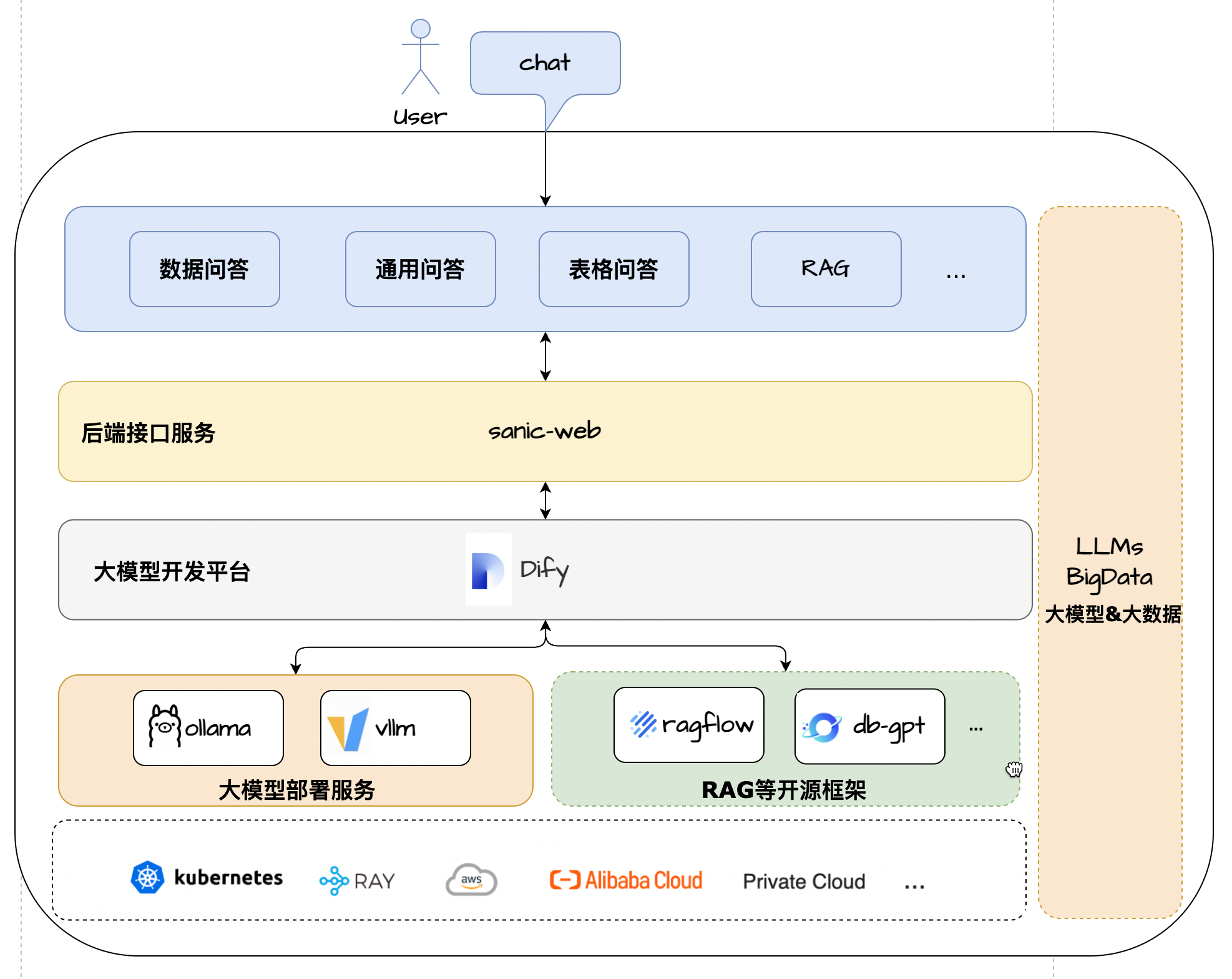

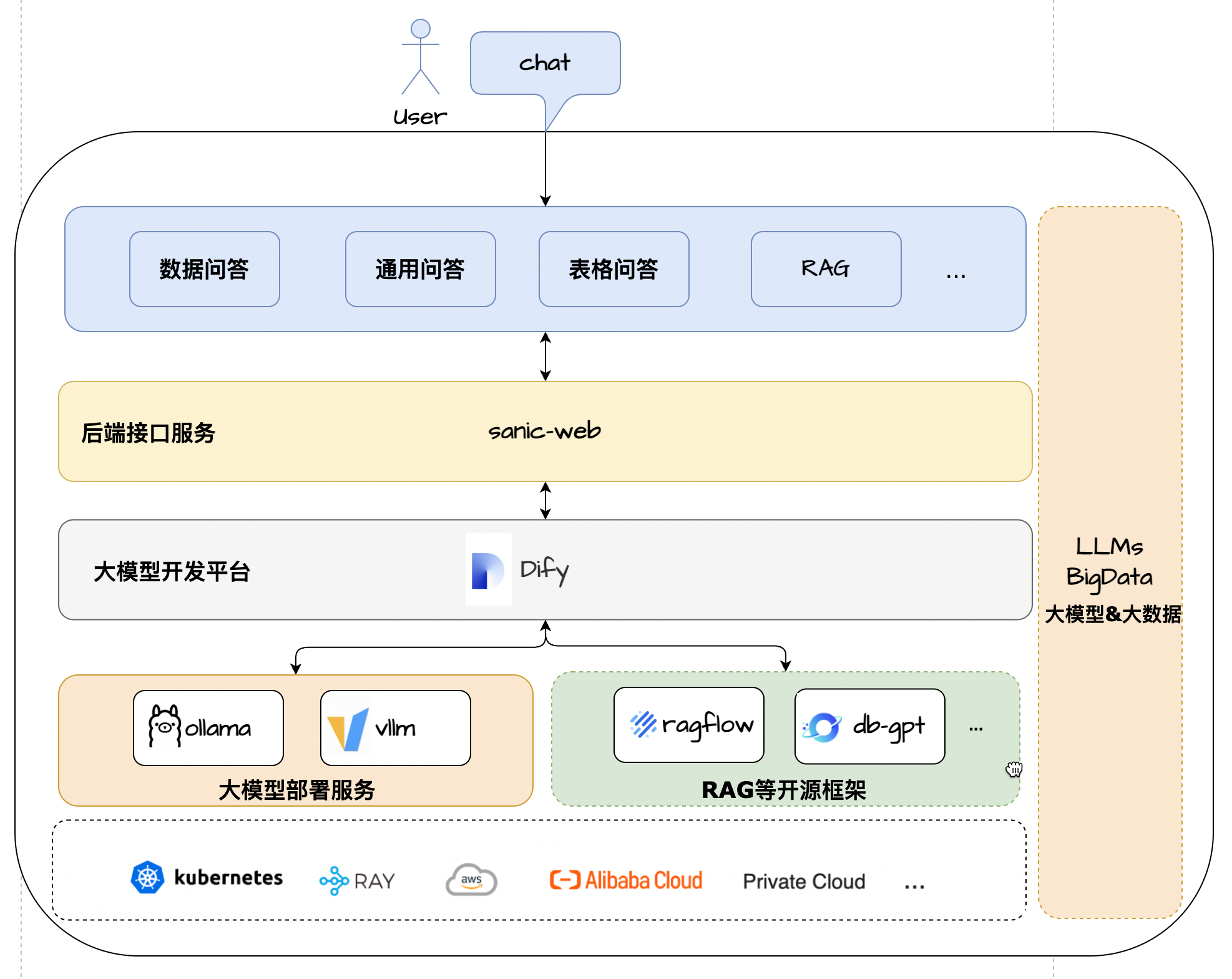

Решение архитектуры

? характеристика

- Основной технологический стек : Dify + Ollama + Rag + LLM + Text2sql

- Framework : Vue 3 + TypeScript + Vite 5

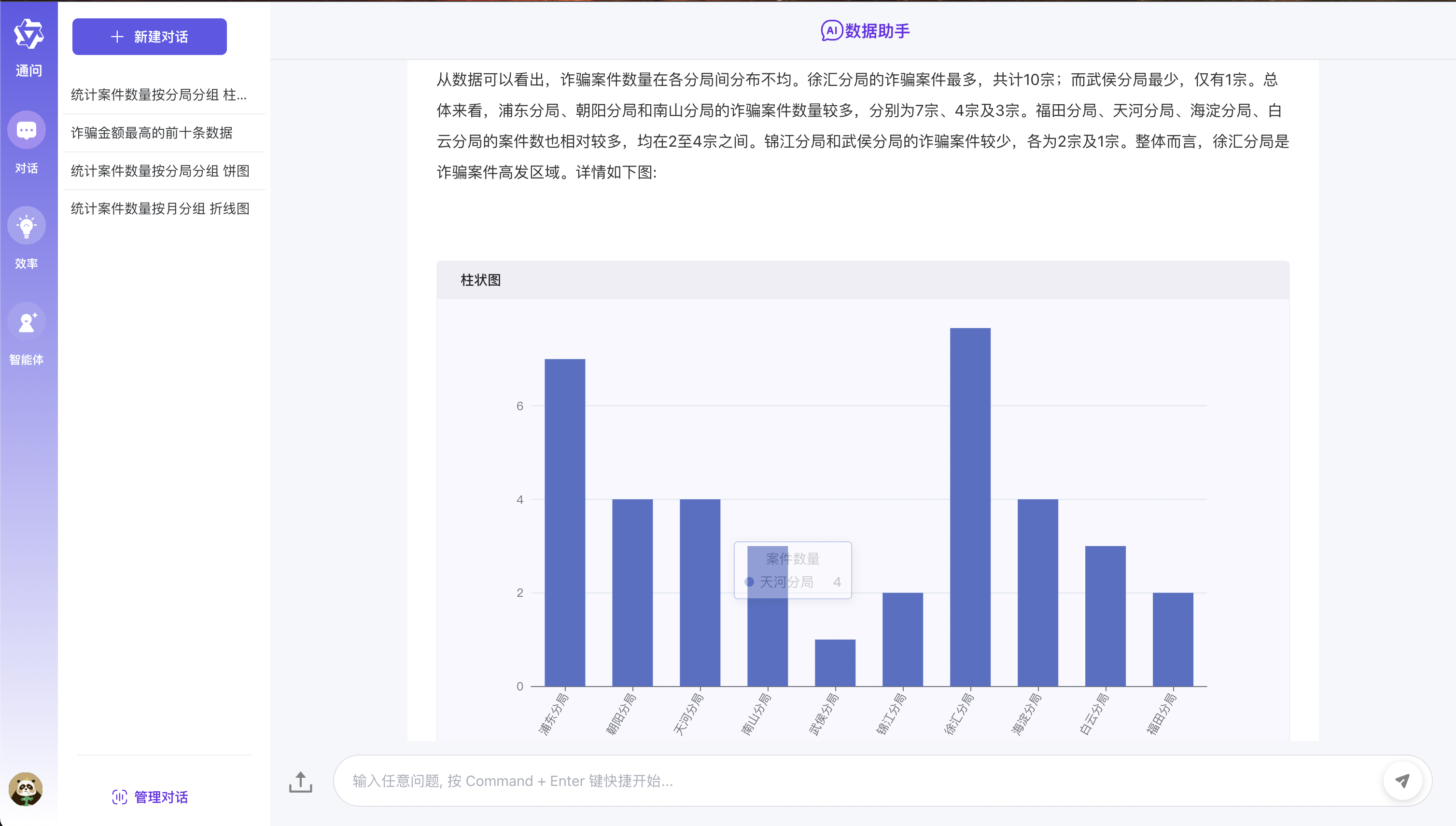

- Данные и ответы : интегрированная модель Echarts для реализации Text2sql Легкие графические данные Q & A

- Таблица Q & A : поддерживает загрузку файлов формата CSV и предварительную обработку на основе резюме большой модели и данных Text2sql Data Q & A

- Общие вопросы и ответы : поддерживает общую форму данных и ответы на основе стыковки трехпартийной тряпичной системы + режим поиска общедоступной сети

- Архитектура приложений : как легкая полноразмерная крупномасштабная структура разработки приложений, удобное расширение и реализация

- Гибкое развертывание : поддерживает крупномасштабные зависимости разработки приложений от различных компонентов Docker Compose с одним щелчком для быстрого развертывания нулевой конфигурации

Эффект бега

Требования к конфигурации среды

Прежде чем начать, убедитесь, что ваша среда разработки соответствует следующим минимальным требованиям конфигурации:

- Операционная система : Windows 10/11, серия MacOS M, Centos/Ubuntu

- GPU : используйте Ollama для развертывания локально, и рекомендуется использовать графическую карту NVIDIA или режим процессора.

- Память : 8 ГБ+

? Предварительные кондиционирования

- Python 3.8+

- Поэзия 1.8.3+

- Dify 0,7,1+

- MySQL 8.0+

- Node.js 18.12.x+

- PNPM 9.x

Большое модель развертывания

- См. Развертывание Олламы

- Модель: QWEN2.5

Конфигурация среды Dify

Используйте сценарии проекта, чтобы по умолчанию установить DIFY

- Чтобы принять во внимание учащиеся, которые впервые подвергаются воздействию приложений с большими моделями, этот проект обеспечивает конфигурацию службы службы DIFTY в одном клике, а также запускает метод обслуживания, чтобы облегчить каждому испытать его быстро.

- Dify Local Adcess Accest: http: // localhost account: [email protected] Пароль: Admin123

# 拉起内置的dify服务

cd docker/dify/docker

docker-compose up -d

Если среда Dify была установлена

- Если у вас уже есть среда Dify, в этом случае вы можете изменить исходный код локально, чтобы запустить службу !!!

- Первым шагом является непосредственный импорт Docker/Dify/Data Q & A в корневом каталоге Project.yml Canvas to dify

- Второй шаг состоит в том, чтобы изменить ключ Database_QA в перечислении DifyAppenum исходного кода ( ключ получает из холста процесса Dify )

- Третий шаг состоит в том, чтобы изменить файл .env в каталоге Project Root и изменить фактический адрес интерфейса службы Dify Rest в соответствии с средой.

- Шаг 4 Измените конфигурацию httprequest в холсте Dify и измените адрес URL-адреса на конкретный адрес службы SANIC WEB

Установите последнюю версию Dify

- Если вам нужно установить последнюю версию DIFY, вы можете обратиться к официальному документу DIFTY DIFTION.

Быстрый опыт

- Конкретные шаги следующие:

- Первый шаг - клонировать код в местном районе

- Второй шаг - ссылаться на вышеуказанное развертывание Big Model. Сначала установите Ollama, чтобы развернуть модель QWEN2.5.

- Третий шаг состоит в том, чтобы напрямую ссылаться на конфигурацию среды DIFY в конфигурации вышеуказанной среды DIFY . В первом случае [использование проектных сценариев для установки DIFY по умолчанию] очень важно !!!

- Конкретные шаги для запуска службы на четвертом этапе следующие:

- Клонирование репозитория

git clone https://github.com/apconw/sanic-web.git

- Начните сервис

# 拉起前后端服务和中间件

cd docker

docker compose up -d

- Инициализация данных

cd docker

./init.sh

或执行

cd docker

python3 ../common/initialize_mysql.py

- Access Services

- Передняя служба: http: // localhost: 8081

Местное развитие

- Первый шаг - клонировать код в местном районе

- Второй шаг - ссылаться на вышеуказанное развертывание Big Model. Сначала установите Ollama, чтобы развернуть модель QWEN2.5.

- Третий шаг - настройка среды локальной среды разработки. Пожалуйста, обратитесь к вышеуказанной конфигурации среды Dify . Вы можете выбрать первые или вторые ситуации самостоятельно.

- Шаг 4: Отредактируйте файл .env в каталоге Project Root, измените информацию ENV = deV и конфигурацию базы данных.

- Шаг 5: Установите зависимости проекта фронтального и внутреннего проекта и запустите услуги с фронтальным и бэк-эндом. Конкретные шаги следующие:

- Бэкэнд -установка зависимостей

- Поэтическая установка ссылка на официальную документацию поэзии

# 安装poetry

pip install poetry

# 安装依赖根目录执行

# 设置国内仓库

poetry source add --priority=default mirrors https://pypi.tuna.tsinghua.edu.cn/simple/

poetry install

- Установите базу данных

docker run --name mysql-local

-p 13006:3306

-v /Users/lihuan/docker-mount/mysql:/var/lib/mysql

-e MYSQL_ROOT_PASSWORD=1

-d mysql:latest

- Инициализировать базу данных

- Если вы используете локальную среду MySQL, вам необходимо изменить исходный код инициализировать_mysql при инициализации данных и изменении информации об подключении базы данных.

cd docker

./init.sh

或执行

cd docker

python3 ../common/initialize_mysql.py

Фронтовая установка зависимости

- Фронт-энд основан на проектах с открытым исходным кодом. Вы можете обратиться к Chatgpt-Vue3-Light-MVP для установки второго открытия.

# 安装前端依赖&启动服务

cd web

#安装依赖

npm install -g pnpm

pnpm i

#启动服务

pnpm dev

Начать сервис бэкэнд

Access Services

- Передняя служба: http: // localhost: 2048

? Построить зеркало

- Отредактируйте файл .env в каталоге Project Root, измените env = тест и сохранение.

- Выполнить команду сборки:

# 构建前端镜像

make web-build

# 构建后端镜像

make server-build

? поддерживать

Если вам нравится этот проект или вы нашли его полезным, вы можете щелкнуть Star в правом верхнем углу, чтобы поддержать его. Ваша поддержка - наша движущая сила для постоянного улучшения, спасибо! ^_^

Если вы обнаружите, что этот проект полезным вам или вам нравится то, что мы делаем, нажмите кнопку [️ ️ star] в правом верхнем углу, чтобы поддержать нас! Каждая ваша звезда является отличной поддержкой для нас, а также является движущей силой для нашего постоянного улучшения и развития. Спасибо за вашу поддержку! ^_^

Кроме того, если у вас есть какие -либо предложения или вы хотите принять участие в разработке проекта, вы также можете связаться с нами по следующим методам:

- Отправьте вопрос - если вы найдете какие -либо проблемы или у вас есть предложения по улучшению, вы можете отправить его по вопросам.

- Присоединяйтесь к обсуждению - вы можете добавить в нашу дискуссионную группу для общения и обсуждения. Участвовать в обсуждении.

- Код взноса - Если вы заинтересованы в сопоставлении кода, вы можете ссылаться на руководство по взносу.

Еще раз спасибо за вашу поддержку!

QA Communication Group

- Добро пожаловать в группу Big Model Application Exchange, добро пожаловать в группу, чтобы обсудить и поделиться опытом

- Следуйте официальной учетной записи ниже и нажмите на меню группы WeChat , чтобы добавить WeChat, чтобы привести вас в группу

| WeChat Group |

|---|

|

Лицензия

MIT Лицензия | Copyright © 2024-Present Aiadventurer